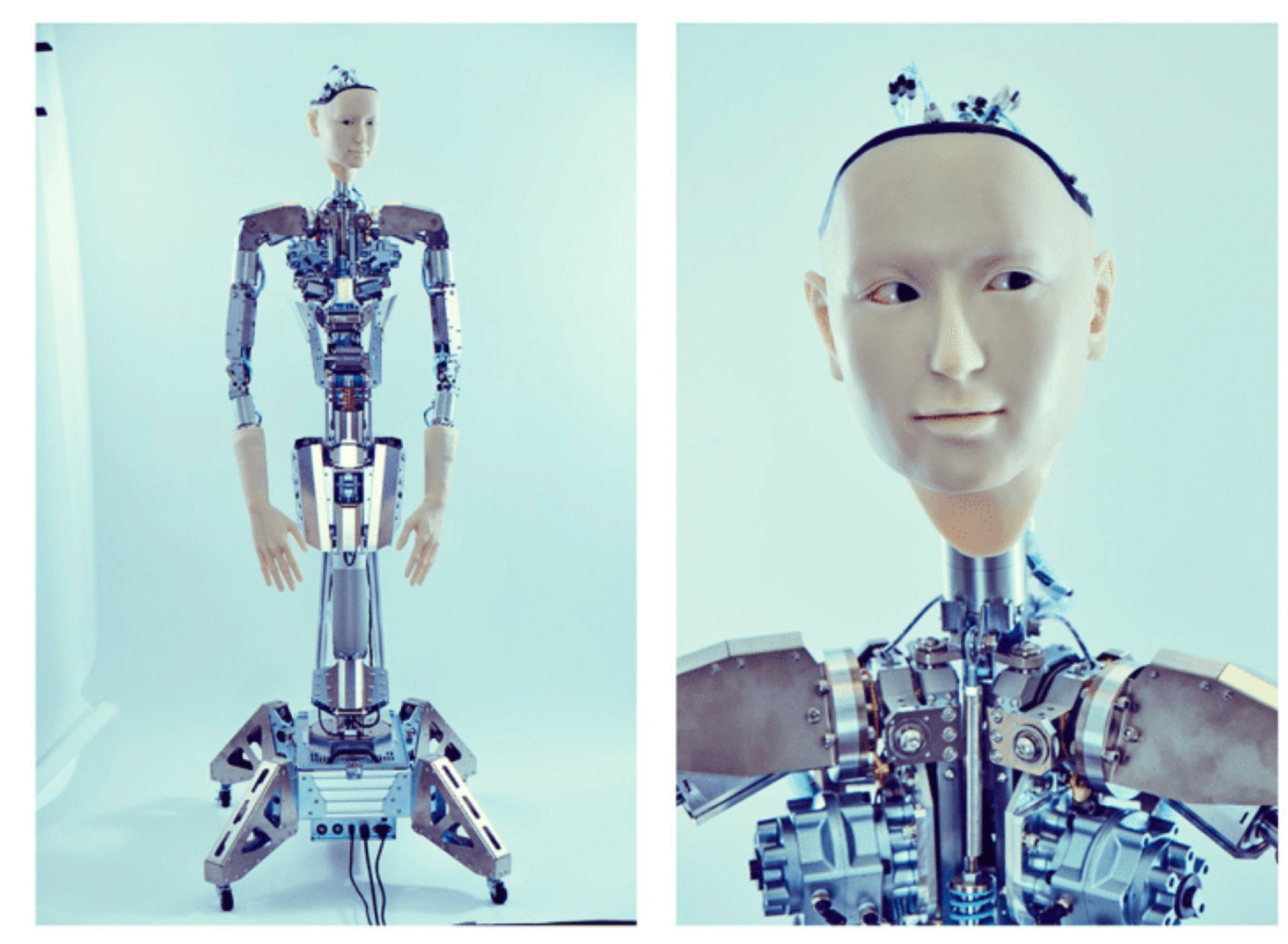

Minimal Self in Humanoid Robot "Alter3" Driven by Large Language Model

作者: Takahide Yoshida, Suzune Baba, Atsushi Masumori, Takashi Ikegami

分类: cs.RO

发布日期: 2024-06-17

备注: Accepted for proceedings in ALIFE 2024 Copenhagen

💡 一句话要点

Alter3:基于大语言模型驱动的人形机器人,探索“最小自我”

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人形机器人 大语言模型 GPT-4 自主运动 自我意识 机器人控制 人机交互

📋 核心要点

- 现有方法难以直接将语言模型应用于机器人控制,限制了机器人自主行为的生成。

- Alter3通过将语言描述转化为动作,使机器人能够自主执行任务,从而探索“最小自我”的可能性。

- 研究通过镜像自我识别和橡胶手错觉测试,评估了Alter3在与GPT-4结合后发展自我意识的潜力。

📝 摘要(中文)

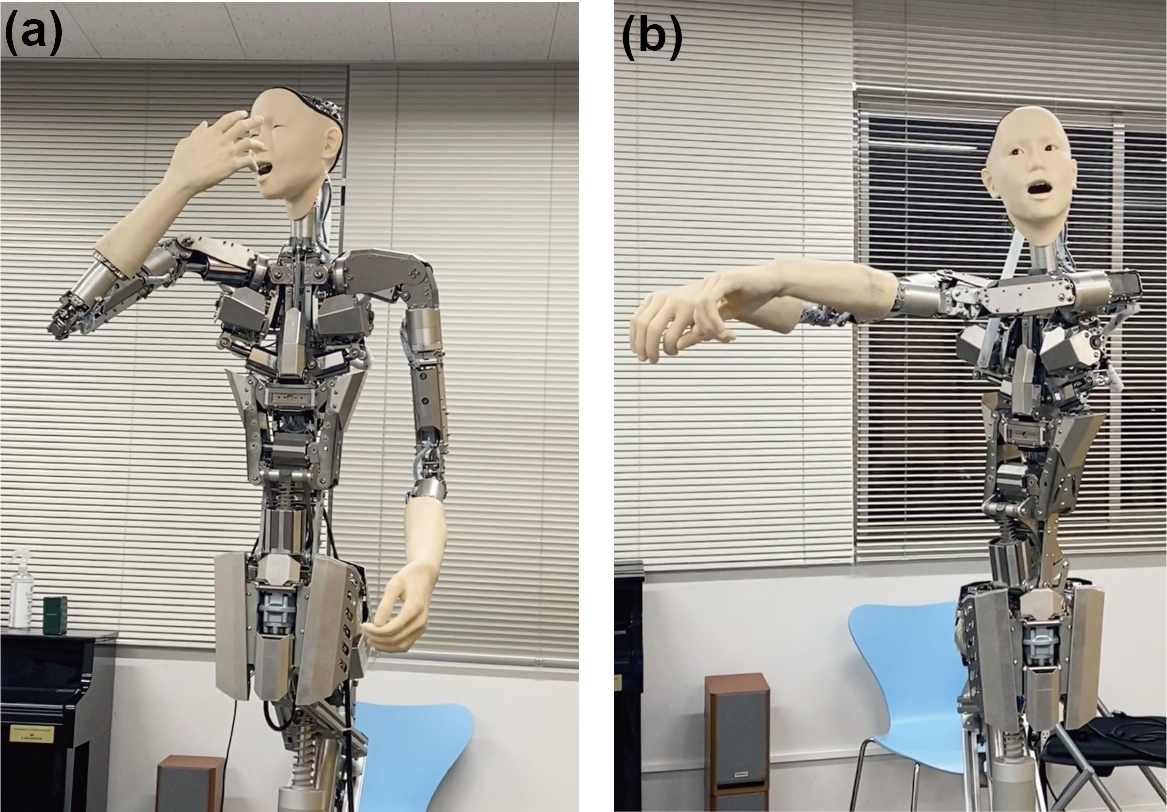

本文介绍了一种名为Alter3的人形机器人,它通过集成GPT-4大语言模型(LLM)来展示自发运动生成能力。这克服了将语言模型直接应用于机器人控制的挑战。通过将语言描述转化为动作,Alter3能够自主执行各种任务。人形机器人的关键在于其模仿人类运动和情感的能力,从而能够利用来自语言模型的人类知识。这引出了一个问题:Alter3+GPT-4是否能够发展出具有能动性和所有权感的“最小自我”。本文介绍了镜像自我识别和橡胶手错觉测试,以评估Alter3发展自我意识的潜力。研究表明,即使是脱离具体形态的语言模型,当与物理机器人平台结合时,也能发展出能动性。

🔬 方法详解

问题定义:现有机器人控制方法难以直接利用大语言模型,导致机器人缺乏自主性和对自身行为的理解。痛点在于如何将抽象的语言指令转化为具体的机器人动作,并赋予机器人一定的“自我意识”。

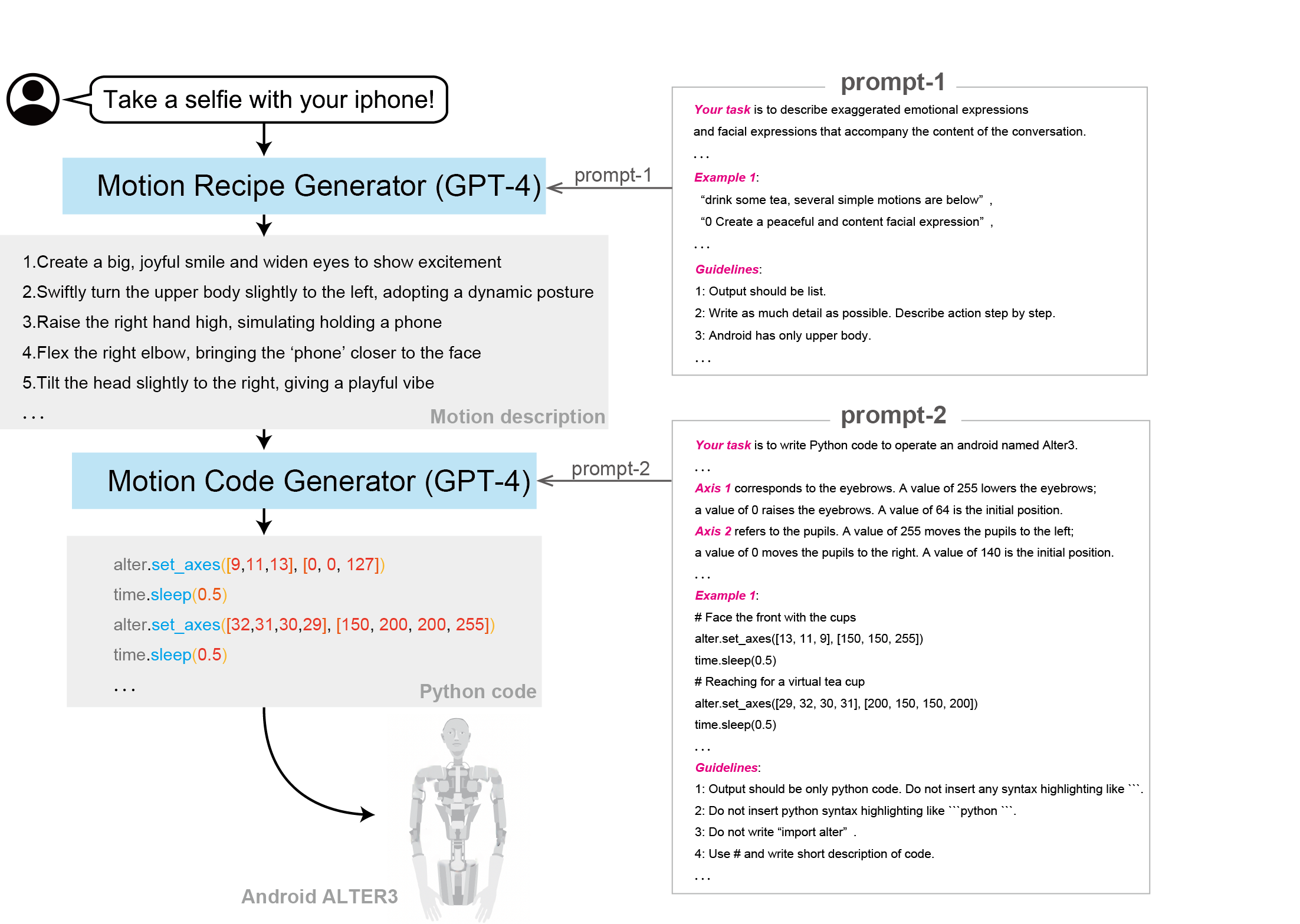

核心思路:论文的核心思路是将大语言模型GPT-4与人形机器人Alter3相结合,利用GPT-4的语言理解和生成能力,将语言指令转化为机器人可执行的动作序列。通过模拟人类的自我认知测试(镜像自我识别和橡胶手错觉),探索机器人是否能够发展出“最小自我”。

技术框架:整体框架包含两个主要部分:一是GPT-4语言模型,负责接收指令并生成相应的动作描述;二是人形机器人Alter3,负责将动作描述转化为实际的物理运动。两者通过某种接口(具体接口细节未知)进行通信,实现语言到动作的转换。研究还包括设计实验来评估机器人的自我认知能力。

关键创新:该研究的关键创新在于探索了将大语言模型与人形机器人结合,以赋予机器人自主性和自我意识的可能性。与传统的机器人控制方法相比,该方法能够利用语言模型的知识和推理能力,使机器人能够执行更复杂的任务,并对自身行为有一定的理解。

关键设计:论文中关于Alter3的具体控制参数设置、GPT-4的prompt设计以及镜像自我识别和橡胶手错觉实验的具体流程等技术细节描述不足,属于未知信息。但可以推测,prompt的设计对于GPT-4生成合适的动作描述至关重要,而机器人控制器的参数设置则直接影响动作的执行效果。

🖼️ 关键图片

📊 实验亮点

论文通过镜像自我识别和橡胶手错觉实验,初步探索了Alter3在与GPT-4结合后发展自我意识的潜力。虽然没有给出具体的性能数据,但实验结果表明,即使是脱离具体形态的语言模型,当与物理机器人平台结合时,也能发展出能动性。这为未来研究机器人的自我意识开辟了新的方向。

🎯 应用场景

该研究具有广泛的应用前景,例如在智能家居、医疗护理、教育娱乐等领域。通过赋予机器人自主性和一定的自我意识,可以使其更好地理解人类的需求,并提供更个性化的服务。未来,这种技术有望应用于开发更智能、更人性化的机器人助手,甚至可以用于研究人类意识的本质。

📄 摘要(原文)

This paper introduces Alter3, a humanoid robot that demonstrates spontaneous motion generation through the integration of GPT-4, Large Language Model (LLM). This overcomes challenges in applying language models to direct robot control. By translating linguistic descriptions into actions, Alter3 can autonomously perform various tasks. The key aspect of humanoid robots is their ability to mimic human movement and emotions, allowing them to leverage human knowledge from language models. This raises the question of whether Alter3+GPT-4 can develop a "minimal self" with a sense of agency and ownership. This paper introduces mirror self-recognition and rubber hand illusion tests to assess Alter3's potential for a sense of self. The research suggests that even disembodied language models can develop agency when coupled with a physical robotic platform.