Graspness Discovery in Clutters for Fast and Accurate Grasp Detection

作者: Chenxi Wang, Hao-Shu Fang, Minghao Gou, Hongjie Fang, Jin Gao, Cewu Lu

分类: cs.RO, cs.CV

发布日期: 2024-06-17

备注: ICCV 2021

🔗 代码/项目: GITHUB

💡 一句话要点

提出 Graspness 用于杂乱场景下的快速精确抓取姿态检测

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人抓取 抓取姿态检测 Graspness 深度学习 目标检测

📋 核心要点

- 现有抓取姿态检测方法在杂乱场景中效率和精度不足,主要原因是忽略了抓取位置的选择,对所有点进行均匀采样。

- 论文提出“graspness”概念,通过几何线索区分可抓取区域,并设计前瞻搜索方法进行评估,指导抓取候选的选择。

- 实验表明,该方法可作为即插即用模块显著提升现有抓取检测方法的准确性,并构建了端到端网络GSNet,在GraspNet-1Billion数据集上取得了显著的性能提升。

📝 摘要(中文)

高效且鲁棒的抓取姿态检测对于机器人操作至关重要。对于通用的6自由度抓取,传统方法平等地对待场景中的所有点,并通常采用均匀采样来选择抓取候选。然而,我们发现忽略在哪里抓取会极大地损害当前抓取姿态检测方法的速度和准确性。在本文中,我们提出了“graspness”,这是一种基于几何线索的质量指标,用于区分杂乱场景中的可抓取区域。提出了一种前瞻搜索方法来测量graspness,统计结果证明了我们方法的合理性。为了在实践中快速检测graspness,我们开发了一个名为级联graspness模型的神经网络来近似搜索过程。大量的实验验证了我们的graspness模型的稳定性、通用性和有效性,使其可以作为不同方法的即插即用模块。在配备我们的graspness模型后,各种先前方法的准确性都得到了显著提高。此外,我们开发了GSNet,这是一个端到端网络,它结合了我们的graspness模型,用于早期过滤低质量的预测。在大型基准GraspNet-1Billion上的实验表明,我们的方法大大优于以前的方法(30+ AP),并实现了较高的推理速度。GSNet的库已集成到AnyGrasp中,网址为https://github.com/graspnet/anygrasp_sdk。

🔬 方法详解

问题定义:论文旨在解决在复杂、杂乱场景中机器人抓取姿态检测的效率和准确性问题。现有方法通常采用均匀采样策略,平等对待场景中的所有点,导致计算资源浪费,且难以找到高质量的抓取姿态。这种盲目的采样方式严重限制了抓取系统的整体性能。

核心思路:论文的核心思路是引入“graspness”的概念,即基于几何特征来评估一个区域的可抓取性。通过识别场景中具有较高graspness的区域,可以有效地过滤掉大量不适合抓取的候选点,从而提高抓取姿态检测的速度和准确性。这种方法类似于人类在抓取物体时会优先关注那些看起来容易抓取的部分。

技术框架:整体框架包含两个主要阶段:首先,使用前瞻搜索方法或级联graspness模型来估计场景中每个点的graspness值。然后,利用这些graspness值来指导抓取候选的采样和评估。对于端到端的GSNet,graspness模型被集成到网络中,用于早期过滤低质量的预测,从而提高整体性能。GSNet的输出是精细化的抓取姿态。

关键创新:论文的关键创新在于提出了graspness的概念,并将其应用于抓取姿态检测中。与现有方法不同,该方法不是平等地对待所有点,而是优先关注那些具有较高可抓取性的区域。此外,级联graspness模型的设计使得能够快速且准确地估计graspness值,从而在实际应用中具有很高的可行性。

关键设计:前瞻搜索方法通过模拟抓取过程来评估graspness,考虑了抓取器与周围环境的交互。级联graspness模型是一个神经网络,用于近似前瞻搜索过程,以提高计算效率。具体网络结构和损失函数细节未知,但可以推断其目标是学习从几何特征到graspness值的映射关系。GSNet的网络结构也未知,但其关键在于将graspness模型集成到网络中,用于早期过滤低质量的预测。

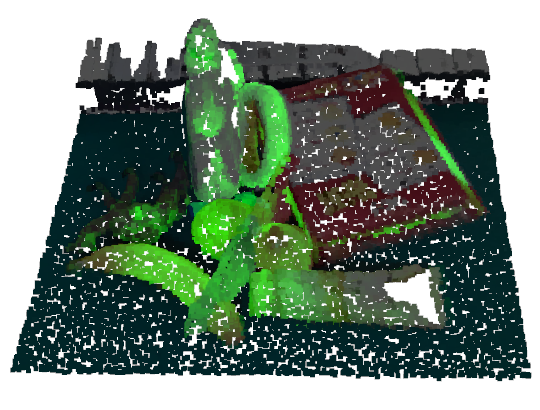

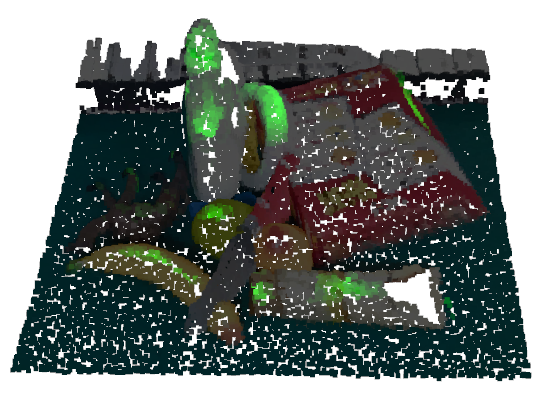

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的graspness模型可以作为即插即用模块,显著提高现有抓取姿态检测方法的准确性。在GraspNet-1Billion数据集上,GSNet的性能大幅超越了之前的state-of-the-art方法,AP提升超过30个百分点,并且实现了较高的推理速度。这些结果充分验证了该方法的有效性和优越性。

🎯 应用场景

该研究成果可广泛应用于机器人自动化领域,例如工业分拣、物流搬运、家庭服务机器人等。通过提高抓取姿态检测的效率和准确性,可以显著提升机器人的操作能力和智能化水平,使其能够更好地适应复杂多变的现实环境。未来,该技术有望推动机器人技术在更多领域的应用。

📄 摘要(原文)

Efficient and robust grasp pose detection is vital for robotic manipulation. For general 6 DoF grasping, conventional methods treat all points in a scene equally and usually adopt uniform sampling to select grasp candidates. However, we discover that ignoring where to grasp greatly harms the speed and accuracy of current grasp pose detection methods. In this paper, we propose "graspness", a quality based on geometry cues that distinguishes graspable areas in cluttered scenes. A look-ahead searching method is proposed for measuring the graspness and statistical results justify the rationality of our method. To quickly detect graspness in practice, we develop a neural network named cascaded graspness model to approximate the searching process. Extensive experiments verify the stability, generality and effectiveness of our graspness model, allowing it to be used as a plug-and-play module for different methods. A large improvement in accuracy is witnessed for various previous methods after equipping our graspness model. Moreover, we develop GSNet, an end-to-end network that incorporates our graspness model for early filtering of low-quality predictions. Experiments on a large-scale benchmark, GraspNet-1Billion, show that our method outperforms previous arts by a large margin (30+ AP) and achieves a high inference speed. The library of GSNet has been integrated into AnyGrasp, which is at https://github.com/graspnet/anygrasp_sdk.