HumanPlus: Humanoid Shadowing and Imitation from Humans

作者: Zipeng Fu, Qingqing Zhao, Qi Wu, Gordon Wetzstein, Chelsea Finn

分类: cs.RO, cs.AI, cs.CV, cs.LG, eess.SY

发布日期: 2024-06-15

备注: project website: https://humanoid-ai.github.io/

💡 一句话要点

HumanPlus:提出一种从人类数据中学习人形机器人运动和技能的完整系统。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人形机器人 模仿学习 行为克隆 强化学习 阴影跟随 自主技能 机器人控制

📋 核心要点

- 人形机器人训练面临感知控制复杂性、人机形态和驱动差异,以及缺乏第一人称视角自主技能学习数据管道等挑战。

- HumanPlus系统通过阴影跟随实现人机数据迁移,利用强化学习和行为克隆,使机器人模仿人类完成复杂任务。

- 实验表明,该系统在多种任务上取得了60-100%的成功率,验证了其在人形机器人自主技能学习方面的有效性。

📝 摘要(中文)

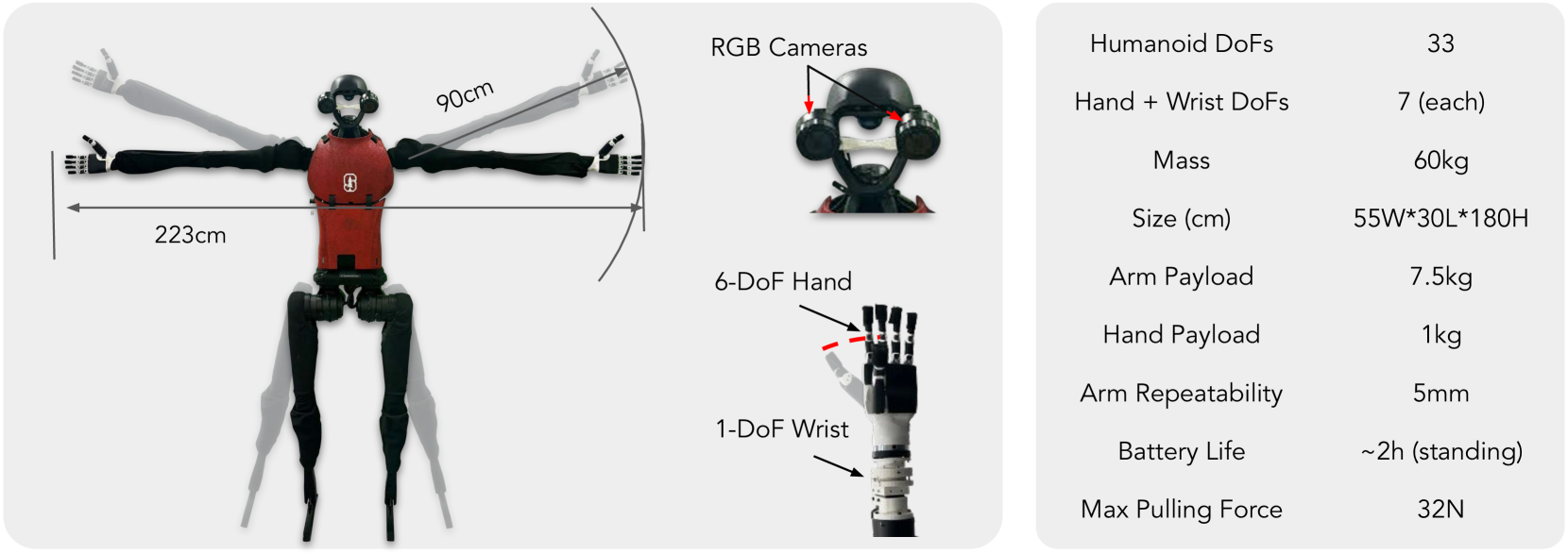

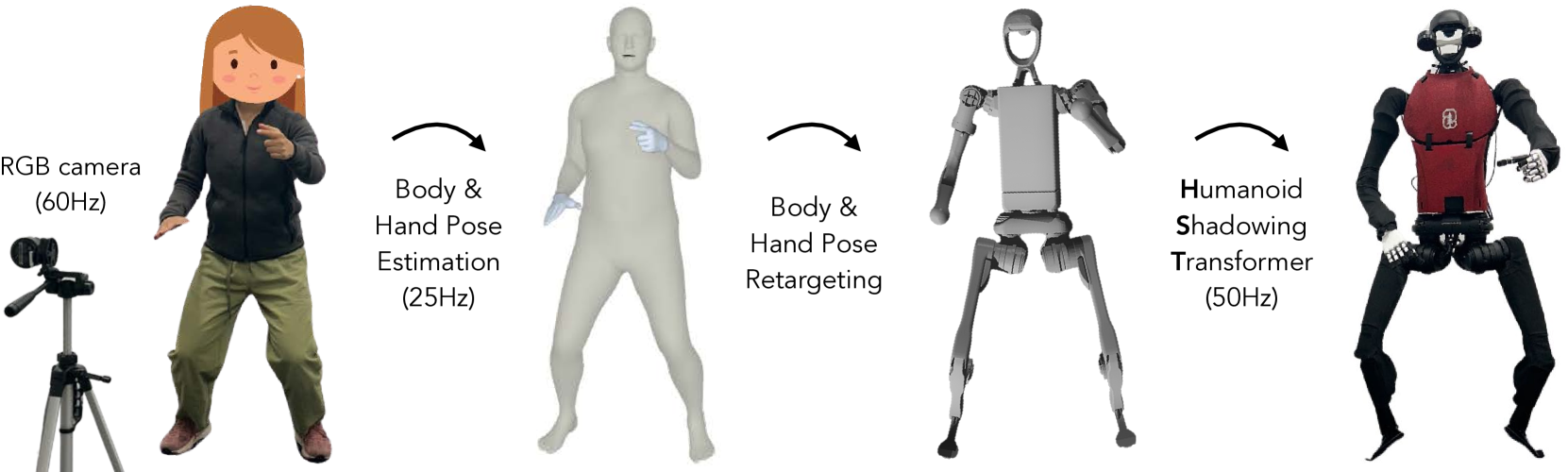

本文介绍了一个完整的系统,使人形机器人能够从人类数据中学习运动和自主技能。首先,我们使用现有的40小时人类运动数据集,通过强化学习在模拟环境中训练一个低级策略。该策略可以迁移到现实世界,使人形机器人仅使用RGB相机即可实时跟随人体和手部运动,即阴影跟随。通过阴影跟随,人类操作员可以遥控人形机器人,收集全身数据,用于在现实世界中学习不同的任务。然后,我们使用收集到的数据执行监督行为克隆,利用第一人称视角训练技能策略,使人形机器人能够通过模仿人类技能自主完成不同的任务。我们在我们定制的33自由度180厘米人形机器人上演示了该系统,自主完成了诸如穿鞋站立行走、从仓库货架上卸载物体、折叠运动衫、重新排列物体、打字以及问候另一个机器人等任务,使用最多40个演示,成功率达到60-100%。项目网站:https://humanoid-ai.github.io/

🔬 方法详解

问题定义:现有方法难以有效利用大量人类运动数据训练人形机器人,主要痛点在于人形机器人与人类在形态、驱动方式上存在差异,以及缺乏从第一人称视角学习自主技能的数据管道。这导致机器人难以直接模仿人类的复杂动作和技能。

核心思路:该论文的核心思路是利用“阴影跟随”(shadowing)技术,让人形机器人模仿人类的动作,从而收集高质量的机器人运动数据。然后,利用这些数据,通过行为克隆学习自主技能。这种方法有效地弥合了人机之间的差异,并为机器人提供了学习复杂任务的途径。

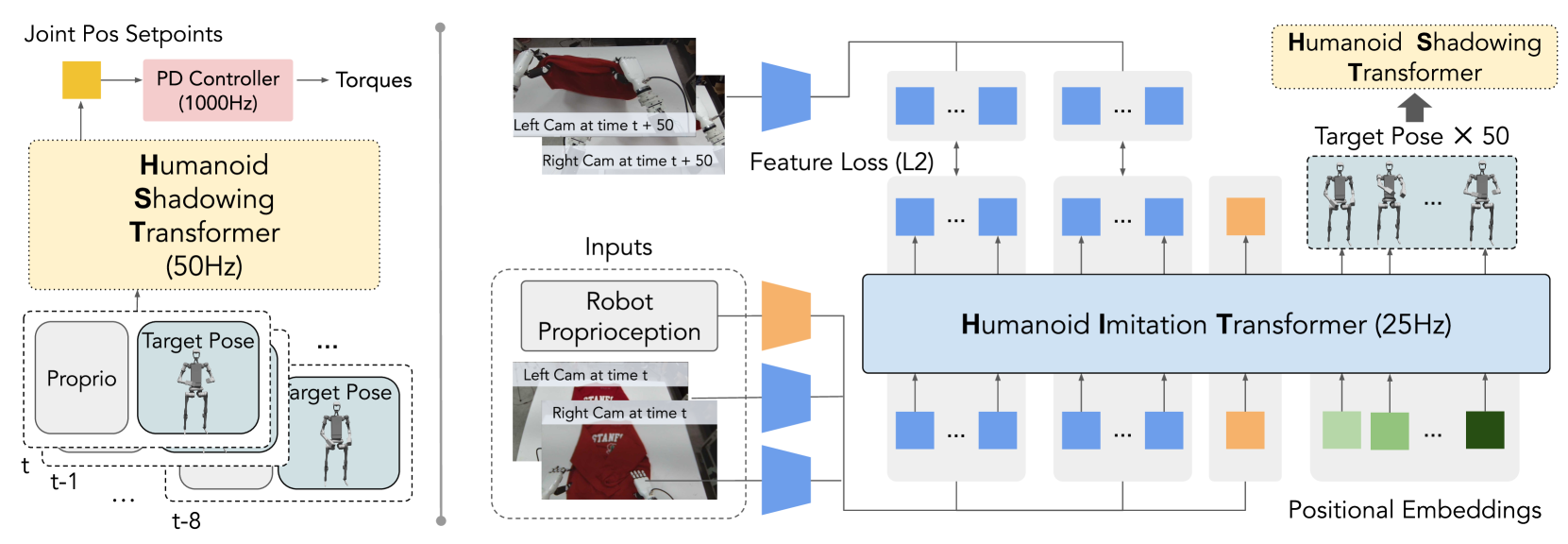

技术框架:该系统包含以下主要阶段:1) 在模拟环境中,使用人类运动数据通过强化学习训练低级策略,使机器人能够跟随人类的身体和手部运动。2) 将该策略迁移到真实机器人上,通过RGB相机实现实时阴影跟随。3) 人类操作员通过阴影跟随遥控机器人执行任务,收集全身数据。4) 使用收集到的数据,通过监督行为克隆训练技能策略,使机器人能够从第一人称视角自主完成任务。

关键创新:该论文的关键创新在于提出了一个完整的、可行的系统,将人类运动数据有效地迁移到人形机器人上,并实现了自主技能的学习。通过阴影跟随,机器人能够模仿人类的动作,从而收集到高质量的训练数据。此外,利用第一人称视角数据进行行为克隆,使机器人能够更好地理解和执行任务。

关键设计:在强化学习阶段,使用了现有的40小时人类运动数据集进行训练。在行为克隆阶段,使用了监督学习方法,利用收集到的机器人运动数据训练技能策略。具体网络结构和损失函数等细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

该系统在定制的33自由度180厘米人形机器人上进行了验证,成功完成了穿鞋站立行走、从仓库货架上卸载物体、折叠运动衫、重新排列物体、打字以及问候另一个机器人等任务,成功率达到60-100%。这些结果表明,该系统能够有效地使人形机器人学习和执行复杂的人类技能。

🎯 应用场景

该研究成果可应用于人形机器人在复杂环境中的自主操作,例如仓库物流、家庭服务、医疗辅助等领域。通过模仿人类技能,机器人可以完成诸如物品搬运、整理、组装等任务,提高工作效率和服务质量。未来,该技术有望推动人形机器人在更多实际场景中的应用。

📄 摘要(原文)

One of the key arguments for building robots that have similar form factors to human beings is that we can leverage the massive human data for training. Yet, doing so has remained challenging in practice due to the complexities in humanoid perception and control, lingering physical gaps between humanoids and humans in morphologies and actuation, and lack of a data pipeline for humanoids to learn autonomous skills from egocentric vision. In this paper, we introduce a full-stack system for humanoids to learn motion and autonomous skills from human data. We first train a low-level policy in simulation via reinforcement learning using existing 40-hour human motion datasets. This policy transfers to the real world and allows humanoid robots to follow human body and hand motion in real time using only a RGB camera, i.e. shadowing. Through shadowing, human operators can teleoperate humanoids to collect whole-body data for learning different tasks in the real world. Using the data collected, we then perform supervised behavior cloning to train skill policies using egocentric vision, allowing humanoids to complete different tasks autonomously by imitating human skills. We demonstrate the system on our customized 33-DoF 180cm humanoid, autonomously completing tasks such as wearing a shoe to stand up and walk, unloading objects from warehouse racks, folding a sweatshirt, rearranging objects, typing, and greeting another robot with 60-100% success rates using up to 40 demonstrations. Project website: https://humanoid-ai.github.io/