Optimizing Deep Reinforcement Learning for Adaptive Robotic Arm Control

作者: Jonaid Shianifar, Michael Schukat, Karl Mason

分类: cs.RO, cs.AI

发布日期: 2024-06-12

期刊: PAAMS 2024, Communications in Computer and Information Science, vol 2149, PP 293-304 Springer, Cham (2025)

DOI: 10.1007/978-3-031-73058-0_24

💡 一句话要点

利用TPE优化SAC和PPO算法,提升七自由度机械臂控制性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 超参数优化 机械臂控制 SAC算法 PPO算法

📋 核心要点

- 现有强化学习方法在机械臂控制中面临超参数调优困难,影响控制性能和训练效率。

- 提出利用TPE优化SAC和PPO算法的超参数,以提升机械臂控制的成功率和收敛速度。

- 实验表明,TPE优化显著提升了SAC和PPO算法的性能,并减少了训练所需的迭代次数。

📝 摘要(中文)

本文研究了使用树状Parzen估计器(TPE)优化软演员-评论家(SAC)和近端策略优化(PPO)算法的超参数,应用于七自由度(DOF)机械臂控制。结果表明,TPE显著提升了算法性能,在训练5万次迭代后,SAC的成功率提高了10.48个百分点,PPO的成功率提高了34.28个百分点。此外,TPE使PPO收敛到最大奖励的95%的速度比没有TPE时快76%,相当于减少了约4万次迭代的训练。SAC的改进速度比没有TPE时快80%。这项研究强调了高级超参数优化对深度强化学习算法在复杂机器人任务中的效率和成功的影响。

🔬 方法详解

问题定义:论文旨在解决深度强化学习算法在机械臂控制应用中,超参数优化困难的问题。传统的手动调参或网格搜索方法效率低下,难以找到最优超参数组合,导致算法性能受限,训练时间过长。现有方法难以充分利用计算资源,无法快速有效地训练出高性能的机械臂控制策略。

核心思路:论文的核心思路是利用树状Parzen估计器(TPE)自动优化SAC和PPO算法的超参数。TPE是一种贝叶斯优化方法,通过构建超参数空间的概率模型,能够有效地搜索最优超参数组合,从而提升算法的性能和训练效率。这种方法避免了手动调参的盲目性和网格搜索的计算量大的问题。

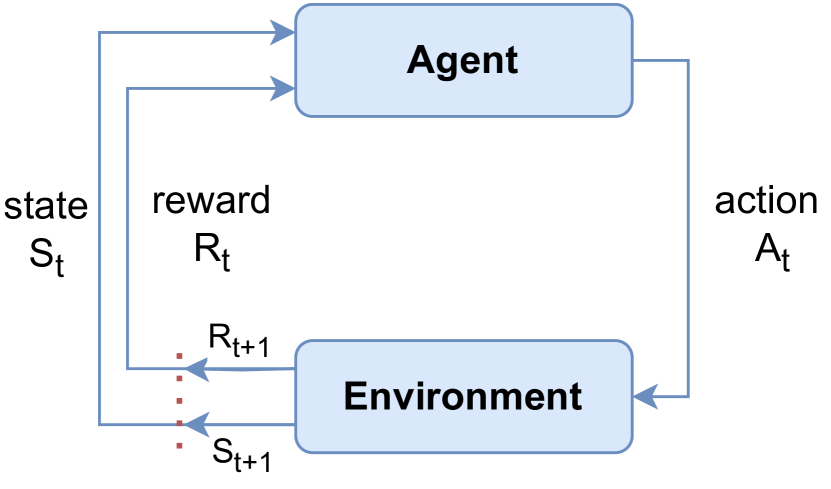

技术框架:整体框架包括以下几个主要步骤:1)定义机械臂控制任务和环境;2)选择SAC和PPO作为基础强化学习算法;3)使用TPE作为超参数优化器,为SAC和PPO算法自动搜索最优超参数组合;4)使用优化后的超参数训练SAC和PPO算法;5)评估训练后的算法在机械臂控制任务中的性能。

关键创新:最重要的技术创新点在于将TPE应用于SAC和PPO算法的超参数优化,并将其应用于七自由度机械臂控制任务。与传统的超参数优化方法相比,TPE能够更有效地搜索最优超参数组合,从而显著提升算法的性能和训练效率。这种方法可以推广到其他强化学习算法和机器人控制任务中。

关键设计:论文中,TPE被用于优化SAC和PPO算法的关键超参数,例如学习率、折扣因子、探索噪声等。具体而言,TPE通过构建超参数空间的概率模型,并根据已有的实验结果,预测不同超参数组合的性能。然后,TPE选择最有希望提升性能的超参数组合进行实验,并更新概率模型。这个过程不断迭代,直到找到最优超参数组合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用TPE优化后,SAC算法的成功率提高了10.48个百分点,PPO算法的成功率提高了34.28个百分点。此外,TPE使PPO收敛到最大奖励的95%的速度比没有TPE时快76%,SAC的改进速度比没有TPE时快80%。这些结果表明,TPE能够显著提升深度强化学习算法在机械臂控制任务中的性能和训练效率。

🎯 应用场景

该研究成果可广泛应用于各种需要精确控制的机器人任务中,例如工业自动化、医疗机器人、服务机器人等。通过自动优化强化学习算法的超参数,可以显著提升机器人的控制精度、效率和鲁棒性,降低开发成本,加速机器人技术的应用和普及。未来,该方法可以进一步扩展到多智能体系统和更复杂的机器人任务中。

📄 摘要(原文)

In this paper, we explore the optimization of hyperparameters for the Soft Actor-Critic (SAC) and Proximal Policy Optimization (PPO) algorithms using the Tree-structured Parzen Estimator (TPE) in the context of robotic arm control with seven Degrees of Freedom (DOF). Our results demonstrate a significant enhancement in algorithm performance, TPE improves the success rate of SAC by 10.48 percentage points and PPO by 34.28 percentage points, where models trained for 50K episodes. Furthermore, TPE enables PPO to converge to a reward within 95% of the maximum reward 76% faster than without TPE, which translates to about 40K fewer episodes of training required for optimal performance. Also, this improvement for SAC is 80% faster than without TPE. This study underscores the impact of advanced hyperparameter optimization on the efficiency and success of deep reinforcement learning algorithms in complex robotic tasks.