Conformalized Teleoperation: Confidently Mapping Human Inputs to High-Dimensional Robot Actions

作者: Michelle Zhao, Reid Simmons, Henny Admoni, Andrea Bajcsy

分类: cs.RO, cs.LG

发布日期: 2024-06-11 (更新: 2024-07-10)

💡 一句话要点

提出自适应保形预测以解决高维机器人动作映射问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 助力机器人 高维动作映射 自适应保形预测 不确定性量化 人机交互 遥控操作 机器人学习

📋 核心要点

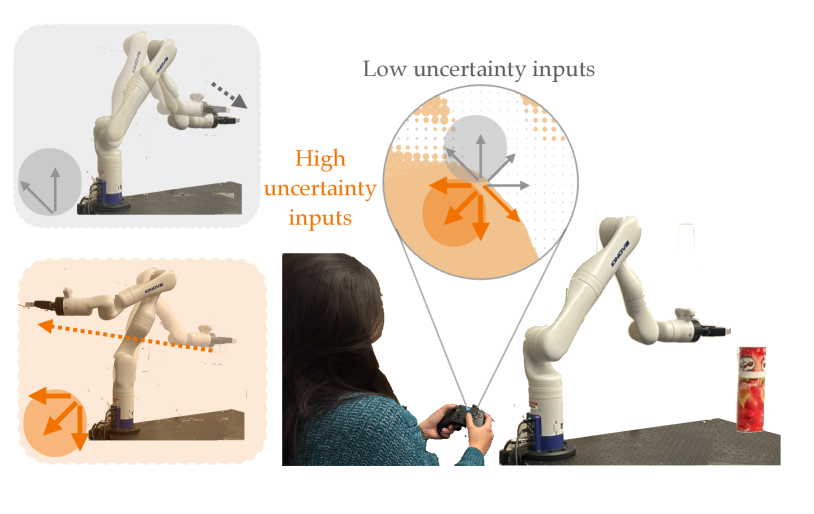

- 现有方法在将低维人类输入映射到高维机器人动作时,无法有效处理不确定性,导致用户意图推断不准确。

- 论文提出通过自适应保形预测在训练阶段估计高维动作分位数,并进行不确定性校准,以提升映射的可靠性。

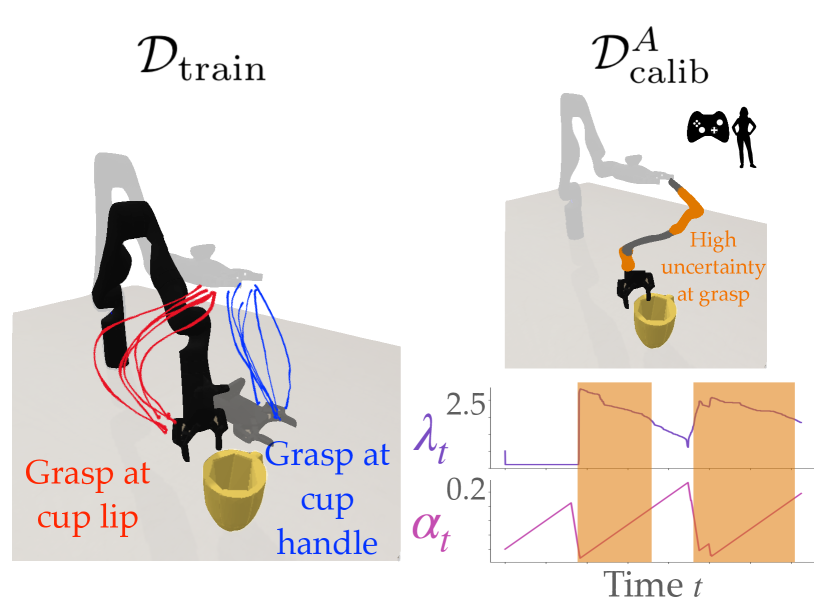

- 实验结果显示,该方法在2D助力导航和7DOF Kinova Jaco任务中有效检测高不确定性输入,推动机器人主动干预。

📝 摘要(中文)

助力机器人手臂通常具有比人类遥控操作员更高的自由度,导致低维输入(如操纵杆)难以有效控制。现有方法依赖数据驱动技术学习从低维输入到高维机器人动作的映射,但如何自信地推断用户意图仍然是一个未解问题。本文提出在训练时适应性地调整助力映射,估计高维动作的分位数,并通过严格的不确定性量化方法进行校准。我们利用自适应保形预测,动态调整不确定性区间,提升映射性能。实验表明,该方法能有效检测高不确定性输入,推动机器人主动寻求干预。

🔬 方法详解

问题定义:本文旨在解决助力机器人手臂在高维动作控制中,如何自信地从低维输入推断用户意图的问题。现有方法的痛点在于缺乏对不确定性的有效量化,导致用户意图推断的不准确性。

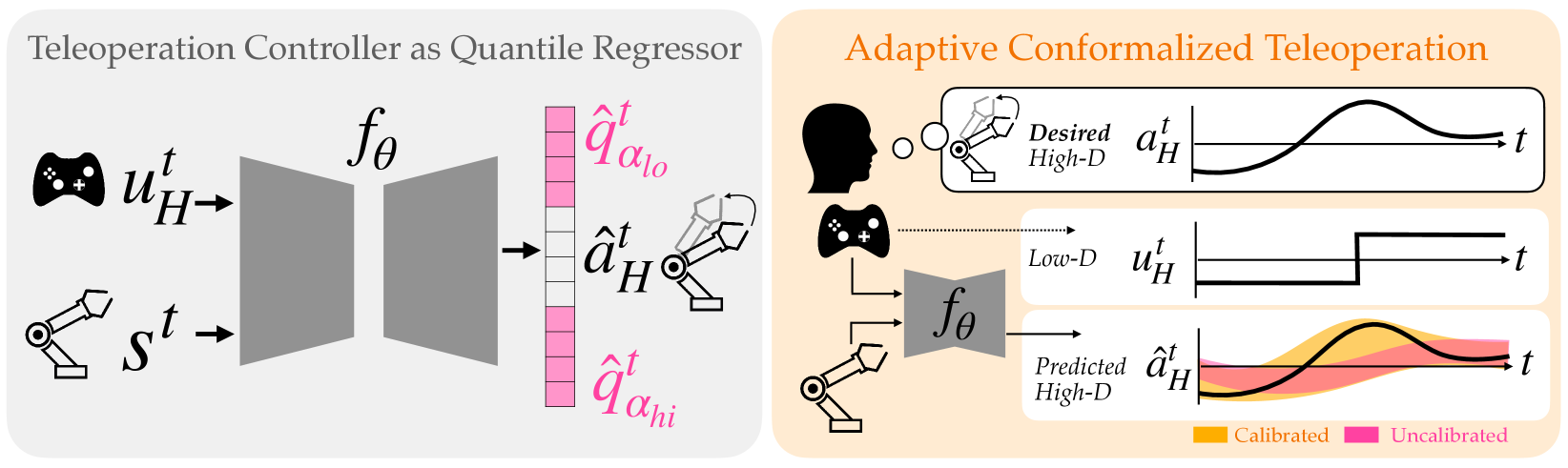

核心思路:论文的核心思路是通过自适应保形预测,在训练过程中动态调整高维动作的分位数估计,并通过不确定性量化方法进行校准,以提高映射的可靠性和准确性。

技术框架:整体架构包括数据收集、模型训练和不确定性校准三个主要模块。首先收集低维输入和对应的高维动作数据,然后训练映射模型,最后通过自适应保形预测调整不确定性区间。

关键创新:最重要的技术创新点在于引入自适应保形预测,能够根据模型性能动态调整不确定性区间,从而在高不确定性情况下提升用户输入的检测能力。这与现有方法的静态不确定性处理方式形成了本质区别。

关键设计:在模型训练中,采用了特定的损失函数来平衡低维输入与高维动作之间的映射,同时设计了适应性调整机制,以便在模型表现良好时缩小不确定性区间,反之则扩大。

🖼️ 关键图片

📊 实验亮点

实验结果表明,采用自适应保形预测的助力遥控系统在2D导航任务和7DOF Kinova Jaco任务中,能够有效检测高不确定性输入,提升了用户输入的可靠性。具体而言,该方法在高不确定性情况下的检测率显著高于传统方法,显示出良好的实用性。

🎯 应用场景

该研究的潜在应用领域包括助力机器人、医疗辅助设备和人机交互系统。通过提升机器人对用户意图的理解能力,能够在复杂环境中提供更为精准的辅助,进而提高人机协作的效率和安全性。未来,该技术有望在智能家居、老年人护理等领域发挥重要作用。

📄 摘要(原文)

Assistive robotic arms often have more degrees-of-freedom than a human teleoperator can control with a low-dimensional input, like a joystick. To overcome this challenge, existing approaches use data-driven methods to learn a mapping from low-dimensional human inputs to high-dimensional robot actions. However, determining if such a black-box mapping can confidently infer a user's intended high-dimensional action from low-dimensional inputs remains an open problem. Our key idea is to adapt the assistive map at training time to additionally estimate high-dimensional action quantiles, and then calibrate these quantiles via rigorous uncertainty quantification methods. Specifically, we leverage adaptive conformal prediction which adjusts the intervals over time, reducing the uncertainty bounds when the mapping is performant and increasing the bounds when the mapping consistently mis-predicts. Furthermore, we propose an uncertainty-interval-based mechanism for detecting high-uncertainty user inputs and robot states. We evaluate the efficacy of our proposed approach in a 2D assistive navigation task and two 7DOF Kinova Jaco tasks involving assistive cup grasping and goal reaching. Our findings demonstrate that conformalized assistive teleoperation manages to detect (but not differentiate between) high uncertainty induced by diverse preferences and induced by low-precision trajectories in the mapping's training dataset. On the whole, we see this work as a key step towards enabling robots to quantify their own uncertainty and proactively seek intervention when needed.