Realistic Data Generation for 6D Pose Estimation of Surgical Instruments

作者: Juan Antonio Barragan, Jintan Zhang, Haoying Zhou, Adnan Munawar, Peter Kazanzides

分类: cs.RO, cs.LG

发布日期: 2024-06-11

备注: 6 pages

期刊: 2024 IEEE International Conference on Robotics and Automation (ICRA)

DOI: 10.1109/ICRA57147.2024.10611638

💡 一句话要点

提出一种改进的仿真环境,用于生成逼真的手术器械6D位姿估计数据集。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 6D位姿估计 手术机器人 合成数据生成 仿真环境 深度学习

📋 核心要点

- 现有手术机器人6D位姿估计依赖大量标注数据,真实数据标注成本高昂,合成数据真实性不足。

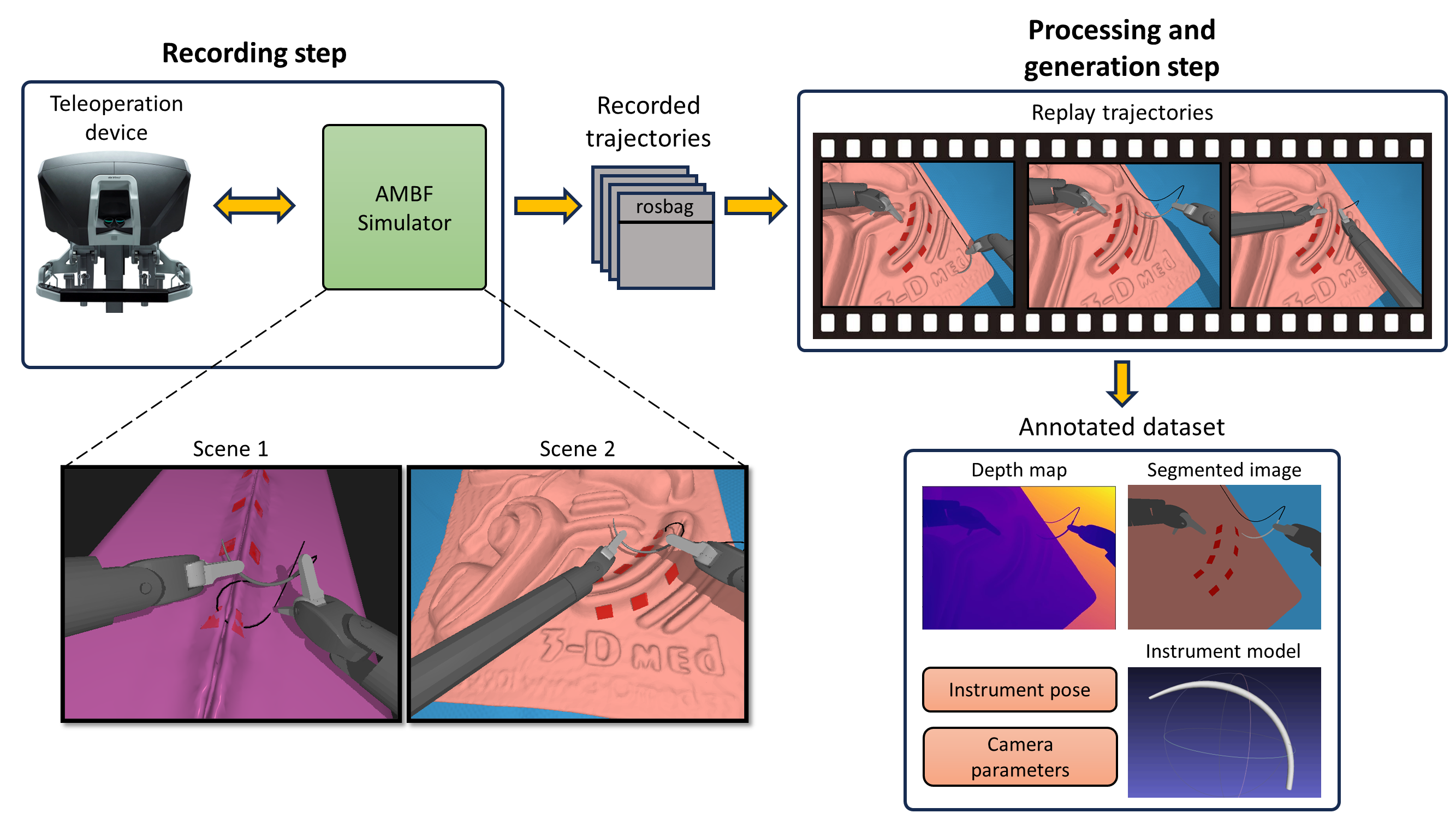

- 提出改进的仿真环境和自动数据生成流程,以生成更逼真的手术器械图像,降低标注成本。

- 生成包含7.5k张手术缝合针图像的数据集,训练的位姿估计模型在测试集上达到2.59mm的平均平移误差。

📝 摘要(中文)

手术机器人自动化具有提高患者安全性和手术效率的潜力,但由于需要强大的感知算法而难以实现。特别是,手术器械的6D位姿估计对于实现基于视觉反馈的自动手术操作至关重要。近年来,有监督的深度学习算法在6D位姿估计任务中表现出越来越好的性能;然而,它们的成功取决于大量带注释数据的可用性。在家庭和工业环境中,使用3D计算机图形软件生成的合成数据已被证明是最小化6D位姿数据集注释成本的一种替代方法。然而,这种策略不能很好地转化为手术领域,因为商业图形软件在生成描绘真实器械-组织交互的图像方面工具有限。为了解决这些限制,我们提出了一种改进的手术机器人仿真环境,该环境能够自动生成大量多样化的数据集,用于手术器械的6D位姿估计。在改进方面,我们开发了一个自动数据生成管道和一个改进的手术场景。为了展示我们系统的适用性,我们生成了一个包含7.5k张图像的数据集,其中包含手术缝合针的位姿注释,该数据集用于评估最先进的位姿估计网络。经过训练的模型在具有不同程度遮挡的具有挑战性的数据集上获得了2.59mm的平均平移误差。这些结果突出了我们的管道在训练和评估用于手术机器人应用的新型视觉算法方面的成功。

🔬 方法详解

问题定义:论文旨在解决手术机器人中手术器械6D位姿估计的数据集问题。现有方法依赖于真实数据的标注,成本高昂且耗时。使用传统计算机图形软件生成的合成数据,由于缺乏真实的器械-组织交互模拟,真实感不足,难以训练出鲁棒的位姿估计模型。

核心思路:论文的核心思路是改进手术机器人仿真环境,使其能够自动生成大量逼真的手术器械图像,从而降低对真实标注数据的依赖。通过改进仿真环境和数据生成流程,提高合成数据的真实感,使其能够有效地训练深度学习模型。

技术框架:该方法包含一个自动数据生成管道和一个改进的手术场景。数据生成管道负责自动生成不同位姿、光照条件和组织交互下的手术器械图像。改进的手术场景则着重于提高场景的真实感,包括更真实的组织纹理、光照模型和器械-组织交互模拟。生成的数据集用于训练现有的6D位姿估计网络。

关键创新:关键创新在于改进了手术机器人仿真环境,使其能够生成更逼真的手术器械图像。这主要体现在两个方面:一是自动数据生成管道的开发,可以高效地生成大量多样化的数据;二是改进的手术场景,能够更真实地模拟器械-组织交互,提高合成数据的真实感。

关键设计:论文中提到开发了自动数据生成管道和改进的手术场景,但没有详细描述具体的参数设置、损失函数或网络结构。数据集包含7.5k张图像,用于训练一个state-of-the-art的位姿估计网络,但具体网络结构未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用该方法生成的合成数据训练的位姿估计模型,在具有挑战性的数据集上获得了2.59mm的平均平移误差。该数据集包含不同程度的遮挡,表明该方法生成的数据具有一定的鲁棒性,能够有效地训练位姿估计模型。

🎯 应用场景

该研究成果可应用于手术机器人视觉伺服、自主手术导航等领域。通过使用逼真的合成数据训练位姿估计模型,可以降低对真实数据的依赖,加速手术机器人技术的研发和应用。未来,该方法可以推广到其他手术器械和手术场景,为手术机器人提供更强大的感知能力。

📄 摘要(原文)

Automation in surgical robotics has the potential to improve patient safety and surgical efficiency, but it is difficult to achieve due to the need for robust perception algorithms. In particular, 6D pose estimation of surgical instruments is critical to enable the automatic execution of surgical maneuvers based on visual feedback. In recent years, supervised deep learning algorithms have shown increasingly better performance at 6D pose estimation tasks; yet, their success depends on the availability of large amounts of annotated data. In household and industrial settings, synthetic data, generated with 3D computer graphics software, has been shown as an alternative to minimize annotation costs of 6D pose datasets. However, this strategy does not translate well to surgical domains as commercial graphics software have limited tools to generate images depicting realistic instrument-tissue interactions. To address these limitations, we propose an improved simulation environment for surgical robotics that enables the automatic generation of large and diverse datasets for 6D pose estimation of surgical instruments. Among the improvements, we developed an automated data generation pipeline and an improved surgical scene. To show the applicability of our system, we generated a dataset of 7.5k images with pose annotations of a surgical needle that was used to evaluate a state-of-the-art pose estimation network. The trained model obtained a mean translational error of 2.59mm on a challenging dataset that presented varying levels of occlusion. These results highlight our pipeline's success in training and evaluating novel vision algorithms for surgical robotics applications.