Optimal Gait Control for a Tendon-driven Soft Quadruped Robot by Model-based Reinforcement Learning

作者: Xuezhi Niu, Kaige Tan, Lei Feng

分类: cs.RO, eess.SY

发布日期: 2024-06-11

💡 一句话要点

提出基于模型强化学习的软体四足机器人最优步态控制方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 软体机器人 步态控制 强化学习 模型预测控制 机器人控制

📋 核心要点

- 软体机器人步态控制面临挑战,传统方法难以在快速性和稳定性间取得平衡。

- 采用基于模型的强化学习(MBRL),结合状态空间限制和数据驱动模型训练,提升控制性能。

- 实验表明,该方法显著提高了步态控制策略的效率和性能,并具有良好的鲁棒性和适应性。

📝 摘要(中文)

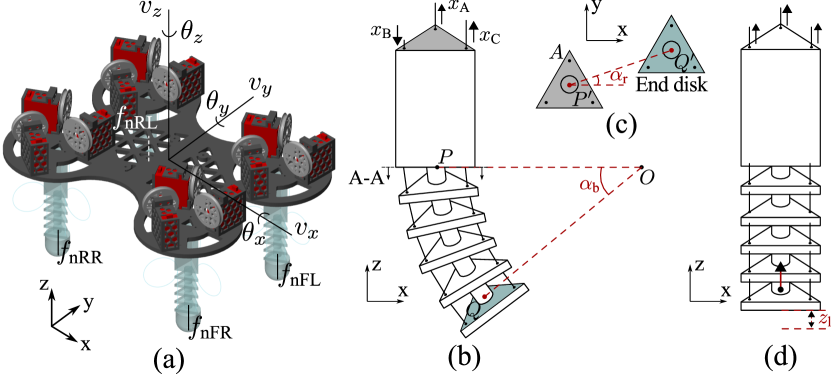

本研究提出了一种创新的软体四足机器人最优步态控制方法,该机器人由四个可压缩肌腱驱动软体执行器(CTSAs)驱动。在先前使用无模型强化学习进行步态控制的研究基础上,本文采用基于模型的强化学习(MBRL)来进一步提高步态控制器的性能。与刚性机器人相比,所提出的软体四足机器人具有更好的安全性、更轻的重量以及更简单的制造和控制机制。然而,主要的挑战在于开发复杂的控制算法,以实现快速和稳定的运动的最佳步态控制。该研究采用了一种多阶段方法,包括状态空间限制、数据驱动模型训练和强化学习算法开发。与基准方法相比,所提出的MBRL算法与后训练相结合,显著提高了步态控制策略的效率和性能。所开发的策略既稳健又适应机器人可变形的形态。研究最后强调了这些发现在实际场景中的实际应用性。

🔬 方法详解

问题定义:论文旨在解决软体四足机器人最优步态控制问题。现有方法,特别是针对刚性机器人的控制策略,难以直接应用于软体机器人,因为软体机器人具有高自由度、非线性以及难以精确建模的特点。此外,无模型强化学习方法虽然可以用于步态控制,但通常需要大量的训练数据,效率较低。因此,如何高效地学习到适用于软体机器人的快速、稳定步态控制策略是一个关键挑战。

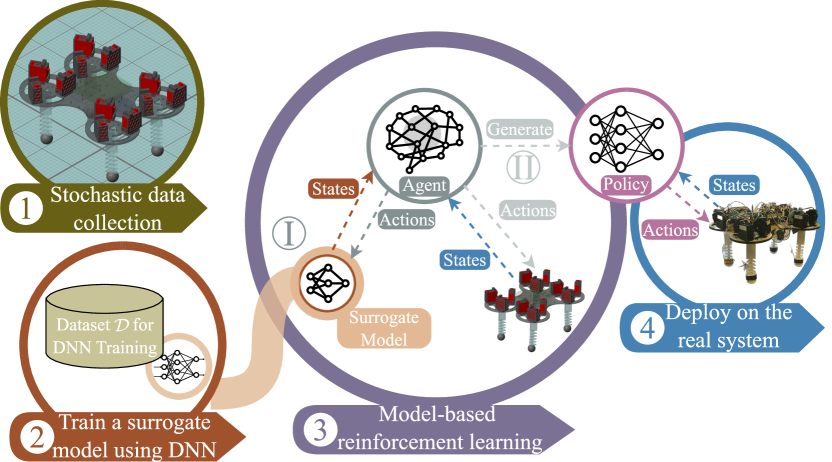

核心思路:论文的核心思路是利用基于模型的强化学习(MBRL)来提高步态控制策略的学习效率。MBRL通过学习一个动力学模型来预测机器人的状态转移,然后利用该模型来生成训练数据,从而减少了对真实环境的依赖,提高了学习效率。此外,论文还结合了状态空间限制,以进一步提高学习的稳定性和安全性。

技术框架:整体框架包括以下几个主要阶段:1) 状态空间限制:根据机器人的物理特性和任务需求,对状态空间进行限制,以减少学习的复杂性。2) 数据驱动模型训练:利用真实或仿真数据训练一个动力学模型,该模型能够预测机器人在给定动作下的状态转移。3) 强化学习算法开发:使用MBRL算法,例如Model Predictive Control (MPC) 或 Policy Optimization,基于学习到的动力学模型来优化步态控制策略。4) 后训练 (Post-training):在真实机器人上进行少量训练,以弥补模型误差,进一步提高控制策略的性能。

关键创新:论文的关键创新在于将MBRL应用于软体四足机器人的步态控制,并结合了状态空间限制和后训练。与传统的无模型强化学习方法相比,MBRL能够显著提高学习效率,减少对真实环境的依赖。此外,状态空间限制可以提高学习的稳定性和安全性,后训练可以弥补模型误差,进一步提高控制策略的性能。

关键设计:论文中可能涉及的关键设计包括:1) 动力学模型的选择:例如高斯过程回归、神经网络等。2) 强化学习算法的选择:例如,使用MPC时,需要设计合适的成本函数;使用Policy Optimization时,需要选择合适的策略梯度算法。3) 状态空间限制的策略:例如,限制关节角度、速度等。4) 后训练的策略:例如,使用少量真实数据进行微调。

🖼️ 关键图片

📊 实验亮点

论文提出的MBRL算法与后训练相结合,显著提高了步态控制策略的效率和性能。具体性能数据未知,但与基准方法相比,该方法在步态速度、稳定性等方面均有明显提升。此外,该方法具有良好的鲁棒性和适应性,能够适应机器人可变形的形态,并在不同地形下实现稳定的运动。

🎯 应用场景

该研究成果可应用于搜救、勘探等复杂环境下的软体机器人运动控制。软体机器人在狭窄空间和崎岖地形中具有独特的优势,能够执行刚性机器人难以完成的任务。通过优化步态控制,可以提高软体机器人的运动效率和稳定性,使其在实际应用中更具竞争力。未来,该技术有望推广到其他类型的软体机器人,并与其他先进技术相结合,例如视觉导航、自主决策等,从而实现更智能、更灵活的软体机器人系统。

📄 摘要(原文)

This study presents an innovative approach to optimal gait control for a soft quadruped robot enabled by four Compressible Tendon-driven Soft Actuators (CTSAs). Improving our previous studies of using model-free reinforcement learning for gait control, we employ model-based reinforcement learning (MBRL) to further enhance the performance of the gait controller. Compared to rigid robots, the proposed soft quadruped robot has better safety, less weight, and a simpler mechanism for fabrication and control. However, the primary challenge lies in developing sophisticated control algorithms to attain optimal gait control for fast and stable locomotion. The research employs a multi-stage methodology, including state space restriction, data-driven model training, and reinforcement learning algorithm development. Compared to benchmark methods, the proposed MBRL algorithm, combined with post-training, significantly improves the efficiency and performance of gait control policies. The developed policy is both robust and adaptable to the robot's deformable morphology. The study concludes by highlighting the practical applicability of these findings in real-world scenarios.