Sim-To-Real Transfer for Visual Reinforcement Learning of Deformable Object Manipulation for Robot-Assisted Surgery

作者: Paul Maria Scheikl, Eleonora Tagliabue, Balázs Gyenes, Martin Wagner, Diego Dall'Alba, Paolo Fiorini, Franziska Mathis-Ullrich

分类: cs.RO

发布日期: 2024-06-10

期刊: IEEE Robotics and Automation Letters 8 (2023) 560-567

💡 一句话要点

提出基于像素级域适应的视觉强化学习方法,解决机器人辅助手术中柔性物体操作的Sim-to-Real迁移问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: Sim-to-Real迁移 视觉强化学习 柔性物体操作 机器人辅助手术 域适应

📋 核心要点

- 现有强化学习方法在模拟环境中表现良好,但难以克服Sim-to-Real差距,导致策略在真实世界中性能下降。

- 该论文提出一种基于像素级域适应的图像强化学习方法,旨在弥合模拟环境和真实环境之间的视觉差异。

- 实验结果表明,该方法在组织牵开任务中,无需在真实环境中重新训练,即可达到50%的成功率。

📝 摘要(中文)

本文提出了一种基于图像的强化学习流程,通过像素级域适应来弥合视觉Sim-to-Real差距,并验证了其在柔性物体操作图像任务中的有效性。选择组织牵开任务,因为它在精确癌症手术的临床实践中非常重要。在模拟环境中,通过域转换图像进行训练后,我们的策略无需重新训练,即可在真实机器人系统上使用原始RGB图像执行组织牵开任务,成功率为50%。此外,我们的Sim-to-Real迁移方法对任务本身不做任何假设,也不需要配对图像。这项工作首次成功地将视觉Sim-to-Real迁移应用于外科领域中柔性物体的机器人操作,代表了认知外科机器人向临床转化迈出的重要一步。

🔬 方法详解

问题定义:该论文旨在解决机器人辅助手术中,柔性物体操作的Sim-to-Real迁移问题。现有的强化学习方法虽然在模拟环境中能够学习到有效的策略,但由于模拟环境与真实环境存在视觉差异(即Sim-to-Real gap),导致在模拟环境中训练的策略难以直接应用于真实机器人系统。这种差异主要体现在光照、纹理、噪声等方面,使得策略的泛化能力不足。

核心思路:论文的核心思路是利用像素级域适应技术,将模拟环境的图像转换为更接近真实环境的图像,从而减小Sim-to-Real gap。通过在域转换后的图像上进行强化学习训练,可以使策略学习到对视觉差异更具鲁棒性的特征,从而提高策略在真实环境中的泛化能力。该方法无需配对图像,也无需对任务本身做任何假设,具有较强的通用性。

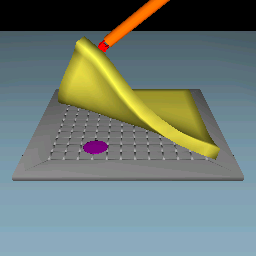

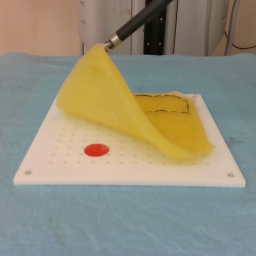

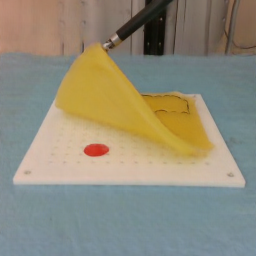

技术框架:整体框架包含两个主要阶段:1) 域适应阶段:使用图像到图像的转换模型(例如CycleGAN)将模拟环境的图像转换为具有真实环境风格的图像。2) 强化学习阶段:在域转换后的模拟图像上训练强化学习策略。该策略接收图像作为输入,输出机器人的控制指令。在真实环境中,直接使用训练好的策略控制机器人执行任务。

关键创新:最重要的技术创新点在于将像素级域适应技术与强化学习相结合,用于解决柔性物体操作的Sim-to-Real迁移问题。与传统的Sim-to-Real方法相比,该方法不需要手动设计特征或进行复杂的环境建模,而是通过数据驱动的方式自动学习域之间的映射关系。此外,该方法不需要配对图像,降低了数据收集的成本。

关键设计:论文中使用了CycleGAN作为图像转换模型,用于将模拟图像转换为真实风格的图像。强化学习算法使用了PPO(Proximal Policy Optimization)。损失函数包括CycleGAN的对抗损失和循环一致性损失,以及PPO的策略损失和价值损失。网络结构方面,使用了卷积神经网络提取图像特征,并使用全连接网络进行策略和价值函数的预测。

🖼️ 关键图片

📊 实验亮点

该研究在真实的机器人系统上进行了组织牵开实验,结果表明,经过在模拟环境中域适应图像训练的策略,无需在真实环境中进行任何重新训练,即可达到50%的成功率。这表明该方法能够有效地弥合Sim-to-Real gap,并具有较强的泛化能力。该结果是首次在外科领域中成功应用视觉Sim-to-Real迁移进行柔性物体操作。

🎯 应用场景

该研究成果可应用于机器人辅助手术领域,特别是涉及柔性物体操作的任务,如组织牵开、缝合等。通过减少对真实环境数据的依赖,降低了策略训练的成本和时间,加速了认知外科机器人向临床转化的进程。未来,该技术有望扩展到其他需要高精度操作的医疗任务中,提高手术效率和安全性。

📄 摘要(原文)

Automation holds the potential to assist surgeons in robotic interventions, shifting their mental work load from visuomotor control to high level decision making. Reinforcement learning has shown promising results in learning complex visuomotor policies, especially in simulation environments where many samples can be collected at low cost. A core challenge is learning policies in simulation that can be deployed in the real world, thereby overcoming the sim-to-real gap. In this work, we bridge the visual sim-to-real gap with an image-based reinforcement learning pipeline based on pixel-level domain adaptation and demonstrate its effectiveness on an image-based task in deformable object manipulation. We choose a tissue retraction task because of its importance in clinical reality of precise cancer surgery. After training in simulation on domain-translated images, our policy requires no retraining to perform tissue retraction with a 50% success rate on the real robotic system using raw RGB images. Furthermore, our sim-to-real transfer method makes no assumptions on the task itself and requires no paired images. This work introduces the first successful application of visual sim-to-real transfer for robotic manipulation of deformable objects in the surgical field, which represents a notable step towards the clinical translation of cognitive surgical robotics.