Open-Vocabulary Part-Based Grasping

作者: Tjeard van Oort, Dimity Miller, Will N. Browne, Nicolas Marticorena, Jesse Haviland, Niko Suenderhauf

分类: cs.RO

发布日期: 2024-06-10 (更新: 2025-09-18)

💡 一句话要点

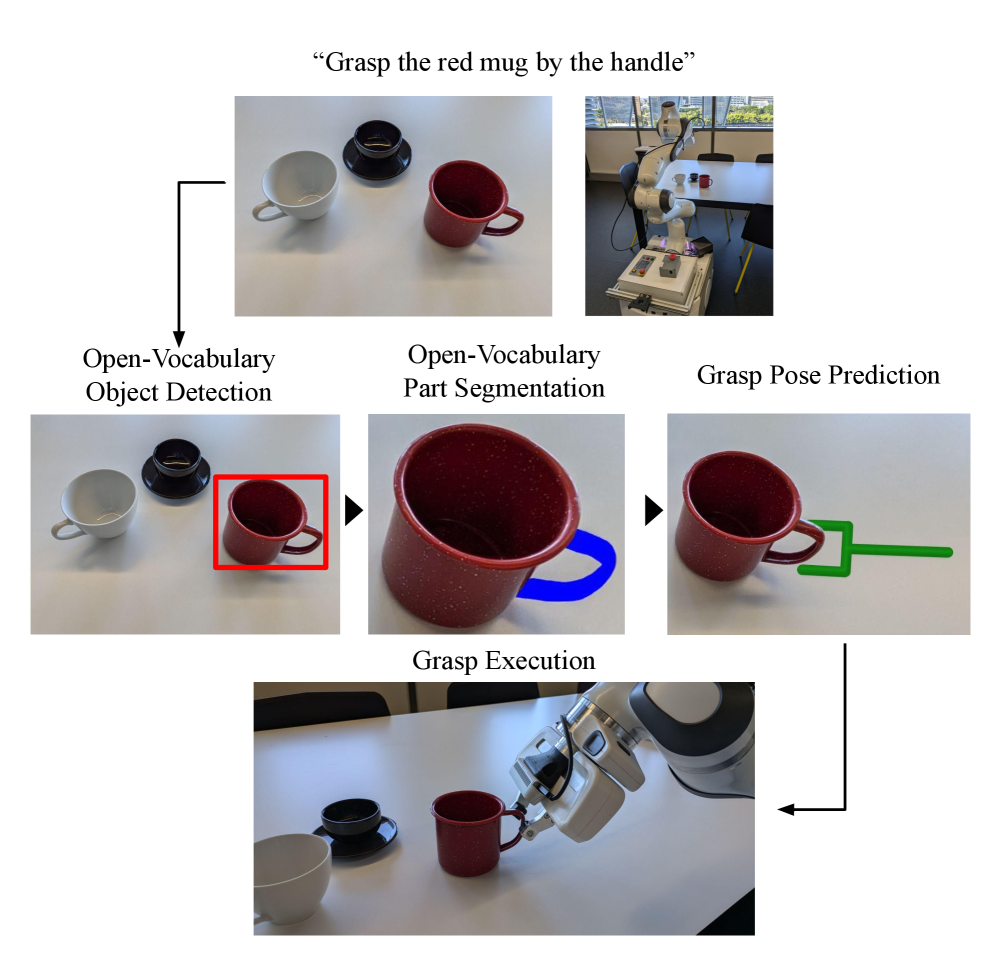

提出AnyPart框架,实现基于自然语言提示的开放词汇部件抓取

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人抓取 开放词汇 部件分割 自然语言提示 模块化框架

📋 核心要点

- 现有机器人抓取方法难以根据自然语言指令抓取特定物体部件,限制了其在复杂任务中的应用。

- AnyPart框架通过模块化组合开放词汇物体检测、部件分割和6自由度抓取预测,实现了基于自然语言提示的部件抓取。

- 实验表明,AnyPart在真实场景中实现了60.8%的抓取成功率,推理速度比现有方法快60倍。

📝 摘要(中文)

许多机器人任务需要在特定的物体部件上进行抓取,而不是随意抓取,这对于简单的拾取放置之外的交互至关重要,例如人机交互、物品传递或工具使用。以往的研究主要集中在通用抓取预测或任务条件抓取上,但没有直接针对开放词汇方式的物体部件。我们提出了AnyPart,一个模块化框架,它统一了开放词汇物体检测、部件分割和6自由度抓取预测,使机器人能够根据自然语言提示抓取任意物体的用户指定部件。我们评估了16种模型组合,并证明了性能最佳的组合在杂乱的真实世界场景中实现了60.8%的抓取成功率,且推理速度比现有方法快60倍。为了支持这项研究,我们引入了一个新的基于部件抓取的数据集,并进行了详细的失败分析。我们的核心见解是,模块化地结合现有的基础模型,无需额外的训练,即可释放出令人惊讶的强大而高效的开放词汇部件抓取能力。

🔬 方法详解

问题定义:现有机器人抓取方法主要集中于通用抓取或任务条件抓取,缺乏根据自然语言指令抓取特定物体部件的能力。这限制了机器人在人机交互、工具使用等复杂任务中的应用。现有方法通常需要针对特定物体或任务进行训练,泛化能力较差。

核心思路:AnyPart的核心思路是利用现有的预训练基础模型,通过模块化组合的方式,实现开放词汇的部件抓取。该方法避免了从头开始训练模型,充分利用了现有模型的知识,提高了效率和泛化能力。通过自然语言提示,用户可以指定需要抓取的物体部件,从而实现更灵活的抓取控制。

技术框架:AnyPart框架包含三个主要模块:开放词汇物体检测、部件分割和6自由度抓取预测。首先,开放词汇物体检测模块识别场景中的物体,并根据自然语言提示定位目标物体。然后,部件分割模块将目标物体分割成不同的部件。最后,6自由度抓取预测模块根据分割结果和自然语言提示,预测最佳的抓取姿态。这三个模块可以灵活组合,以适应不同的任务需求。

关键创新:AnyPart最重要的技术创新点在于其模块化设计和对现有基础模型的有效利用。通过将开放词汇物体检测、部件分割和6自由度抓取预测模块化,AnyPart可以灵活地适应不同的任务需求。此外,AnyPart充分利用了现有的预训练基础模型,避免了从头开始训练模型,提高了效率和泛化能力。

关键设计:AnyPart的关键设计包括:(1) 使用CLIP等模型进行开放词汇物体检测,实现对任意物体的识别;(2) 使用Mask R-CNN等模型进行部件分割,将物体分割成不同的部件;(3) 使用GraspNet等模型进行6自由度抓取预测,预测最佳的抓取姿态。框架没有进行额外的训练,而是直接使用了这些预训练模型的输出,并通过简单的后处理和组合,实现了开放词汇部件抓取。

🖼️ 关键图片

📊 实验亮点

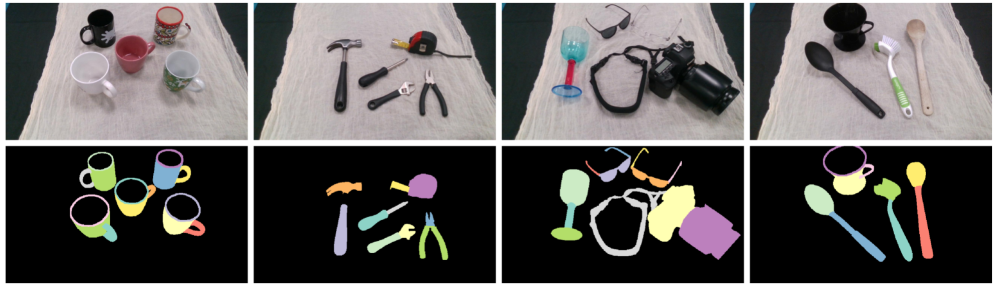

AnyPart在真实世界场景中实现了60.8%的抓取成功率,并且推理速度比现有方法快60倍。该研究评估了16种模型组合,并发现最佳组合在性能和效率方面都表现出色。此外,该研究还引入了一个新的基于部件抓取的数据集,并进行了详细的失败分析,为未来的研究提供了有价值的参考。

🎯 应用场景

AnyPart框架可应用于人机协作、家庭服务机器人、工业自动化等领域。例如,在人机协作中,机器人可以根据人类的自然语言指令抓取特定工具的特定部件,辅助人类完成任务。在家庭服务机器人中,机器人可以根据用户的指令抓取特定物品的特定部分,例如“把杯子的把手递给我”。在工业自动化中,机器人可以根据指令抓取零件的特定部位,进行组装或维修。

📄 摘要(原文)

Many robotic tasks require grasping objects at specific object parts instead of arbitrarily, a crucial capability for interactions beyond simple pick-and-place, such as human-robot interaction, handovers, or tool use. Prior work has focused either on generic grasp prediction or task-conditioned grasping, but not on directly targeting object parts in an open-vocabulary way. We propose AnyPart, a modular framework that unifies open-vocabulary object detection, part segmentation, and 6-DoF grasp prediction to enable robots to grasp user-specified parts of arbitrary objects based on natural language prompts. We evaluate 16 model combinations, and demonstrate that the best-performing combination achieves 60.8% grasp success in cluttered real-world scenes at 60 times faster inference than existing approaches. To support this study, we introduce a new dataset for part-based grasping and conduct a detailed failure analysis. Our core insight is that modularly combining existing foundation models unlocks surprisingly strong and efficient capabilities for open-vocabulary part-based grasping without requiring additional training.