A Superalignment Framework in Autonomous Driving with Large Language Models

作者: Xiangrui Kong, Thomas Braunl, Marco Fahmi, Yue Wang

分类: cs.RO, cs.CL, cs.CV

发布日期: 2024-06-09

备注: 6 pages, 5 figures, ieeeiv24

💡 一句话要点

提出基于多智能体LLM的自动驾驶安全框架,保障数据安全与行为合规。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶 大型语言模型 多智能体系统 安全框架 数据安全

📋 核心要点

- 现有自动驾驶系统依赖LLM进行高级分析,但缺乏对LLM推理输出的安全审查,存在数据泄露和违规风险。

- 论文提出一种基于多智能体LLM的安全框架,旨在保护自动驾驶车辆的敏感信息,并确保LLM输出符合驾驶法规和人类价值观。

- 通过对11个LLM驱动的自动驾驶提示进行安全、隐私和成本评估以及QA测试,验证了该框架的有效性。

📝 摘要(中文)

近年来,大型语言模型(LLM)和多模态大型语言模型(MLLM)在自动驾驶领域的应用取得了显著进展。这些模型在处理和交互复杂信息方面表现出卓越的能力。在自动驾驶中,LLM和MLLM被广泛使用,需要访问车辆的敏感数据,如精确位置、图像和路况。这些数据被传输到基于LLM的推理云进行高级分析。然而,数据安全问题日益突出,因为对数据和隐私泄露的保护主要依赖于LLM固有的安全措施,而缺乏对LLM推理输出的额外审查或评估。尽管其重要性,LLM在自动驾驶中的安全性方面仍未得到充分研究。为了弥补这一差距,我们的研究引入了一种新颖的自动驾驶车辆安全框架,该框架利用多智能体LLM方法。该框架旨在保护与自动驾驶车辆相关的敏感信息免受潜在泄露,同时确保LLM输出符合驾驶法规并与人类价值观保持一致。它包括过滤掉不相关查询并验证LLM输出的安全性和可靠性的机制。利用该框架,我们评估了11个大型语言模型驱动的自动驾驶提示的安全、隐私和成本方面。此外,我们对这些驾驶提示进行了QA测试,成功地证明了该框架的有效性。

🔬 方法详解

问题定义:自动驾驶系统依赖LLM进行决策,但现有方法主要依赖LLM自身的安全机制,缺乏外部的安全保障,导致敏感数据容易泄露,并且LLM的输出可能不符合驾驶法规和人类价值观。因此,需要一种框架来保障LLM在自动驾驶应用中的安全性和合规性。

核心思路:论文的核心思路是引入一个多智能体LLM框架,通过多个LLM智能体协同工作,对输入数据进行过滤,对LLM的输出进行验证,从而提高系统的安全性和可靠性。这种设计借鉴了软件工程中的防御性编程思想,通过多层防护来降低风险。

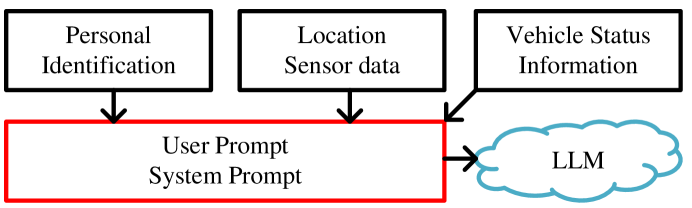

技术框架:该框架包含以下主要模块:1) 数据过滤模块:用于过滤掉不相关的查询,减少敏感数据的暴露。2) LLM推理模块:使用LLM对驾驶场景进行分析和决策。3) 输出验证模块:验证LLM的输出是否安全可靠,是否符合驾驶法规和人类价值观。4) 多智能体协同模块:多个LLM智能体协同工作,相互验证,提高系统的鲁棒性。

关键创新:该论文的关键创新在于提出了一个多智能体LLM框架,用于保障自动驾驶系统的安全性。与现有方法相比,该框架不仅依赖于LLM自身的安全机制,还引入了外部的安全验证机制,从而提高了系统的整体安全性。此外,多智能体的协同工作也提高了系统的鲁棒性。

关键设计:具体的技术细节包括:1) 数据过滤模块使用关键词过滤和语义分析等技术,过滤掉不相关的查询。2) 输出验证模块使用规则引擎和机器学习模型,验证LLM的输出是否安全可靠。3) 多智能体协同模块使用投票机制或共识算法,确保多个LLM智能体的输出一致。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了该框架的有效性。实验结果表明,该框架可以有效地过滤掉不相关的查询,验证LLM输出的安全性和可靠性,并降低数据泄露的风险。此外,QA测试也表明,该框架可以确保LLM的输出符合驾驶法规和人类价值观。

🎯 应用场景

该研究成果可应用于各种自动驾驶系统,提高其安全性和可靠性。例如,可以用于自动驾驶出租车、自动驾驶卡车和自动驾驶公交车等。此外,该框架还可以扩展到其他需要使用LLM进行决策的领域,如智能家居、智能医疗和智能金融等,具有广泛的应用前景。

📄 摘要(原文)

Over the last year, significant advancements have been made in the realms of large language models (LLMs) and multi-modal large language models (MLLMs), particularly in their application to autonomous driving. These models have showcased remarkable abilities in processing and interacting with complex information. In autonomous driving, LLMs and MLLMs are extensively used, requiring access to sensitive vehicle data such as precise locations, images, and road conditions. These data are transmitted to an LLM-based inference cloud for advanced analysis. However, concerns arise regarding data security, as the protection against data and privacy breaches primarily depends on the LLM's inherent security measures, without additional scrutiny or evaluation of the LLM's inference outputs. Despite its importance, the security aspect of LLMs in autonomous driving remains underexplored. Addressing this gap, our research introduces a novel security framework for autonomous vehicles, utilizing a multi-agent LLM approach. This framework is designed to safeguard sensitive information associated with autonomous vehicles from potential leaks, while also ensuring that LLM outputs adhere to driving regulations and align with human values. It includes mechanisms to filter out irrelevant queries and verify the safety and reliability of LLM outputs. Utilizing this framework, we evaluated the security, privacy, and cost aspects of eleven large language model-driven autonomous driving cues. Additionally, we performed QA tests on these driving prompts, which successfully demonstrated the framework's efficacy.