W-RIZZ: A Weakly-Supervised Framework for Relative Traversability Estimation in Mobile Robotics

作者: Andre Schreiber, Arun N. Sivakumar, Peter Du, Mateus V. Gasparino, Girish Chowdhary, Katherine Driggs-Campbell

分类: cs.RO

发布日期: 2024-06-04

备注: Accepted by RA-L. Code is available at https://github.com/andreschreiber/W-RIZZ

💡 一句话要点

提出W-RIZZ:一种弱监督的移动机器人相对可通行性估计框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 可通行性估计 弱监督学习 移动机器人 相对关系学习 环境感知

📋 核心要点

- 现有可通行性估计方法,如几何方法忽略语义信息,语义分割标注繁琐,自监督方法依赖额外数据且难标记不可通行区域。

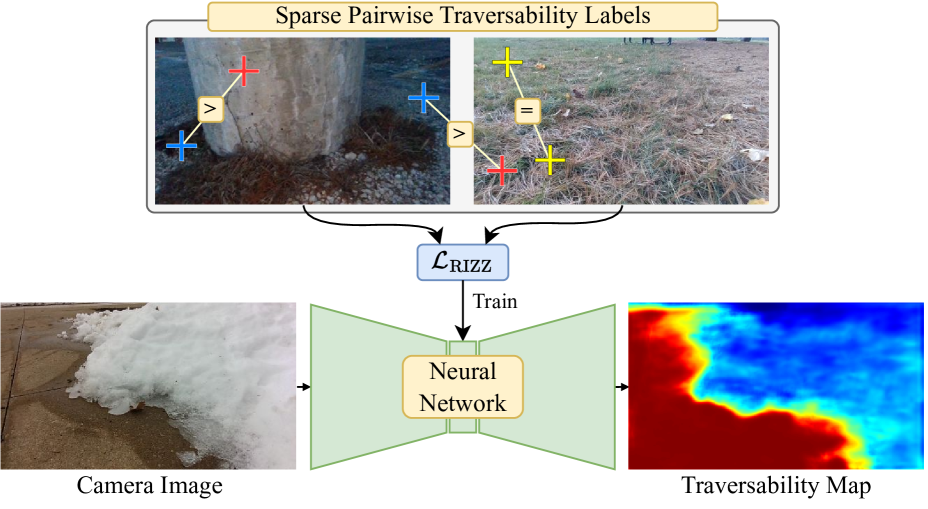

- W-RIZZ框架通过弱监督学习,仅需标注少量点对的相对可通行性,降低标注成本,同时避免了自监督方法的缺陷。

- 通过跨图像标注策略和定制损失函数,W-RIZZ框架在户外移动机器人实验中验证了其可行性和性能。

📝 摘要(中文)

本文提出了一种弱监督的相对可通行性估计方法,旨在解决移动机器人在非结构化环境中安全导航的问题。现有几何方法忽略了重要的语义信息,而语义分割方法需要繁琐的标注过程。虽然最近的自监督方法减少了标注工作,但需要额外的数据或模型,并且难以显式地标记不可通行区域。为了解决这些局限性,该方法仅需手动标注少量点对的相对可通行性,显著减少了标注工作量,并避免了自监督方法的限制。通过一种新颖的跨图像标注策略和损失函数,进一步提高了方法的性能。在户外环境的移动机器人部署中,验证了该方法的可行性和性能。

🔬 方法详解

问题定义:移动机器人在非结构化环境中导航时,需要准确估计环境的可通行性,以避免危险区域、陷入困境或与障碍物碰撞。现有的几何方法无法有效利用语义信息,而基于语义分割的方法需要大量的像素级标注,成本高昂。自监督方法虽然降低了标注成本,但通常需要额外的数据或模型,并且在显式标记不可通行区域方面表现不佳。

核心思路:W-RIZZ的核心思路是利用弱监督学习,通过人工标注少量点对之间的相对可通行性关系,来训练模型学习环境的可通行性。这种方法显著减少了标注工作量,同时避免了自监督方法对额外数据的依赖和难以显式标记不可通行区域的问题。通过学习点对之间的相对关系,模型可以推断出整个环境的可通行性分布。

技术框架:W-RIZZ框架主要包含以下几个模块:1) 数据采集模块:收集包含环境信息的图像数据。2) 弱监督标注模块:人工标注少量点对的相对可通行性关系。3) 模型训练模块:使用标注数据训练可通行性估计模型。4) 可通行性估计模块:利用训练好的模型估计环境中每个位置的可通行性。5) 导航决策模块:根据可通行性估计结果,规划机器人的安全路径。

关键创新:W-RIZZ的关键创新在于:1) 提出了基于弱监督学习的相对可通行性估计方法,显著降低了标注成本。2) 引入了一种新颖的跨图像标注策略,利用不同视角下的图像信息来增强模型的泛化能力。3) 设计了一种定制的损失函数,用于优化模型学习点对之间的相对可通行性关系。

关键设计:在弱监督标注方面,人工标注人员需要判断图像中两个点哪个更易于通行。跨图像标注策略利用不同视角的图像信息,例如,如果一个点在某个视角下被遮挡,可以利用其他视角的图像进行标注。损失函数的设计需要考虑点对之间的相对关系,例如,可以使用排序损失或对比损失来优化模型。

🖼️ 关键图片

📊 实验亮点

该论文通过在户外移动机器人平台上进行实验,验证了W-RIZZ框架的有效性。实验结果表明,与传统的基于语义分割的方法相比,W-RIZZ在显著降低标注成本的同时,能够达到相近甚至更好的可通行性估计精度。具体的性能数据(例如,可通行性估计的准确率、导航成功率等)需要在论文中查找。

🎯 应用场景

W-RIZZ框架可应用于各种移动机器人导航场景,例如农业机器人、巡检机器人、搜救机器人等。通过准确估计环境的可通行性,可以提高机器人的自主导航能力,降低安全风险,并扩展机器人的应用范围。该研究成果对于推动移动机器人在复杂环境中的应用具有重要意义。

📄 摘要(原文)

Successful deployment of mobile robots in unstructured domains requires an understanding of the environment and terrain to avoid hazardous areas, getting stuck, and colliding with obstacles. Traversability estimation--which predicts where in the environment a robot can travel--is one prominent approach that tackles this problem. Existing geometric methods may ignore important semantic considerations, while semantic segmentation approaches involve a tedious labeling process. Recent self-supervised methods reduce labeling tedium, but require additional data or models and tend to struggle to explicitly label untraversable areas. To address these limitations, we introduce a weakly-supervised method for relative traversability estimation. Our method involves manually annotating the relative traversability of a small number of point pairs, which significantly reduces labeling effort compared to traditional segmentation-based methods and avoids the limitations of self-supervised methods. We further improve the performance of our method through a novel cross-image labeling strategy and loss function. We demonstrate the viability and performance of our method through deployment on a mobile robot in outdoor environments.