Cross-Embodiment Robot Manipulation Skill Transfer using Latent Space Alignment

作者: Tianyu Wang, Dwait Bhatt, Xiaolong Wang, Nikolay Atanasov

分类: cs.RO, cs.AI

发布日期: 2024-06-04

备注: 8 pages, 9 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于潜在空间对齐的跨形态机器人操作技能迁移方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting)

关键词: 机器人操作 策略迁移 跨形态 潜在空间对齐 强化学习 领域自适应 生成对抗网络

📋 核心要点

- 现有强化学习方法难以将机器人操作策略从仿真环境迁移到真实机器人,或部署到不同形态的机器人上。

- 论文提出将源机器人和目标机器人的状态和动作投影到共同的潜在空间,实现跨形态的策略迁移。

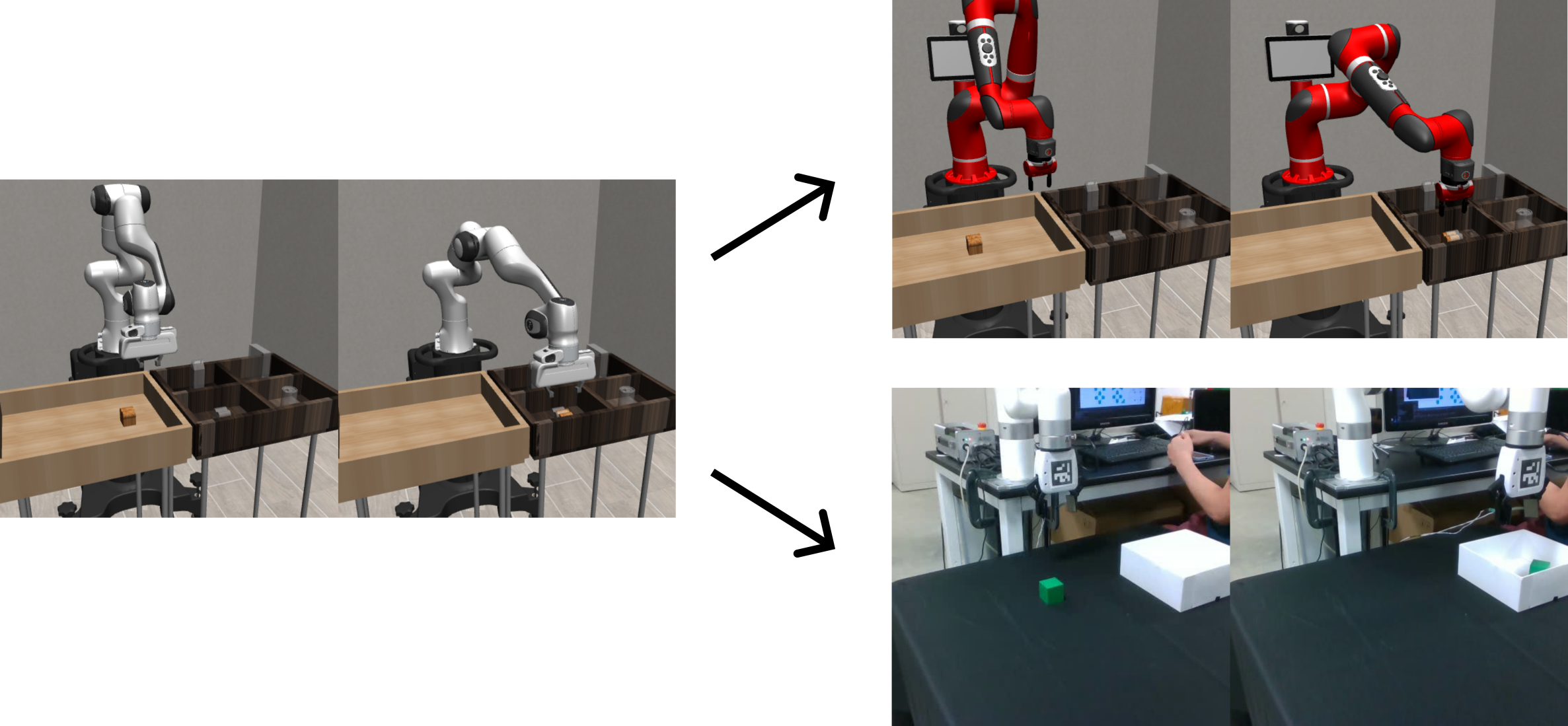

- 实验证明,该方法能够在仿真到仿真和仿真到真实的环境中,成功迁移不同形态机器人的操作策略。

📝 摘要(中文)

本文致力于解决不同形态机器人操作臂之间的控制策略迁移问题。尽管强化学习方法在机器人操作任务中取得了成功,但将训练好的策略从仿真环境迁移到真实机器人,或将其部署到具有不同状态、动作或运动学结构的机器人上仍然具有挑战性。为了实现跨形态策略迁移,我们的核心思想是将源机器人和目标机器人的状态和动作空间投影到一个共同的潜在空间表示中。我们首先引入编码器和解码器,将源机器人的状态和动作与潜在空间相关联。编码器、解码器和潜在空间控制策略同时进行训练,使用的损失函数用于衡量任务性能、潜在动态一致性以及编码器-解码器重建原始状态和动作的能力。为了迁移学习到的控制策略,我们只需要训练目标编码器和解码器,将新的目标域与潜在空间对齐。我们使用生成对抗训练,结合循环一致性和潜在动态损失,无需访问目标域中的任务奖励或奖励调整。我们展示了具有不同状态、动作和形态的源机器人和目标机器人的仿真到仿真以及仿真到真实的操作策略迁移。

🔬 方法详解

问题定义:现有强化学习方法在机器人操作任务中表现出色,但其策略迁移能力有限。将策略从仿真环境迁移到真实环境(sim-to-real),或者在具有不同形态(状态空间、动作空间、运动学结构不同)的机器人之间迁移策略,仍然是一个挑战。现有的方法往往需要大量的目标域数据进行微调,或者依赖于复杂的领域自适应技术。

核心思路:论文的核心思路是将不同形态机器人的状态和动作映射到一个共享的、低维的潜在空间中。在这个潜在空间中学习控制策略,然后通过学习目标机器人的编码器和解码器,将目标机器人的状态和动作映射到该潜在空间,从而实现策略迁移。这种方法的关键在于学习一个与具体机器人形态无关的、通用的控制策略表示。

技术框架:整体框架包含以下几个主要模块:1) 源机器人编码器和解码器:将源机器人的状态和动作映射到潜在空间,并从潜在空间重建状态和动作。2) 潜在空间控制策略:在潜在空间中学习控制策略,目标是完成特定的操作任务。3) 目标机器人编码器和解码器:将目标机器人的状态和动作映射到潜在空间,并从潜在空间重建状态和动作。训练过程包括:首先联合训练源机器人的编码器、解码器和潜在空间控制策略,然后固定潜在空间控制策略,只训练目标机器人的编码器和解码器,使其与潜在空间对齐。

关键创新:最重要的创新点在于提出了一个基于潜在空间对齐的跨形态策略迁移框架。与现有方法相比,该方法不需要访问目标域的奖励函数,也不需要进行复杂的奖励函数调整。通过学习一个通用的潜在空间表示,可以实现不同形态机器人之间的策略迁移。此外,使用生成对抗网络和循环一致性损失来训练目标机器人的编码器和解码器,进一步提高了迁移的效率和鲁棒性。

关键设计:关键的设计包括:1) 编码器和解码器的网络结构:可以使用各种神经网络结构,如MLP、CNN等,具体取决于状态和动作空间的维度和复杂性。2) 损失函数:包括任务性能损失(例如,操作任务的奖励)、潜在动态一致性损失(确保潜在空间中的动态变化与源机器人的动态变化一致)、编码器-解码器重建损失(确保编码器和解码器能够准确地重建原始状态和动作)、生成对抗损失和循环一致性损失(用于训练目标机器人的编码器和解码器)。3) 训练策略:采用两阶段训练策略,首先联合训练源机器人的编码器、解码器和潜在空间控制策略,然后固定潜在空间控制策略,只训练目标机器人的编码器和解码器。

🖼️ 关键图片

📊 实验亮点

论文通过仿真实验验证了该方法的有效性,在sim-to-sim和sim-to-real的场景下,成功地将操作策略从一个机器人迁移到另一个具有不同形态的机器人上。实验结果表明,该方法能够在目标机器人上实现与源机器人相似的任务性能,并且不需要访问目标域的奖励函数或进行奖励函数调整。具体的性能数据和对比基线在论文中给出。

🎯 应用场景

该研究成果可应用于机器人自动化生产线,实现不同型号机器人之间的任务快速部署和切换。例如,在柔性制造系统中,可以利用该方法将已训练好的操作技能快速迁移到新的机器人上,从而减少重新训练的时间和成本。此外,该方法还可用于开发更通用的机器人控制系统,使机器人能够适应不同的环境和任务。

📄 摘要(原文)

This paper focuses on transferring control policies between robot manipulators with different morphology. While reinforcement learning (RL) methods have shown successful results in robot manipulation tasks, transferring a trained policy from simulation to a real robot or deploying it on a robot with different states, actions, or kinematics is challenging. To achieve cross-embodiment policy transfer, our key insight is to project the state and action spaces of the source and target robots to a common latent space representation. We first introduce encoders and decoders to associate the states and actions of the source robot with a latent space. The encoders, decoders, and a latent space control policy are trained simultaneously using loss functions measuring task performance, latent dynamics consistency, and encoder-decoder ability to reconstruct the original states and actions. To transfer the learned control policy, we only need to train target encoders and decoders that align a new target domain to the latent space. We use generative adversarial training with cycle consistency and latent dynamics losses without access to the task reward or reward tuning in the target domain. We demonstrate sim-to-sim and sim-to-real manipulation policy transfer with source and target robots of different states, actions, and embodiments. The source code is available at \url{https://github.com/ExistentialRobotics/cross_embodiment_transfer}.