ManiCM: Real-time 3D Diffusion Policy via Consistency Model for Robotic Manipulation

作者: Guanxing Lu, Zifeng Gao, Tianxing Chen, Wenxun Dai, Ziwei Wang, Wenbo Ding, Yansong Tang

分类: cs.RO, cs.AI

发布日期: 2024-06-03 (更新: 2025-09-06)

备注: https://manicm-fast.github.io/

💡 一句话要点

ManiCM:基于一致性模型的实时3D扩散策略,用于机器人操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人操作 扩散模型 一致性模型 实时控制 点云 强化学习 一致性蒸馏

📋 核心要点

- 现有基于扩散模型的机器人操作方法,由于需要多次去噪,在高维观测下运行效率低。

- ManiCM通过施加一致性约束,使模型能够通过单步推理生成机器人动作,提高效率。

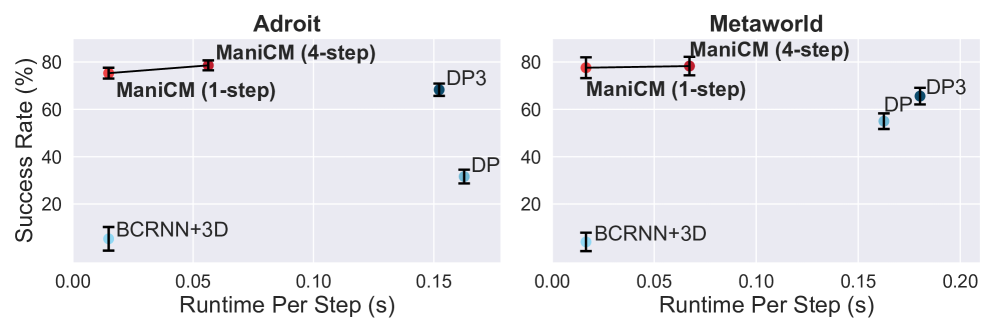

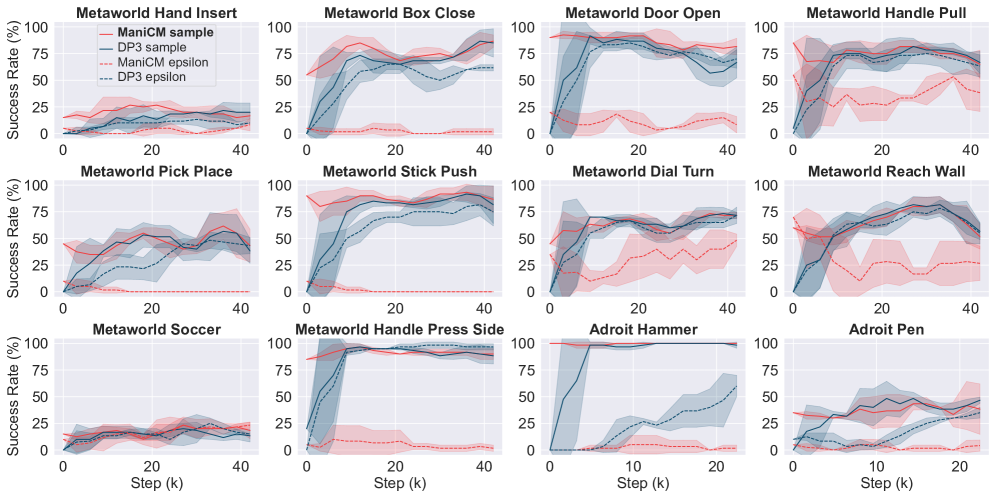

- 实验结果表明,ManiCM在保持竞争力的成功率的同时,推理速度比现有方法平均快10倍。

📝 摘要(中文)

扩散模型已被验证在生成复杂分布方面有效,从自然图像到运动轨迹皆可应用。最近基于扩散的方法在3D机器人操作任务中表现出令人印象深刻的性能,但由于多次去噪步骤,尤其是在高维观测下,它们存在严重的运行时效率低下问题。为此,我们提出了一种名为ManiCM的实时机器人操作模型,该模型将一致性约束施加到扩散过程中,从而使模型能够仅通过一步推理生成机器人动作。具体来说,我们制定了一个在机器人动作空间中,以点云输入为条件的一致扩散过程,其中原始动作需要直接从ODE轨迹上的任何点进行去噪。为了对这个过程进行建模,我们设计了一种一致性蒸馏技术,用于直接预测动作样本,而不是像计算机视觉领域那样预测噪声,以便在低维动作流形中快速收敛。我们在Adroit和Metaworld的31个机器人操作任务上评估了ManiCM,结果表明,我们的方法在保持具有竞争力的平均成功率的同时,平均推理速度比最先进的方法快10倍。

🔬 方法详解

问题定义:论文旨在解决基于扩散模型的机器人操作方法在实时性方面的不足。现有方法需要进行多次去噪迭代,导致在高维观测场景下推理速度慢,难以满足实时控制的需求。

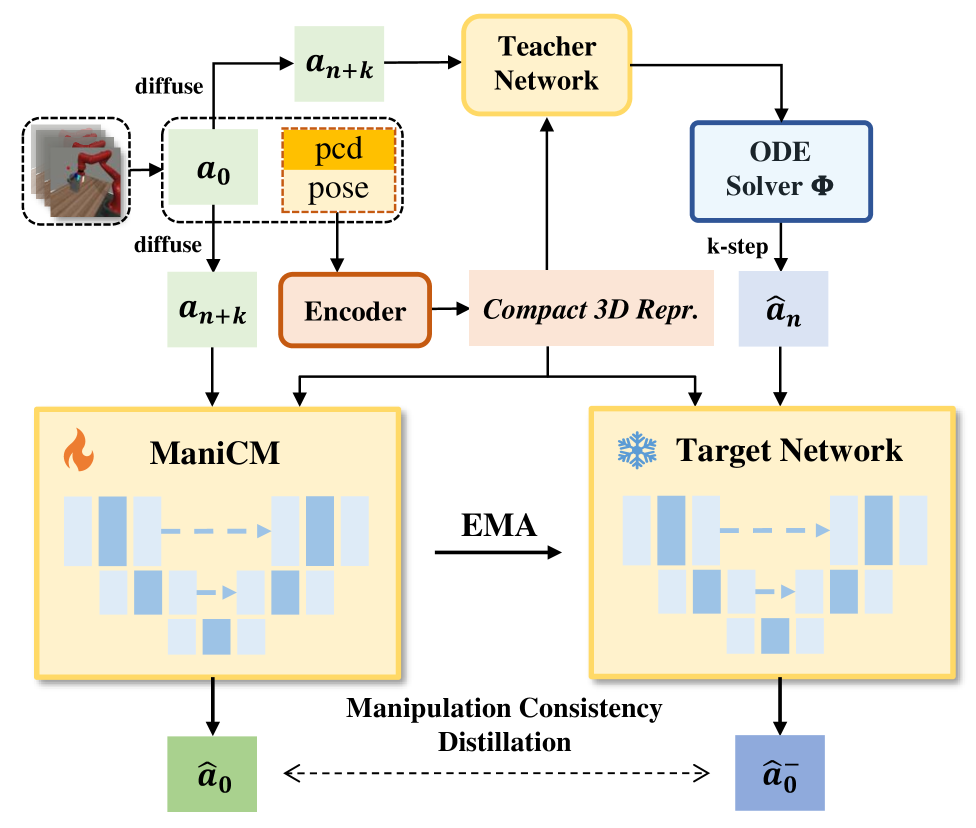

核心思路:论文的核心思路是利用一致性模型(Consistency Model)来约束扩散过程,使得从扩散轨迹上的任意点都能一步预测出原始动作。通过这种方式,避免了传统扩散模型的多步迭代去噪过程,从而显著提升推理速度。

技术框架:ManiCM的技术框架主要包含以下几个部分:1) 基于点云输入的机器人动作空间;2) 在该空间上定义的一致性扩散过程,要求从ODE轨迹上的任意点都能直接去噪得到原始动作;3) 一致性蒸馏技术,用于训练模型直接预测动作样本,而非预测噪声。整体流程是从点云输入到单步动作预测。

关键创新:论文的关键创新在于将一致性模型引入到机器人操作的扩散策略中,并设计了一致性蒸馏技术。与传统的扩散模型预测噪声不同,ManiCM直接预测动作样本,更适合低维动作流形,加速了收敛过程。

关键设计:论文的关键设计包括:1) 损失函数的设计,确保模型预测的动作与原始动作的一致性;2) 网络结构的设计,能够有效地从点云输入中提取特征,并预测出高质量的动作;3) 采用一致性蒸馏技术,通过teacher-student的方式训练模型,使得student模型能够学习到teacher模型的知识,从而实现单步推理。

🖼️ 关键图片

📊 实验亮点

ManiCM在Adroit和Metaworld的31个机器人操作任务上进行了评估。实验结果表明,ManiCM在保持与最先进方法相当的平均成功率的同时,平均推理速度提高了10倍。这表明ManiCM在实时性方面具有显著优势,能够满足实际应用的需求。

🎯 应用场景

ManiCM具有广泛的应用前景,例如工业自动化、家庭服务机器人、医疗机器人等领域。它可以应用于需要实时响应的机器人操作任务,例如快速抓取、动态避障、精准装配等。该研究的实际价值在于提高了机器人操作的效率和可靠性,为机器人更广泛的应用奠定了基础。未来,可以将ManiCM与其他感知技术相结合,实现更智能、更灵活的机器人操作。

📄 摘要(原文)

Diffusion models have been verified to be effective in generating complex distributions from natural images to motion trajectories. Recent diffusion-based methods show impressive performance in 3D robotic manipulation tasks, whereas they suffer from severe runtime inefficiency due to multiple denoising steps, especially with high-dimensional observations. To this end, we propose a real-time robotic manipulation model named ManiCM that imposes the consistency constraint to the diffusion process, so that the model can generate robot actions in only one-step inference. Specifically, we formulate a consistent diffusion process in the robot action space conditioned on the point cloud input, where the original action is required to be directly denoised from any point along the ODE trajectory. To model this process, we design a consistency distillation technique to predict the action sample directly instead of predicting the noise within the vision community for fast convergence in the low-dimensional action manifold. We evaluate ManiCM on 31 robotic manipulation tasks from Adroit and Metaworld, and the results demonstrate that our approach accelerates the state-of-the-art method by 10 times in average inference speed while maintaining competitive average success rate.