InterPreT: Interactive Predicate Learning from Language Feedback for Generalizable Task Planning

作者: Muzhi Han, Yifeng Zhu, Song-Chun Zhu, Ying Nian Wu, Yuke Zhu

分类: cs.RO

发布日期: 2024-05-30

备注: RSS 2024; https://interpret-robot.github.io

💡 一句话要点

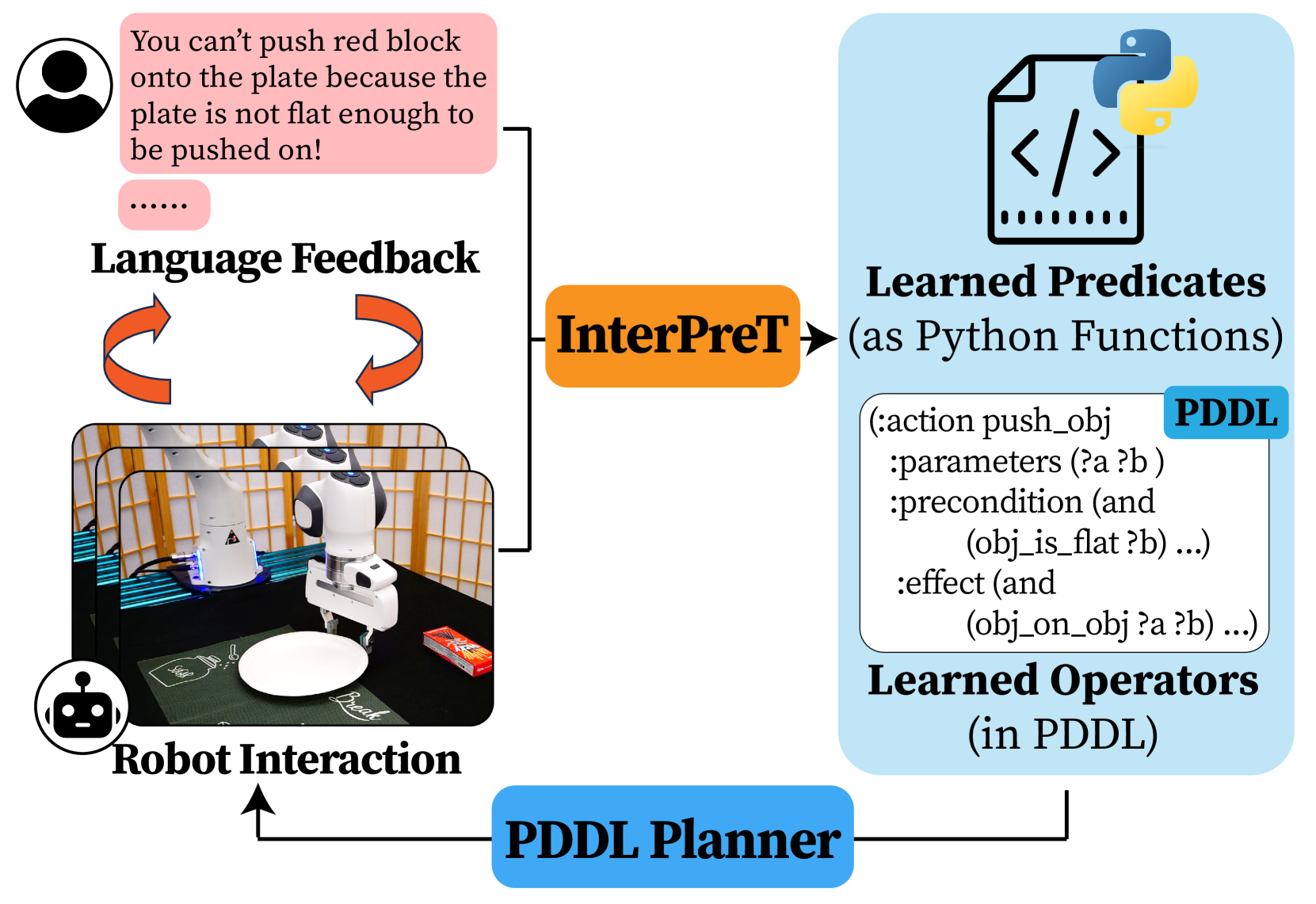

InterPreT:利用语言反馈交互式学习谓词,实现通用任务规划

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人任务规划 语言反馈学习 符号谓词学习 大型语言模型 交互式学习

📋 核心要点

- 长时程机器人规划的关键在于学习抽象的状态表示和知识,现有方法难以有效利用人类反馈。

- InterPreT利用大型语言模型,通过人类语言反馈学习符号谓词,从而实现环境状态的关系抽象。

- 实验表明,InterPreT学习到的谓词和算子具有很强的泛化能力,在复杂任务中显著优于基线方法。

📝 摘要(中文)

本文提出InterPreT,一个由大型语言模型驱动的框架,旨在让机器人通过与人类非专业人员的具身交互中的语言反馈来学习符号谓词。学习到的谓词提供了环境状态的关系抽象,从而促进了捕获动作前提条件和效果的符号算子的学习。通过将学习到的谓词和算子即时编译成PDDL领域,InterPreT能够使用PDDL规划器有效地规划任意领域内目标。在模拟和真实世界的机器人操作领域中,我们证明了InterPreT能够可靠地发现控制环境动态的关键谓词和算子。尽管是从简单的训练任务中学习的,但这些谓词和算子对复杂度显著提高的新任务表现出强大的泛化能力。在最具挑战性的泛化设置中,InterPreT在模拟中达到了73%的成功率,在现实世界中达到了40%的成功率,大大优于基线方法。

🔬 方法详解

问题定义:现有机器人任务规划方法在学习抽象状态表示和知识方面存在不足,尤其是在利用人类非专业知识方面。如何让机器人通过与人类交互,从语言反馈中学习可泛化的谓词和算子,是本文要解决的核心问题。现有方法难以有效利用人类反馈,导致泛化能力受限。

核心思路:InterPreT的核心思路是利用大型语言模型(LLM)的强大语言理解和生成能力,将人类的语言反馈转化为机器人可以理解和利用的符号谓词。通过交互式学习,机器人可以逐步完善其对环境的理解,并学习到适用于不同任务的通用知识。这种方法的核心在于将人类的知识融入到机器人的学习过程中,从而提高机器人的泛化能力。

技术框架:InterPreT框架包含以下主要模块:1) 语言反馈收集模块:收集人类对机器人行为的语言反馈。2) 谓词学习模块:利用LLM从语言反馈中学习符号谓词,这些谓词描述了环境的状态和对象之间的关系。3) 算子学习模块:基于学习到的谓词,学习描述动作前提条件和效果的符号算子。4) PDDL编译模块:将学习到的谓词和算子编译成PDDL领域描述。5) 任务规划模块:使用PDDL规划器,基于编译后的领域描述,规划机器人的动作序列。

关键创新:InterPreT的关键创新在于利用LLM进行交互式的谓词学习。与传统的基于手工设计的谓词或基于数据驱动的无监督学习方法不同,InterPreT能够直接从人类的语言反馈中学习谓词,从而更好地反映人类对环境的理解。此外,InterPreT还能够将学习到的谓词和算子编译成PDDL领域描述,从而利用现有的PDDL规划器进行任务规划。

关键设计:InterPreT的关键设计包括:1) 使用合适的LLM,并进行微调,以提高其在机器人任务规划领域的性能。2) 设计有效的语言反馈收集机制,例如,通过提问或提供选项的方式引导人类提供有用的反馈。3) 设计合适的损失函数,以优化谓词和算子的学习过程。4) 设计有效的PDDL编译策略,以确保编译后的领域描述能够被PDDL规划器正确解析。

🖼️ 关键图片

📊 实验亮点

实验结果表明,InterPreT在模拟和真实世界的机器人操作任务中都取得了显著的性能提升。在最具挑战性的泛化设置中,InterPreT在模拟中达到了73%的成功率,在现实世界中达到了40%的成功率,大大优于基线方法。这些结果表明,InterPreT学习到的谓词和算子具有很强的泛化能力,能够适应不同的任务和环境。

🎯 应用场景

InterPreT具有广泛的应用前景,例如,可以应用于家庭服务机器人、工业机器人、自动驾驶等领域。通过与人类交互,机器人可以学习到特定环境下的知识,从而更好地完成各种任务。此外,InterPreT还可以用于教育领域,帮助学生学习机器人编程和人工智能知识。该研究的实际价值在于降低了机器人编程的门槛,使得非专业人员也能够参与到机器人任务规划中来。未来,InterPreT有望成为一种通用的机器人任务规划框架。

📄 摘要(原文)

Learning abstract state representations and knowledge is crucial for long-horizon robot planning. We present InterPreT, an LLM-powered framework for robots to learn symbolic predicates from language feedback of human non-experts during embodied interaction. The learned predicates provide relational abstractions of the environment state, facilitating the learning of symbolic operators that capture action preconditions and effects. By compiling the learned predicates and operators into a PDDL domain on-the-fly, InterPreT allows effective planning toward arbitrary in-domain goals using a PDDL planner. In both simulated and real-world robot manipulation domains, we demonstrate that InterPreT reliably uncovers the key predicates and operators governing the environment dynamics. Although learned from simple training tasks, these predicates and operators exhibit strong generalization to novel tasks with significantly higher complexity. In the most challenging generalization setting, InterPreT attains success rates of 73% in simulation and 40% in the real world, substantially outperforming baseline methods.