Value Alignment and Trust in Human-Robot Interaction: Insights from Simulation and User Study

作者: Shreyas Bhat, Joseph B. Lyons, Cong Shi, X. Jessie Yang

分类: cs.RO

发布日期: 2024-05-28

备注: This is a preprint of the following chapter: Bhat et al., Value Alignment and Trust in Human-Robot Interaction: Insights from Simulation and User Study, published in "Emerging Frontiers in Human-Robot Interaction", edited by Ramana Kumar Vinjamuri, 2024, Springer Nature reproduced with permission of Springer Nature. The final authenticated version is available online at: [INSERT LINK HERE]

💡 一句话要点

研究人机协作中价值对齐对信任的影响,提出基于逆强化学习的自适应对齐策略。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 人机交互 价值对齐 信任 逆强化学习 自适应策略 仿真研究 用户研究

📋 核心要点

- 现有研究假设人机协作中价值对齐总是有益的,但缺乏实证验证,且忽略了信任因素。

- 提出一种基于逆强化学习的自适应策略,使机器人能够动态匹配人类的价值观。

- 仿真和实验结果表明,在高风险任务中价值对齐对信任至关重要,且自适应策略能有效维持信任。

📝 摘要(中文)

随着人工智能技术的发展,人类和机器人越来越多地合作执行任务。为了实现平滑有效的协作,机器人与人类之间的价值对齐(本文将其操作化为任务中动态目标对齐的程度)这一主题正受到越来越多的研究关注。以往关于价值对齐的文献都固有地假设,使机器人的价值观与人类的价值观对齐有利于团队。然而,这一假设尚未得到经验验证。此外,以往的文献在分析人机价值对齐时,没有考虑人类对机器人的信任。因此,需要通过回答两个问题来弥合研究差距:价值观的对齐如何影响信任?将机器人的价值观与人类的价值观对齐总是有益的吗?我们通过仿真研究和人类受试者研究来回答这些问题。仿真研究的结果表明,当任务的总体风险水平较高时,价值观的对齐对于信任至关重要。我们还提出了一种自适应策略,机器人使用逆强化学习(IRL)来匹配机器人与人类在交互过程中的价值观。我们的模拟表明,这种自适应策略能够维持人类价值观全谱中的信任。我们还展示了一项实证研究的结果,该研究验证了这些来自模拟的发现。结果表明,当机器人对人类的价值观没有很好的先验知识时,实时个性化的价值对齐有利于人类的信任和感知到的性能。

🔬 方法详解

问题定义:论文旨在研究人机协作中价值对齐对人类信任的影响。现有研究通常假设价值对齐总是有益的,但缺乏实验验证,并且没有充分考虑人类对机器人的信任程度。这种假设的有效性以及信任在价值对齐中的作用需要进一步研究。

核心思路:论文的核心思路是通过仿真和人类实验,探究价值对齐与人类信任之间的关系。特别地,论文提出了一种自适应的价值对齐策略,该策略允许机器人通过逆强化学习(IRL)来学习和匹配人类的价值观。这种自适应策略旨在使机器人在与人类交互时能够动态地调整其行为,从而提高人类的信任和协作效率。

技术框架:整体框架包括两个主要部分:仿真研究和人类实验。仿真研究使用虚拟环境来模拟人机协作场景,并测试不同价值对齐策略对信任的影响。人类实验则招募真实的人类受试者,让他们与机器人进行交互,并评估他们在不同价值对齐条件下的信任程度和任务表现。机器人使用逆强化学习(IRL)算法来学习人类的价值观,并根据学习到的价值观调整其行为。

关键创新:论文的关键创新在于提出了基于逆强化学习的自适应价值对齐策略。与传统的静态价值对齐方法不同,该策略能够根据人类的实际行为动态地调整机器人的价值观,从而更好地适应人类的需求和偏好。此外,论文还首次实证研究了价值对齐对人类信任的影响,并揭示了在高风险任务中价值对齐的重要性。

关键设计:在逆强化学习(IRL)的实现中,论文可能使用了最大熵逆强化学习或者贝叶斯逆强化学习等方法,通过观察人类的行为来推断其潜在的奖励函数(即价值观)。关键设计可能包括:特征工程(如何表示人类行为的特征),奖励函数的设计(如何将特征映射到奖励值),以及优化算法的选择(如何有效地学习奖励函数)。此外,信任的评估可能采用了问卷调查、生理指标监测等方法。

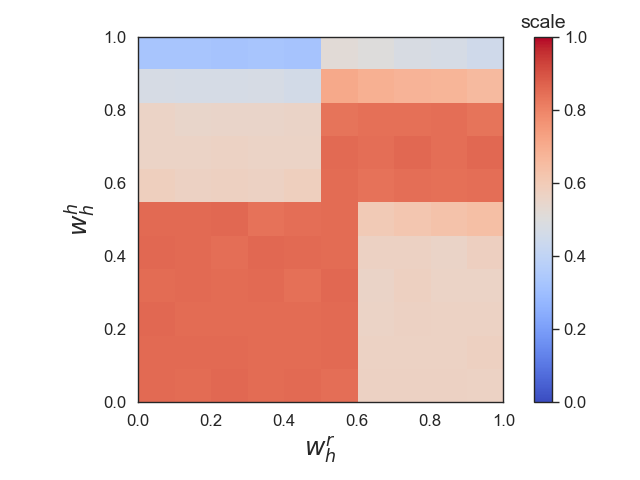

🖼️ 关键图片

📊 实验亮点

仿真结果表明,在高风险任务中,价值对齐对信任至关重要。实验结果验证了仿真结果,表明当机器人对人类的价值观没有很好的先验知识时,实时个性化的价值对齐有利于人类的信任和感知到的性能。该研究为设计更值得信赖和高效的人机协作系统提供了重要的理论依据和实践指导。

🎯 应用场景

该研究成果可应用于各种人机协作场景,例如:辅助驾驶、医疗机器人、工业机器人等。通过实现实时的个性化价值对齐,可以提高人类对机器人的信任度,从而提升协作效率和安全性。未来,该研究可以进一步扩展到多机器人协作、跨文化协作等更复杂的场景。

📄 摘要(原文)

With the advent of AI technologies, humans and robots are increasingly teaming up to perform collaborative tasks. To enable smooth and effective collaboration, the topic of value alignment (operationalized herein as the degree of dynamic goal alignment within a task) between the robot and the human is gaining increasing research attention. Prior literature on value alignment makes an inherent assumption that aligning the values of the robot with that of the human benefits the team. This assumption, however, has not been empirically verified. Moreover, prior literature does not account for human's trust in the robot when analyzing human-robot value alignment. Thus, a research gap needs to be bridged by answering two questions: How does alignment of values affect trust? Is it always beneficial to align the robot's values with that of the human? We present a simulation study and a human-subject study to answer these questions. Results from the simulation study show that alignment of values is important for trust when the overall risk level of the task is high. We also present an adaptive strategy for the robot that uses Inverse Reinforcement Learning (IRL) to match the values of the robot with those of the human during interaction. Our simulations suggest that such an adaptive strategy is able to maintain trust across the full spectrum of human values. We also present results from an empirical study that validate these findings from simulation. Results indicate that real-time personalized value alignment is beneficial to trust and perceived performance by the human when the robot does not have a good prior on the human's values.