Ego-Foresight: Self-supervised Learning of Agent-Aware Representations for Improved RL

作者: Manuel Serra Nunes, Atabak Dehban, Yiannis Demiris, José Santos-Victor

分类: cs.RO, cs.AI

发布日期: 2024-05-27 (更新: 2025-08-26)

备注: 13 pages, 8 figures, conference

💡 一句话要点

Ego-Foresight:通过自监督学习Agent-Aware表征提升强化学习效率

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 自监督学习 Agent-Aware表征 运动预测 机器人

📋 核心要点

- 深度强化学习需要大量训练数据,现有方法通常依赖监督信号来区分Agent和环境,限制了其应用。

- Ego-Foresight利用Agent运动作为线索,通过自监督学习解耦Agent和环境,无需额外的监督信号。

- 实验表明,Ego-Foresight能够有效预测Agent运动,并显著提升强化学习算法的样本效率和性能。

📝 摘要(中文)

尽管深度强化学习(RL)在过去十年取得了显著进展,但学习有效策略所需的训练经验量仍然是模拟和真实环境中主要关注的问题之一。为了解决这个问题,之前的工作表明,通过分别建模Agent和环境可以提高训练效率,但通常需要监督Agent掩码。与RL相比,人类可以通过少量的试验来完善一项新技能,并且在大多数情况下无需监督信号即可完成,这使得人类发展的神经科学研究成为RL的宝贵灵感来源。我们特别探索了运动预测的思想,该思想表明人类发展了自身及其运动命令对直接感官输入的影响的内部模型。我们的见解是,Agent的运动提供了一种线索,可以学习Agent和环境之间的二元性。为了实例化这个想法,我们提出Ego-Foresight,这是一种基于运动和预测来解耦Agent和环境的自监督方法。我们的主要发现是,通过对Agent的视觉运动预测进行自监督Agent感知可以提高底层RL算法的样本效率和性能。

🔬 方法详解

问题定义:现有强化学习算法在训练Agent时,通常需要大量的训练数据,尤其是在复杂环境中。一些方法尝试将Agent和环境分离建模,但往往依赖于人工标注的Agent掩码等监督信息,这在实际应用中难以获取,限制了算法的泛化能力。因此,如何在缺乏监督信号的情况下,有效地学习Agent和环境的解耦表征,是本文要解决的关键问题。

核心思路:本文的核心思路是借鉴人类的运动预测能力。人类能够通过自身的运动经验,学习到自身与环境之间的关系,并预测运动带来的感官变化。基于此,本文提出利用Agent自身的运动作为线索,通过自监督学习的方式,让Agent学习预测自身运动带来的视觉变化,从而实现Agent和环境的解耦。

技术框架:Ego-Foresight的整体框架包含两个主要模块:Agent-Aware表征学习模块和强化学习模块。首先,Agent-Aware表征学习模块通过自监督学习,学习Agent和环境的解耦表征。然后,将学习到的表征作为强化学习模块的输入,用于训练Agent的策略。具体来说,Agent在环境中执行动作,观察到当前状态和执行的动作,然后通过Agent-Aware表征学习模块预测下一个状态。预测的误差用于更新Agent-Aware表征学习模块的参数。

关键创新:Ego-Foresight的关键创新在于提出了基于运动的自监督学习方法,用于学习Agent-Aware表征。与现有方法相比,Ego-Foresight不需要任何人工标注的监督信息,而是通过Agent自身的运动作为线索,学习Agent和环境的解耦表征。这种自监督学习方法可以有效地提高强化学习算法的样本效率和泛化能力。

关键设计:Ego-Foresight的关键设计包括:1) 使用卷积神经网络(CNN)提取视觉特征;2) 使用循环神经网络(RNN)建模Agent的运动;3) 使用变分自编码器(VAE)学习Agent和环境的解耦表征;4) 使用均方误差(MSE)作为预测误差的损失函数。具体的网络结构和参数设置需要根据具体的任务进行调整。此外,为了提高训练的稳定性,可以使用一些常用的技巧,如梯度裁剪、学习率衰减等。

🖼️ 关键图片

📊 实验亮点

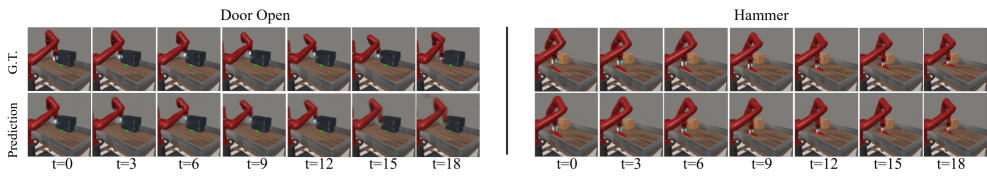

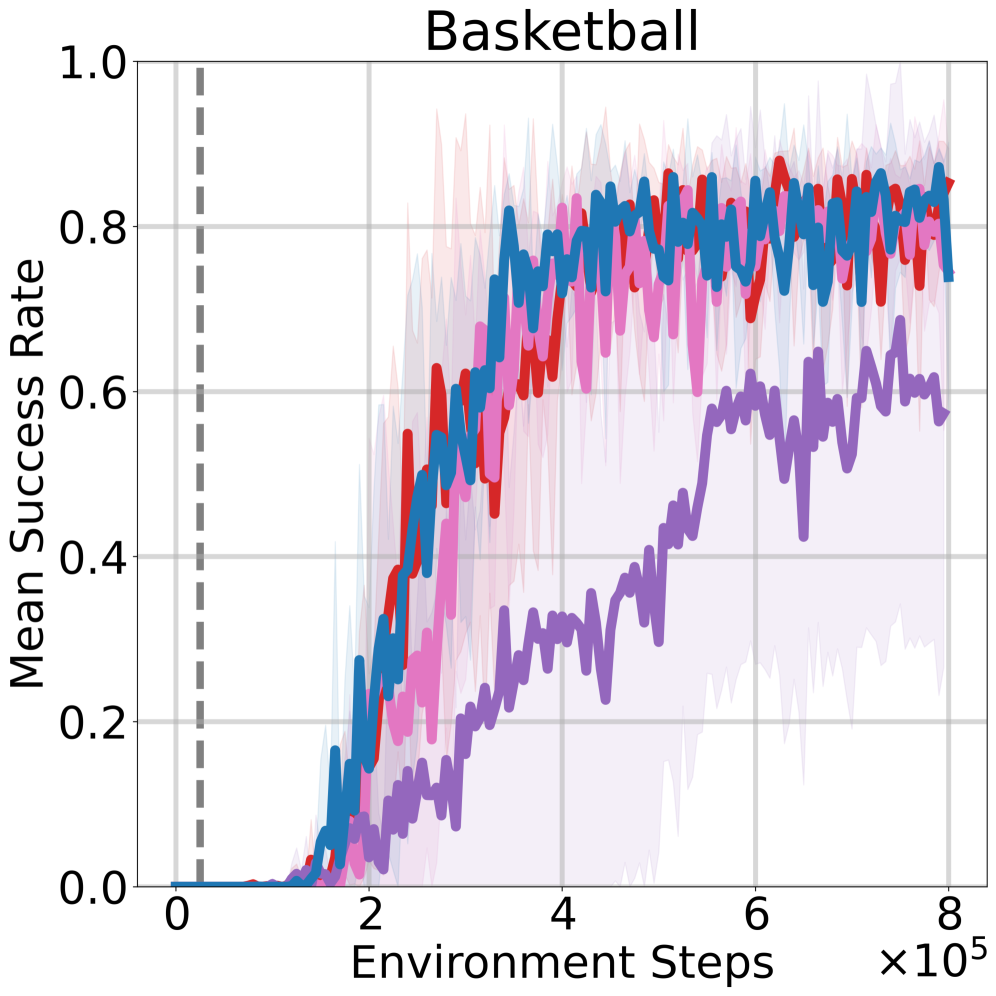

实验结果表明,Ego-Foresight能够有效地预测Agent的运动,并在多个模拟机器人任务中显著提升强化学习算法的性能。例如,在Reach任务中,与基线方法相比,Ego-Foresight可以将样本效率提高2倍以上。此外,Ego-Foresight在真实机器人数据上也表现出良好的泛化能力,证明了其在实际应用中的潜力。

🎯 应用场景

Ego-Foresight具有广泛的应用前景,例如机器人导航、自动驾驶、游戏AI等领域。通过学习Agent-Aware表征,可以提高Agent在复杂环境中的适应能力和决策能力。此外,该方法还可以应用于其他需要解耦Agent和环境的任务,例如人机协作、多Agent系统等。未来,Ego-Foresight有望成为一种通用的强化学习预训练方法,为各种Agent的学习提供有效的初始化。

📄 摘要(原文)

Despite the significant advancements in Deep Reinforcement Learning (RL) observed in the last decade, the amount of training experience necessary to learn effective policies remains one of the primary concerns both in simulated and real environments. Looking to solve this issue, previous work has shown that improved training efficiency can be achieved by separately modeling agent and environment, but usually requiring a supervisory agent mask. In contrast to RL, humans can perfect a new skill from a small number of trials and in most cases do so without a supervisory signal, making neuroscientific studies of human development a valuable source of inspiration for RL. In particular, we explore the idea of motor prediction, which states that humans develop an internal model of themselves and of the consequences that their motor commands have on the immediate sensory inputs. Our insight is that the movement of the agent provides a cue that allows the duality between agent and environment to be learned. To instantiate this idea, we present Ego-Foresight, a self-supervised method for disentangling agent and environment based on motion and prediction. Our main finding is self-supervised agent-awareness by visuomotor prediction of the agent improves sample-efficiency and performance of the underlying RL algorithm. To test our approach, we first study its ability to visually predict agent movement irrespective of the environment, in simulated and real-world robotic data. Then, we integrate Ego-Foresight with a model-free RL algorithm to solve simulated robotic tasks, showing that self-supervised agent-awareness can improve sample-efficiency and performance in RL.