CudaSIFT-SLAM: multiple-map visual SLAM for full procedure mapping in real human endoscopy

作者: Richard Elvira, Juan D. Tardós, José M. M. Montiel

分类: cs.RO, cs.CV

发布日期: 2024-05-27

备注: 10 pages, 10 figures, 6 tables, under revision

💡 一句话要点

CudaSIFT-SLAM:用于真实人体内窥镜全流程建图的多地图视觉SLAM系统

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 视觉SLAM 结肠镜检查 SIFT特征 GPU加速 实时建图 地图合并 内窥镜导航

📋 核心要点

- 现有ORB-SLAM3在结肠镜检查等复杂场景中,因ORB特征和DBoW2的局限性,难以从频繁的跟踪丢失中恢复。

- CudaSIFT-SLAM采用SIFT特征和GPU加速的暴力匹配,替代ORB和DBoW2,提升了重定位和地图合并的性能。

- 实验表明,CudaSIFT-SLAM在真实结肠镜视频中,地图覆盖率相比ORB-SLAM3提升了70%,实现了更完整的实时建图。

📝 摘要(中文)

单目视觉同步定位与建图(V-SLAM)已成为移动机器人和增强现实中不可替代的工具,并在这些领域表现出强大的鲁棒性。然而,人体结肠镜检查带来了严峻的挑战,如遮挡、模糊、光照变化、缺乏纹理、形变、水射流或工具交互,这些因素导致非常频繁的跟踪丢失。ORB-SLAM3是性能最佳的多地图V-SLAM系统,但由于其基于ORB特征和DBoW2词袋模型的位姿识别算法性能不佳,无法通过合并子地图或重定位相机来从中恢复。本文提出了CudaSIFT-SLAM,这是第一个能够实时处理完整人体结肠镜检查的V-SLAM系统。为了克服ORB-SLAM3的局限性,我们使用SIFT代替ORB特征,并用计算量更大的暴力匹配代替DBoW2直接索引,从而能够成功匹配时间上分离的图像以进行重定位和地图合并。借助CudaSIFT(SIFT提取和暴力匹配的GPU实现),实现了实时性能。我们在C3VD幻影结肠数据集和Endomapper数据集中的完整真实结肠镜检查中对我们的系统进行了基准测试,证明了合并子地图和在其中重定位的能力,从而获得了明显更长的子地图。我们的系统成功地实时映射了C3VD数据集中88%的帧。在真实的筛查结肠镜检查中,尽管遮挡和模糊帧的发生率更高,但在精心探索的区域中,映射覆盖率为53%,在完整序列中为38%,比ORB-SLAM3提高了70%。

🔬 方法详解

问题定义:论文旨在解决在真实人体结肠镜检查中,由于遮挡、模糊、光照变化等因素导致的V-SLAM系统跟踪丢失问题。现有方法,如ORB-SLAM3,在这些挑战性场景下,其基于ORB特征和DBoW2的位姿识别算法性能不佳,无法有效进行重定位和地图合并,导致建图不完整。

核心思路:论文的核心思路是使用更具鲁棒性的SIFT特征替代ORB特征,并采用暴力匹配方法进行图像匹配,以提高重定位和地图合并的成功率。同时,为了保证实时性,采用GPU加速的CudaSIFT实现SIFT特征提取和暴力匹配。这样设计的目的是为了在复杂和具有挑战性的结肠镜检查环境中,提高V-SLAM系统的稳定性和建图完整性。

技术框架:CudaSIFT-SLAM的整体框架基于V-SLAM系统,主要包含以下模块:1. 图像采集;2. CudaSIFT特征提取(GPU加速);3. 暴力匹配;4. 位姿估计;5. 地图构建;6. 回环检测与地图合并。系统首先从内窥镜视频中获取图像,然后使用CudaSIFT提取SIFT特征。接着,通过暴力匹配方法在关键帧之间进行图像匹配,用于重定位和地图合并。最后,根据匹配结果进行位姿估计和地图构建,并进行回环检测和地图合并,以构建全局一致的地图。

关键创新:论文最重要的技术创新点在于将SIFT特征和GPU加速的暴力匹配方法引入到结肠镜V-SLAM系统中,以克服ORB特征和DBoW2在复杂场景下的局限性。与现有方法相比,CudaSIFT-SLAM能够更有效地进行重定位和地图合并,从而构建更完整和准确的结肠镜地图。

关键设计:CudaSIFT的GPU实现是关键设计之一,它保证了SIFT特征提取和暴力匹配的实时性。此外,论文可能还涉及关键帧选择策略、地图合并算法、回环检测阈值等方面的设计,但具体细节未知。

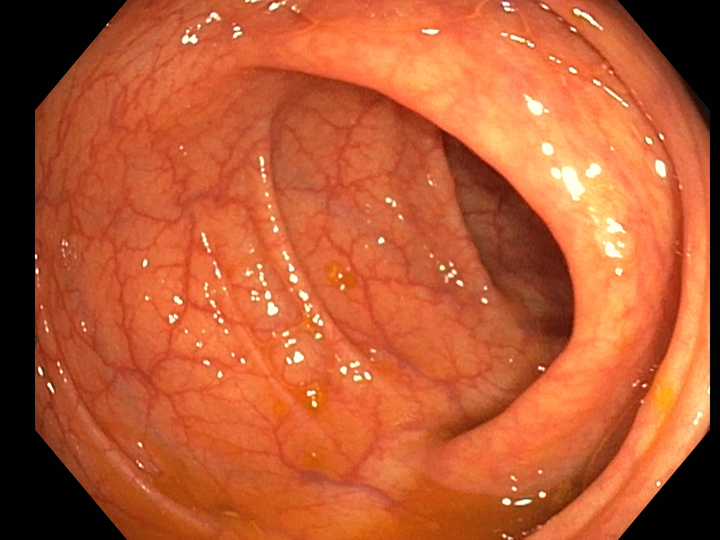

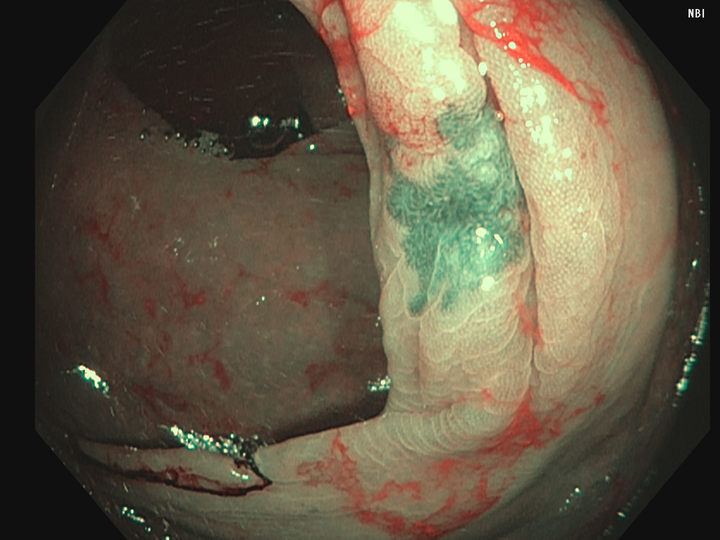

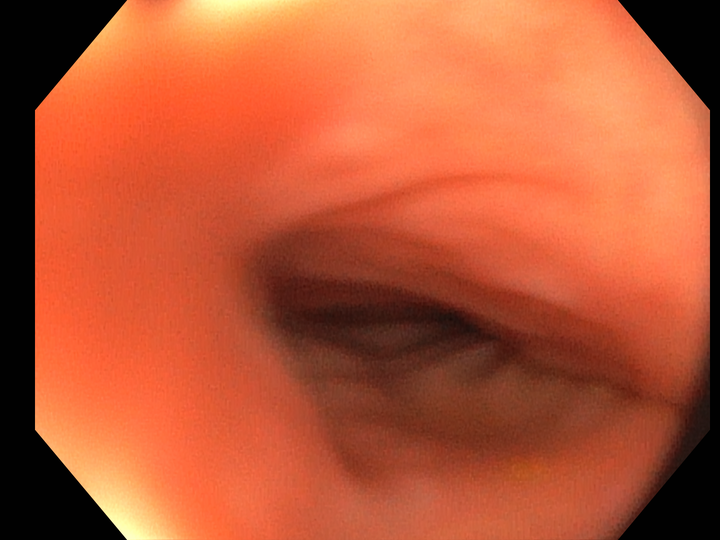

🖼️ 关键图片

📊 实验亮点

实验结果表明,CudaSIFT-SLAM在C3VD幻影结肠数据集中成功实时映射了88%的帧。在真实的筛查结肠镜检查中,在精心探索的区域中,映射覆盖率为53%,在完整序列中为38%,比ORB-SLAM3提高了70%。这些结果证明了CudaSIFT-SLAM在复杂结肠镜检查环境中的优越性能。

🎯 应用场景

CudaSIFT-SLAM在医疗领域具有广阔的应用前景,可用于辅助医生进行结肠镜检查,提供实时的三维地图,帮助医生更全面地了解肠道情况,提高诊断准确率。此外,该技术还可应用于其他内窥镜检查,如胃镜、支气管镜等,具有重要的临床价值和潜在的社会效益。

📄 摘要(原文)

Monocular visual simultaneous localization and mapping (V-SLAM) is nowadays an irreplaceable tool in mobile robotics and augmented reality, where it performs robustly. However, human colonoscopies pose formidable challenges like occlusions, blur, light changes, lack of texture, deformation, water jets or tool interaction, which result in very frequent tracking losses. ORB-SLAM3, the top performing multiple-map V-SLAM, is unable to recover from them by merging sub-maps or relocalizing the camera, due to the poor performance of its place recognition algorithm based on ORB features and DBoW2 bag-of-words. We present CudaSIFT-SLAM, the first V-SLAM system able to process complete human colonoscopies in real-time. To overcome the limitations of ORB-SLAM3, we use SIFT instead of ORB features and replace the DBoW2 direct index with the more computationally demanding brute-force matching, being able to successfully match images separated in time for relocation and map merging. Real-time performance is achieved thanks to CudaSIFT, a GPU implementation for SIFT extraction and brute-force matching. We benchmark our system in the C3VD phantom colon dataset, and in a full real colonoscopy from the Endomapper dataset, demonstrating the capabilities to merge sub-maps and relocate in them, obtaining significantly longer sub-maps. Our system successfully maps in real-time 88 % of the frames in the C3VD dataset. In a real screening colonoscopy, despite the much higher prevalence of occluded and blurred frames, the mapping coverage is 53 % in carefully explored areas and 38 % in the full sequence, a 70 % improvement over ORB-SLAM3.