Small but Fair! Fairness for Multimodal Human-Human and Robot-Human Mental Wellbeing Coaching

作者: Jiaee Cheong, Micol Spitale, Hatice Gunes

分类: cs.RO

发布日期: 2024-05-15

备注: First two authors have equal contribution, alphabetic order

💡 一句话要点

针对人机共融心理辅导,提出MixFeat数据增强方法以提升小样本数据集的公平性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 情感计算 机器学习公平性 数据增强 多模态学习

📋 核心要点

- 现有情感计算和人机交互研究缺乏对机器学习偏差的关注,尤其是在小样本数据集上。

- 提出MixFeat数据增强策略,旨在缓解小样本多模态数据集中的偏差,提升模型公平性。

- 通过实验分析,揭示了情感计算和人机交互领域中独特的机器学习公平性问题,并给出建议。

📝 摘要(中文)

近年来,情感计算(AC)和人机交互(HRI)研究领域已将公平性置于其研究议程的中心。然而,目前尚无工作解决HRI环境中机器学习(ML)的偏差问题。此外,当前许多用于AC和HRI的数据集都很“小”,这使得ML偏差和去偏分析具有挑战性。本文首次探讨了在人与人以及机器人与人心理辅导环境中收集的三个小型多模态数据集的ML偏差分析和缓解。本工作的主要贡献包括:i) 首次探索HRI环境中的ML偏差和公平性问题;ii) 提供多模态分析,通过建模性能和跨高低级特征的公平性指标进行评估,并提出一种简单有效的数据增强策略(MixFeat)来消除本文中小数据集的偏差;iii) 进行广泛的实验和分析,揭示AC和HRI研究中独特的ML公平性见解,从而提炼出一套建议,以帮助AC和HRI研究人员更多地参与到公平性意识的基于ML的研究中。

🔬 方法详解

问题定义:论文旨在解决人机交互(HRI)和情感计算(AC)领域中,由于数据集规模小和固有的数据偏差导致的机器学习模型不公平问题。现有方法通常忽略了HRI场景下的ML偏差,并且缺乏针对小样本数据集的有效去偏策略。这种偏差会导致模型在不同人群或情境下表现出显著差异,影响实际应用效果。

核心思路:论文的核心思路是通过数据增强来缓解小样本数据集的偏差。具体而言,论文提出了一种名为MixFeat的数据增强方法,该方法通过混合不同样本的特征来生成新的训练样本,从而增加数据集的多样性,减少模型对特定样本的过度依赖,进而提升模型的公平性。

技术框架:整体框架包括数据预处理、特征提取、模型训练、公平性评估和偏差缓解五个主要阶段。首先,对多模态数据进行预处理和特征提取,得到高低级特征。然后,使用这些特征训练机器学习模型。接着,使用公平性指标评估模型的偏差程度。最后,应用MixFeat数据增强策略,重新训练模型,并再次评估公平性。

关键创新:最重要的技术创新点是MixFeat数据增强策略。与传统的图像数据增强方法不同,MixFeat直接在特征空间进行混合,更适用于多模态数据,并且能够有效地增加小样本数据集的多样性。此外,该方法简单易用,可以方便地应用于不同的HRI和AC任务。

关键设计:MixFeat的关键设计在于如何选择混合的样本以及如何确定混合的比例。论文中,MixFeat随机选择两个样本,并按照一定的比例混合它们的特征。混合比例可以是一个固定的值,也可以是一个随机变量。此外,论文还探索了不同的特征混合方式,例如,可以只混合高级特征,也可以同时混合高级和低级特征。

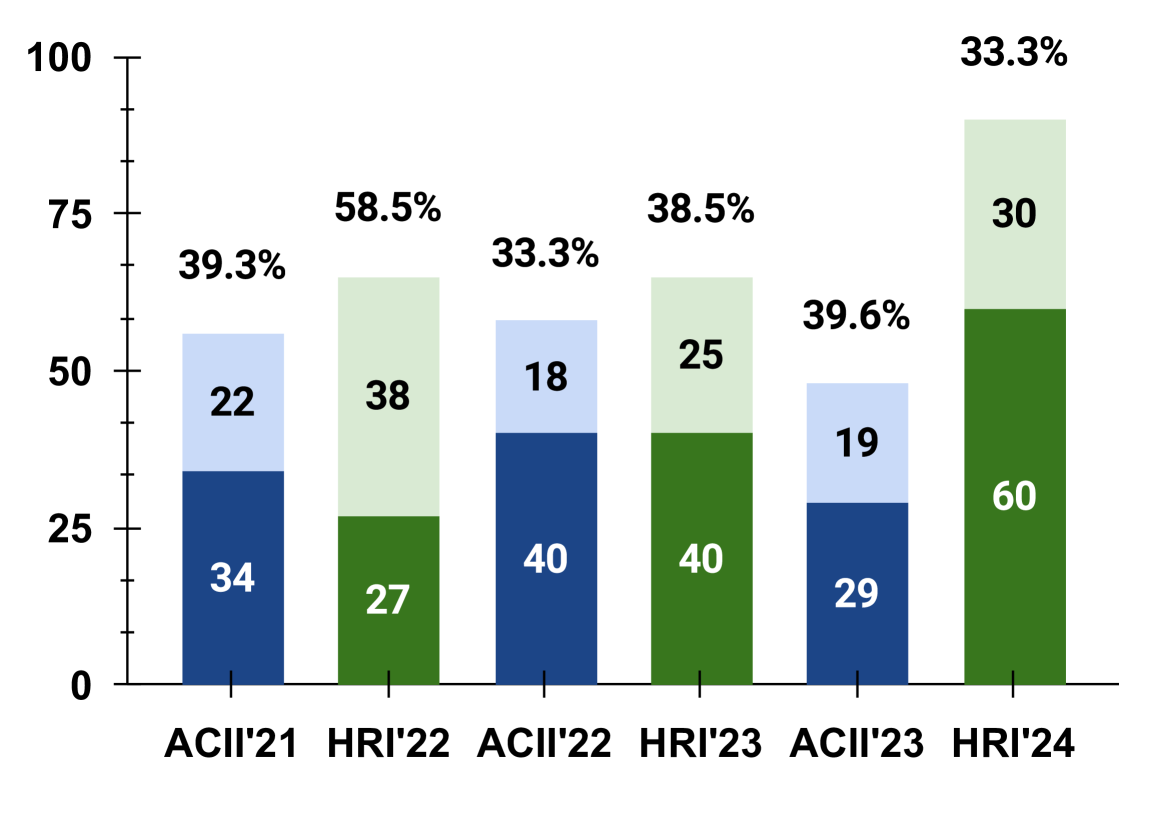

🖼️ 关键图片

📊 实验亮点

实验结果表明,MixFeat数据增强策略能够有效提升小样本数据集上模型的公平性,同时保持甚至提升模型的性能。通过在三个人机交互数据集上的实验,验证了MixFeat的有效性。具体性能提升数据未知,但实验证明了该方法在缓解偏差方面的有效性。

🎯 应用场景

该研究成果可应用于心理健康辅导机器人、情感识别系统等领域,提升人机交互的公平性和用户体验。通过减少算法偏差,确保不同背景的用户都能获得公平有效的服务,促进人工智能技术在心理健康领域的健康发展。未来,该方法有望推广到其他小样本、多模态的人工智能应用场景。

📄 摘要(原文)

In recent years, the affective computing (AC) and human-robot interaction (HRI) research communities have put fairness at the centre of their research agenda. However, none of the existing work has addressed the problem of machine learning (ML) bias in HRI settings. In addition, many of the current datasets for AC and HRI are "small", making ML bias and debias analysis challenging. This paper presents the first work to explore ML bias analysis and mitigation of three small multimodal datasets collected within both a human-human and robot-human wellbeing coaching settings. The contributions of this work includes: i) being the first to explore the problem of ML bias and fairness within HRI settings; and ii) providing a multimodal analysis evaluated via modelling performance and fairness metrics across both high and low-level features and proposing a simple and effective data augmentation strategy (MixFeat) to debias the small datasets presented within this paper; and iii) conducting extensive experimentation and analyses to reveal ML fairness insights unique to AC and HRI research in order to distill a set of recommendations to aid AC and HRI researchers to be more engaged with fairness-aware ML-based research.