Auxiliary-predicted Compress Memory Model(ApCM Model): A Neural Memory Storage Model Based on Invertible Compression and Learnable Prediction

作者: Weinuo Ou

分类: cs.LG

发布日期: 2026-04-07

💡 一句话要点

提出ApCM模型,通过可逆压缩和预测机制增强LLM的运行时记忆能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 运行时记忆 可逆压缩 辅助预测 神经记忆存储

📋 核心要点

- 现有大型语言模型缺乏有效的运行时记忆机制,限制了其在动态和个性化交互场景中的应用。

- ApCM模型通过可逆压缩和可学习的预测机制,构建神经记忆存储架构,提升模型记忆能力。

- 论文提出了ApCM模型,但摘要中未提及实验结果和性能提升,具体效果未知。

📝 摘要(中文)

当前的大型语言模型(LLMs)普遍缺乏有效的运行时记忆机制,这使得它们难以适应动态和个性化的交互需求。为了解决这个问题,本文提出了一种新颖的神经记忆存储架构——辅助预测压缩记忆模型(ApCM模型)。

🔬 方法详解

问题定义:大型语言模型在处理动态和个性化交互时,由于缺乏有效的运行时记忆机制,无法很好地记住之前的交互信息,导致无法进行上下文相关的推理和生成。现有方法要么依赖于外部知识库,要么直接将所有历史信息作为输入,效率较低且容易受到噪声干扰。

核心思路:ApCM模型的核心思路是利用可逆压缩技术将历史信息压缩成紧凑的记忆表示,并使用辅助预测机制来预测未来的记忆状态。通过这种方式,模型可以在运行时高效地存储和检索相关信息,从而更好地适应动态交互环境。

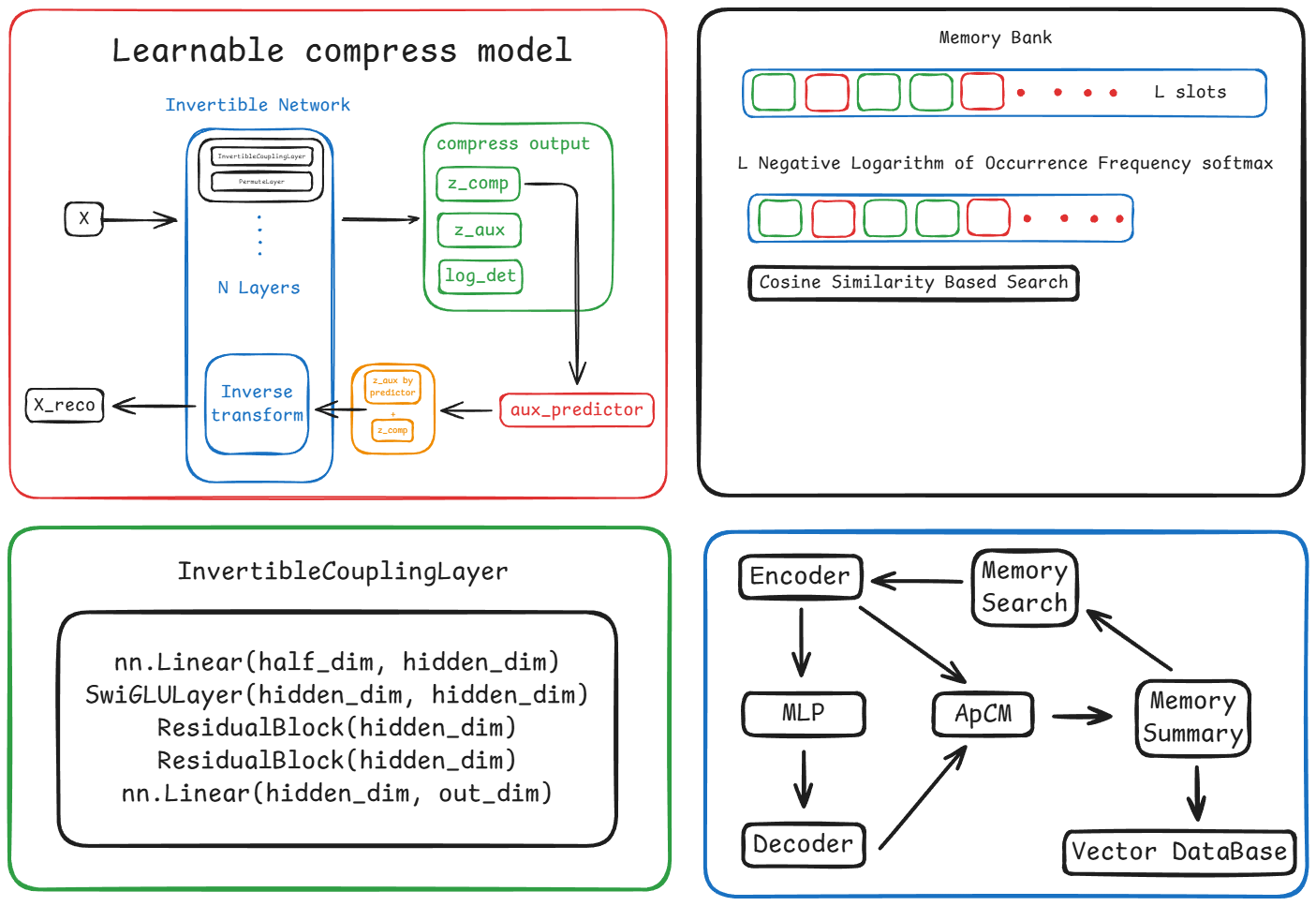

技术框架:ApCM模型的整体架构包含三个主要模块:压缩模块、记忆存储模块和预测模块。压缩模块负责将输入信息压缩成低维向量表示;记忆存储模块负责存储和检索压缩后的记忆;预测模块则根据当前记忆状态预测未来的记忆状态。整个流程是:输入信息经过压缩模块编码,存储到记忆存储模块,同时预测模块预测下一个状态,用于后续交互。

关键创新:ApCM模型的关键创新在于结合了可逆压缩和可学习的预测机制。可逆压缩保证了信息在压缩和解压缩过程中的无损性,避免了信息损失;预测机制则使得模型能够提前预测未来的记忆状态,从而更好地适应动态变化的环境。与现有方法相比,ApCM模型能够更高效地存储和检索相关信息,并具有更强的适应性。

关键设计:论文摘要中没有提供关于具体参数设置、损失函数、网络结构等技术细节。这些细节对于理解和复现ApCM模型至关重要,需要进一步查阅论文全文才能了解。

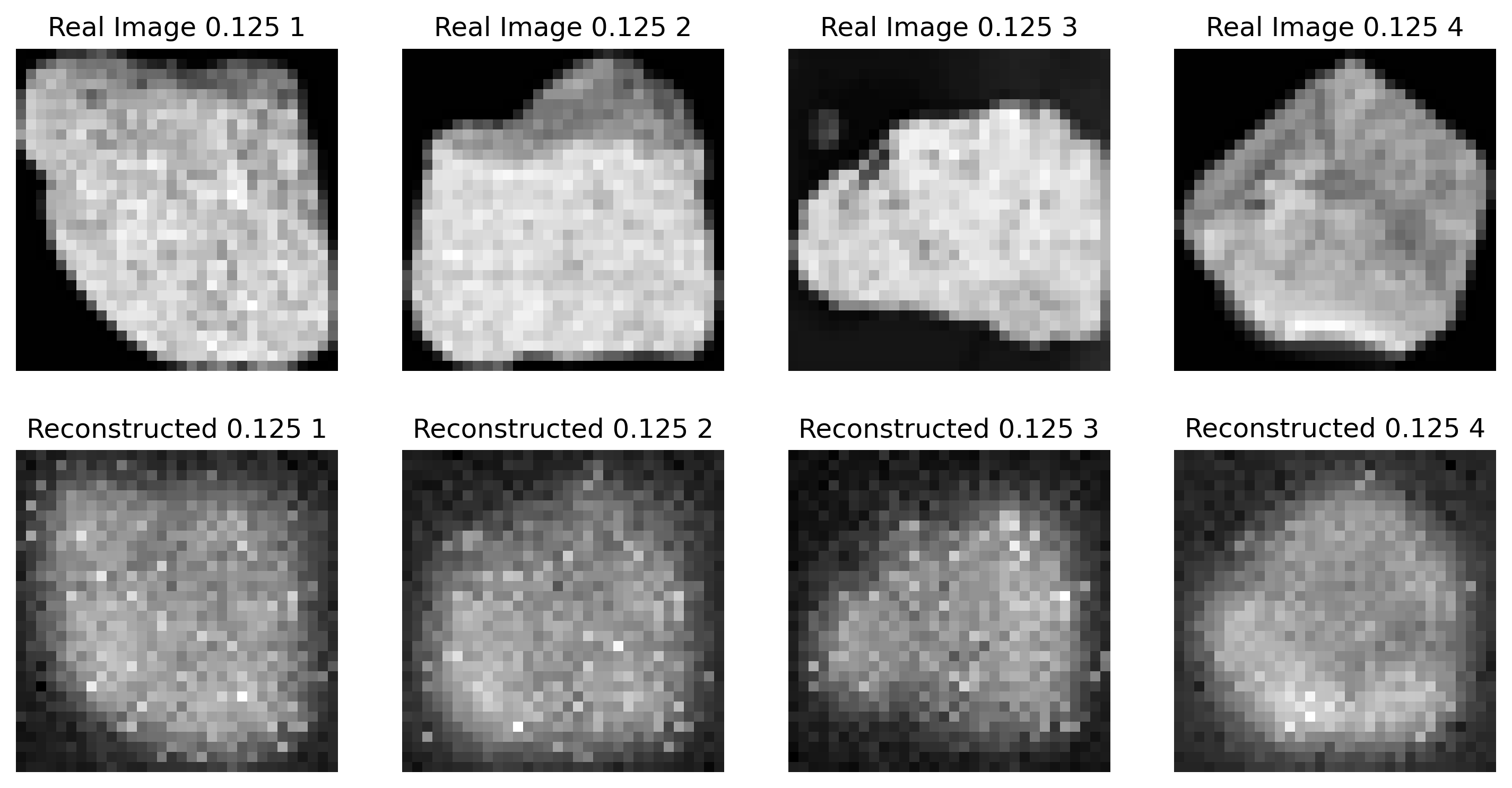

🖼️ 关键图片

📊 实验亮点

摘要中未提供具体的实验结果和性能数据,因此无法总结实验亮点。需要查阅论文全文才能了解ApCM模型的具体性能表现和提升幅度。

🎯 应用场景

ApCM模型具有广泛的应用前景,例如智能对话系统、个性化推荐系统、机器人控制等。它可以帮助这些系统更好地理解用户的意图,并根据历史交互信息进行更准确的推理和决策。未来,ApCM模型有望成为构建更智能、更人性化的AI系统的关键技术。

📄 摘要(原文)

Current large language models (LLMs) generally lack an effective runtime memory mechanism,making it difficult to adapt to dynamic and personalized interaction requirements. To address this issue, this paper proposes a novel neural memory storage architecture--the Auxiliary Prediction Compression Memory Model (ApCM Model).