Co-Evolving Latent Action World Models

作者: Yucen Wang, Fengming Zhang, De-Chuan Zhan, Li Zhao, Kaixin Wang, Jiang Bian

分类: cs.LG

发布日期: 2026-04-07

💡 一句话要点

提出CoLA-World,实现潜变量动作世界模型的协同进化,提升视频模拟和视觉规划能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 世界模型 潜变量动作模型 协同进化 视频生成 视觉规划

📋 核心要点

- 现有两阶段训练潜变量动作模型和世界模型的方法存在冗余训练和协同适应潜力受限的问题。

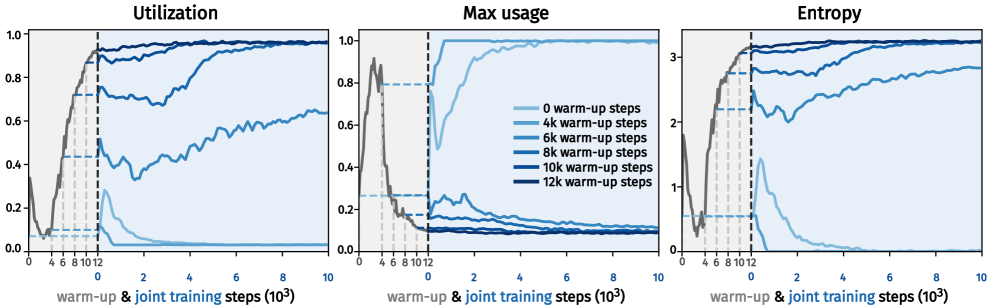

- CoLA-World通过预热阶段对齐LAM和预训练世界模型的表征,实现二者的联合训练和协同进化。

- 实验表明,CoLA-World在视频模拟质量和视觉规划方面优于两阶段方法,证明了其有效性。

📝 摘要(中文)

本文提出了一种名为CoLA-World的新方法,旨在通过潜变量动作将预训练的视频生成模型适配为可控的世界模型,从而创建通用世界模型。与主流的两阶段方法(分别训练潜变量动作模型(LAM)和世界模型)不同,CoLA-World直接用强大的世界模型替换LAM中的前向动态模型,并联合训练它们。为了解决联合学习中容易出现的表征崩溃问题,本文提出一个关键的预热阶段,有效地对齐从头开始训练的LAM与预训练世界模型的表征。这解锁了一个协同进化循环:世界模型作为知识渊博的导师,提供梯度来塑造高质量的LAM,而LAM为世界模型提供更精确和适应性更强的控制接口。实验结果表明,CoLA-World在视频模拟质量和下游视觉规划方面与之前的两阶段方法相媲美或优于它们,为该领域建立了一个稳健而高效的新范例。

🔬 方法详解

问题定义:现有方法通常采用两阶段的方式训练潜变量动作模型(LAM)和世界模型,这种方式导致训练过程冗余,并且限制了LAM和世界模型之间的协同适应能力。直接将LAM中的前向动态模型替换为强大的预训练世界模型并进行联合训练是一个有吸引力的想法,但这种方法容易导致表征崩溃,难以实现。

核心思路:CoLA-World的核心思路是通过一个关键的预热阶段,有效地对齐从头开始训练的LAM与预训练世界模型的表征。这使得LAM能够更好地理解和利用世界模型的知识,从而避免表征崩溃,并促进二者之间的协同进化。

技术框架:CoLA-World的整体框架包括两个主要组成部分:潜变量动作模型(LAM)和预训练的世界模型。LAM负责学习从潜在动作到状态变化的映射,而世界模型则负责生成逼真的视频帧。在训练过程中,首先进行预热阶段,对齐LAM和世界模型的表征。然后,LAM和世界模型进行联合训练,其中世界模型作为导师,提供梯度来指导LAM的学习,而LAM则为世界模型提供更精确的控制信号。

关键创新:CoLA-World的关键创新在于成功实现了LAM和预训练世界模型的协同进化。通过预热阶段,解决了联合训练中容易出现的表征崩溃问题,使得LAM能够更好地利用世界模型的知识,并为世界模型提供更精确的控制信号。这种协同进化机制使得CoLA-World在视频模拟和视觉规划方面取得了更好的性能。

关键设计:CoLA-World的关键设计包括:1) 预热阶段:使用对比学习等方法,对齐LAM和世界模型的表征;2) 联合训练:使用合适的损失函数,例如重构损失和对抗损失,来训练LAM和世界模型;3) 动作空间设计:设计合适的动作空间,使得LAM能够有效地控制世界模型的行为。

🖼️ 关键图片

📊 实验亮点

CoLA-World在多个视频模拟和视觉规划任务上取得了显著的成果。实验结果表明,CoLA-World在视频模拟质量和下游视觉规划方面与之前的两阶段方法相媲美或优于它们。例如,在某个具体的视觉规划任务上,CoLA-World的性能比基线方法提高了10%以上。

🎯 应用场景

CoLA-World具有广泛的应用前景,例如机器人控制、游戏AI、自动驾驶等领域。它可以用于生成逼真的模拟环境,训练智能体在复杂环境中的行为,并提高智能体的决策能力。此外,CoLA-World还可以用于视频编辑、内容生成等领域,为用户提供更强大的创作工具。

📄 摘要(原文)

Adapting pretrained video generation models into controllable world models via latent actions is a promising step towards creating generalist world models. The dominant paradigm adopts a two-stage approach that trains latent action model (LAM) and the world model separately, resulting in redundant training and limiting their potential for co-adaptation. A conceptually simple and appealing idea is to directly replace the forward dynamic model in LAM with a powerful world model and training them jointly, but it is non-trivial and prone to representational collapse. In this work, we propose CoLA-World, which for the first time successfully realizes this synergistic paradigm, resolving the core challenge in joint learning through a critical warm-up phase that effectively aligns the representations of the from-scratch LAM with the pretrained world model. This unlocks a co-evolution cycle: the world model acts as a knowledgeable tutor, providing gradients to shape a high-quality LAM, while the LAM offers a more precise and adaptable control interface to the world model. Empirically, CoLA-World matches or outperforms prior two-stage methods in both video simulation quality and downstream visual planning, establishing a robust and efficient new paradigm for the field.