LLMs Judging LLMs: A Simplex Perspective

作者: Patrick Vossler, Fan Xia, Yifan Mai, Adarsh Subbaswamy, Jean Feng

分类: cs.LG, cs.AI, stat.ML

发布日期: 2026-04-07

💡 一句话要点

提出几何贝叶斯先验以评估大型语言模型的输出质量

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 评估机制 几何分析 贝叶斯推断 不确定性建模 自然语言处理 自动评分

📋 核心要点

- 现有方法在评估LLMs输出时仅考虑随机不确定性,忽略了评判者质量的不确定性,导致评估结果的可靠性不足。

- 论文提出了一种几何视角,通过将LLM评判者和候选者表示为概率单纯形上的点,设计几何贝叶斯先验以编码评判质量的不确定性。

- 实验表明,基于LLM评判者的排名在多个数据集上表现稳健,且该贝叶斯方法的覆盖率显著高于现有程序,展示了建模认知不确定性的必要性。

📝 摘要(中文)

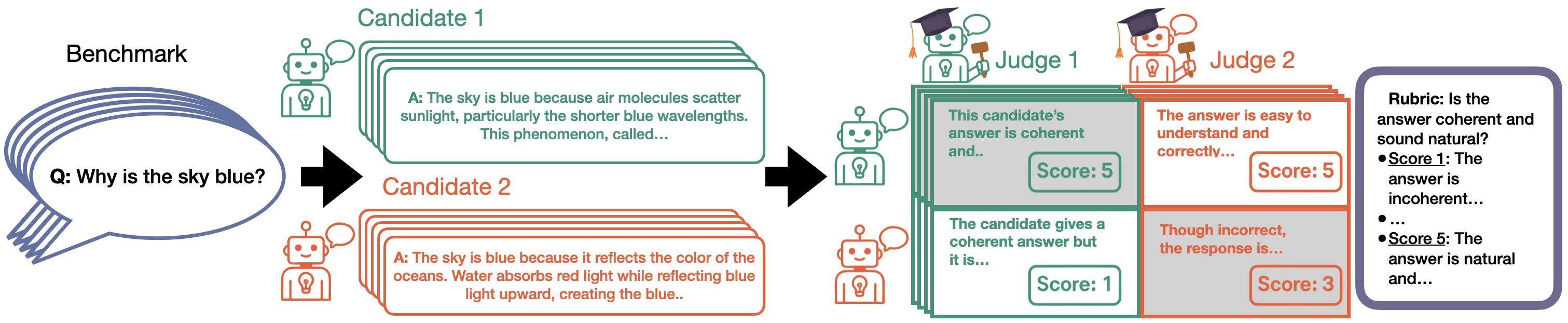

鉴于自动评估大型语言模型(LLMs)自由形式输出的挑战,越来越多的解决方案采用LLMs自身作为评判机制,而不依赖任何标准评分。这种做法隐含地只考虑了采样变异性(随机不确定性),而忽略了评判质量的不确定性(认知不确定性)。本文从几何的角度研究了这一问题,提出将LLM评判者和候选者视为概率单纯形上的点,并利用几何概念来分析排名的可识别性。实验结果表明,基于LLM评判者的排名在许多数据集上是稳健的,但并非在所有情况下都有效,强调了对评判质量建模的重要性。

🔬 方法详解

问题定义:本文旨在解决如何有效评估大型语言模型输出的问题,现有方法仅考虑随机不确定性,未能充分考虑评判者的质量不确定性,导致评估结果的可靠性不足。

核心思路:论文的核心思路是将LLM评判者和候选者视为概率单纯形上的点,通过几何概念分析排名的可识别性,并设计几何贝叶斯先验来编码评判质量的不确定性。

技术框架:整体架构包括将评判者和候选者映射到单纯形,利用几何方法分析排名可识别性,并通过贝叶斯推断处理评判质量的不确定性。主要模块包括数据映射、几何分析和贝叶斯推断。

关键创新:最重要的技术创新在于引入几何视角来分析LLM评判者的有效性,提供了理论基础,证明了在两级评分系统中评判者的效果优于多级评分系统。

关键设计:关键设计包括几何贝叶斯先验的构建,参数设置和敏感性分析,确保模型能够有效捕捉评判者质量的不确定性,并在不同数据集上进行验证。

🖼️ 关键图片

📊 实验亮点

实验结果显示,基于LLM评判者的排名在多个数据集上表现稳健,尤其在两级评分系统中效果显著。该贝叶斯方法的覆盖率达到现有程序的显著提升,强调了建模认知不确定性的重要性。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理中的模型评估、自动评分系统和人机交互等。通过更准确地评估LLMs的输出质量,能够提升自动化系统的可靠性和用户体验,未来可能对教育、客服等行业产生深远影响。

📄 摘要(原文)

Given the challenge of automatically evaluating free-form outputs from large language models (LLMs), an increasingly common solution is to use LLMs themselves as the judging mechanism, without any gold-standard scores. Implicitly, this practice accounts for only sampling variability (aleatoric uncertainty) and ignores uncertainty about judge quality (epistemic uncertainty). While this is justified if judges are perfectly accurate, it is unclear when such an approach is theoretically valid and practically robust. We study these questions for the task of ranking LLM candidates from a novel geometric perspective: for $M$-level scoring systems, both LLM judges and candidates can be represented as points on an $(M-1)$-dimensional probability simplex, where geometric concepts (e.g., triangle areas) correspond to key ranking concepts. This perspective yields intuitive theoretical conditions and visual proofs for when rankings are identifiable; for instance, we provide a formal basis for the ``folk wisdom'' that LLM judges are more effective for two-level scoring ($M=2$) than multi-level scoring ($M>2$). Leveraging the simplex, we design geometric Bayesian priors that encode epistemic uncertainty about judge quality and vary the priors to conduct sensitivity analyses. Experiments on LLM benchmarks show that rankings based solely on LLM judges are robust in many but not all datasets, underscoring both their widespread success and the need for caution. Our Bayesian method achieves substantially higher coverage rates than existing procedures, highlighting the importance of modeling epistemic uncertainty.