EventFlow: Forecasting Temporal Point Processes with Flow Matching

作者: Gavin Kerrigan, Kai Nelson, Padhraic Smyth

分类: cs.LG, stat.ML

发布日期: 2026-04-07

💡 一句话要点

EventFlow:利用Flow Matching进行时序点过程预测,显著降低预测误差。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 时间点过程 事件预测 Flow Matching 非自回归模型 生成模型

📋 核心要点

- 自回归模型在长时序点过程预测中存在级联误差和短视预测问题,导致性能下降。

- EventFlow利用Flow Matching框架,直接学习事件时间的联合分布,避免自回归过程。

- 实验表明,EventFlow在标准TPP基准测试中显著降低了预测误差,且采样效率更高。

📝 摘要(中文)

连续时间事件序列在工业和科学领域普遍存在,事件以不规则的时间间隔发生。目前主流的建模方法是将此类数据视为时间点过程的实现,在机器学习中,通常使用神经网络以自回归方式对时间点过程进行建模。虽然自回归模型在预测单个后续事件的时间方面表现出色,但由于级联误差和短视预测,在预测较长时间范围时,其性能可能会下降。我们提出了EventFlow,一种用于时间点过程的非自回归生成模型。该模型建立在Flow Matching框架之上,直接学习事件时间的联合分布,从而绕过自回归过程。EventFlow易于实现,并且在标准TPP基准测试中,实现了比最接近的基线低20%-53%的预测误差,同时在采样时使用的模型调用次数更少。

🔬 方法详解

问题定义:论文旨在解决时间点过程(Temporal Point Process, TPP)的长时预测问题。现有的自回归模型在预测未来多个事件的时间时,会因为误差累积而导致性能显著下降,并且每次预测都需要调用模型,效率较低。

核心思路:EventFlow的核心思路是放弃传统的自回归建模方式,转而直接学习事件发生时间的联合概率分布。通过Flow Matching技术,将复杂的事件时间分布映射到一个已知的简单分布,从而实现非自回归的生成式预测。这样可以避免误差累积,并允许并行生成多个事件的时间。

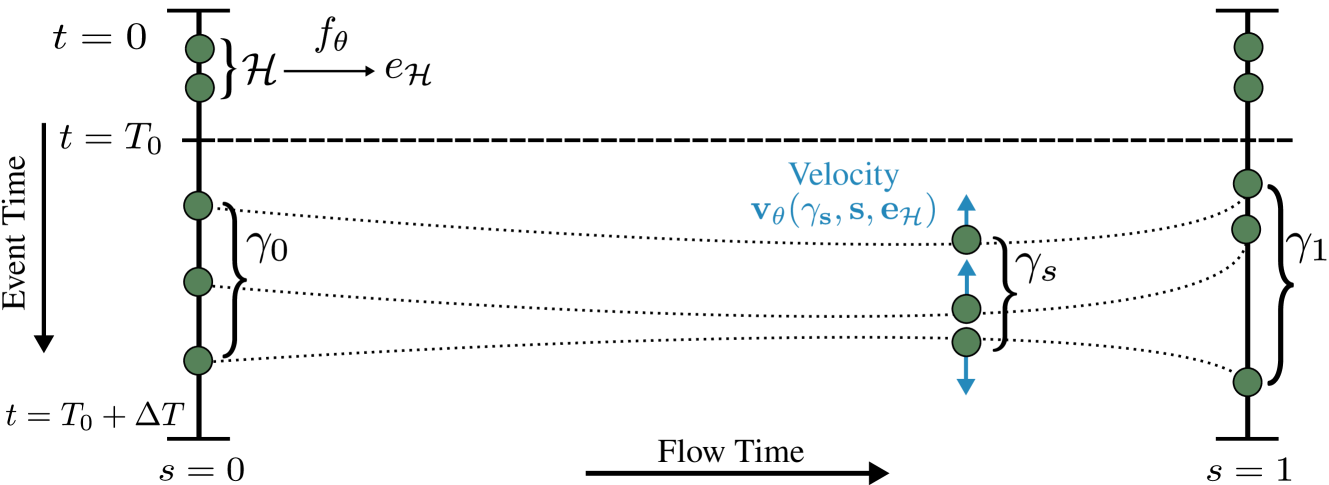

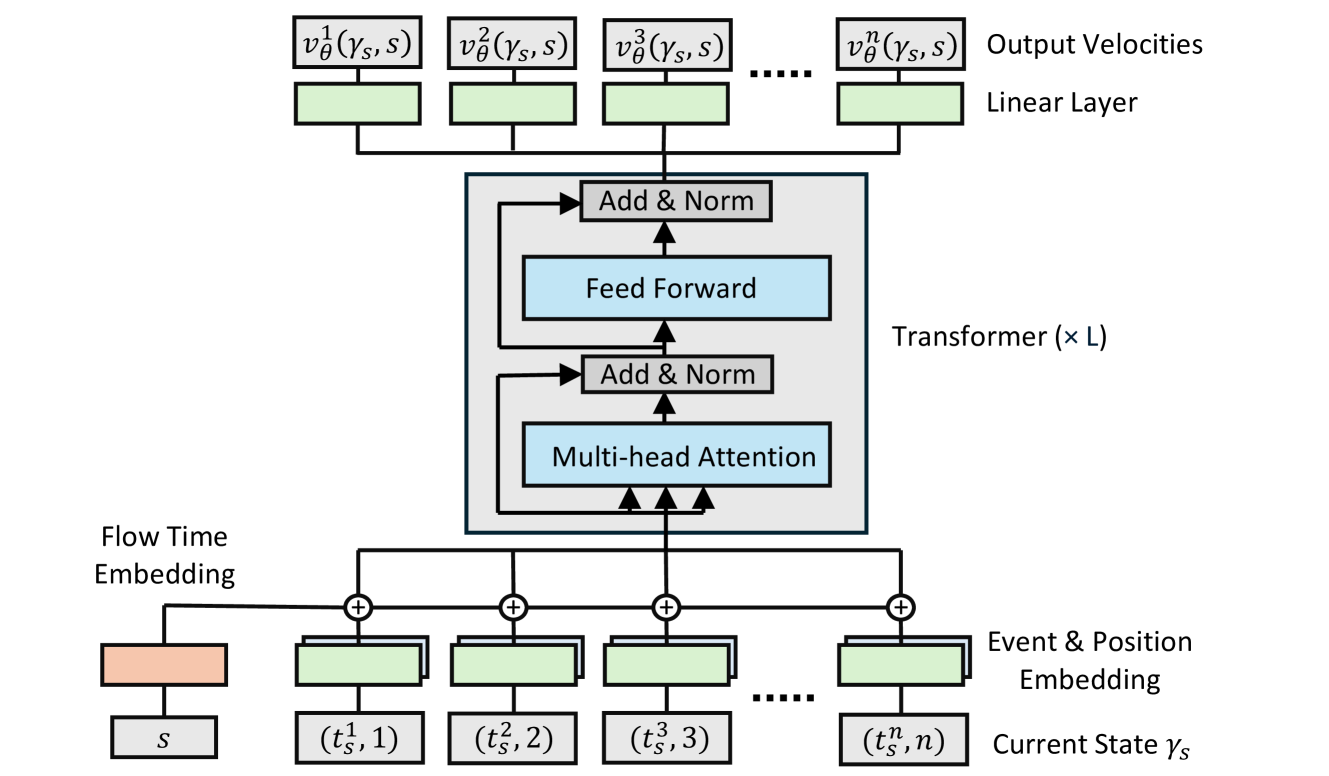

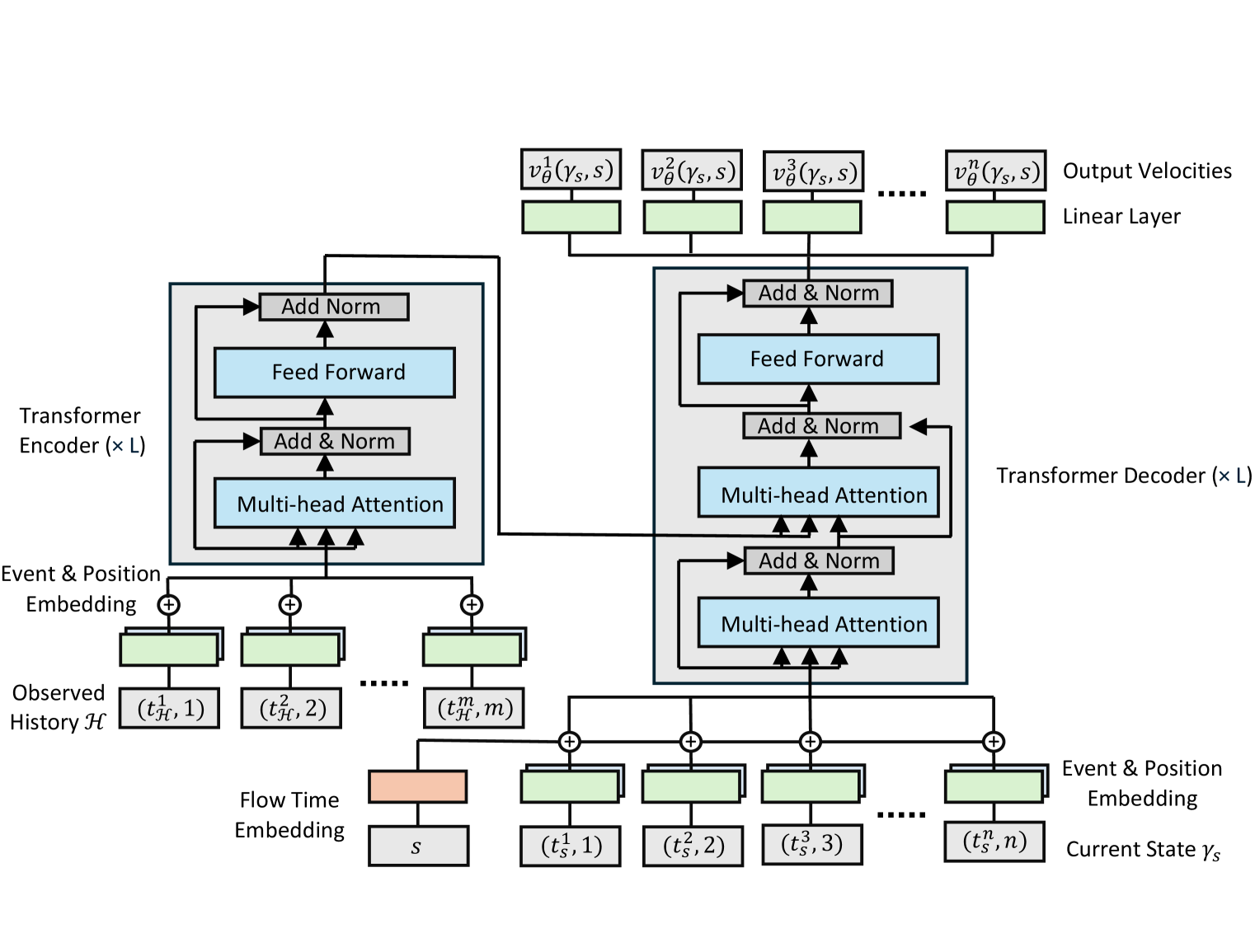

技术框架:EventFlow的整体框架基于Flow Matching。首先,定义一个从简单先验分布(如高斯分布)到目标事件时间分布的连续变换。然后,训练一个神经网络来学习这个变换的向量场。在推理阶段,通过求解一个常微分方程(ODE),将样本从先验分布转换到目标分布,从而生成事件时间序列。主要模块包括:条件向量场网络、ODE求解器和损失函数。

关键创新:EventFlow的关键创新在于使用Flow Matching框架进行时间点过程建模,避免了自回归的依赖关系。与传统的自回归模型相比,EventFlow能够直接学习事件时间的联合分布,从而实现更准确的长时预测。此外,非自回归的特性也使得EventFlow在采样时可以并行生成多个事件,提高了效率。

关键设计:EventFlow的关键设计包括:1) 使用神经网络来参数化条件向量场,该网络接收历史事件信息作为输入,并输出向量场的值;2) 使用ODE求解器(如Runge-Kutta方法)来求解从先验分布到目标分布的变换;3) 使用Flow Matching损失函数来训练神经网络,该损失函数旨在最小化向量场与真实变换之间的差异。具体的网络结构和超参数设置需要根据不同的数据集进行调整。

🖼️ 关键图片

📊 实验亮点

EventFlow在多个标准时间点过程数据集上进行了评估,实验结果表明,EventFlow在预测误差方面显著优于现有的自回归模型。具体而言,EventFlow在某些数据集上实现了20%-53%的预测误差降低。此外,EventFlow在采样时使用的模型调用次数也更少,表明其具有更高的采样效率。

🎯 应用场景

EventFlow可应用于金融交易、医疗健康、社交网络等领域,用于预测事件发生的未来时间。例如,在金融领域,可以预测股票交易的时间和数量;在医疗健康领域,可以预测患者的就诊时间和疾病发作时间;在社交网络领域,可以预测用户的发帖时间和互动行为。该研究有助于提高预测精度,为决策提供更可靠的依据。

📄 摘要(原文)

Continuous-time event sequences, in which events occur at irregular intervals, are ubiquitous across a wide range of industrial and scientific domains. The contemporary modeling paradigm is to treat such data as realizations of a temporal point process, and in machine learning it is common to model temporal point processes in an autoregressive fashion using a neural network. While autoregressive models are successful in predicting the time of a single subsequent event, their performance can degrade when forecasting longer horizons due to cascading errors and myopic predictions. We propose EventFlow, a non-autoregressive generative model for temporal point processes. The model builds on the flow matching framework in order to directly learn joint distributions over event times, side-stepping the autoregressive process. EventFlow is simple to implement and achieves a 20%-53% lower forecast error than the nearest baseline on standard TPP benchmarks while simultaneously using fewer model calls at sampling time.