ROM: Real-time Overthinking Mitigation via Streaming Detection and Intervention

作者: Xinyan Wang, Xiaogeng Liu, Chaowei Xiao

分类: cs.LG, cs.AI, cs.CL

发布日期: 2026-03-23

备注: Code is available at https://github.com/SaFo-Lab/ROM

💡 一句话要点

提出ROM,通过流式检测和干预缓解大型推理模型中的过度思考问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 过度思考 流式检测 实时干预 思维链 推理效率 模型优化

📋 核心要点

- 大型推理模型存在过度思考问题,导致计算成本增加和答案漂移,现有方法难以有效缓解。

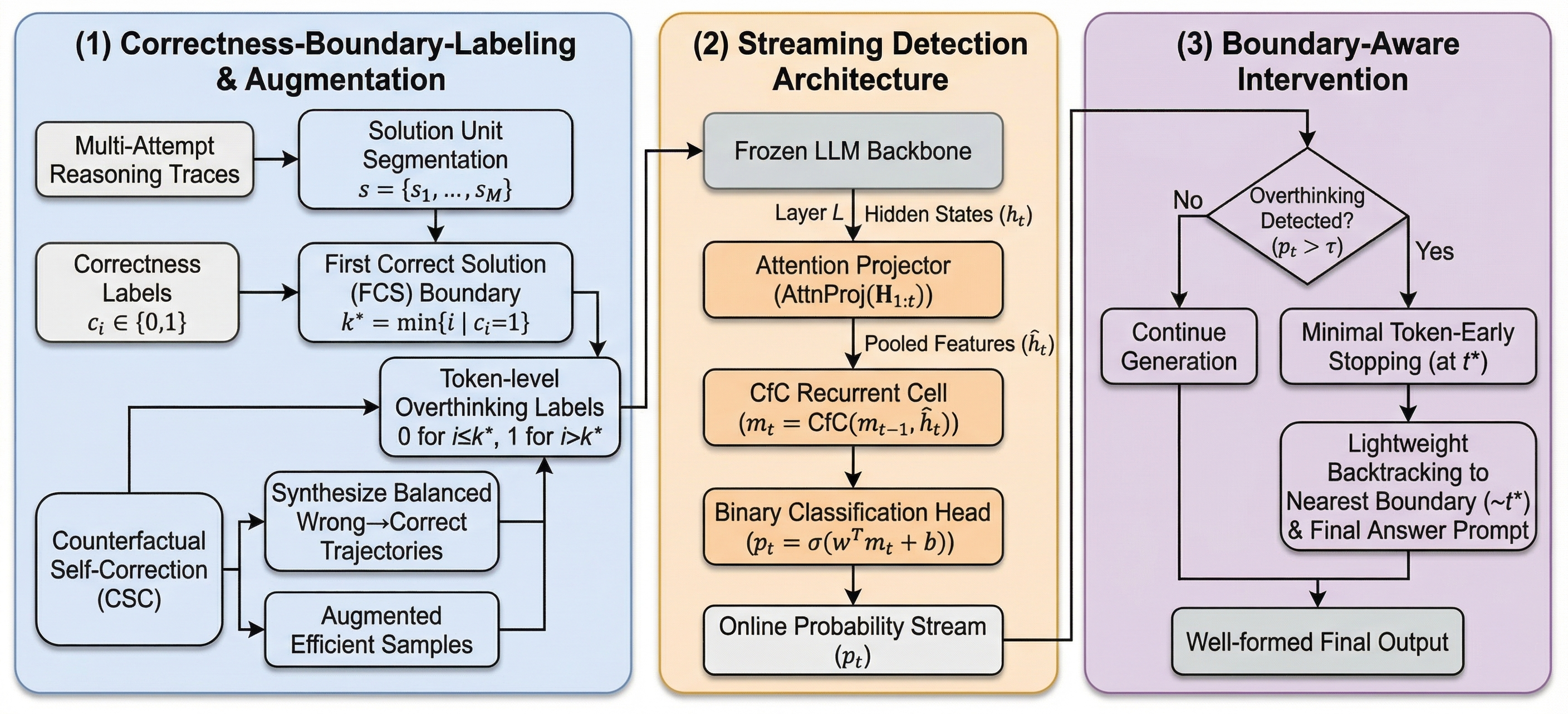

- ROM将过度思考缓解视为流式预测和控制问题,通过轻量级检测头实时监控tokens并提前终止推理。

- 实验结果表明,ROM在多个基准测试中实现了更高的准确率、更短的响应时间和更高的响应效率。

📝 摘要(中文)

大型推理模型(LRMs)通过生成长的思维链(Chain-of-Thought)推理过程,在具有挑战性的任务上实现了很高的准确率,但也存在过度思考的问题。即使在达到正确答案后,它们仍然会继续生成冗余的推理步骤。这种行为增加了延迟和计算成本,并且可能导致答案漂移。现有的缓解方法要么需要大量训练的骨干网络修改,要么依赖于手工设计的启发式方法,这些方法并不能真正捕捉到过度思考的模式。我们提出了ROM,这是第一个将过度思考缓解形式化为流式预测和控制问题的方法。ROM将一个轻量级的检测头连接到冻结的大型语言模型骨干网络的后期隐藏状态。它实时监控tokens,并在检测到过度思考时触发提前过渡到最终答案。我们还引入了基于解决方案正确性边界的token级别监督和一种减少蒸馏数据偏差的数据增强策略。在七个基准测试中,ROM实现了最高的准确率(93.51%),最短的响应(1,159个tokens)和最佳的响应效率。与原始基线相比,它将响应长度减少了47.2%,并将效率提高了121%。这些结果表明,流式检测是一种有希望的实时过度思考缓解方法。

🔬 方法详解

问题定义:论文旨在解决大型推理模型(LRMs)中存在的过度思考问题。即使模型已经得出正确答案,它仍然会继续生成冗余的推理步骤,导致延迟增加、计算成本上升,甚至可能引入错误。现有方法,如需要大量训练的骨干网络修改或手工设计的启发式规则,都无法有效且高效地解决这个问题。

核心思路:ROM的核心思路是将过度思考的缓解过程建模为一个流式预测和控制问题。通过实时监控模型生成的tokens,预测模型是否已经完成有效推理,并在检测到过度思考时,提前终止推理过程,从而减少冗余计算。

技术框架:ROM的技术框架主要包括一个冻结的大型语言模型骨干网络和一个轻量级的检测头。检测头连接到骨干网络的后期隐藏状态,负责实时监控tokens并预测是否需要提前终止推理。整个过程可以看作是一个流式处理过程,其中检测头根据当前的token序列动态地做出决策。

关键创新:ROM的关键创新在于将过度思考缓解问题形式化为流式预测和控制问题,并设计了一个轻量级的检测头来实现实时监控和干预。与现有方法相比,ROM不需要对骨干网络进行大量训练,并且能够更准确地捕捉到过度思考的模式。此外,论文还提出了token级别的监督和数据增强策略,以进一步提高检测头的性能。

关键设计:ROM的关键设计包括:1) 轻量级检测头的设计,使其能够高效地处理流式数据;2) 基于解决方案正确性边界的token级别监督,用于训练检测头;3) 数据增强策略,用于减少蒸馏数据的偏差。具体的损失函数和网络结构等细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

ROM在七个基准测试中取得了显著的性能提升。具体来说,ROM实现了最高的准确率(93.51%),最短的响应(1,159个tokens),以及最佳的响应效率。与原始基线相比,ROM将响应长度减少了47.2%,并将效率提高了121%。这些结果表明,ROM是一种有效的过度思考缓解方法。

🎯 应用场景

ROM具有广泛的应用前景,可以应用于各种需要大型推理模型的场景,例如问答系统、对话系统、代码生成等。通过减少推理过程中的冗余计算,ROM可以显著提高系统的响应速度和效率,降低计算成本,并改善用户体验。此外,ROM还可以用于提高模型的鲁棒性,防止模型在过度思考过程中引入错误。

📄 摘要(原文)

Large Reasoning Models (LRMs) achieve strong accuracy on challenging tasks by generating long Chain-of-Thought traces, but suffer from overthinking. Even after reaching the correct answer, they continue generating redundant reasoning steps. This behavior increases latency and compute cost and can also lead to answer drift. Existing mitigation methods either require training-heavy backbone modification or rely on hand-crafted heuristics that do not truly capture overthinking patterns. We propose ROM, the first method that formulates overthinking mitigation as a streaming prediction-and-control problem. ROM attaches a lightweight detection head to the late-layer hidden states of a frozen large language model backbone. It monitors tokens in real time and triggers an early transition to the final answer once overthinking is detected. We also introduce token-level supervision based on solution correctness boundaries and a data augmentation strategy that reduces distilled-data bias. Across seven benchmarks, ROM achieves the highest accuracy (93.51%), the shortest responses (1,159 tokens), and the best response efficiency. Compared with the vanilla baseline, it reduces response length by 47.2% and improves efficiency by 121%. These results show that streaming detection is a promising approach to real-time overthinking mitigation.