TabKD: Tabular Knowledge Distillation through Interaction Diversity of Learned Feature Bins

作者: Shovon Niverd Pereira, Krishna Khadka, Yu Lei

分类: cs.LG, cs.AI

发布日期: 2026-03-16

💡 一句话要点

TabKD:通过学习特征箱交互多样性的表格知识蒸馏

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 表格数据 知识蒸馏 特征交互 模型压缩 无数据学习

📋 核心要点

- 现有无数据知识蒸馏方法在表格数据上表现不佳,未能有效捕捉表格数据中重要的特征交互。

- TabKD通过学习自适应特征箱并生成合成查询来最大化特征间的交互覆盖,从而实现有效的知识蒸馏。

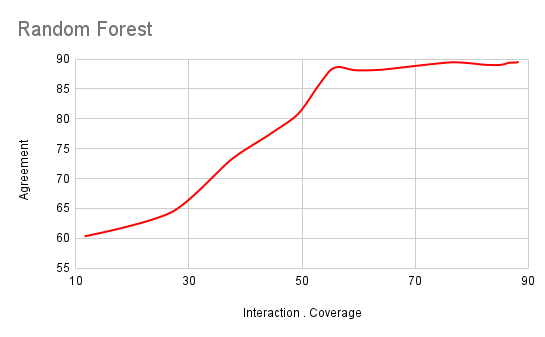

- 实验结果表明,TabKD在多个数据集和模型上优于现有方法,且交互覆盖与蒸馏质量高度相关。

📝 摘要(中文)

本文提出了一种用于表格数据的无数据知识蒸馏方法TabKD,旨在解决现有方法在表格数据上表现不佳的问题,因为现有方法没有明确地解决特征交互这一表格模型编码预测知识的根本方式。TabKD的核心思想是交互多样性,即对特征组合的系统覆盖,这是有效表格蒸馏的关键。TabKD学习与教师模型决策边界对齐的自适应特征箱,然后生成最大化成对交互覆盖的合成查询。在4个基准数据集和4个教师模型架构上,TabKD在16个配置中的14个配置中实现了最高的学生-教师一致性,优于5个最先进的基线方法。进一步证明了交互覆盖与蒸馏质量密切相关,验证了核心假设。这项工作确立了以交互为中心的探索作为表格模型提取的原则性框架。

🔬 方法详解

问题定义:现有的无数据知识蒸馏方法在表格数据上表现不佳,主要原因是它们没有充分考虑表格数据中特征之间的复杂交互关系。表格模型的预测能力很大程度上依赖于对这些交互关系的建模,而现有方法通常忽略了这一点,导致蒸馏效果不佳。

核心思路:TabKD的核心思路是通过最大化特征交互的多样性来提升蒸馏效果。具体来说,它通过学习与教师模型决策边界对齐的自适应特征箱,并生成能够覆盖尽可能多的特征组合的合成查询,从而让学生模型能够学习到教师模型中蕴含的特征交互知识。

技术框架:TabKD的整体框架包括以下几个主要阶段:1) 特征箱学习:学习与教师模型决策边界对齐的自适应特征箱,用于离散化连续特征。2) 合成查询生成:生成合成查询,目标是最大化成对特征交互的覆盖范围。3) 知识蒸馏:使用生成的合成查询作为训练数据,训练学生模型,使其模仿教师模型的预测行为。

关键创新:TabKD的关键创新在于它将特征交互多样性作为表格数据知识蒸馏的核心原则。与现有方法不同,TabKD显式地关注特征之间的交互关系,并通过学习自适应特征箱和生成交互覆盖最大化的合成查询来捕捉这些关系。

关键设计:TabKD的关键设计包括:1) 自适应特征箱:使用梯度信息来调整特征箱的边界,使其与教师模型的决策边界对齐。2) 交互覆盖损失:设计损失函数来鼓励生成的合成查询覆盖尽可能多的成对特征交互。3) 合成数据生成策略:使用基于梯度的优化方法生成合成查询,以最大化交互覆盖损失。

🖼️ 关键图片

📊 实验亮点

TabKD在4个基准数据集和4个教师模型架构上进行了评估,结果表明,TabKD在16个配置中的14个配置中实现了最高的学生-教师一致性,显著优于5个最先进的基线方法。实验还验证了交互覆盖与蒸馏质量之间存在强烈的正相关关系,证明了TabKD的核心假设。

🎯 应用场景

TabKD可应用于各种需要保护隐私的表格数据场景,例如金融风控、医疗诊断等。通过知识蒸馏,可以在不暴露原始数据的情况下,将复杂模型的知识迁移到更小的模型,从而实现模型压缩和加速推理,同时保护用户隐私。未来,该方法可以扩展到更复杂的表格数据结构和更广泛的知识迁移任务。

📄 摘要(原文)

Data-free knowledge distillation enables model compression without original training data, critical for privacy-sensitive tabular domains. However, existing methods does not perform well on tabular data because they do not explicitly address feature interactions, the fundamental way tabular models encode predictive knowledge. We identify interaction diversity, systematic coverage of feature combinations, as an essential requirement for effective tabular distillation. To operationalize this insight, we propose TabKD, which learns adaptive feature bins aligned with teacher decision boundaries, then generates synthetic queries that maximize pairwise interaction coverage. Across 4 benchmark datasets and 4 teacher architectures, TabKD achieves highest student-teacher agreement in 14 out of 16 configurations, outperforming 5 state-of-the-art baselines. We further show that interaction coverage strongly correlates with distillation quality, validating our core hypothesis. Our work establishes interaction-focused exploration as a principled framework for tabular model extraction.