Impermanent: A Live Benchmark for Temporal Generalization in Time Series Forecasting

作者: Azul Garza, Renée Rosillo, Rodrigo Mendoza-Smith, David Salinas, Andrew Robert Williams, Arjun Ashok, Mononito Goswami, José Martín Juárez

分类: cs.LG

发布日期: 2026-03-09

🔗 代码/项目: GITHUB

💡 一句话要点

提出Impermanent基准以解决时间序列预测中的通用性评估问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列预测 动态评估 模型通用性 实时数据流 开源活动 性能稳定性 分布变化

📋 核心要点

- 现有的时间序列预测评估方法多依赖静态训练-测试分割,容易导致模型在测试数据上进行训练,从而影响评估结果的可靠性。

- Impermanent通过实时更新的数据流评估预测模型,关注时间的鲁棒性和性能稳定性,避免了静态测试集的局限性。

- 该基准在GitHub开源活动上实施,构建了动态的时间序列数据集,提供了标准化的评估协议和排行榜,促进了持续的性能比较。

📝 摘要(中文)

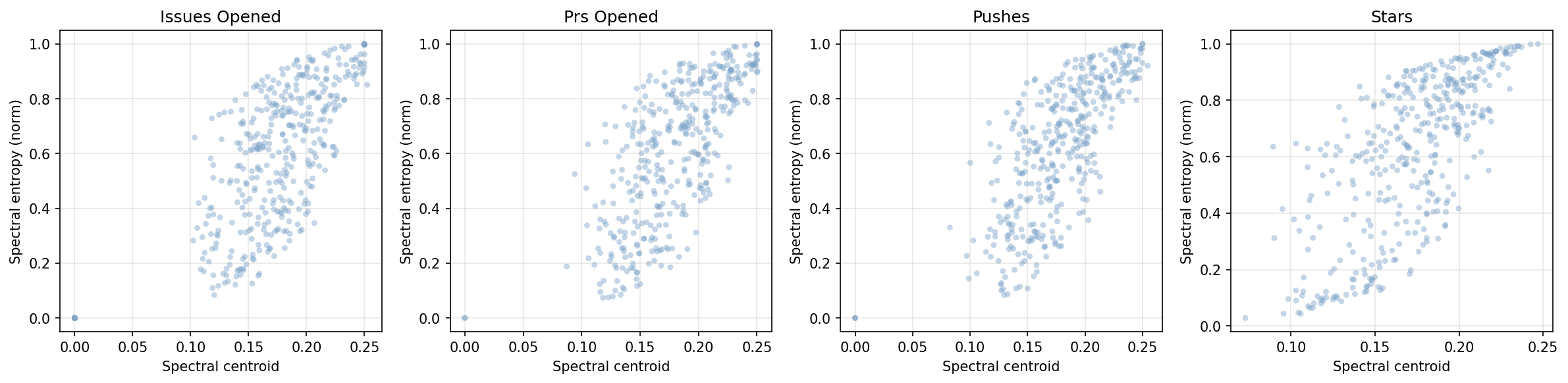

随着时间序列预测领域的进步,越来越多的研究依赖于预训练的基础模型。然而,现有的评估协议提供的证据有限,尤其是静态的训练-测试分割容易导致模型在测试数据上进行训练,从而夸大性能。为此,本文提出了Impermanent,一个实时基准,通过在不断更新的数据流上对预测模型进行评估,研究时间的鲁棒性、分布变化和性能稳定性,而不是仅仅依赖于静态测试集的准确性。Impermanent基于GitHub的开源活动构建,提供了一个自然的、非平稳的数据集,涵盖了多个动态因素。我们聚焦于前400个最受欢迎的代码库,构建了基于问题、拉取请求、推送事件和新星标的时间序列,并通过滚动窗口进行评估,提供了标准化的协议和排行榜以实现可重复的比较。

🔬 方法详解

问题定义:本文旨在解决时间序列预测中现有评估方法的不足,特别是静态训练-测试分割导致的模型性能夸大问题。

核心思路:提出Impermanent基准,通过实时更新的数据流对预测模型进行评估,关注模型在动态环境下的鲁棒性和稳定性。

技术框架:Impermanent的整体架构包括数据收集、时间序列构建、实时评估和结果展示四个主要模块。数据收集基于GitHub开源活动,时间序列由多个动态因素构成,评估则通过滚动窗口进行。

关键创新:Impermanent的核心创新在于将评估从静态准确性转向持续性能,能够更真实地反映模型在实际应用中的表现。

关键设计:在设计中,采用了标准化的评估协议和排行榜,确保了结果的可重复性和可比性,同时通过每日更新的数据流来保持评估的实时性。

🖼️ 关键图片

📊 实验亮点

Impermanent基准通过实时数据流评估模型,显著提高了时间序列预测的评估可靠性。与传统静态评估方法相比,模型在动态环境中的性能稳定性得到了更好的体现,推动了对基础模型通用性的深入理解。

🎯 应用场景

该研究的潜在应用领域包括金融市场预测、气候变化分析和供应链管理等动态环境中的时间序列预测。通过提供更可靠的评估机制,Impermanent能够帮助研究人员和从业者更好地理解模型的实际表现,推动时间序列预测技术的进步。

📄 摘要(原文)

Recent advances in time-series forecasting increasingly rely on pre-trained foundation-style models. While these models often claim broad generalization, existing evaluation protocols provide limited evidence. Indeed, most current benchmarks use static train-test splits that can easily lead to contamination as foundation models can inadvertently train on test data or perform model selection using test scores, which can inflate performance. We introduce Impermanent, a live benchmark that evaluates forecasting models under open-world temporal change by scoring forecasts sequentially over time on continuously updated data streams, enabling the study of temporal robustness, distributional shift, and performance stability rather than one-off accuracy on a frozen test set. Impermanent is instantiated on GitHub open-source activity, providing a naturally live and highly non-stationary dataset shaped by releases, shifting contributor behavior, platform/tooling changes, and external events. We focus on the top 400 repositories by star count and construct time series from issues opened, pull requests opened, push events, and new stargazers, evaluated over a rolling window with daily updates, alongside standardized protocols and leaderboards for reproducible, ongoing comparison. By shifting evaluation from static accuracy to sustained performance, Impermanent takes a concrete step toward assessing when and whether foundation-level generalization in time-series forecasting can be meaningfully claimed. Code and a live dashboard are available at https://github.com/TimeCopilot/impermanent and https://impermanent.timecopilot.dev.