VaSST: Variational Inference for Symbolic Regression using Soft Symbolic Trees

作者: Somjit Roy, Pritam Dey, Bani K. Mallick

分类: stat.ME, cs.LG, cs.SC, stat.CO, stat.ML

发布日期: 2026-02-27

备注: 38 pages, 5 figures, 35 tables, Submitted

💡 一句话要点

VaSST:基于变分推断和软符号树的符号回归方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 符号回归 变分推断 软符号树 概率模型 不确定性量化

📋 核心要点

- 现有符号回归方法依赖启发式搜索或数据密集型方法,缺乏不确定性量化,难以有效探索复杂的符号空间。

- VaSST通过引入软符号树,将离散的符号表达式树进行连续松弛,从而将组合搜索转化为梯度优化问题。

- 实验表明,VaSST在结构恢复和预测精度上优于现有方法,并在模拟和真实数据集上验证了其有效性。

📝 摘要(中文)

符号回归在人工智能驱动的科学发现中日益受到关注,其目标是从数据中恢复显式的闭合形式表达式,从而揭示潜在的物理定律。尽管最近取得了进展,但现有方法仍然主要依赖于启发式搜索算法或数据密集型方法,这些方法假设低噪声环境并且缺乏可靠的不确定性量化。完全概率形式的符号回归方法很少,并且现有的基于马尔可夫链蒙特卡罗的贝叶斯方法通常难以有效地探索符号表达式的高度多模态组合空间。我们提出了VaSST,一个基于变分推断的可扩展概率符号回归框架。VaSST采用符号表达式树的连续松弛,称为软符号树,其中离散的运算符和特征分配被允许组件上的软分布所取代。这种松弛将对天文数字般庞大的符号空间的组合搜索转化为有效的基于梯度的优化问题,同时保留了连贯的概率解释。学习到的软表示诱导了符号结构的后验分布,从而实现了可靠的不确定性量化。在模拟实验和SRBench中的Feynman符号回归数据库上,VaSST在结构恢复和预测精度方面均优于最先进的符号回归方法。

🔬 方法详解

问题定义:符号回归旨在从数据中自动发现数学表达式,揭示隐藏的物理规律。现有方法,如遗传算法或深度学习方法,通常是启发式的,难以保证找到全局最优解,且缺乏对结果不确定性的量化。此外,这些方法在高噪声或复杂表达式的情况下表现不佳,计算成本也很高。

核心思路:VaSST的核心思路是将离散的符号表达式树进行连续松弛,用“软符号树”代替。具体来说,将运算符和变量的选择从硬选择变为概率分布,从而将离散搜索问题转化为连续优化问题。通过变分推断学习这些概率分布,从而得到表达式的后验分布,实现不确定性量化。

技术框架:VaSST框架包含以下几个主要步骤:1) 构建软符号树:将传统的符号表达式树中的节点(运算符和变量)替换为概率分布。2) 变分推断:使用变分推断方法学习软符号树中每个节点的概率分布,目标是最小化变分自由能。3) 表达式采样与评估:从学习到的概率分布中采样多个表达式,并根据其拟合数据的程度进行评估。4) 模型选择:选择最优的表达式作为最终结果,并提供不确定性估计。

关键创新:VaSST的关键创新在于将符号回归问题转化为一个连续优化问题,从而可以使用基于梯度的优化方法进行求解。这种方法避免了传统方法的启发式搜索,提高了效率和准确性。此外,VaSST通过变分推断学习表达式的后验分布,实现了对结果不确定性的量化,这在科学发现中至关重要。

关键设计:VaSST使用变分自编码器(VAE)的框架进行训练。编码器将数据映射到软符号树的参数(即每个节点的概率分布),解码器则根据这些参数生成表达式。损失函数包括重构损失(衡量表达式拟合数据的程度)和KL散度(衡量软符号树的分布与先验分布的差异)。为了提高效率,VaSST还采用了剪枝策略,去除概率较低的节点。

🖼️ 关键图片

📊 实验亮点

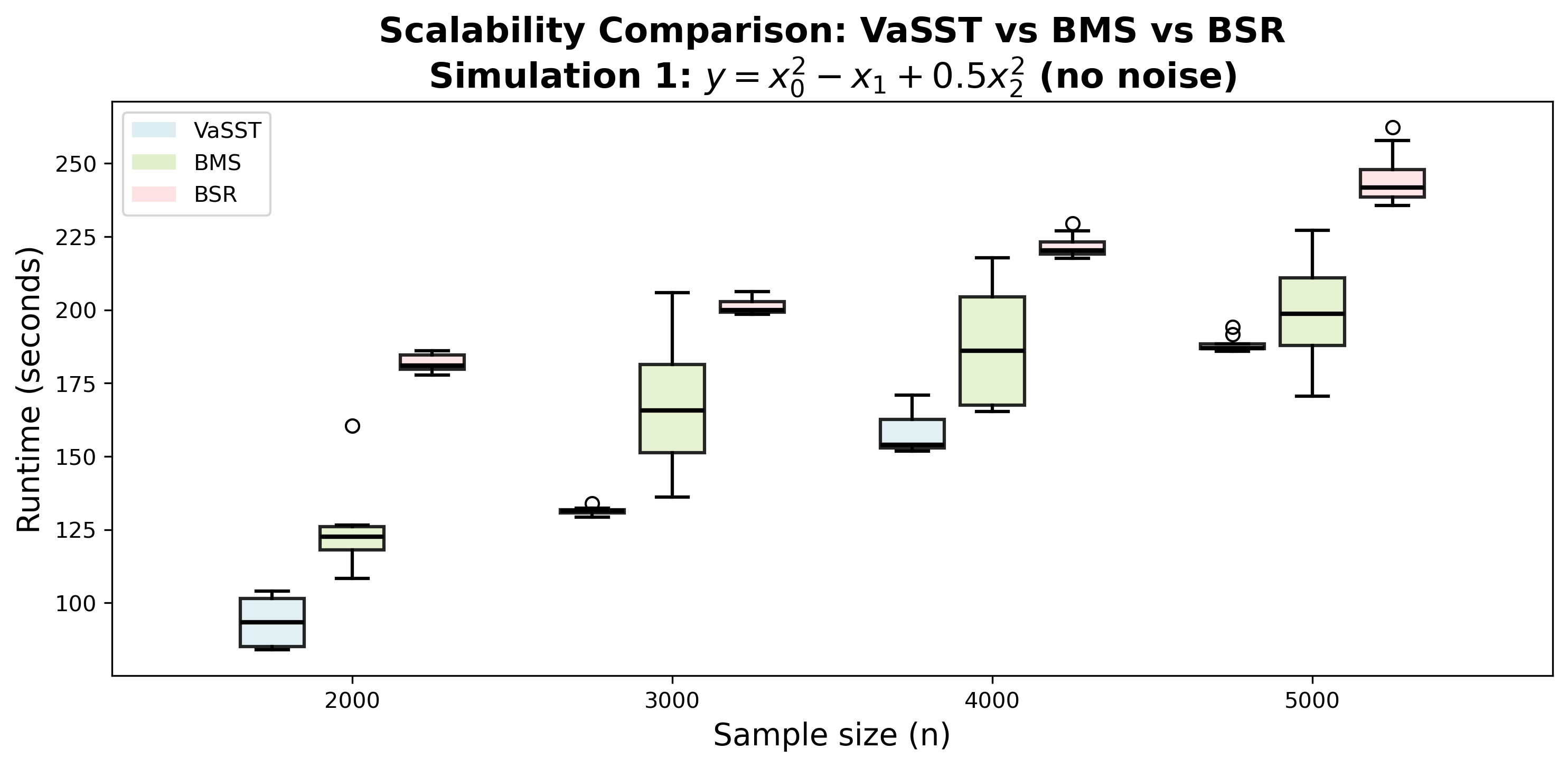

VaSST在模拟实验和Feynman符号回归数据库上取得了显著成果。在结构恢复方面,VaSST能够更准确地识别正确的表达式结构。在预测精度方面,VaSST优于现有的符号回归方法,例如EQL、GOGSYM和Operon。具体来说,VaSST在SRBench的Feynman数据库上取得了state-of-the-art的结果,表明其在复杂符号回归问题上的优越性。

🎯 应用场景

VaSST可应用于多个科学和工程领域,例如物理学、化学、生物学和金融学。它可以帮助科学家自动发现隐藏在数据中的物理定律、化学反应机制或金融模型。此外,VaSST提供的不确定性量化功能可以帮助用户评估发现结果的可靠性,并指导进一步的实验设计。未来,VaSST可以扩展到处理更复杂的数据类型,例如时间序列数据和图像数据。

📄 摘要(原文)

Symbolic regression has recently gained traction in AI-driven scientific discovery, aiming to recover explicit closed-form expressions from data that reveal underlying physical laws. Despite recent advances, existing methods remain dominated by heuristic search algorithms or data-intensive approaches that assume low-noise regimes and lack principled uncertainty quantification. Fully probabilistic formulations are scarce, and existing Markov chain Monte Carlo-based Bayesian methods often struggle to efficiently explore the highly multimodal combinatorial space of symbolic expressions. We introduce VaSST, a scalable probabilistic framework for symbolic regression based on variational inference. VaSST employs a continuous relaxation of symbolic expression trees, termed soft symbolic trees, where discrete operator and feature assignments are replaced by soft distributions over allowable components. This relaxation transforms the combinatorial search over an astronomically large symbolic space into an efficient gradient-based optimization problem while preserving a coherent probabilistic interpretation. The learned soft representations induce posterior distributions over symbolic structures, enabling principled uncertainty quantification. Across simulated experiments and Feynman Symbolic Regression Database within SRBench, VaSST achieves superior performance in both structural recovery and predictive accuracy compared to state-of-the-art symbolic regression methods.