RobPI: Robust Private Inference against Malicious Client

作者: Jiaqi Xue, Mengxin Zheng, Qian Lou

分类: cs.CR, cs.LG

发布日期: 2026-02-23

备注: Accepted by SaTML 2026

💡 一句话要点

RobPI:提出针对恶意客户端的鲁棒私有推理协议

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 私有推理 恶意客户端 安全计算 密码协议 鲁棒性

📋 核心要点

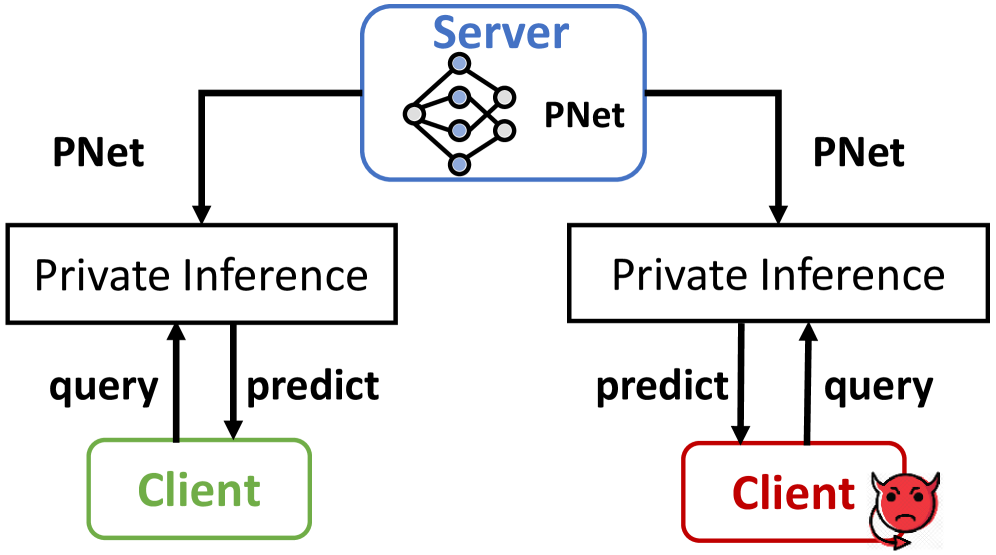

- 现有私有推理协议通常假设半诚实模型,忽略了恶意客户端可能发起的攻击,存在安全隐患。

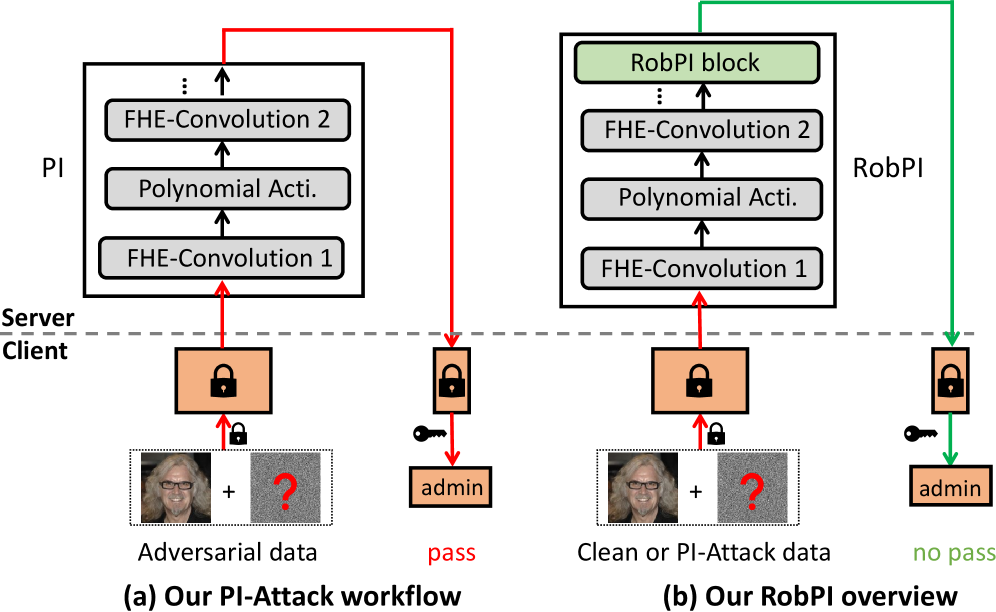

- RobPI通过在推理过程中引入与加密兼容的噪声,有效防御恶意客户端对模型输出的操纵攻击。

- 实验表明,RobPI显著降低了攻击成功率,并大幅增加了恶意攻击所需的查询次数,提升了安全性。

📝 摘要(中文)

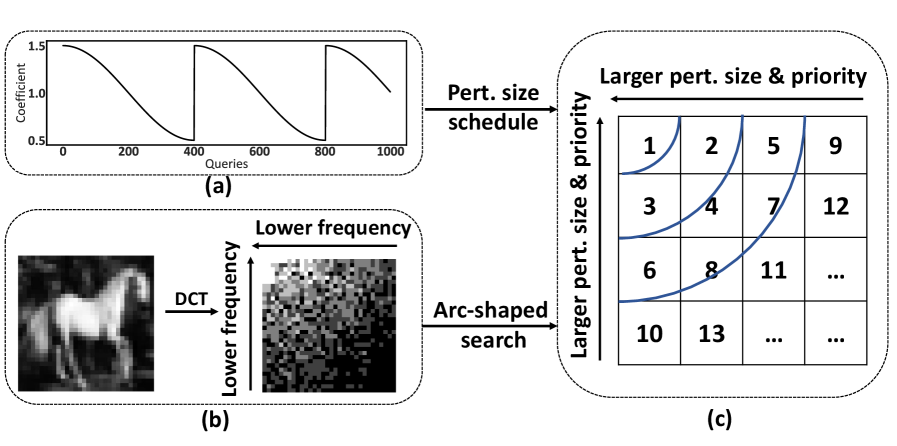

机器学习推理在各种应用中的日益普及引发了隐私问题。为了解决这个问题,私有推理(PI)协议应运而生,它允许各方在不泄露敏感数据的情况下执行推理。尽管PI的效率最近有所提高,但目前大多数方法都假设一个半诚实威胁模型,即数据所有者是诚实的并遵守协议。然而,在现实中,数据所有者可能有不同的动机,并以不可预测的方式行事,这使得这种假设不切实际。为了展示恶意客户端如何破坏半诚实模型,我们首先设计了一种针对一系列最先进的私有推理协议的推理操纵攻击。这种攻击允许恶意客户端以比当前黑盒攻击少3到8倍的查询来修改模型输出。受这些攻击的启发,我们提出并实现了RobPI,一种能够抵御恶意客户端的鲁棒且有弹性的私有推理协议。RobPI集成了一种独特的密码协议,通过将与加密兼容的噪声编织到私有推理的logits和特征中来增强安全性,从而有效地抵御恶意客户端攻击。我们在各种神经网络和数据集上的大量实验表明,RobPI实现了约91.9%的攻击成功率降低,并使恶意客户端攻击所需的查询数量增加了10倍以上。

🔬 方法详解

问题定义:现有的私有推理协议大多基于半诚实模型,即假设数据拥有者(客户端)是诚实的,会遵守协议。然而,在实际应用中,客户端可能出于各种目的而恶意篡改输入或利用协议漏洞来影响推理结果,从而破坏隐私和安全性。现有方法缺乏对恶意客户端攻击的有效防御机制。

核心思路:RobPI的核心思路是在私有推理过程中引入与加密兼容的噪声。通过在logits和特征中注入噪声,可以有效地模糊恶意客户端的攻击尝试,使其难以精确地操纵模型输出。这种噪声的设计需要与底层加密协议兼容,以便在保证安全性的同时,尽可能减少对推理精度的影响。

技术框架:RobPI的整体框架包括以下几个主要阶段:1)客户端输入加密;2)服务器端安全计算,包括特征提取和模型推理,并在logits和特征中注入噪声;3)客户端解密并获得推理结果。关键模块包括噪声生成器、加密模块和安全计算模块。整个流程旨在确保即使客户端是恶意的,也无法有效地操纵推理结果。

关键创新:RobPI最重要的创新点在于其独特的密码协议,该协议能够将与加密兼容的噪声有效地融入到私有推理过程中。这种噪声不仅能够抵御恶意客户端的攻击,而且对推理精度的影响相对较小。此外,RobPI的设计充分考虑了效率,能够在保证安全性的前提下,实现较高的推理速度。

关键设计:RobPI的关键设计包括:1)噪声生成器的设计,需要保证噪声的随机性和与加密协议的兼容性;2)噪声注入的位置和强度,需要在安全性和精度之间进行权衡;3)加密算法的选择,需要保证安全性和计算效率;4)协议的参数设置,例如密钥长度、噪声方差等,需要根据具体的应用场景进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RobPI能够有效防御恶意客户端的攻击,将攻击成功率降低约91.9%,并使恶意客户端攻击所需的查询数量增加10倍以上。与现有的私有推理协议相比,RobPI在安全性方面具有显著优势,同时保持了较高的推理效率。这些结果表明,RobPI是一种实用且有效的鲁棒私有推理解决方案。

🎯 应用场景

RobPI适用于各种需要保护用户数据隐私的机器学习推理场景,例如医疗诊断、金融风控、身份验证等。通过使用RobPI,可以在不泄露用户敏感数据的前提下,安全地利用机器学习模型进行推理,从而促进人工智能技术在隐私敏感领域的应用。未来,RobPI可以进一步扩展到更复杂的模型和更广泛的应用场景,例如联邦学习和安全多方计算。

📄 摘要(原文)

The increased deployment of machine learning inference in various applications has sparked privacy concerns. In response, private inference (PI) protocols have been created to allow parties to perform inference without revealing their sensitive data. Despite recent advances in the efficiency of PI, most current methods assume a semi-honest threat model where the data owner is honest and adheres to the protocol. However, in reality, data owners can have different motivations and act in unpredictable ways, making this assumption unrealistic. To demonstrate how a malicious client can compromise the semi-honest model, we first designed an inference manipulation attack against a range of state-of-the-art private inference protocols. This attack allows a malicious client to modify the model output with 3x to 8x fewer queries than current black-box attacks. Motivated by the attacks, we proposed and implemented RobPI, a robust and resilient private inference protocol that withstands malicious clients. RobPI integrates a distinctive cryptographic protocol that bolsters security by weaving encryption-compatible noise into the logits and features of private inference, thereby efficiently warding off malicious-client attacks. Our extensive experiments on various neural networks and datasets show that RobPI achieves ~91.9% attack success rate reduction and increases more than 10x the number of queries required by malicious-client attacks.