Workflow-Level Design Principles for Trustworthy GenAI in Automotive System Engineering

作者: Chih-Hong Cheng, Brian Hsuan-Cheng Liao, Adam Molin, Hasan Esen

分类: cs.SE, cs.LG

发布日期: 2026-02-23

💡 一句话要点

提出面向汽车系统工程的GenAI可信工作流设计原则,提升安全性和可追溯性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: GenAI 汽车系统工程 安全关键系统 需求工程 SysML v2 可信AI 回归测试

📋 核心要点

- 现有方法在处理大型、复杂的汽车系统需求变更时,采用“大爆炸”式提示,容易遗漏关键信息,导致系统更新不完整。

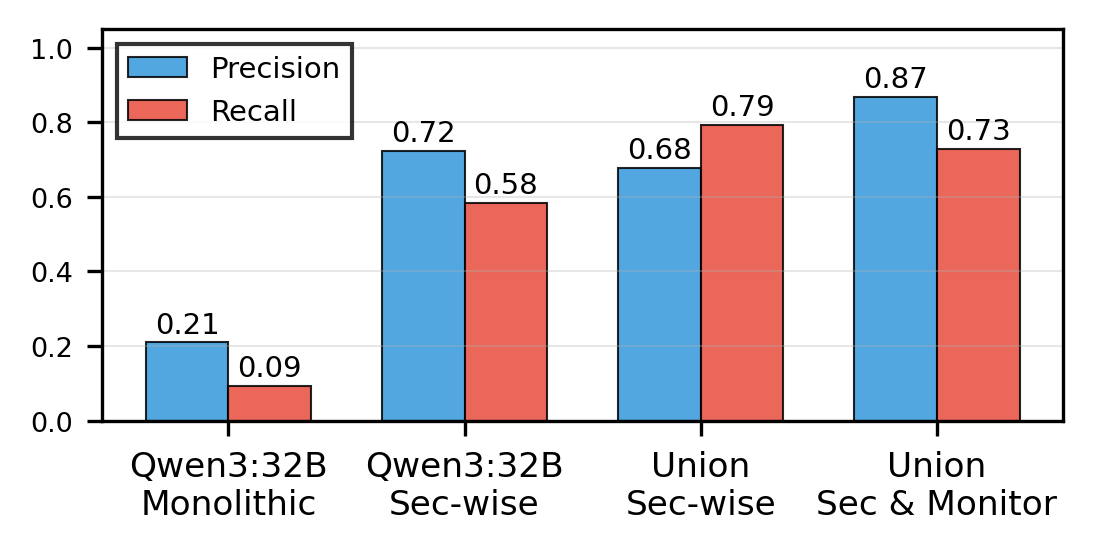

- 论文提出分段分解需求,结合多样性抽样和轻量级NLP健全性检查,提高需求变更识别的完整性和正确性,确保信息无遗漏。

- 通过将需求变更传播到SysML v2模型,并生成可追溯的测试用例,实现了对GenAI更新的验证,提升了汽车系统的安全性和可靠性。

📝 摘要(中文)

大型语言模型在安全关键系统工程中的应用受到可信度、可追溯性以及与现有验证实践一致性的限制。本文提出了面向可信GenAI集成的工作流级设计原则,并在端到端的汽车流水线中进行了演示,涵盖需求增量识别、SysML v2架构更新和重新测试。首先,研究表明,单体式(“大爆炸”)提示会遗漏大型规范中的关键变更,而采用多样性抽样和轻量级NLP健全性检查的分段分解可以提高完整性和正确性。然后,将需求增量传播到SysML v2模型中,并通过编译和静态分析来验证更新。此外,通过建立规范变量到架构端口和状态的显式映射来生成测试用例,从而确保可追溯的回归测试,为在安全关键型汽车工程中使用的GenAI提供实用的保障。

🔬 方法详解

问题定义:在汽车系统工程中,安全关键系统的开发需要严格的需求管理和验证。然而,将大型语言模型(LLM)应用于此领域面临挑战,特别是如何确保LLM生成结果的可信度、可追溯性以及与现有验证流程的兼容性。现有方法,例如直接使用LLM处理整个需求文档(“大爆炸”式提示),容易忽略细微但重要的需求变更,导致系统更新不完整,存在安全隐患。

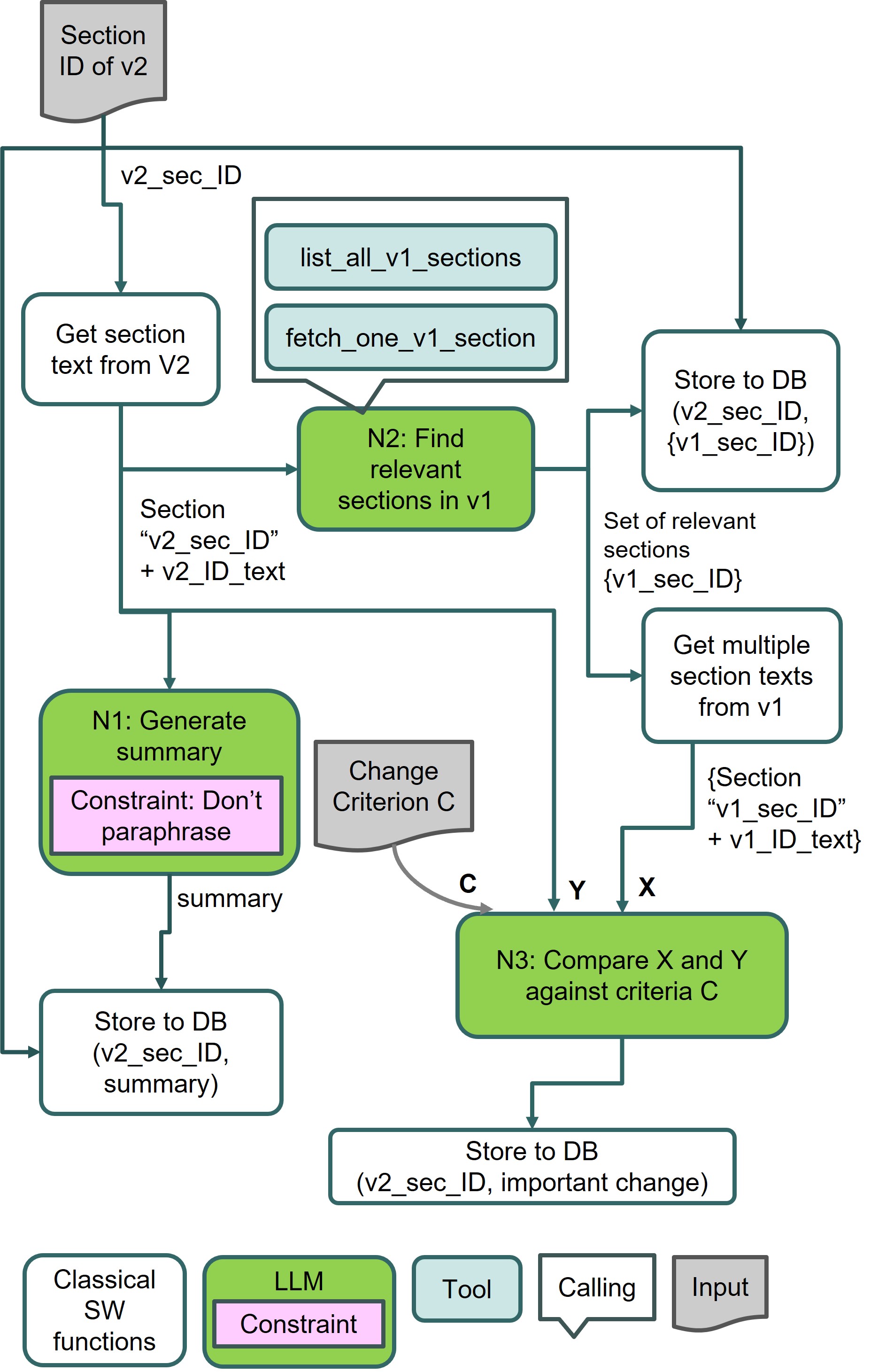

核心思路:本文的核心思路是将复杂的需求变更处理流程分解为多个可控的步骤,并引入多样性抽样和轻量级NLP健全性检查来提高LLM处理的准确性和完整性。通过建立需求变量与架构端口和状态之间的显式映射,实现测试用例的可追溯性,从而验证LLM的输出,确保系统更新的正确性。

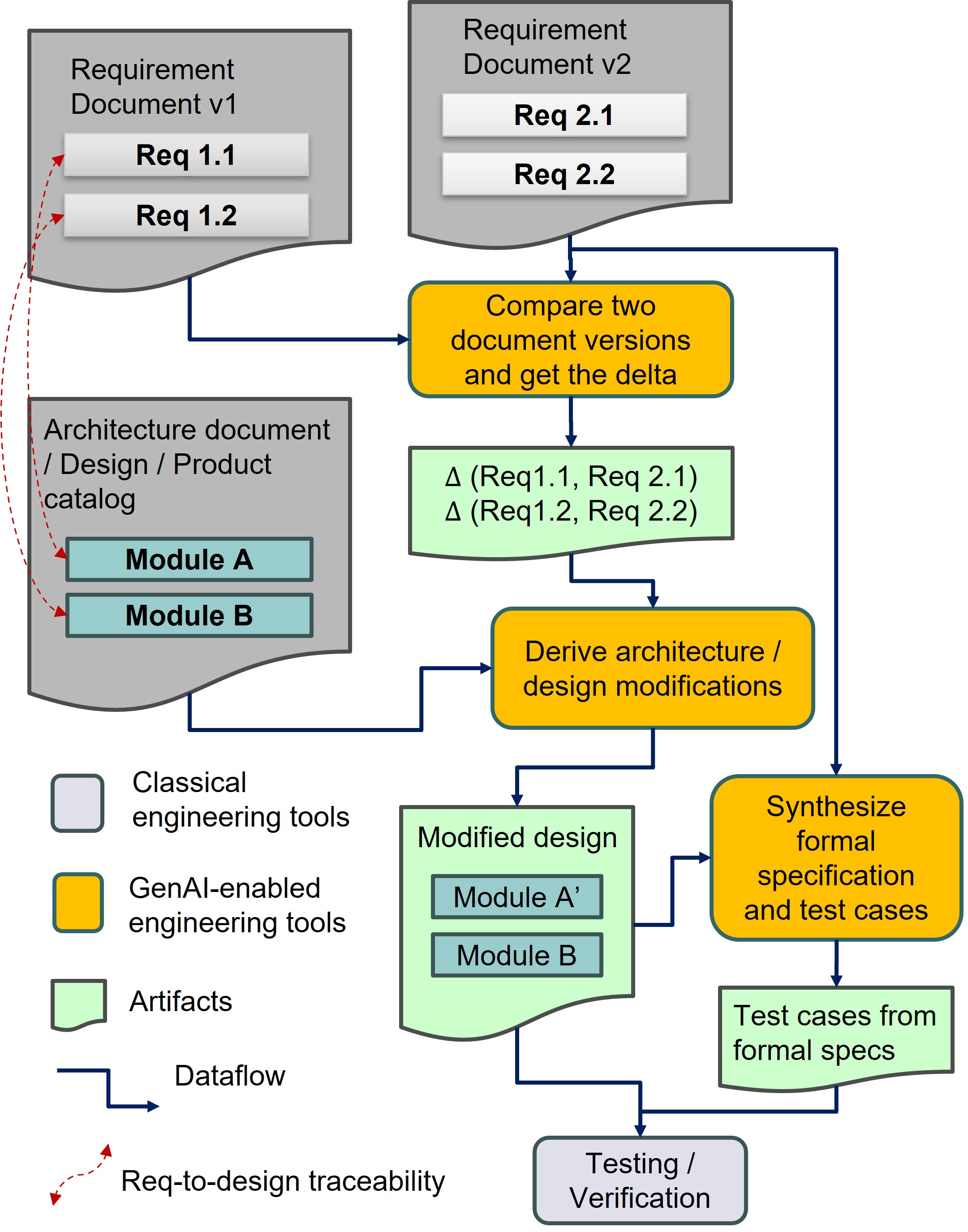

技术框架:该方法包含以下主要阶段:1) 需求增量识别:将大型需求文档分解为多个部分,并使用多样性抽样和NLP健全性检查来识别需求变更。2) SysML v2模型更新:将识别出的需求变更传播到SysML v2模型中,并进行编译和静态分析以验证更新。3) 可追溯的回归测试:通过建立需求变量与架构端口和状态之间的显式映射来生成测试用例,并执行回归测试以验证系统更新的正确性。

关键创新:该方法的主要创新在于工作流级别的设计原则,它不是简单地将LLM作为一个黑盒工具使用,而是将其集成到现有的汽车系统工程流程中,并引入了多样性抽样、NLP健全性检查和可追溯的测试用例生成等机制,从而提高了LLM在安全关键系统工程中的可信度和可靠性。与现有方法相比,该方法更加注重流程的控制和验证,从而降低了LLM引入的风险。

关键设计:在需求增量识别阶段,使用了多样性抽样来探索不同的LLM输出,并使用轻量级NLP健全性检查来过滤掉不合理的输出。在SysML v2模型更新阶段,使用了编译和静态分析来验证模型更新的正确性。在可追溯的回归测试阶段,通过建立需求变量与架构端口和状态之间的显式映射来生成测试用例,确保每个测试用例都与特定的需求相关联。

🖼️ 关键图片

📊 实验亮点

论文验证了分段分解和多样性抽样策略在需求变更识别中的有效性,显著提高了LLM处理大型规范的完整性和正确性。通过将需求变更传播到SysML v2模型并生成可追溯的测试用例,实现了对GenAI更新的验证,为安全关键系统工程中GenAI的应用提供了实际保障。

🎯 应用场景

该研究成果可应用于汽车电子、航空航天等安全关键系统的开发过程中,帮助工程师更安全、高效地利用GenAI技术进行需求分析、系统建模和测试验证。通过提高GenAI的可信度和可追溯性,降低安全风险,加速产品开发周期,并为未来智能化汽车系统的设计和验证奠定基础。

📄 摘要(原文)

The adoption of large language models in safety-critical system engineering is constrained by trustworthiness, traceability, and alignment with established verification practices. We propose workflow-level design principles for trustworthy GenAI integration and demonstrate them in an end-to-end automotive pipeline, from requirement delta identification to SysML v2 architecture update and re-testing. First, we show that monolithic ("big-bang") prompting misses critical changes in large specifications, while section-wise decomposition with diversity sampling and lightweight NLP sanity checks improves completeness and correctness. Then, we propagate requirement deltas into SysML v2 models and validate updates via compilation and static analysis. Additionally, we ensure traceable regression testing by generating test cases through explicit mappings from specification variables to architectural ports and states, providing practical safeguards for GenAI used in safety-critical automotive engineering.