RAmmStein: Regime Adaptation in Mean-reverting Markets with Stein Thresholds -- Optimal Impulse Control in Concentrated AMMs

作者: Pranay Anchuri

分类: cs.LG, q-fin.TR

发布日期: 2026-02-23

备注: 12 pages, 1 figure, 4 tables, 1 algorithm; submitted to Designing DeFi workshop (https://www.designingdefi.xyz/)

💡 一句话要点

RAmmStein:基于Stein阈值和均值回复的集中式AMM机制自适应

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation)

关键词: 集中流动性 自动做市商 深度强化学习 最优控制 均值回复

📋 核心要点

- 现有流动性管理策略未能充分考虑市场动态,导致再平衡成本高昂,收益受损。

- RAmmStein将流动性管理建模为最优控制问题,利用深度强化学习学习最优再平衡策略。

- 实验表明,RAmmStein在降低再平衡频率的同时,显著提高了净投资回报率。

📝 摘要(中文)

本文研究了去中心化交易所中集中流动性提供所面临的基本脉冲控制问题。流动性提供者(LP)需要在通过收紧价格范围集中来最大化费用收入,和最小化包括gas费用和交易滑点在内的再平衡摩擦成本之间做出权衡。现有方法通常采用启发式或阈值策略,未能充分考虑市场动态。本文将流动性管理建模为最优控制问题,并推导出相应的Hamilton-Jacobi-Bellman拟变分不等式(HJB-QVI)。我们提出了一种近似解RAmmStein,这是一种深度强化学习方法,它将Ornstein-Uhlenbeck过程的均值回复速度(theta)以及其他特征作为模型的输入。我们证明了该智能体学会将状态空间划分为行动区域和非行动区域。我们使用包含超过680万笔交易的高频1Hz Coinbase交易数据评估了该框架。实验结果表明,与被动和激进策略相比,RAmmStein实现了0.72%的卓越净投资回报率。值得注意的是,该智能体将再平衡频率降低了67%,同时保持了88%的活跃时间。我们的结果表明,具有机制意识的“懒惰”可以通过保留原本会被运营成本侵蚀的回报来显着提高资本效率。

🔬 方法详解

问题定义:本文旨在解决集中式自动做市商(AMM)中流动性提供者(LP)面临的流动性管理问题。LP需要在最大化交易费用收入和最小化再平衡成本(如gas费和滑点)之间进行权衡。现有的方法,例如启发式或阈值策略,通常无法充分捕捉市场动态,导致次优的再平衡决策和潜在的利润损失。

核心思路:RAmmStein的核心思路是将流动性管理问题建模为一个最优控制问题,并利用深度强化学习(DRL)来寻找最优的再平衡策略。通过学习市场动态和交易成本,智能体可以学会何时以及如何进行再平衡,从而最大化净投资回报率。该方法特别关注市场的均值回复特性,并将其作为重要的输入特征。

技术框架:RAmmStein的技术框架主要包括以下几个部分:1) 将流动性管理问题建模为马尔可夫决策过程(MDP);2) 使用Ornstein-Uhlenbeck过程模拟价格变动,并提取均值回复速度(theta)等特征;3) 构建深度强化学习模型,该模型以市场状态和特征作为输入,输出再平衡决策;4) 使用历史交易数据训练DRL模型,并使用HJB-QVI进行验证。

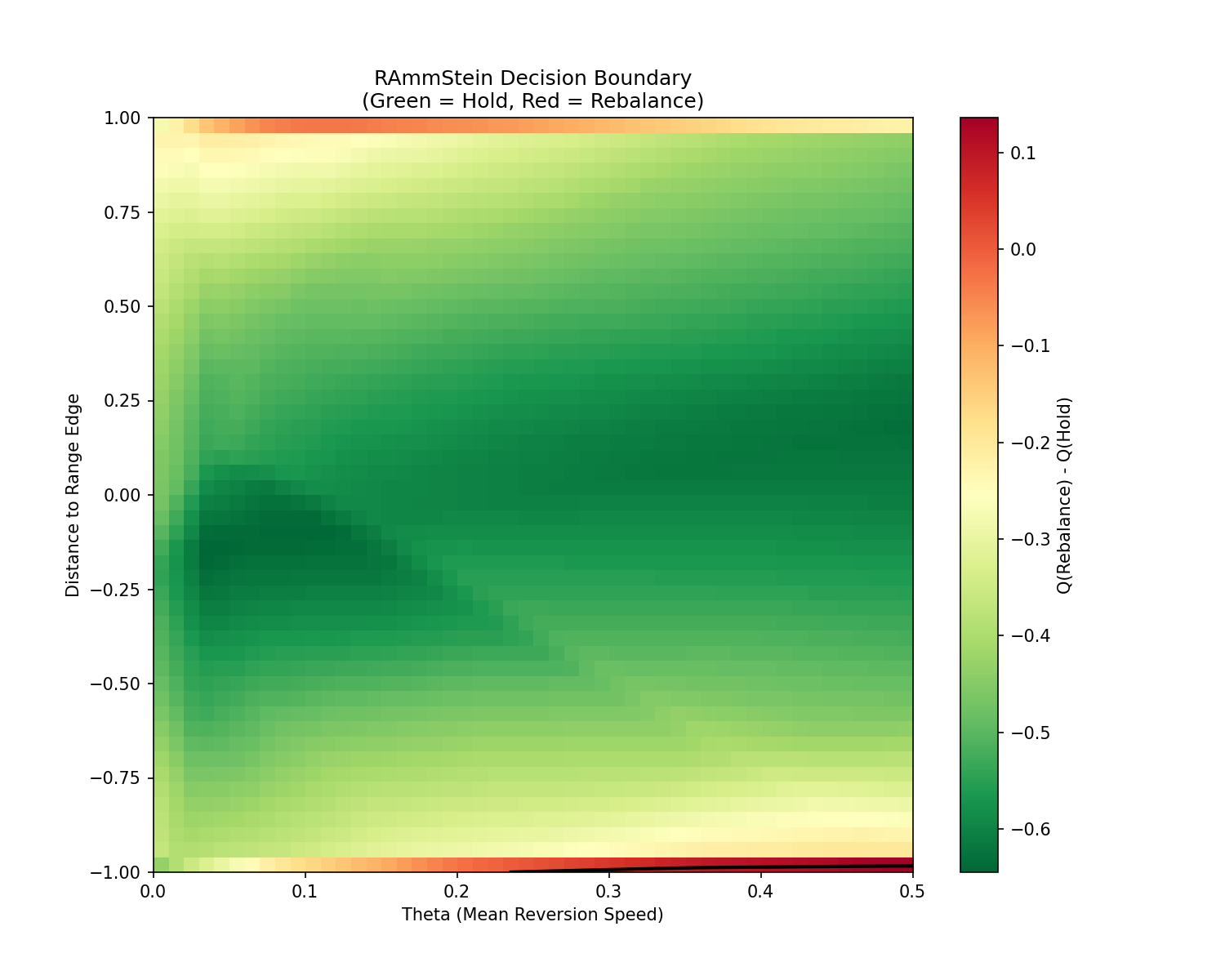

关键创新:RAmmStein的关键创新在于:1) 将市场均值回复特性融入到DRL模型中,使智能体能够更好地预测价格变动;2) 提出了一种“机制感知的懒惰”策略,即智能体学会避免频繁的再平衡,从而降低交易成本;3) 将流动性管理问题建模为最优控制问题,并使用HJB-QVI进行理论分析。

关键设计:RAmmStein的关键设计包括:1) 使用Ornstein-Uhlenbeck过程模拟价格变动,并使用其均值回复速度作为模型输入;2) 使用深度神经网络作为DRL模型的函数逼近器;3) 使用合适的奖励函数来鼓励智能体最大化净投资回报率,同时惩罚频繁的再平衡;4) 使用历史交易数据训练DRL模型,并进行超参数调优。

🖼️ 关键图片

📊 实验亮点

RAmmStein在Coinbase高频交易数据上的实验结果显示,其净投资回报率达到0.72%,优于被动和激进策略。更重要的是,RAmmStein将再平衡频率降低了67%,同时保持了88%的活跃时间。这表明RAmmStein能够在降低交易成本的同时,保持较高的市场参与度,从而实现更高的资本效率。

🎯 应用场景

RAmmStein可应用于各种去中心化交易所(DEX)中的集中流动性管理,帮助流动性提供者更有效地管理其资金,提高资本效率和投资回报率。该方法还可以扩展到其他金融市场,例如传统交易所中的做市策略,以及其他需要动态调整投资组合的场景。此外,该研究为基于强化学习的金融决策提供了新的思路。

📄 摘要(原文)

Concentrated liquidity provision in decentralized exchanges presents a fundamental Impulse Control problem. Liquidity Providers (LPs) face a non-trivial trade-off between maximizing fee accrual through tight price-range concentration and minimizing the friction costs of rebalancing, including gas fees and swap slippage. Existing methods typically employ heuristic or threshold strategies that fail to account for market dynamics. This paper formulates liquidity management as an optimal control problem and derives the corresponding Hamilton-Jacobi-Bellman quasi-variational inequality (HJB-QVI). We present an approximate solution RAmmStein, a Deep Reinforcement Learning method that incorporates the mean-reversion speed (theta) of an Ornstein-Uhlenbeck process among other features as input to the model. We demonstrate that the agent learns to separate the state space into regions of action and inaction. We evaluate the framework using high-frequency 1Hz Coinbase trade data comprising over 6.8M trades. Experimental results show that RAmmStein achieves a superior net ROI of 0.72% compared to both passive and aggressive strategies. Notably, the agent reduces rebalancing frequency by 67% compared to a greedy rebalancing strategy while maintaining 88% active time. Our results demonstrate that regime-aware laziness can significantly improve capital efficiency by preserving the returns that would otherwise be eroded by the operational costs.