Limits of Convergence-Rate Control for Open-Weight Safety

作者: Domenic Rosati, Xijie Zeng, Hong Huang, Sebastian Dionicio, Subhabrata Majumdar, Frank Rudzicz, Hassan Sajjad

分类: math.OC, cs.LG

发布日期: 2026-02-21

备注: Submitted to ICML 2026. 13 figures, 30 tables

💡 一句话要点

提出SpecDef算法,通过谱重参数化实现开放权重模型的收敛速度控制,防御恶意微调。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 开放权重模型 安全性 恶意微调 收敛速度控制 谱重参数化

📋 核心要点

- 现有方法无法有效防御开放权重模型被恶意微调,缺乏理论保障,存在安全隐患。

- 通过谱重参数化控制模型权重的谱结构,从而影响模型的收敛速度,达到防御恶意微调的目的。

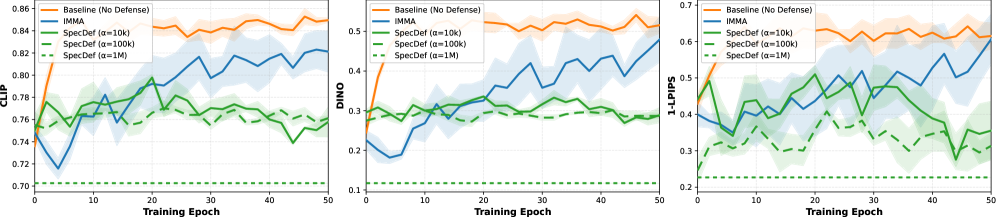

- 提出了SpecDef算法,在非对抗环境中可以有效减缓优化速度,但在对抗环境中存在局限性。

📝 摘要(中文)

开放权重的基础模型在发布后可能被恶意微调,但现有的训练抵抗方法缺乏理论保证。本文将这些干预视为收敛速度控制问题,从而将优化速度与模型权重的谱结构联系起来。基于此,我们提出了一种通过谱重参数化控制收敛速度的新方法,并设计了SpecDef算法,该算法在非对抗环境中可以证明并实际减缓一阶和二阶优化。在对抗环境中,我们确定了包括我们自身方法在内的一大类收敛速度控制方法的一个基本限制:具有足够知识的攻击者可以通过线性增加模型大小来恢复快速收敛。为了克服这一限制,未来的工作需要研究与控制收敛速度不等价的方法。

🔬 方法详解

问题定义:论文旨在解决开放权重模型发布后被恶意微调的安全问题。现有的训练抵抗方法缺乏理论保证,无法有效防御攻击者通过微调来改变模型的行为。因此,需要一种具有理论基础且能有效防御恶意微调的方法。

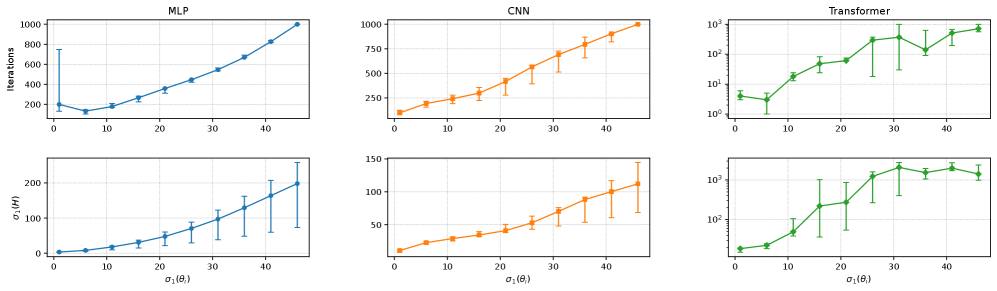

核心思路:论文的核心思路是将恶意微调视为一个收敛速度控制问题。通过控制模型的收敛速度,可以减缓恶意微调的影响,从而提高模型的安全性。具体来说,通过改变模型权重的谱结构来影响模型的收敛速度。

技术框架:论文提出的SpecDef算法主要包含以下几个阶段: 1. 谱重参数化:对模型的权重进行谱重参数化,改变其谱结构。 2. 训练:使用重参数化后的模型进行训练。 3. 推理:使用训练好的模型进行推理。

关键创新:论文最重要的技术创新点在于将收敛速度控制与模型权重的谱结构联系起来,并提出了一种通过谱重参数化来控制收敛速度的方法。与现有方法相比,该方法具有更强的理论基础,并且能够更有效地防御恶意微调。

关键设计:SpecDef算法的关键设计在于谱重参数化的具体实现方式。论文中具体描述了如何通过调整权重矩阵的奇异值来改变其谱结构,从而影响模型的收敛速度。此外,论文还分析了在对抗环境中,攻击者如何通过增加模型大小来恢复快速收敛,并提出了未来研究方向。

🖼️ 关键图片

📊 实验亮点

论文提出了SpecDef算法,在非对抗环境中可以证明并实际减缓一阶和二阶优化。实验结果表明,SpecDef算法可以有效降低模型对恶意微调的敏感性,提高模型的安全性。然而,在对抗环境中,攻击者可以通过线性增加模型大小来恢复快速收敛,这表明该方法存在一定的局限性。

🎯 应用场景

该研究成果可应用于各种开放权重模型的安全部署,例如大型语言模型、图像生成模型等。通过减缓恶意微调的速度,可以有效防止模型被用于生成有害内容、传播虚假信息等。该研究对于提高人工智能系统的安全性具有重要意义,并为未来的安全AI研究提供了新的思路。

📄 摘要(原文)

Open-weight foundation models can be fine-tuned for harmful purposes after release, yet no existing training resistance methods provide theoretical guarantees. Treating these interventions as convergence-rate control problems allows us to connect optimization speed to the spectral structure of model weights. We leverage this insight to develop a novel understanding of convergence rate control through spectral reparameterization and derive an algorithm, SpecDef, that can both provably and empirically slow first- and second-order optimization in non-adversarial settings. In adversarial settings, we establish a fundamental limit on a broad class of convergence rate control methods including our own: an attacker with sufficient knowledge can restore fast convergence at a linear increase in model size. In order to overcome this limitation, future works will need to investigate methods that are not equivalent to controlling convergence rate.