Large Causal Models for Temporal Causal Discovery

作者: Nikolaos Kougioulis, Nikolaos Gkorgkolis, MingXue Wang, Bora Caglayan, Dario Simionato, Andrea Tonon, Ioannis Tsamardinos

分类: cs.LG

发布日期: 2026-02-20

备注: 32 pages (16 main text, 16 Appendix), 11 Figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出用于时序因果发现的大型因果模型,提升泛化性和可扩展性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时序因果发现 大型因果模型 预训练模型 时间序列分析 因果推断

📋 核心要点

- 现有因果发现方法依赖于为每个数据集单独训练模型,缺乏跨数据集的知识迁移能力。

- 论文提出大型因果模型(LCMs),通过预训练的神经架构进行时序因果发现,提升泛化能力。

- 实验表明,LCMs在变量数量和模型深度上具有良好的扩展性,并在分布外数据上表现优异。

📝 摘要(中文)

传统的横截面和时序数据因果发现方法通常采用数据集特定的范式,即为每个数据集拟合一个新模型。这种方法限制了多数据集预训练的潜力。大型因果模型(LCMs)的概念设想了一类专门为时序因果发现设计的预训练神经架构。现有方法受限于小变量计数,随着输入增大而性能下降,并且严重依赖合成数据,限制了泛化能力。我们提出了一个LCMs的原则性框架,结合了多样化的合成生成器和真实时间序列数据集,从而能够进行大规模学习。在合成、半合成和真实基准上的大量实验表明,LCMs能够有效地扩展到更高的变量计数和更深层的架构,同时保持强大的性能。与经典和神经基线相比,训练后的模型实现了有竞争力或更优越的准确性,尤其是在分布外设置中,同时实现了快速的单次推理。结果表明,LCMs是时序因果发现的一种有前途的基础模型范式。实验和模型权重可在https://github.com/kougioulis/LCM-paper/ 获得。

🔬 方法详解

问题定义:论文旨在解决时序因果发现中,现有方法泛化能力差、难以扩展到大规模变量的问题。传统方法通常针对特定数据集进行训练,无法利用多数据集的知识,且对合成数据过度依赖,导致在真实数据上表现不佳。

核心思路:论文的核心思路是利用大型预训练模型(LCMs)学习通用的时序因果关系表示。通过在多样化的合成数据和真实数据上进行预训练,LCMs能够学习到更鲁棒的因果结构,从而提升在不同数据集上的泛化能力。

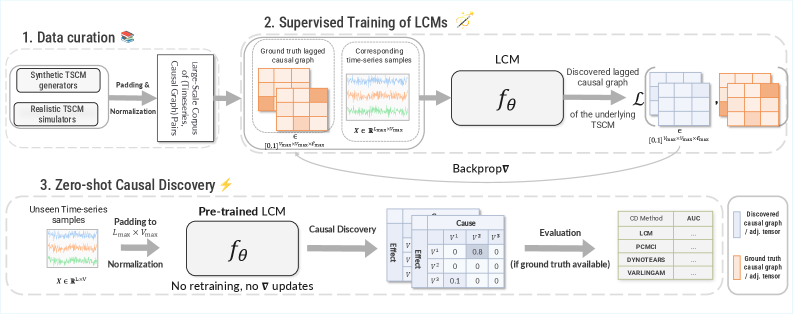

技术框架:LCMs的整体框架包括数据生成、模型预训练和因果结构推断三个主要阶段。首先,利用多种合成数据生成器和真实时间序列数据集构建训练集。然后,使用这些数据对神经架构进行预训练,学习时序因果关系。最后,利用预训练的模型进行因果结构推断,例如通过打分函数或直接预测因果图。

关键创新:论文的关键创新在于提出了一个用于时序因果发现的LCMs框架,该框架能够有效地利用多数据集进行预训练,从而提升模型的泛化能力和可扩展性。与现有方法相比,LCMs不再局限于小规模变量和特定数据集,而是能够处理更大规模、更复杂的时间序列数据。

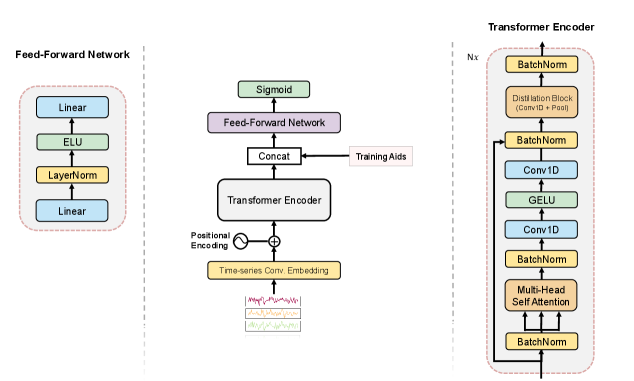

关键设计:论文在数据生成方面,结合了多种合成数据生成器,以覆盖不同的因果关系类型和数据分布。在模型架构方面,采用了能够处理时间序列数据的神经网络结构,例如循环神经网络(RNN)或Transformer。在损失函数方面,设计了能够反映因果关系一致性的损失函数,例如基于因果效应的损失函数。

🖼️ 关键图片

📊 实验亮点

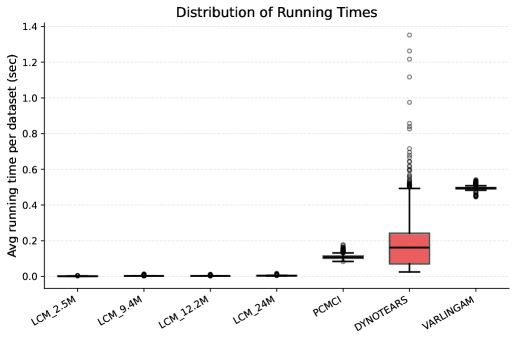

实验结果表明,LCMs在合成、半合成和真实数据集上均取得了优异的性能。与传统方法和神经基线相比,LCMs在分布外数据上表现出更强的泛化能力,并且能够有效地扩展到更高的变量计数和更深层的架构。例如,在某些数据集上,LCMs的准确率比基线方法提高了10%以上。

🎯 应用场景

该研究成果可应用于金融、医疗、气候科学等领域,用于分析时间序列数据中的因果关系,例如预测股票价格波动、诊断疾病、分析气候变化的影响因素。通过准确地识别因果关系,可以为决策提供更可靠的依据,并制定更有效的干预措施。

📄 摘要(原文)

Causal discovery for both cross-sectional and temporal data has traditionally followed a dataset-specific paradigm, where a new model is fitted for each individual dataset. Such an approach limits the potential of multi-dataset pretraining. The concept of large causal models (LCMs) envisions a class of pre-trained neural architectures specifically designed for temporal causal discovery. Prior approaches are constrained to small variable counts, degrade with larger inputs, and rely heavily on synthetic data, limiting generalization. We propose a principled framework for LCMs, combining diverse synthetic generators with realistic time-series datasets, allowing learning at scale. Extensive experiments on synthetic, semi-synthetic and realistic benchmarks show that LCMs scale effectively to higher variable counts and deeper architectures while maintaining strong performance. Trained models achieve competitive or superior accuracy compared to classical and neural baselines, particularly in out-of-distribution settings, while enabling fast, single-pass inference. Results demonstrate LCMs as a promising foundation-model paradigm for temporal causal discovery. Experiments and model weights are available at https://github.com/kougioulis/LCM-paper/.