Online decoding of rat self-paced locomotion speed from EEG using recurrent neural networks

作者: Alejandro de Miguel, Nelson Totah, Uri Maoz

分类: cs.LG, q-bio.NC

发布日期: 2026-02-20

备注: 17 pages, 1 table and 7 figures

💡 一句话要点

利用循环神经网络从脑电信号在线解码大鼠自主运动速度

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 脑-机接口 脑电解码 循环神经网络 自主运动 运动速度 非侵入式 视觉皮层

📋 核心要点

- 现有运动解码方法依赖侵入式手段或外部控制步速,缺乏对自主运动的非侵入式高精度解码。

- 提出一种基于循环神经网络的异步脑-计算机接口,利用头皮脑电信号解码大鼠自主运动速度。

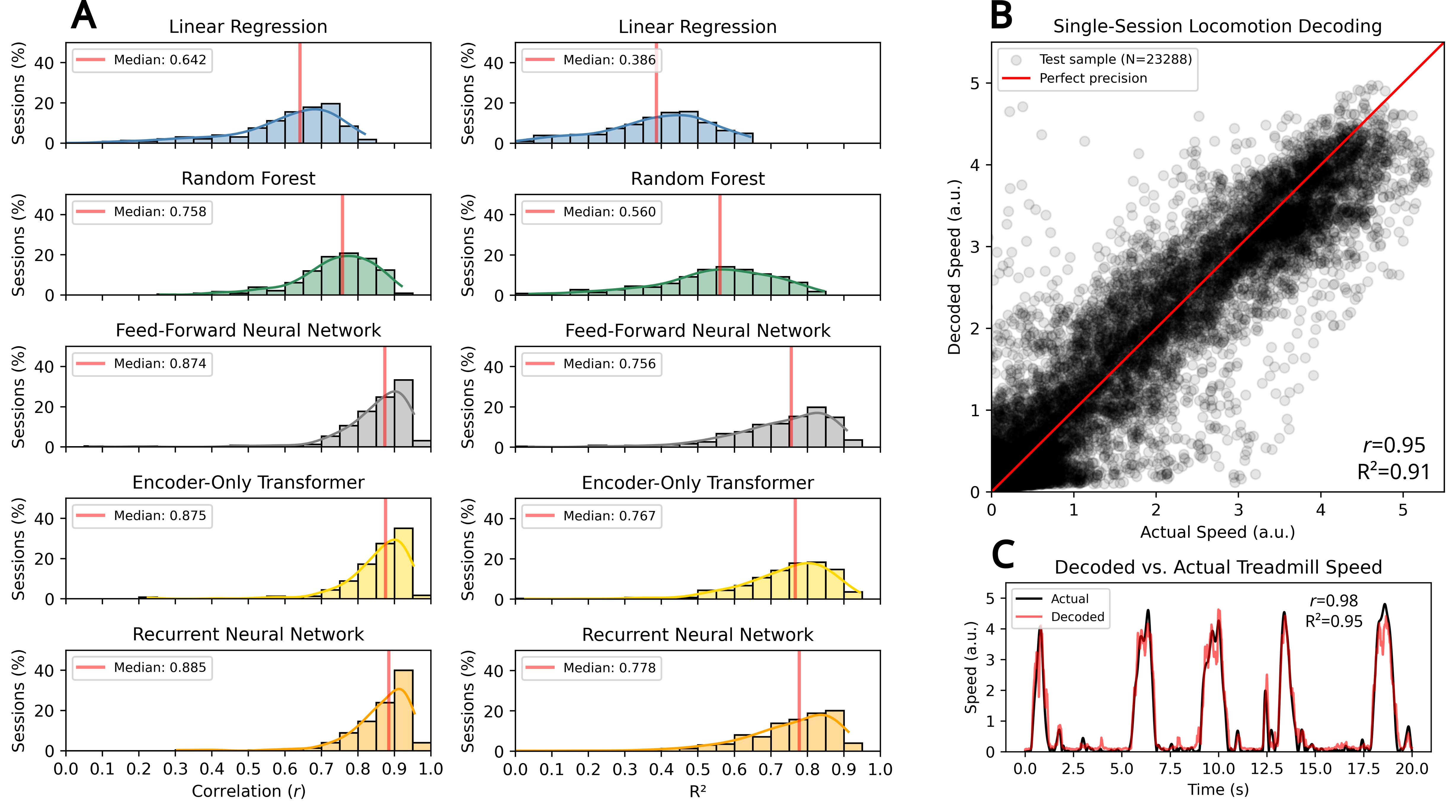

- 实验结果表明,该方法能以较高精度解码运动速度,且解码器具有一定的会话内泛化能力。

📝 摘要(中文)

本研究旨在推进康复、假肢控制以及对动作神经关联的理解,探索对运动的精确神经解码。虽然之前的研究已展示了在电动跑步机上跨物种的运动学解码,但在更自然的环境中解码运动速度(即步速是自主选择而非外部施加)的研究较少,精度不高,且需要颅内植入。本文旨在使用来自大鼠皮层范围脑电图(EEG)记录,无创且连续地解码自主运动速度。我们引入了一个异步脑-计算机接口(BCI),处理来自头固定大鼠在非电动跑步机上自主运动期间的32电极颅骨表面脑电图(0.01-45 Hz)流,以解码瞬时速度。使用循环神经网络和超过133小时的记录数据集,我们训练了解码器以将正在进行的脑电活动映射到跑步机速度。解码速度的相关性达到0.88(R^2 = 0.78),主要由视觉皮层电极和低频(<8 Hz)振荡驱动。此外,在单个会话上进行预训练允许对来自同一大鼠的其他会话进行解码,表明存在跨会话泛化的统一神经特征,但无法跨动物转移。最后,我们发现皮层状态不仅携带有关当前速度的信息,还携带有关未来和过去动态的信息,最长可达1000毫秒。这些发现表明,可以从无创、皮层范围的脑电图中准确且连续地解码自主运动速度。我们的方法为开发高性能、无创BCI系统提供了一个框架,并有助于理解动作动力学的分布式神经表征。

🔬 方法详解

问题定义:论文旨在解决从非侵入式脑电信号中准确解码自主运动速度的问题。现有方法主要依赖于侵入式脑电记录或在受控的运动模式(如电动跑步机)下进行解码,无法很好地推广到更自然的自主运动场景。此外,现有非侵入式方法的解码精度通常较低,限制了其在实际应用中的潜力。

核心思路:论文的核心思路是利用循环神经网络(RNN)对连续的脑电信号进行建模,从而捕捉运动速度与脑电活动之间的时序关系。通过训练RNN,建立脑电信号到运动速度的映射关系,实现对自主运动速度的准确解码。选择RNN是因为它擅长处理时序数据,能够有效提取脑电信号中的动态特征。

技术框架:整体框架是一个异步脑-计算机接口(BCI)系统,包含以下主要模块:1) 脑电信号采集:使用32电极头皮脑电帽记录大鼠在非电动跑步机上自主运动时的脑电信号。2) 信号预处理:对脑电信号进行滤波(0.01-45 Hz)等预处理操作,去除噪声和伪迹。3) 特征提取:将预处理后的脑电信号输入到RNN模型中,RNN自动提取与运动速度相关的特征。4) 速度解码:RNN模型的输出层预测当前的运动速度。5) 性能评估:使用相关系数(R)和决定系数(R^2)等指标评估解码性能。

关键创新:该研究的关键创新在于:1) 实现了从非侵入式头皮脑电信号中对自主运动速度的高精度解码。2) 证明了RNN模型在脑电信号解码中的有效性。3) 揭示了视觉皮层和低频脑电振荡在运动速度解码中的重要作用。4) 发现皮层状态不仅包含当前速度的信息,还包含过去和未来的运动信息。

关键设计:论文使用了标准的循环神经网络结构,具体结构细节未详细描述。关键参数可能包括:RNN的层数、隐藏单元的数量、学习率等。损失函数选择均方误差(MSE),优化器选择Adam。预训练策略是先在一个会话上训练模型,然后在其他会话上进行微调,以提高泛化能力。脑电信号的采样频率和电极位置也是重要的设计参数。

🖼️ 关键图片

📊 实验亮点

该研究使用循环神经网络从大鼠的头皮脑电信号中解码自主运动速度,实现了0.88的相关系数(R^2 = 0.78)。实验结果表明,视觉皮层电极和低频(<8 Hz)振荡对速度解码贡献最大。此外,模型在同一大鼠的不同会话中具有一定的泛化能力,但无法跨动物泛化。

🎯 应用场景

该研究成果可应用于开发非侵入式脑-机接口系统,用于辅助运动障碍患者的康复训练,例如中风患者或脊髓损伤患者。通过解码患者的运动意图,可以帮助他们控制外部设备(如机械臂或外骨骼),从而恢复运动能力。此外,该研究还可以用于运动科学领域,深入理解大脑如何控制自主运动。

📄 摘要(原文)

$\textit{Objective.}$ Accurate neural decoding of locomotion holds promise for advancing rehabilitation, prosthetic control, and understanding neural correlates of action. Recent studies have demonstrated decoding of locomotion kinematics across species on motorized treadmills. However, efforts to decode locomotion speed in more natural contexts$-$where pace is self-selected rather than externally imposed$-$are scarce, generally achieve only modest accuracy, and require intracranial implants. Here, we aim to decode self-paced locomotion speed non-invasively and continuously using cortex-wide EEG recordings from rats. $\textit{Approach.}$ We introduce an asynchronous brain$-$computer interface (BCI) that processes a stream of 32-electrode skull-surface EEG (0.01$-$45 Hz) to decode instantaneous speed from a non-motorized treadmill during self-paced locomotion in head-fixed rats. Using recurrent neural networks and a dataset of over 133 h of recordings, we trained decoders to map ongoing EEG activity to treadmill speed. $\textit{Main results.}$ Our decoding achieves a correlation of 0.88 ($R^2$ = 0.78) for speed, primarily driven by visual cortex electrodes and low-frequency ($< 8$ Hz) oscillations. Moreover, pre-training on a single session permitted decoding on other sessions from the same rat, suggesting uniform neural signatures that generalize across sessions but fail to transfer across animals. Finally, we found that cortical states not only carry information about current speed, but also about future and past dynamics, extending up to 1000 ms. $\textit{Significance.}$ These findings demonstrate that self-paced locomotion speed can be decoded accurately and continuously from non-invasive, cortex-wide EEG. Our approach provides a framework for developing high-performing, non-invasive BCI systems and contributes to understanding distributed neural representations of action dynamics.