Non-Interfering Weight Fields: Treating Model Parameters as a Continuously Extensible Function

作者: Sarim Chaudhry

分类: cs.LG, cs.AI

发布日期: 2026-02-20

💡 一句话要点

提出非干涉权重场(NIWF),解决大模型灾难性遗忘问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 灾难性遗忘 持续学习 权重场 非干涉学习 大语言模型 版本控制 能力坐标

📋 核心要点

- 现有方法难以解决大模型灾难性遗忘问题,它们将权重视为不可变的,缺乏防止遗忘的结构性保证。

- NIWF将模型权重视为连续可扩展函数,通过能力坐标空间生成权重配置,训练后锁定坐标区域防止遗忘。

- 实验表明,NIWF在顺序任务学习中实现了零遗忘,并在新任务上保持了良好的性能,具有软件式版本控制的潜力。

📝 摘要(中文)

大型语言模型将所有学习到的知识存储在单个固定的权重向量中。赋予模型新的能力需要修改这些权重,不可避免地会降低先前获得的知识,即灾难性遗忘。本文提出非干涉权重场(NIWF),该框架用一个学习到的函数替代固定权重模式,该函数从连续的能力坐标空间按需生成权重配置。在某个任务上训练后,通过快照字段输出在锚点上的输出来提交已占用的坐标区域,从而在所有未来的训练中强制执行功能锁定。在Mistral-7B上对顺序指令跟随和代码生成任务验证了NIWF,证明了在已提交任务上实现了零遗忘,并在新任务上具有竞争力的困惑度。该框架引入了神经网络智能的软件式版本控制概念,无需重新训练即可提交、扩展、组合和回滚功能。

🔬 方法详解

问题定义:论文旨在解决大型语言模型中普遍存在的灾难性遗忘问题。现有方法,如正则化、回放缓存或适配器模块,都将权重视为不可变的,缺乏防止遗忘的根本性结构保证,无法有效解决模型在学习新任务时忘记旧任务的问题。

核心思路:NIWF的核心思路是将模型的权重不再视为固定的参数,而是视为一个连续函数的输出。这个函数以“能力坐标”作为输入,输出对应的权重配置。通过这种方式,不同的能力可以映射到不同的权重空间区域,从而避免相互干扰。训练完成后,通过“锁定”已学习能力的坐标区域,防止后续训练修改这些区域对应的权重,从而避免遗忘。

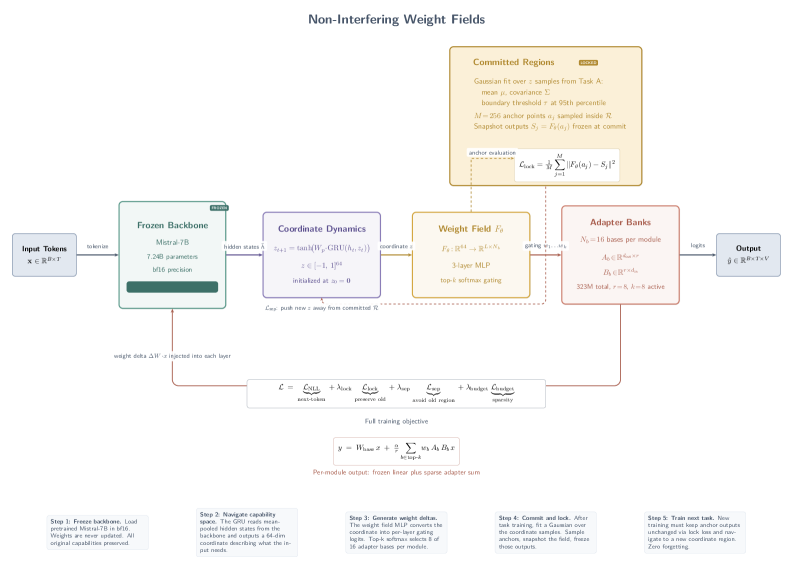

技术框架:NIWF框架包含以下几个主要步骤:1) 定义一个连续的能力坐标空间。2) 训练一个权重生成函数(Weight Field),该函数将能力坐标映射到权重配置。3) 在训练完一个任务后,通过在锚点上快照权重场输出来“提交”已占用的坐标区域,形成功能锁定。4) 在后续训练中,锁定区域的权重保持不变,从而防止遗忘。整体流程类似于软件开发中的版本控制,每个任务对应一个版本,可以随时回滚或组合。

关键创新:NIWF最重要的创新在于将模型权重从固定的参数转变为一个连续可学习的函数。这种转变使得模型能够以一种非干涉的方式学习新的能力,避免了对已有知识的破坏。与现有方法相比,NIWF提供了一种结构性的遗忘保护机制,而不是依赖于启发式的正则化或回放策略。

关键设计:NIWF的关键设计包括:1) 如何选择合适的权重生成函数,例如MLP或Transformer。2) 如何定义能力坐标空间,使其能够有效地表示不同的任务或能力。3) 如何选择锚点,以确保能够充分覆盖已学习的坐标区域。4) 如何定义损失函数,以鼓励权重生成函数学习到有效的映射关系,并防止不同能力之间的干扰。论文使用Mistral-7B作为基础模型进行了实验。

🖼️ 关键图片

📊 实验亮点

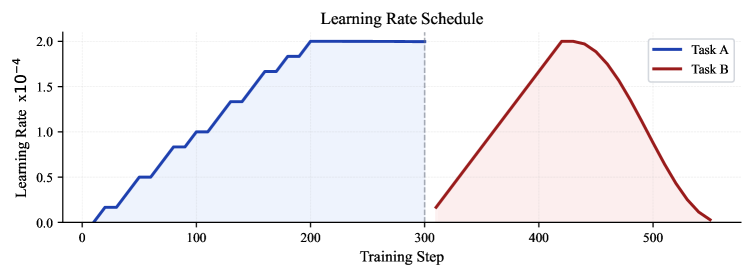

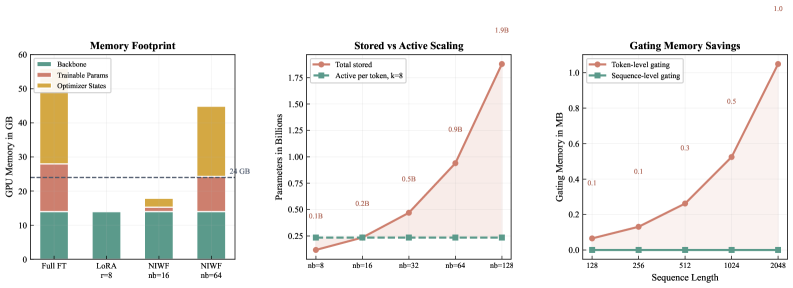

实验结果表明,NIWF在顺序指令跟随和代码生成任务上,使用Mistral-7B模型,实现了已提交任务的零遗忘。同时,NIWF在新任务上的性能与基线模型相比具有竞争力,表明该方法能够在防止遗忘的同时,保持模型的学习能力。这些结果验证了NIWF的有效性和潜力。

🎯 应用场景

NIWF具有广泛的应用前景,例如持续学习、多任务学习、终身学习等。它可以应用于机器人、自然语言处理、计算机视觉等领域,使模型能够不断学习新的知识和技能,而不会忘记已有的知识。该方法为构建具有软件式版本控制能力的神经网络智能奠定了基础,使得模型的开发、部署和维护更加灵活和高效。

📄 摘要(原文)

Large language models store all learned knowledge in a single, fixed weight vector. Teaching a model new capabilities requires modifying those same weights, inevitably degrading previously acquired knowledge. This fundamental limitation, known as catastrophic forgetting, has resisted principled solutions for decades. Existing approaches treat weights as immutable artifacts that must be protected through techniques like regularization heuristics, replay buffers, or isolated adapter modules. The problem is none of these provide a structural guarantee against forgetting. In this work, we propose Non-Interfering Weight Fields (NIWF), a framework that replaces the fixed weight paradigm with a learned function that generates weight configurations on demand from a continuous capability coordinate space. After training on a task, we commit the occupied coordinate region by snapshotting the fields outputs on anchor points to enforce a functional lock during all future training. We validate NIWF on sequential instructionfollowing and code generation tasks using Mistral-7B, demonstrating zero forgetting on committed tasks with competitive perplexity on new tasks. The framework introduces the notion of software-like versioning for neural network intelligence, where capabilities can be committed, extended, composed, and rolled back without retraining.