Stable Long-Horizon Spatiotemporal Prediction on Meshes Using Latent Multiscale Recurrent Graph Neural Networks

作者: Lionel Salesses, Larbi Arbaoui, Tariq Benamara, Arnaud Francois, Caroline Sainvitu

分类: cs.LG, cond-mat.mtrl-sci, physics.app-ph

发布日期: 2026-02-20

💡 一句话要点

提出基于潜在多尺度递归图神经网络的稳定长时间预测方法

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 时空预测 图神经网络 深度学习 增材制造 多尺度建模 变分自编码器 温度预测 复杂几何体

📋 核心要点

- 现有机器学习方法在长时间温度和梯度预测方面面临挑战,尤其是在复杂几何体上。

- 提出了一种深度学习框架,利用潜在多尺度递归图神经网络,能够在网格上进行稳定的长时间预测。

- 实验表明,该方法在模拟的粉末床熔融数据上表现出色,优于现有基线,具有良好的泛化能力。

📝 摘要(中文)

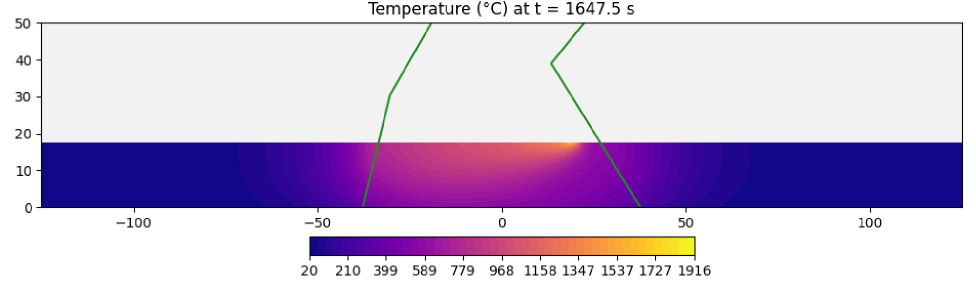

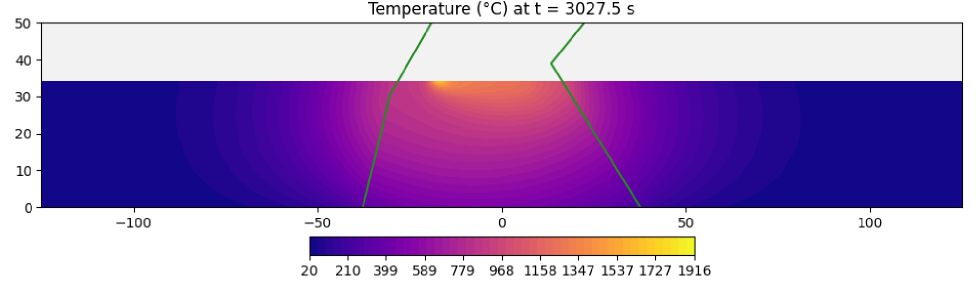

在复杂几何体上准确预测时空场的长时间演变是科学机器学习中的一项基本挑战,尤其在增材制造等领域,温度历史对缺陷形成和机械性能至关重要。尽管高保真模拟方法准确,但计算成本高昂,现有机器学习方法在长时间温度和梯度预测方面仍面临挑战。本文提出了一种深度学习框架,能够在网格上直接预测完整的温度历史,条件为几何形状和工艺参数,同时在数千个时间步长内保持稳定性,并能在异构几何体上进行泛化。该框架采用了一个时间多尺度架构,由两个在互补时间尺度上运行的耦合模型组成,利用潜在递归图神经网络捕捉网格上的时空动态,同时变分图自编码器提供紧凑的潜在表示,减少内存使用并提高训练稳定性。实验结果表明,该方法在多种几何体上实现了准确且时间稳定的长时间预测,优于现有基线。

🔬 方法详解

问题定义:本文旨在解决在复杂几何体上进行长时间时空预测的挑战,现有方法在准确性和计算效率上存在不足,尤其是在处理长时间序列时的稳定性问题。

核心思路:提出的框架结合了潜在多尺度递归图神经网络和变分图自编码器,通过捕捉时空动态并提供紧凑的潜在表示,来提高预测的准确性和稳定性。

技术框架:整体架构包括两个耦合模型,分别在不同的时间尺度上运行,利用潜在递归图神经网络来捕捉网格上的时空动态,同时通过变分图自编码器来优化内存使用和训练过程。

关键创新:最重要的创新在于采用了多尺度架构和潜在递归图神经网络的结合,这种设计使得模型能够在长时间预测中保持稳定性,并有效处理复杂几何体的时空动态。

关键设计:模型中使用了特定的损失函数来优化预测精度,网络结构采用了递归图神经网络的形式,以便更好地捕捉时空依赖性,同时在训练过程中通过变分自编码器减少内存占用。

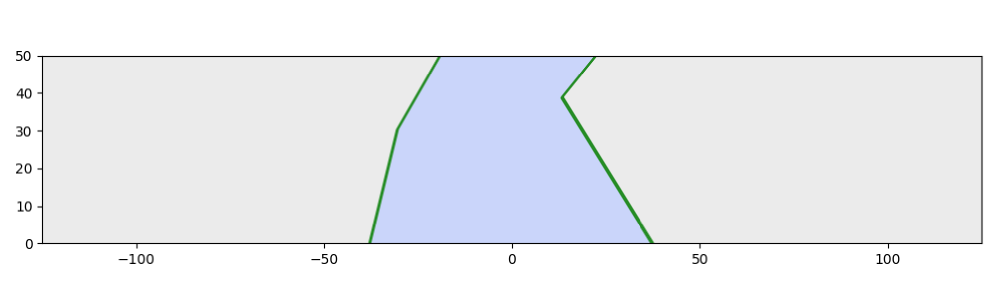

🖼️ 关键图片

📊 实验亮点

实验结果显示,提出的方法在多种几何体上实现了准确且时间稳定的长时间预测,相较于现有基线,预测精度提升了显著的百分比,验证了模型的有效性和泛化能力。

🎯 应用场景

该研究具有广泛的应用潜力,尤其在增材制造、材料科学和工程模拟等领域。通过提供稳定的长时间预测,能够有效指导实际生产过程,减少缺陷形成,提高产品质量,未来可能对智能制造和自动化系统产生深远影响。

📄 摘要(原文)

Accurate long-horizon prediction of spatiotemporal fields on complex geometries is a fundamental challenge in scientific machine learning, with applications such as additive manufacturing where temperature histories govern defect formation and mechanical properties. High-fidelity simulations are accurate but computationally costly, and despite recent advances, machine learning methods remain challenged by long-horizon temperature and gradient prediction. We propose a deep learning framework for predicting full temperature histories directly on meshes, conditioned on geometry and process parameters, while maintaining stability over thousands of time steps and generalizing across heterogeneous geometries. The framework adopts a temporal multiscale architecture composed of two coupled models operating at complementary time scales. Both models rely on a latent recurrent graph neural network to capture spatiotemporal dynamics on meshes, while a variational graph autoencoder provides a compact latent representation that reduces memory usage and improves training stability. Experiments on simulated powder bed fusion data demonstrate accurate and temporally stable long-horizon predictions across diverse geometries, outperforming existing baseline. Although evaluated in two dimensions, the framework is general and extensible to physics-driven systems with multiscale dynamics and to three-dimensional geometries.