Balancing Symmetry and Efficiency in Graph Flow Matching

作者: Benjamin Honoré, Alba Carballo-Castro, Yiming Qin, Pascal Frossard

分类: cs.LG

发布日期: 2026-02-20

备注: 15 pages, 11 figures

💡 一句话要点

提出一种可控对称性调制方案,在图生成模型中平衡对称性和效率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图生成模型 等变性 对称性调制 流匹配 节点置换

📋 核心要点

- 图生成模型需要满足等变性,但严格的等变性会增加计算成本和降低收敛速度。

- 论文提出一种可控对称性调制方案,通过正弦位置编码和节点置换来放松等变性约束。

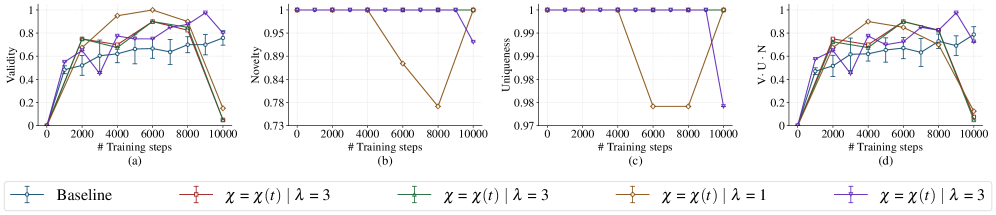

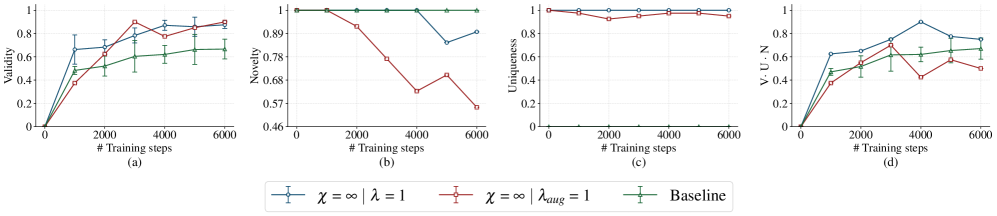

- 实验表明,适当调制对称性信号可以加速收敛,同时避免过拟合,提升模型性能。

📝 摘要(中文)

等变性是图生成模型的核心,它确保模型尊重图的置换对称性。然而,严格的等变性会因增加的架构约束而增加计算成本,并因模型必须在大量可能的节点置换中保持一致而减慢收敛速度。本文研究了图生成模型中的这种权衡。具体来说,我们从一个等变离散流匹配模型开始,并通过基于正弦位置编码和节点置换的可控对称性调制方案,在训练期间放宽其等变性。实验表明,打破对称性可以通过提供更容易的学习信号来加速早期训练,但代价是鼓励可能导致过拟合的捷径解决方案,即模型重复生成训练集的副本。相反,正确地调制对称性信号可以延迟过拟合,同时加速收敛,使模型能够以基线训练 epoch 的 19% 达到更强的性能。

🔬 方法详解

问题定义:图生成模型需要满足等变性,即对于图的节点置换,模型的输出应该保持不变。然而,强制模型的等变性会增加计算复杂度,并且由于模型需要在所有可能的节点置换下保持一致,这会减慢训练的收敛速度。现有方法难以在模型的对称性和训练效率之间取得平衡。

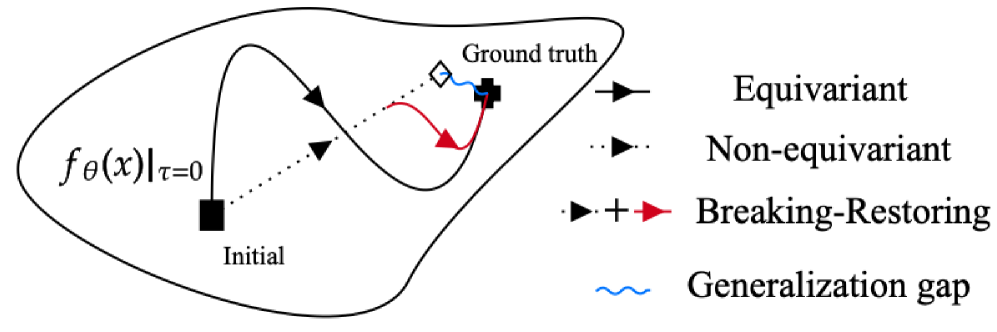

核心思路:本文的核心思路是通过在训练过程中有控制地打破模型的对称性,来加速模型的训练过程。具体来说,在训练初期,允许模型学习一些非对称的特征,从而更快地拟合数据。随着训练的进行,逐渐增强模型的对称性,以避免过拟合。

技术框架:该方法基于离散流匹配模型,并引入了一个可控对称性调制模块。该模块使用正弦位置编码来表示节点的位置信息,并使用节点置换来打破模型的对称性。通过调整正弦位置编码的频率和节点置换的概率,可以控制模型的对称性程度。整体训练流程包括:1. 初始化等变离散流匹配模型;2. 使用可控对称性调制模块进行训练;3. 评估模型性能。

关键创新:该方法最重要的创新点在于提出了一个可控对称性调制方案,可以在训练过程中动态地调整模型的对称性程度。这种方法允许模型在训练初期快速学习,并在训练后期避免过拟合。与现有方法相比,该方法能够在模型的对称性和训练效率之间取得更好的平衡。

关键设计:关键设计包括:1. 使用正弦位置编码来表示节点的位置信息,正弦函数的频率控制了对称性打破的程度;2. 使用节点置换来打破模型的对称性,置换的概率控制了对称性打破的程度;3. 设计了合适的损失函数,以鼓励模型在训练初期快速学习,并在训练后期保持对称性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过适当调制对称性信号,该方法可以在加速收敛的同时延迟过拟合,使得模型能够以基线训练 epoch 的 19% 达到更强的性能。这意味着该方法可以在显著减少训练时间的情况下,获得更好的模型性能。

🎯 应用场景

该研究成果可应用于各种图生成任务,例如分子生成、社交网络生成、知识图谱生成等。通过平衡模型的对称性和效率,可以提高图生成模型的性能和训练速度,从而加速相关领域的研发进程。该方法在药物发现、社交媒体分析、推荐系统等领域具有潜在的应用价值。

📄 摘要(原文)

Equivariance is central to graph generative models, as it ensures the model respects the permutation symmetry of graphs. However, strict equivariance can increase computational cost due to added architectural constraints, and can slow down convergence because the model must be consistent across a large space of possible node permutations. We study this trade-off for graph generative models. Specifically, we start from an equivariant discrete flow-matching model, and relax its equivariance during training via a controllable symmetry modulation scheme based on sinusoidal positional encodings and node permutations. Experiments first show that symmetry-breaking can accelerate early training by providing an easier learning signal, but at the expense of encouraging shortcut solutions that can cause overfitting, where the model repeatedly generates graphs that are duplicates of the training set. On the contrary, properly modulating the symmetry signal can delay overfitting while accelerating convergence, allowing the model to reach stronger performance with $19\%$ of the baseline training epochs.