Pushing the Frontier of Black-Box LVLM Attacks via Fine-Grained Detail Targeting

作者: Xiaohan Zhao, Zhaoyi Li, Yaxin Luo, Jiacheng Cui, Zhiqiang Shen

分类: cs.LG, cs.AI, cs.CL, cs.CV

发布日期: 2026-02-19

备注: Code at: https://github.com/vila-lab/M-Attack-V2

🔗 代码/项目: GITHUB

💡 一句话要点

M-Attack-V2:通过细粒度细节攻击提升黑盒LVLM对抗攻击性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 黑盒攻击 视觉语言模型 对抗样本 迁移学习 梯度去噪

📋 核心要点

- 现有基于迁移的黑盒LVLM攻击方法(如M-Attack)存在梯度高方差和优化不稳定的问题,源于ViT的平移敏感性和源目标裁剪的结构不对称。

- 论文提出M-Attack-V2,通过多裁剪对齐(MCA)降低源端梯度方差,辅助目标对齐(ATA)平滑目标流形,并引入补丁动量和补丁大小集成来增强可迁移方向。

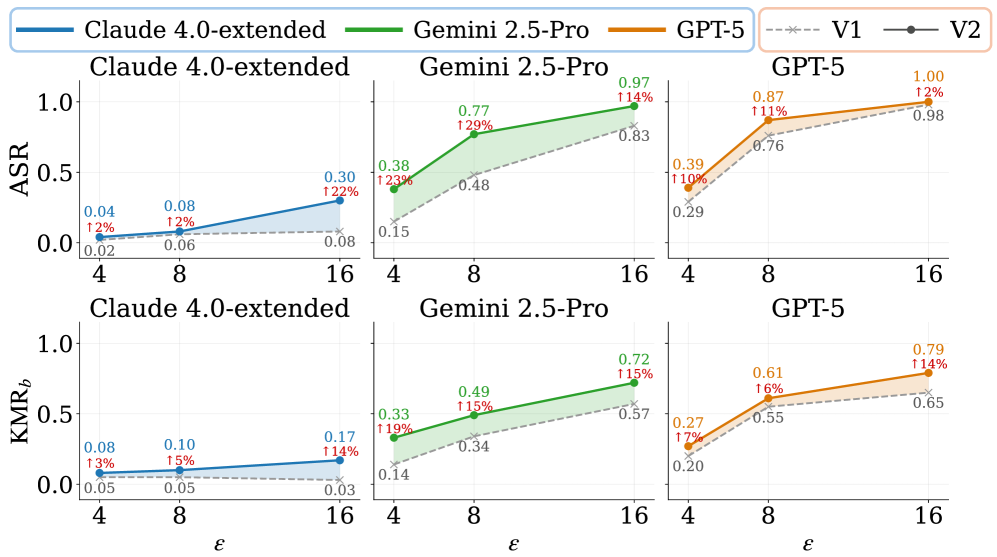

- 实验结果表明,M-Attack-V2显著提升了对前沿LVLM的黑盒攻击成功率,例如在Claude-4.0上从8%提升至30%,Gemini-2.5-Pro上从83%提升至97%。

📝 摘要(中文)

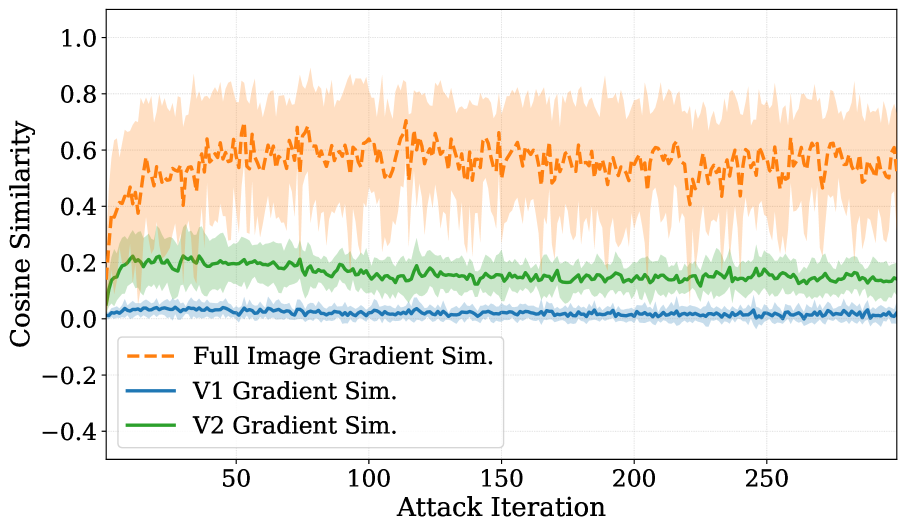

针对大型视觉语言模型(LVLM)的黑盒对抗攻击由于缺乏梯度和复杂的多模态边界而具有挑战性。现有最佳的基于迁移的攻击方法,如M-Attack,虽然通过源图像和目标图像之间的局部裁剪级别匹配表现良好,但我们发现这会导致高方差、几乎正交的梯度,从而破坏了连贯的局部对齐并使优化不稳定。我们将其归因于(i)ViT的平移敏感性,产生尖峰状梯度,以及(ii)源裁剪和目标裁剪之间的结构不对称性。我们将局部匹配重新定义为源变换和目标语义上的非对称期望,并构建了M-Attack的梯度去噪升级版本。在源端,多裁剪对齐(MCA)平均每次迭代中来自多个独立采样的局部视图的梯度,以减少方差。在目标端,辅助目标对齐(ATA)用来自语义相关分布的小型辅助集替换了激进的目标增强,从而产生了更平滑、更低方差的目标流形。我们进一步将动量重新解释为补丁动量,重放历史裁剪梯度;结合改进的补丁大小集成(PE+),这加强了可迁移的方向。这些模块共同构成了M-Attack-V2,这是一个简单、模块化的M-Attack增强版本,它大大提高了对前沿LVLM的基于迁移的黑盒攻击性能:将Claude-4.0的成功率从8%提高到30%,Gemini-2.5-Pro从83%提高到97%,GPT-5从98%提高到100%,优于之前的黑盒LVLM攻击。

🔬 方法详解

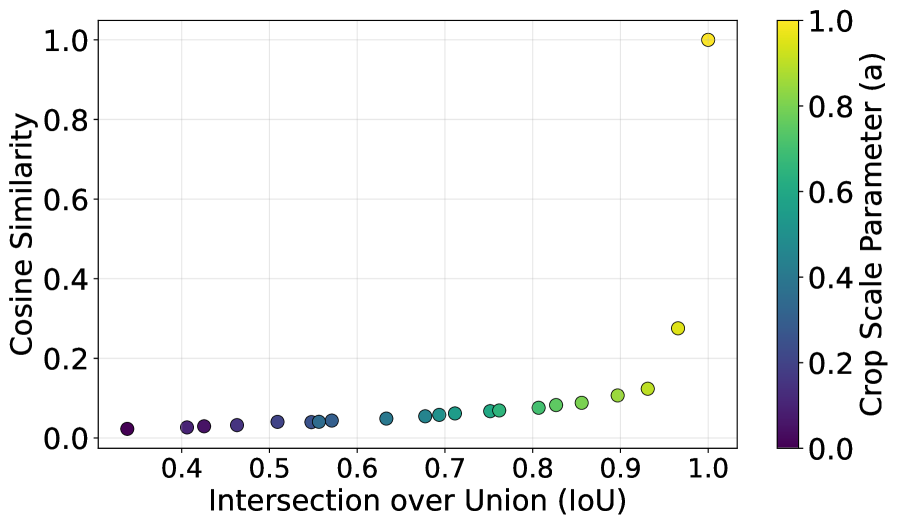

问题定义:论文旨在解决黑盒条件下,针对大型视觉语言模型(LVLM)的对抗攻击问题。现有方法,如M-Attack,虽然利用了源图像和目标图像的局部裁剪匹配,但在实际应用中存在梯度方差过高、优化过程不稳定等问题。这些问题源于ViT架构对图像平移的敏感性以及源图像和目标图像裁剪区域之间的结构不对称性,导致攻击效果不佳。

核心思路:论文的核心思路是通过改进局部匹配策略,降低梯度方差,并增强可迁移的对抗扰动。具体来说,论文将局部匹配重新定义为源图像变换和目标图像语义上的非对称期望,从而更好地模拟真实场景下的攻击情况。此外,论文还引入了梯度去噪机制,以减少优化过程中的噪声干扰。

技术框架:M-Attack-V2的整体框架是在M-Attack的基础上进行改进,主要包含以下几个模块:1) 多裁剪对齐(MCA):通过对源图像进行多次独立裁剪,并对裁剪区域的梯度进行平均,从而降低梯度方差。2) 辅助目标对齐(ATA):使用语义相关的辅助图像集替代激进的目标增强,生成更平滑的目标流形。3) 补丁动量(Patch Momentum):将历史裁剪区域的梯度信息融入当前迭代,增强可迁移的对抗方向。4) 补丁大小集成(PE+):优化补丁大小的选择,进一步提升攻击效果。

关键创新:论文的关键创新在于对局部匹配策略的重新定义和梯度去噪机制的引入。通过将局部匹配视为非对称期望,论文更好地模拟了真实场景下的攻击情况。同时,MCA和ATA模块有效地降低了梯度方差,提高了优化的稳定性。补丁动量和补丁大小集成则进一步增强了对抗扰动的可迁移性。

关键设计:MCA模块中,裁剪区域的数量是一个关键参数,需要根据具体任务进行调整。ATA模块中,辅助图像集的选择需要保证与目标图像具有一定的语义相关性。补丁动量模块中,动量系数的设置需要平衡历史梯度和当前梯度的影响。补丁大小集成模块中,需要选择合适的补丁大小范围,以覆盖不同尺度的图像特征。

🖼️ 关键图片

📊 实验亮点

M-Attack-V2在多个前沿LVLM上取得了显著的性能提升。例如,在Claude-4.0上的攻击成功率从8%提升至30%,在Gemini-2.5-Pro上从83%提升至97%,在GPT-5上从98%提升至100%。这些结果表明,M-Attack-V2是一种有效的黑盒LVLM对抗攻击方法,优于现有的攻击技术。

🎯 应用场景

该研究成果可应用于评估和提升大型视觉语言模型的安全性,防御潜在的对抗攻击。通过了解LVLM的脆弱性,可以开发更鲁棒的模型,防止恶意用户利用对抗样本进行欺骗、误导或破坏。此外,该研究也有助于推动对抗攻击和防御领域的发展,促进更安全可靠的人工智能系统的构建。

📄 摘要(原文)

Black-box adversarial attacks on Large Vision-Language Models (LVLMs) are challenging due to missing gradients and complex multimodal boundaries. While prior state-of-the-art transfer-based approaches like M-Attack perform well using local crop-level matching between source and target images, we find this induces high-variance, nearly orthogonal gradients across iterations, violating coherent local alignment and destabilizing optimization. We attribute this to (i) ViT translation sensitivity that yields spike-like gradients and (ii) structural asymmetry between source and target crops. We reformulate local matching as an asymmetric expectation over source transformations and target semantics, and build a gradient-denoising upgrade to M-Attack. On the source side, Multi-Crop Alignment (MCA) averages gradients from multiple independently sampled local views per iteration to reduce variance. On the target side, Auxiliary Target Alignment (ATA) replaces aggressive target augmentation with a small auxiliary set from a semantically correlated distribution, producing a smoother, lower-variance target manifold. We further reinterpret momentum as Patch Momentum, replaying historical crop gradients; combined with a refined patch-size ensemble (PE+), this strengthens transferable directions. Together these modules form M-Attack-V2, a simple, modular enhancement over M-Attack that substantially improves transfer-based black-box attacks on frontier LVLMs: boosting success rates on Claude-4.0 from 8% to 30%, Gemini-2.5-Pro from 83% to 97%, and GPT-5 from 98% to 100%, outperforming prior black-box LVLM attacks. Code and data are publicly available at: https://github.com/vila-lab/M-Attack-V2.