Privacy-Preserving Mechanisms Enable Cheap Verifiable Inference of LLMs

作者: Arka Pal, Louai Zahran, William Gvozdjak, Akilesh Potti, Micah Goldblum

分类: cs.CR, cs.LG

发布日期: 2026-02-19

💡 一句话要点

利用隐私保护机制实现低成本、可验证的大语言模型推理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 可验证推理 隐私保护 零知识证明 安全计算

📋 核心要点

- 现有LLM推理验证方法依赖零知识证明,计算开销大,难以应用于大型模型。

- 论文提出利用隐私保护LLM推理,以极低的额外成本实现推理验证,无需复杂密码学。

- 新方法计算成本低,对下游任务影响小,且验证速度优于传统的零知识证明方法。

📝 摘要(中文)

随着大型语言模型(LLMs)规模持续增长,越来越多的用户无法在本地托管和运行模型。这导致第三方托管服务的使用增加。然而,在这种情况下,推理提供商执行的计算缺乏保证。例如,不诚实的提供商可能会用运行成本较低的较弱模型替换昂贵的大型模型,并将较弱模型的结果返回给用户。现有的验证推理的工具通常依赖于零知识证明(ZKPs)等密码学方法,但这会增加显著的计算开销,并且对于大型模型来说仍然不可行。在这项工作中,我们提出了一个新的见解——给定一种执行私有LLM推理的方法,就可以以极低的额外成本获得可验证的推理形式。具体来说,我们提出了两种新的协议,利用隐私保护的LLM推理来提供对所执行推理的保证。我们的方法成本低廉,只需要增加几个额外的计算token,并且对下游的影响很小或没有影响。由于最快的隐私保护推理方法通常比ZK方法更快,因此所提出的协议也提高了验证运行时间。我们的工作为LLM推理中隐私和可验证性之间的联系提供了新的见解。

🔬 方法详解

问题定义:论文旨在解决LLM推理服务中,用户无法验证服务提供商是否使用了正确的模型进行推理的问题。现有方法,如零知识证明,计算开销巨大,难以应用于大型LLM,使得不诚实的提供商可以用低成本的弱模型替代昂贵的LLM,损害用户利益。

核心思路:论文的核心思想是,如果已经存在一种隐私保护的LLM推理方法,那么就可以在此基础上,以很小的额外代价实现推理结果的可验证性。通过巧妙地设计协议,利用隐私保护推理过程中的某些中间结果或特性,来提供推理过程的证据,从而让用户能够验证推理的真实性。

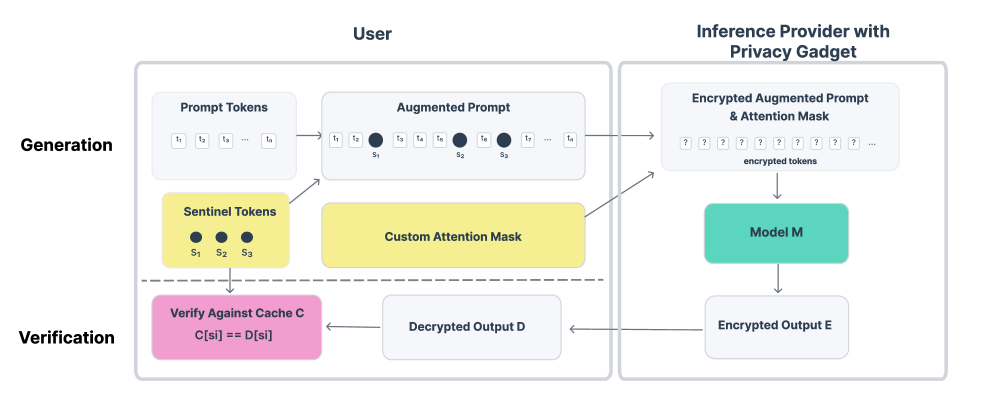

技术框架:论文提出了两种新的协议,具体的技术框架细节未知,但整体思路是利用已有的隐私保护LLM推理技术作为基础。可以推测,该框架可能包含以下阶段:1) 用户向服务提供商发送加密的输入;2) 服务提供商使用隐私保护的LLM进行推理;3) 服务提供商生成用于验证推理过程的证据;4) 服务提供商将加密的推理结果和证据发送给用户;5) 用户解密推理结果,并使用证据验证推理过程的真实性。

关键创新:论文的关键创新在于发现了隐私保护推理和可验证推理之间的联系,并提出了利用隐私保护推理来实现低成本可验证推理的新思路。这种方法避免了直接使用零知识证明等复杂密码学技术,从而大大降低了计算开销。

关键设计:具体的参数设置、损失函数、网络结构等技术细节未知,但可以推测,关键设计可能包括:1) 如何选择合适的隐私保护LLM推理方法作为基础;2) 如何设计证据生成过程,使其既能提供足够的验证信息,又能保持较低的计算开销;3) 如何设计验证算法,使其能够高效地验证推理过程的真实性。

🖼️ 关键图片

📊 实验亮点

论文提出的方法能够以极低的额外计算成本实现LLM推理的可验证性,只需要增加几个额外的计算token。由于隐私保护推理方法通常比零知识证明方法更快,因此该方法还能提高验证运行时间。具体的性能数据和对比基线未知。

🎯 应用场景

该研究成果可应用于对安全性要求较高的LLM推理服务场景,例如金融、医疗等领域。用户可以验证推理结果的真实性,防止服务提供商作弊,保障数据安全和模型公平性。未来,该技术有望促进LLM在更多敏感领域的应用。

📄 摘要(原文)

As large language models (LLMs) continue to grow in size, fewer users are able to host and run models locally. This has led to increased use of third-party hosting services. However, in this setting, there is a lack of guarantees on the computation performed by the inference provider. For example, a dishonest provider may replace an expensive large model with a cheaper-to-run weaker model and return the results from the weaker model to the user. Existing tools to verify inference typically rely on methods from cryptography such as zero-knowledge proofs (ZKPs), but these add significant computational overhead, and remain infeasible for use for large models. In this work, we develop a new insight -- that given a method for performing private LLM inference, one can obtain forms of verified inference at marginal extra cost. Specifically, we propose two new protocols which leverage privacy-preserving LLM inference in order to provide guarantees over the inference that was carried out. Our approaches are cheap, requiring the addition of a few extra tokens of computation, and have little to no downstream impact. As the fastest privacy-preserving inference methods are typically faster than ZK methods, the proposed protocols also improve verification runtime. Our work provides novel insights into the connections between privacy and verifiability in LLM inference.