Geometric Neural Operators via Lie Group-Constrained Latent Dynamics

作者: Jiaquan Zhang, Fachrina Dewi Puspitasari, Songbo Zhang, Yibei Liu, Kuien Liu, Caiyan Qin, Fan Mo, Peng Wang, Yang Yang, Chaoning Zhang

分类: cs.LG, cs.AI

发布日期: 2026-02-18

💡 一句话要点

提出基于李群约束流形神经网络算子,提升偏微分方程长期预测稳定性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 神经算子 李群 流形约束 偏微分方程 长期预测

📋 核心要点

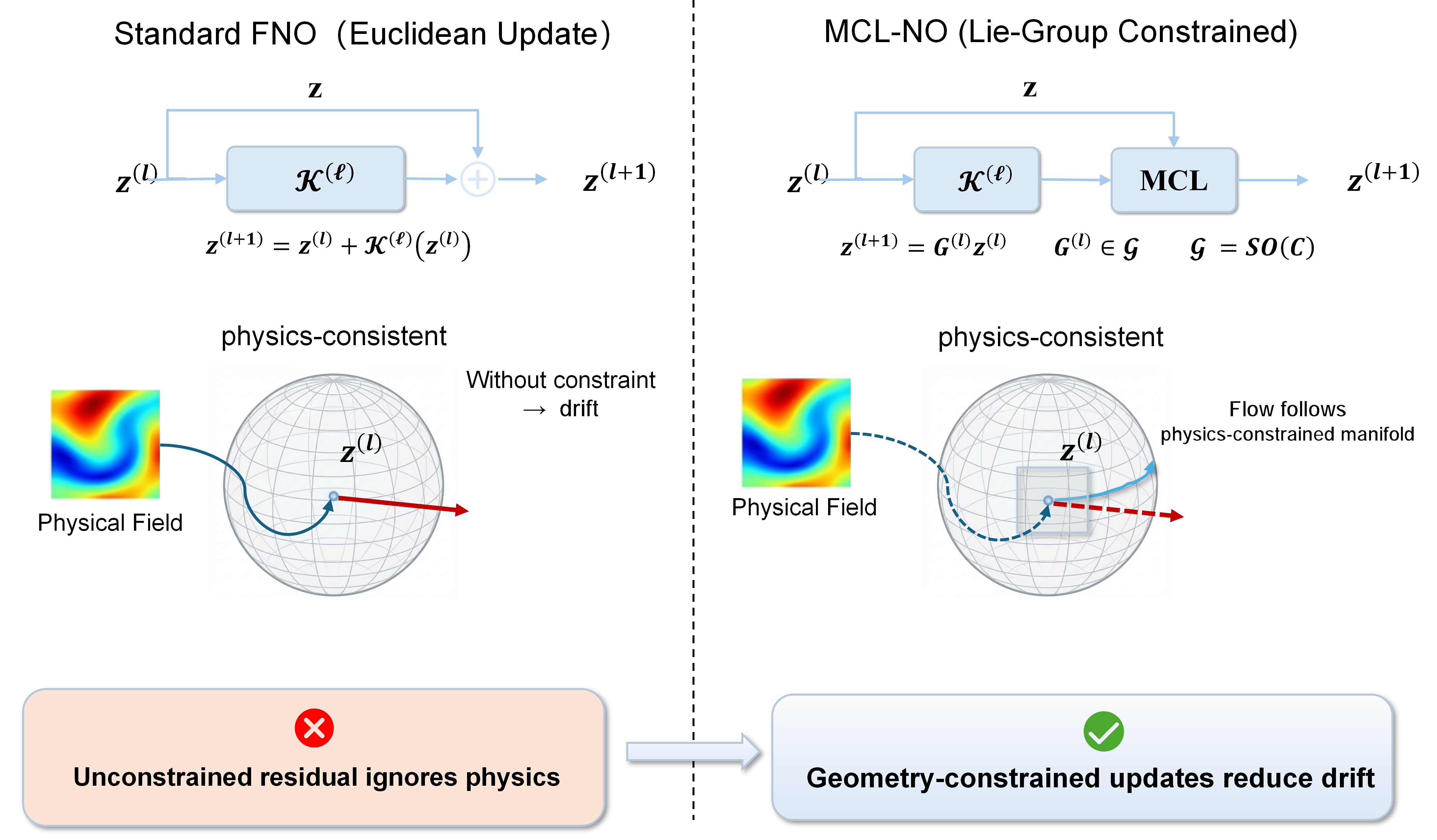

- 现有神经算子在求解偏微分方程时,由于潜在空间更新缺乏几何约束,导致长期预测不稳定。

- 论文提出基于李群的流形约束(MCL)模块,通过李代数参数化约束潜在空间,强制几何归纳偏置。

- 实验表明,MCL模块能显著降低偏微分方程长期预测的误差,且参数增加较少,具有良好的可扩展性。

📝 摘要(中文)

神经算子为以数据驱动方式学习偏微分方程的解提供了一个有效的框架,并且具有分辨率不变性。然而,现有的神经算子在多层迭代和长期预测中常常表现出不稳定性,这源于无约束的欧几里德潜在空间更新,违反了几何和守恒定律。为了解决这个问题,我们提出使用低秩李代数参数化约束流形,对潜在表示执行群作用更新。我们的方法,称为基于李群的流形约束(MCL),作为一个有效的“即插即用”模块,将几何归纳偏置强制施加到现有的神经算子上。在各种偏微分方程(如一维Burgers和二维Navier-Stokes)上进行的大量实验,涵盖了广泛的参数和步长,表明我们的方法有效地降低了30-50%的相对预测误差,而参数增加仅为2.26%。结果表明,我们的方法通过解决神经算子更新中缺失的原则性几何约束,为提高长期预测保真度提供了一个可扩展的解决方案。

🔬 方法详解

问题定义:现有的神经算子在解决偏微分方程时,尤其是在进行多层迭代或长期预测时,容易出现不稳定的情况。这是因为它们通常在无约束的欧几里德空间中进行潜在变量的更新,忽略了物理系统内在的几何结构和守恒定律。这种忽略会导致预测结果偏离真实解,尤其是在长期预测中误差会迅速累积。

核心思路:论文的核心思路是通过引入李群来约束神经算子的潜在空间更新。李群具有良好的几何性质,能够保持系统的对称性和守恒律。具体来说,论文使用低秩李代数来参数化流形,并利用李群在该流形上的作用来更新潜在表示。这样,每次更新都相当于在李群的作用下进行变换,从而保证了潜在空间的几何一致性。

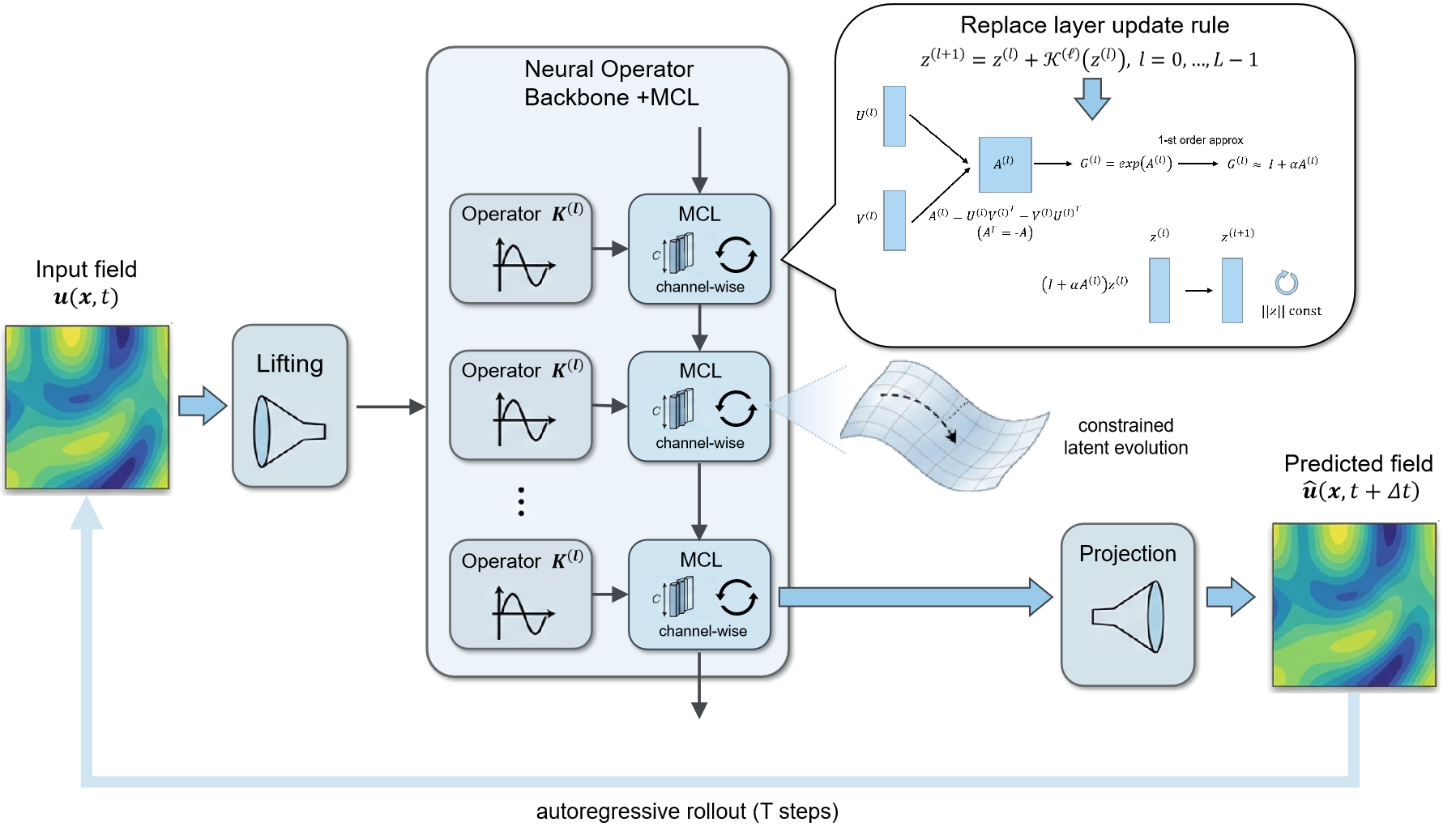

技术框架:MCL模块可以作为一个“即插即用”的组件集成到现有的神经算子中。其主要流程如下:首先,将输入数据编码到潜在空间;然后,利用李代数参数化的流形进行潜在空间的更新;最后,将更新后的潜在表示解码回原始空间,得到预测结果。MCL模块的关键在于李代数的选择和参数化方式,以及如何将李群的作用有效地应用到潜在表示上。

关键创新:论文的关键创新在于将李群理论引入到神经算子的设计中,通过约束潜在空间的几何结构来提高预测的稳定性和准确性。与传统的神经算子相比,MCL模块能够更好地捕捉物理系统的内在规律,从而实现更可靠的长期预测。此外,MCL模块的“即插即用”特性使其易于集成到各种现有的神经算子框架中。

关键设计:论文使用低秩李代数来参数化流形,以降低计算复杂度。具体的李代数选择取决于具体的问题,例如,对于具有旋转对称性的系统,可以选择SO(3)李群。损失函数通常包括预测误差和正则化项,用于约束李代数的参数。网络结构方面,MCL模块可以与各种现有的神经算子结合使用,例如FNO、DeepONet等。

🖼️ 关键图片

📊 实验亮点

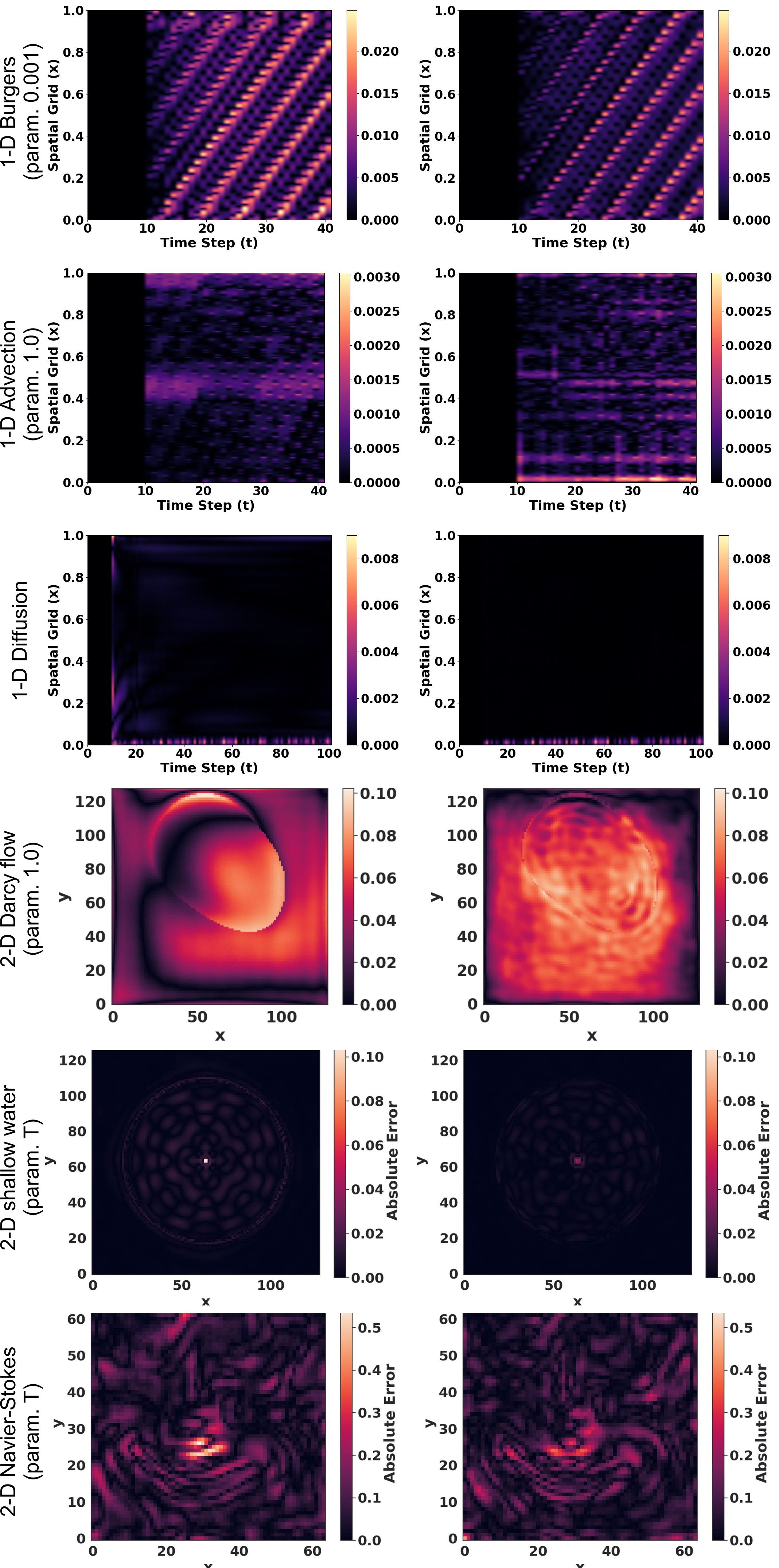

实验结果表明,MCL模块在1-D Burgers和2-D Navier-Stokes方程的预测中,能够有效地降低30-50%的相对预测误差,同时参数增加仅为2.26%。这表明MCL模块能够在显著提高预测精度的同时,保持较低的计算成本。此外,实验还验证了MCL模块在不同参数和步长下的鲁棒性,表明其具有良好的泛化能力。

🎯 应用场景

该研究成果可广泛应用于各种涉及偏微分方程求解的领域,例如流体力学、热传导、电磁学等。通过提高神经算子的长期预测能力,可以更准确地模拟和预测复杂物理系统的行为,从而为工程设计、科学研究和决策提供更可靠的依据。例如,在航空航天领域,可以利用该方法更准确地预测飞行器的气动性能,优化飞行器设计。

📄 摘要(原文)

Neural operators offer an effective framework for learning solutions of partial differential equations for many physical systems in a resolution-invariant and data-driven manner. Existing neural operators, however, often suffer from instability in multi-layer iteration and long-horizon rollout, which stems from the unconstrained Euclidean latent space updates that violate the geometric and conservation laws. To address this challenge, we propose to constrain manifolds with low-rank Lie algebra parameterization that performs group action updates on the latent representation. Our method, termed Manifold Constraining based on Lie group (MCL), acts as an efficient \emph{plug-and-play} module that enforces geometric inductive bias to existing neural operators. Extensive experiments on various partial differential equations, such as 1-D Burgers and 2-D Navier-Stokes, over a wide range of parameters and steps demonstrate that our method effectively lowers the relative prediction error by 30-50\% at the cost of 2.26\% of parameter increase. The results show that our approach provides a scalable solution for improving long-term prediction fidelity by addressing the principled geometric constraints absent in the neural operator updates.