ModalImmune: Immunity Driven Unlearning via Self Destructive Training

作者: Rong Fu, Jia Yee Tan, Wenxin Zhang, Zijian Zhang, Ziming Wang, Zhaolu Kang, Muge Qi, Shuning Zhang, Simon Fong

分类: cs.LG, cs.CL, cs.MM

发布日期: 2026-02-18

备注: 23 pages, 8 figures

💡 一句话要点

ModalImmune:提出一种自毁训练框架,增强多模态系统对模态缺失的鲁棒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 模态缺失 鲁棒性 自毁训练 信息增益

📋 核心要点

- 多模态系统易受模态缺失影响,现有方法难以保证在实际应用中的可靠性。

- ModalImmune通过在训练中主动破坏模态信息,使模型学习对模态缺失具有鲁棒性的联合表示。

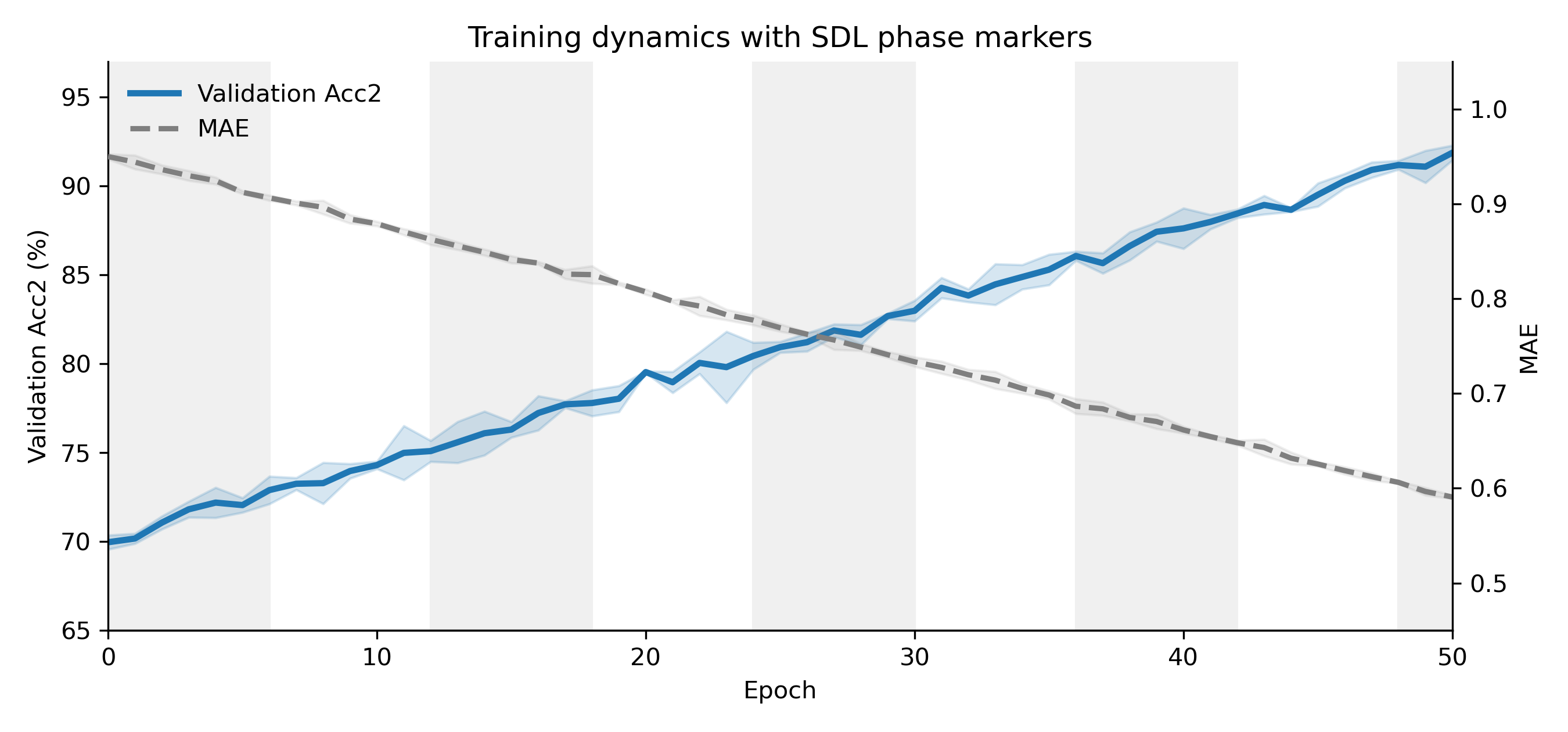

- 实验表明,ModalImmune在提升模型对模态移除和损坏的鲁棒性的同时,保持了收敛稳定性和重建能力。

📝 摘要(中文)

多模态系统在部署时容易遭受输入通道的部分或完全丢失,这会损害其在现实环境中的可靠性。本文提出ModalImmune,一种训练框架,通过在训练期间有意且可控地崩溃选定的模态信息,来强制实现模态免疫,从而使模型学习对破坏性模态影响具有鲁棒性的联合表示。该框架结合了频谱自适应崩溃正则化器、用于目标干预的信息增益引导控制器、用于稳定破坏性更新的曲率感知梯度掩蔽,以及用于自动元参数自适应的认证Neumann截断超梯度程序。在标准多模态基准上的实证评估表明,ModalImmune提高了对模态移除和损坏的弹性,同时保持了收敛稳定性和重建能力。

🔬 方法详解

问题定义:多模态机器学习模型在实际部署中,可能会遇到部分或全部模态数据缺失的情况,导致模型性能显著下降。现有的多模态学习方法通常假设所有模态在训练和推理阶段都是可用的,因此缺乏对模态缺失的鲁棒性。这限制了它们在真实世界场景中的应用。

核心思路:ModalImmune的核心思想是通过在训练过程中主动引入模态信息的缺失或损坏,模拟真实世界中可能出现的模态缺失情况。通过这种“自毁式”训练,模型被迫学习从剩余模态中提取信息,从而提高对模态缺失的鲁棒性。这种方法类似于生物免疫系统,通过暴露于少量病原体来增强免疫力。

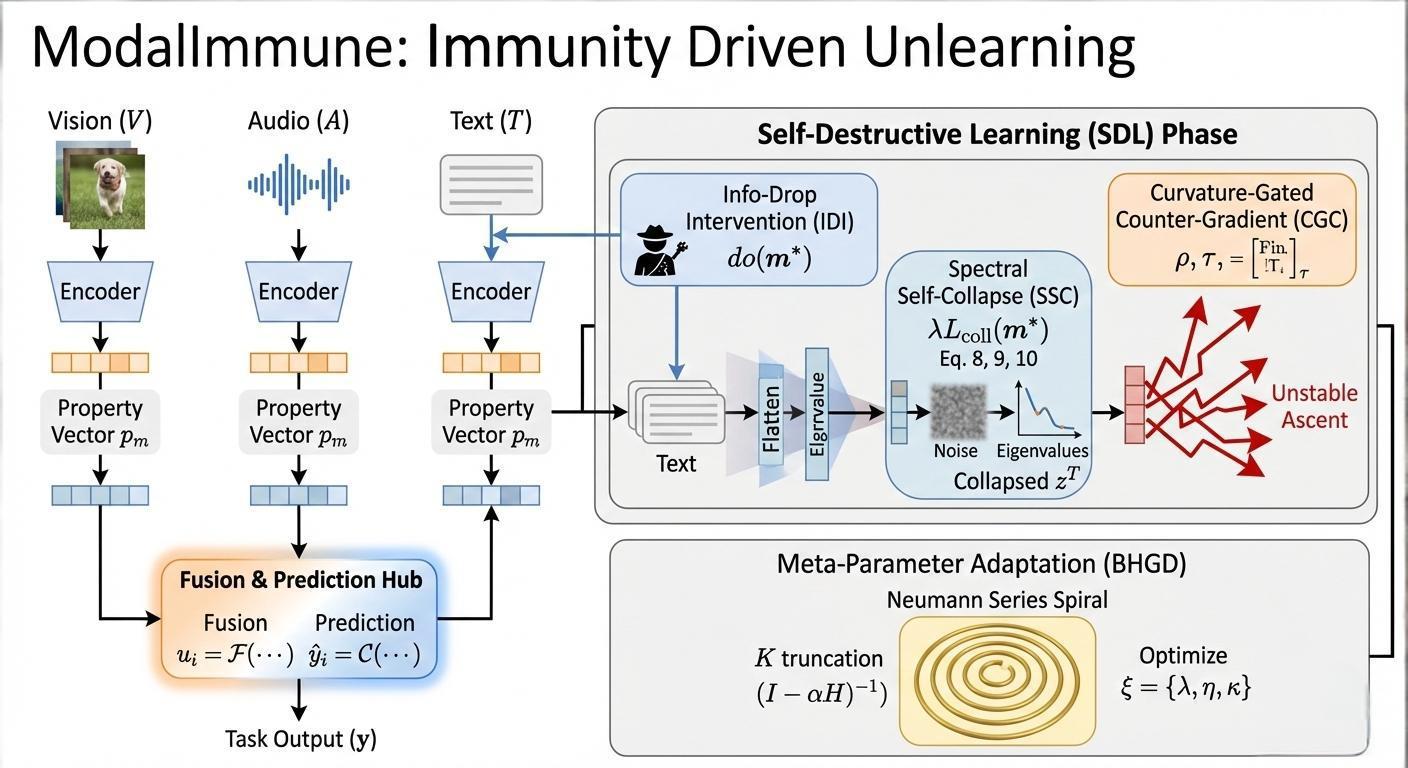

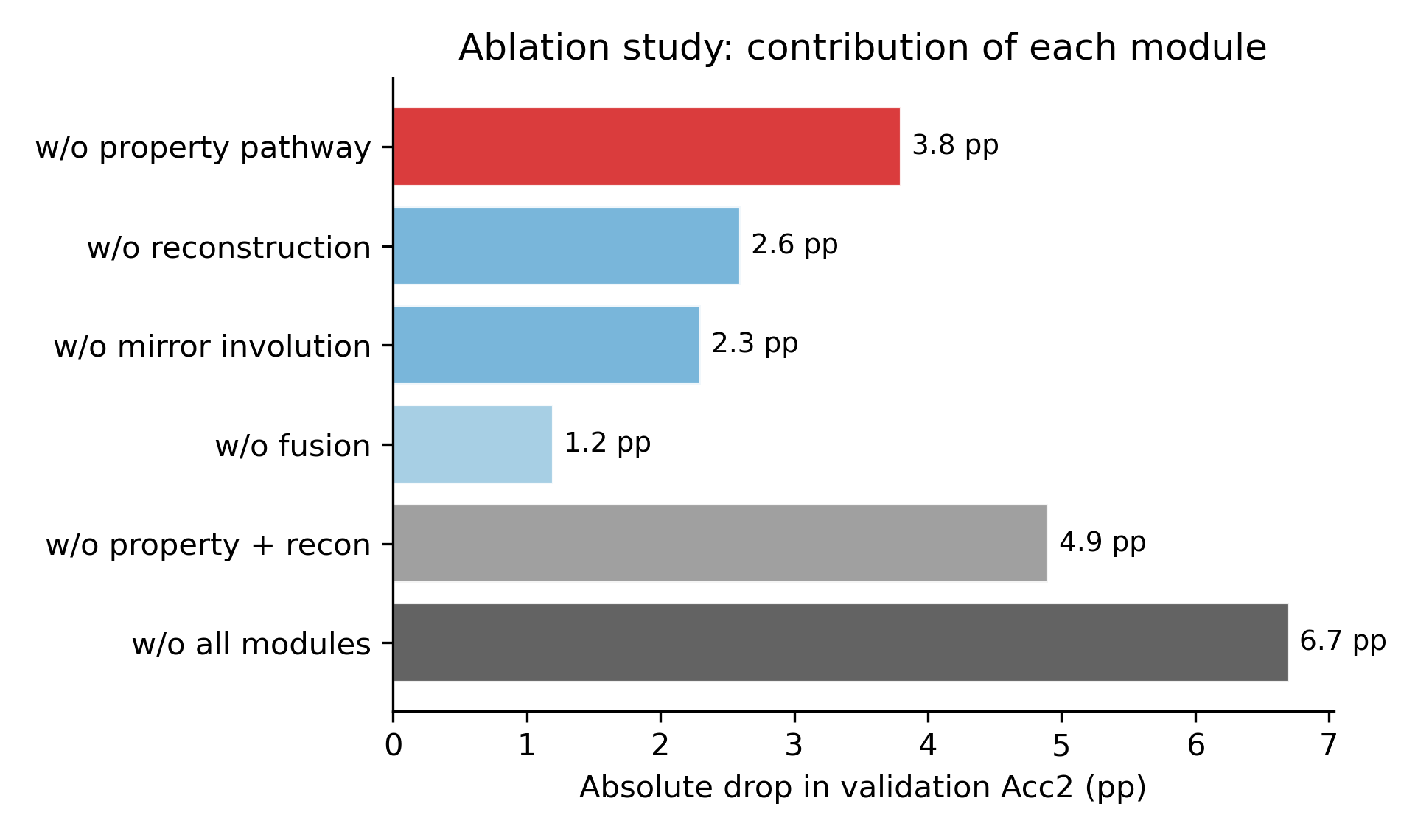

技术框架:ModalImmune框架包含以下几个主要模块:1) 频谱自适应崩溃正则化器:用于控制模态信息的崩溃程度,允许模型在不同模态上学习不同程度的依赖关系。2) 信息增益引导控制器:用于选择性地崩溃对模型性能影响较大的模态信息,从而实现更有针对性的干预。3) 曲率感知梯度掩蔽:用于稳定破坏性更新,防止模型在训练过程中崩溃。4) 认证Neumann截断超梯度程序:用于自动调整框架中的元参数,例如崩溃正则化器的强度。

关键创新:ModalImmune的关键创新在于其主动引入模态缺失的训练策略,以及用于控制和稳定这种训练过程的各种技术手段。与传统的被动式鲁棒性学习方法不同,ModalImmune通过主动干预来增强模型的鲁棒性。此外,框架中的信息增益引导控制器和曲率感知梯度掩蔽等技术,进一步提高了训练的效率和稳定性。

关键设计:频谱自适应崩溃正则化器通过调整不同模态的崩溃概率来实现。信息增益引导控制器使用梯度信息来估计每个模态对模型性能的影响。曲率感知梯度掩蔽使用Hessian矩阵的近似来调整梯度更新的幅度。认证Neumann截断超梯度程序使用Neumann级数来近似超梯度,并使用截断来控制计算复杂度。

🖼️ 关键图片

📊 实验亮点

论文在多个标准多模态基准数据集上进行了实验,结果表明ModalImmune能够显著提高模型对模态移除和损坏的鲁棒性。例如,在某个数据集上,ModalImmune将模型的鲁棒性提高了10%以上,同时保持了模型的原始性能。此外,实验还验证了ModalImmune的收敛稳定性和重建能力。

🎯 应用场景

ModalImmune可应用于各种多模态机器学习任务中,例如多模态情感分析、多模态行为识别、多模态医学诊断等。该方法可以提高这些系统在实际应用中的可靠性和鲁棒性,尤其是在数据质量不佳或模态信息不完整的情况下。未来,该方法可以进一步扩展到更复杂的多模态场景,例如多智能体系统和人机交互。

📄 摘要(原文)

Multimodal systems are vulnerable to partial or complete loss of input channels at deployment, which undermines reliability in real-world settings. This paper presents ModalImmune, a training framework that enforces modality immunity by intentionally and controllably collapsing selected modality information during training so the model learns joint representations that are robust to destructive modality influence. The framework combines a spectrum-adaptive collapse regularizer, an information-gain guided controller for targeted interventions, curvature-aware gradient masking to stabilize destructive updates, and a certified Neumann-truncated hyper-gradient procedure for automatic meta-parameter adaptation. Empirical evaluation on standard multimodal benchmarks demonstrates that ModalImmune improves resilience to modality removal and corruption while retaining convergence stability and reconstruction capacity.