GLM-5: from Vibe Coding to Agentic Engineering

作者: GLM-5 Team, :, Aohan Zeng, Xin Lv, Zhenyu Hou, Zhengxiao Du, Qinkai Zheng, Bin Chen, Da Yin, Chendi Ge, Chengxing Xie, Cunxiang Wang, Gengzheng Pan, Hao Zeng, Haoke Zhang, Haoran Wang, Huilong Chen, Jiajie Zhang, Jian Jiao, Jiaqi Guo, Jingsen Wang, Jingzhao Du, Jinzhu Wu, Kedong Wang, Lei Li, Lin Fan, Lucen Zhong, Mingdao Liu, Mingming Zhao, Pengfan Du, Qian Dong, Rui Lu, Shuang-Li, Shulin Cao, Song Liu, Ting Jiang, Xiaodong Chen, Xiaohan Zhang, Xuancheng Huang, Xuezhen Dong, Yabo Xu, Yao Wei, Yifan An, Yilin Niu, Yitong Zhu, Yuanhao Wen, Yukuo Cen, Yushi Bai, Zhongpei Qiao, Zihan Wang, Zikang Wang, Zilin Zhu, Ziqiang Liu, Zixuan Li, Bojie Wang, Bosi Wen, Can Huang, Changpeng Cai, Chao Yu, Chen Li, Chen Li, Chenghua Huang, Chengwei Hu, Chenhui Zhang, Chenzheng Zhu, Congfeng Yin, Daoyan Lin, Dayong Yang, Di Wang, Ding Ai, Erle Zhu, Fangzhou Yi, Feiyu Chen, Guohong Wen, Hailong Sun, Haisha Zhao, Haiyi Hu, Hanchen Zhang, Hanrui Liu, Hanyu Zhang, Hao Peng, Hao Tai, Haobo Zhang, He Liu, Hongwei Wang, Hongxi Yan, Hongyu Ge, Huan Liu, Huan Liu, Huanpeng Chu, Jia'ni Zhao, Jiachen Wang, Jiajing Zhao, Jiamin Ren, Jiapeng Wang, Jiaxin Zhang, Jiayi Gui, Jiayue Zhao, Jijie Li, Jing An, Jing Li, Jingwei Yuan, Jinhua Du, Jinxin Liu, Junkai Zhi, Junwen Duan, Kaiyue Zhou, Kangjian Wei, Ke Wang, Keyun Luo, Laiqiang Zhang, Leigang Sha, Liang Xu, Lindong Wu, Lintao Ding, Lu Chen, Minghao Li, Nianyi Lin, Pan Ta, Qiang Zou, Rongjun Song, Ruiqi Yang, Shangqing Tu, Shangtong Yang, Shaoxiang Wu, Shengyan Zhang, Shijie Li, Shuang Li, Shuyi Fan, Wei Qin, Wei Tian, Weining Zhang, Wenbo Yu, Wenjie Liang, Xiang Kuang, Xiangmeng Cheng, Xiangyang Li, Xiaoquan Yan, Xiaowei Hu, Xiaoying Ling, Xing Fan, Xingye Xia, Xinyuan Zhang, Xinze Zhang, Xirui Pan, Xunkai Zhang, Yandong Wu, Yanfu Li, Yidong Wang, Yifan Zhu, Yijun Tan, Yilin Zhou, Yiming Pan, Ying Zhang, Yinpei Su, Yipeng Geng, Yipeng Geng, Yong Yan, Yonglin Tan, Yuean Bi, Yuhan Shen, Yuhao Yang, Yujiang Li, Yunan Liu, Yunqing Wang, Yuntao Li, Yurong Wu, Yutao Zhang, Yuxi Duan, Yuxuan Zhang, Zezhen Liu, Zhengtao Jiang, Zhenhe Yan, Zheyu Zhang, Zhixiang Wei, Zhuo Chen, Zhuoer Feng, Zijun Yao, Ziwei Chai, Ziyuan Wang, Zuzhou Zhang, Bin Xu, Minlie Huang, Hongning Wang, Juanzi Li, Yuxiao Dong, Jie Tang

分类: cs.LG, cs.CL

发布日期: 2026-02-17

🔗 代码/项目: GITHUB

💡 一句话要点

GLM-5:从Vibe Coding到Agentic Engineering的范式转变,提升软件工程能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 软件工程 强化学习 异步训练 长上下文 代码生成 Agentic Engineering

📋 核心要点

- 现有模型在处理复杂软件工程任务时,面临训练和推理成本高昂、长上下文信息利用不足等挑战。

- GLM-5通过DSA降低训练和推理成本,并采用异步强化学习基础设施提升模型对齐和自主性。

- GLM-5在实际编码任务中超越了之前的基线,展现了在端到端软件工程挑战中前所未有的能力。

📝 摘要(中文)

GLM-5是一个新一代的基础模型,旨在将范式从Vibe Coding转变为Agentic Engineering。在先前模型Agentic、推理和编码(ARC)能力的基础上,GLM-5采用DSA显著降低了训练和推理成本,同时保持了长上下文的保真度。为了提升模型对齐和自主性,我们实现了一种新的异步强化学习基础设施,通过将生成与训练解耦,大幅提高了后训练效率。此外,我们提出了新的异步Agent RL算法,进一步提高了RL质量,使模型能够更有效地从复杂的、长期的交互中学习。通过这些创新,GLM-5在主要的开放基准测试中实现了最先进的性能。最关键的是,GLM-5在实际编码任务中表现出前所未有的能力,在处理端到端软件工程挑战方面超越了之前的基线。

🔬 方法详解

问题定义:现有的大语言模型在软件工程领域应用时,面临着两个主要问题。一是训练和推理成本过高,特别是对于长上下文任务。二是模型对齐和自主性不足,难以胜任复杂的、长期的软件工程任务。传统的Vibe Coding方式依赖人工干预,效率低下且难以扩展。

核心思路:GLM-5的核心思路是将Vibe Coding范式转变为Agentic Engineering。通过引入DSA(具体含义未知)来降低训练和推理成本,同时保持长上下文的保真度。此外,采用异步强化学习基础设施和新的异步Agent RL算法来提升模型对齐和自主性,使其能够更好地从复杂的交互中学习。

技术框架:GLM-5的技术框架主要包含三个关键部分:DSA机制(具体细节未知)、异步强化学习基础设施和异步Agent RL算法。异步强化学习基础设施将生成与训练解耦,提高了后训练效率。异步Agent RL算法则进一步提升了RL质量,使模型能够更好地学习长期交互。整体流程可能是先通过DSA进行预训练,然后利用异步强化学习进行微调,最终应用于实际的软件工程任务。

关键创新:GLM-5的关键创新在于其DSA机制、异步强化学习基础设施和异步Agent RL算法的结合。DSA机制降低了训练和推理成本,异步强化学习基础设施提高了后训练效率,异步Agent RL算法提升了模型对齐和自主性。这种结合使得GLM-5在软件工程任务中表现出更强的能力。

关键设计:论文中没有详细描述DSA机制、异步强化学习基础设施和异步Agent RL算法的具体技术细节,例如DSA的具体实现方式、异步强化学习中的奖励函数设计、Agent RL算法的网络结构等。这些细节需要在阅读论文原文或相关代码后才能了解。

🖼️ 关键图片

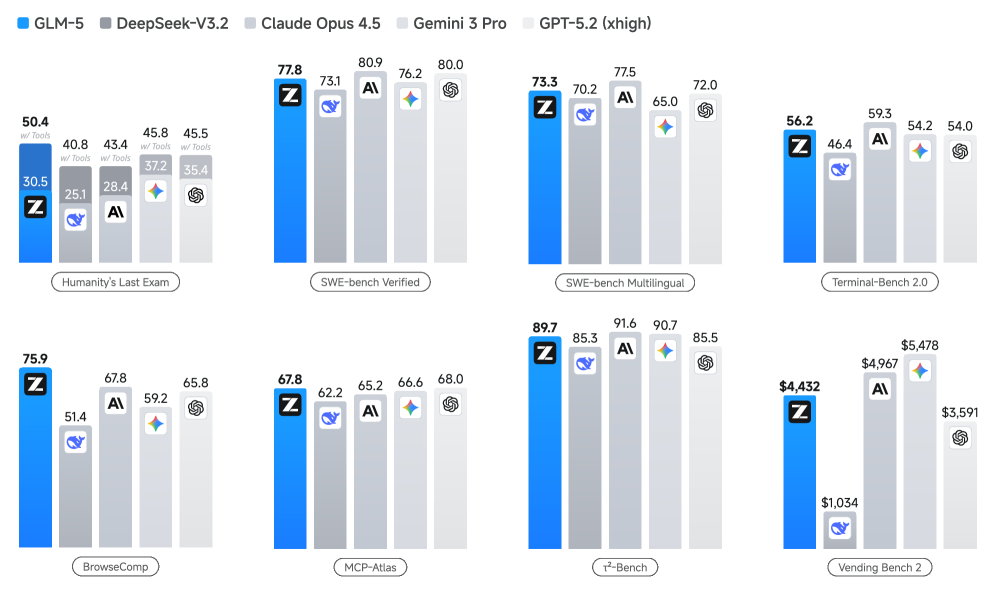

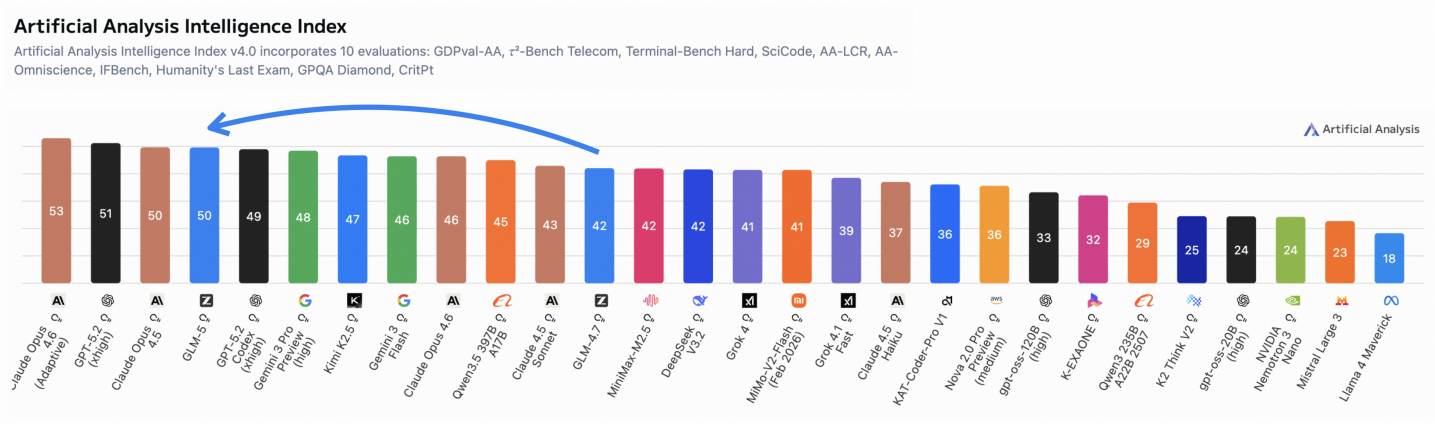

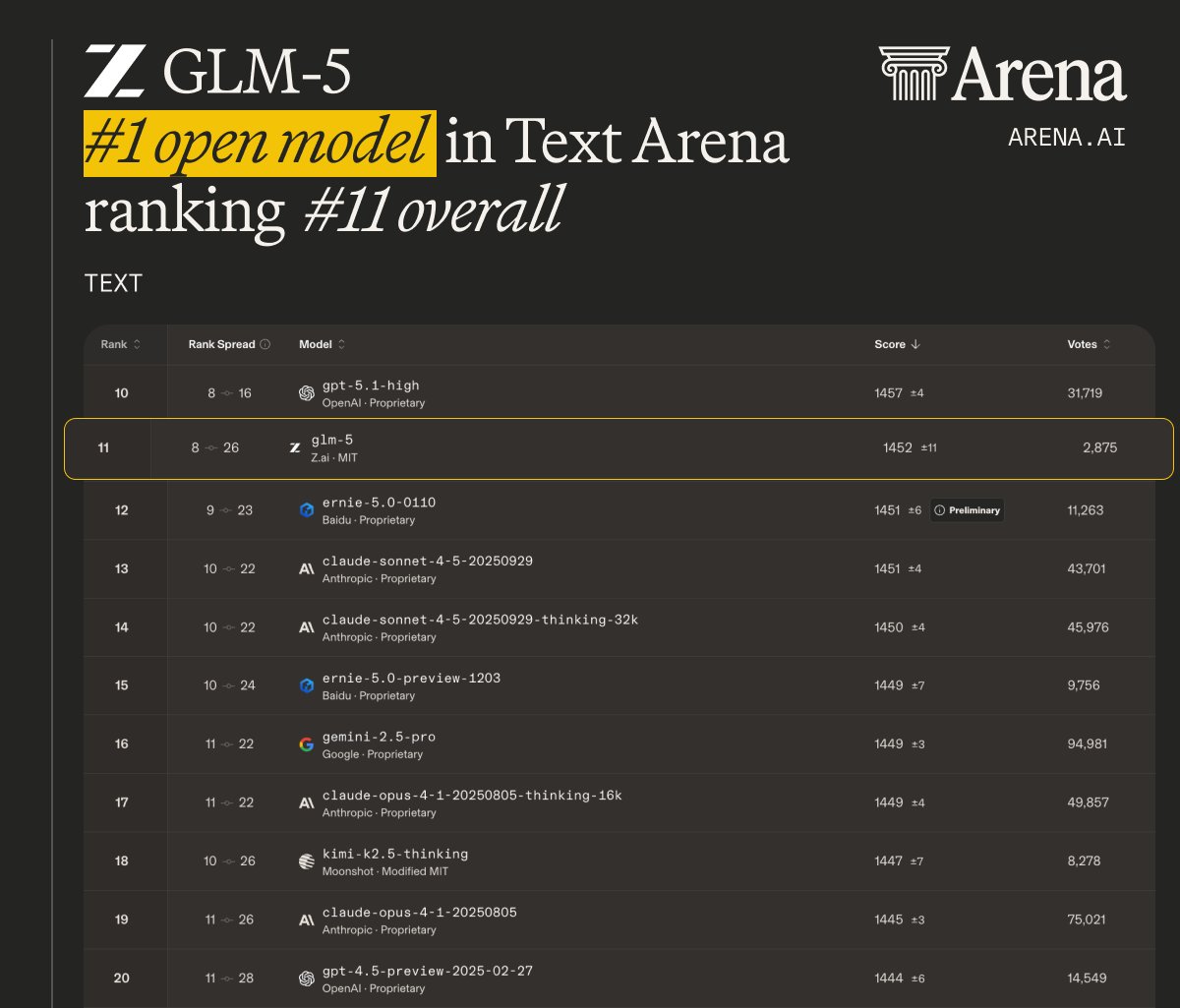

📊 实验亮点

GLM-5在主要的开放基准测试中实现了最先进的性能。更重要的是,GLM-5在实际编码任务中表现出前所未有的能力,在处理端到端软件工程挑战方面超越了之前的基线。具体的性能数据和提升幅度需要在阅读论文原文后才能获取。

🎯 应用场景

GLM-5在软件工程领域具有广泛的应用前景,例如自动化代码生成、软件缺陷检测与修复、软件项目管理等。它可以帮助开发者提高开发效率,降低开发成本,并提升软件质量。未来,GLM-5有望成为软件工程领域的重要基础设施。

📄 摘要(原文)

We present GLM-5, a next-generation foundation model designed to transition the paradigm of vibe coding to agentic engineering. Building upon the agentic, reasoning, and coding (ARC) capabilities of its predecessor, GLM-5 adopts DSA to significantly reduce training and inference costs while maintaining long-context fidelity. To advance model alignment and autonomy, we implement a new asynchronous reinforcement learning infrastructure that drastically improves post-training efficiency by decoupling generation from training. Furthermore, we propose novel asynchronous agent RL algorithms that further improve RL quality, enabling the model to learn from complex, long-horizon interactions more effectively. Through these innovations, GLM-5 achieves state-of-the-art performance on major open benchmarks. Most critically, GLM-5 demonstrates unprecedented capability in real-world coding tasks, surpassing previous baselines in handling end-to-end software engineering challenges. Code, models, and more information are available at https://github.com/zai-org/GLM-5.