ROAST: Rollout-based On-distribution Activation Steering Technique

作者: Xuanbo Su, Hao Luo, Yingfang Zhang, Lijun Zhang

分类: cs.LG, cs.CL

发布日期: 2026-02-15

💡 一句话要点

提出ROAST:一种基于模型自身rollout的LLM激活调控技术,提升任务性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 激活调控 大型语言模型 分布内学习 Rollout 连续软缩放 分组均值归一化 参数高效

📋 核心要点

- 现有激活调控方法依赖非分布内监督和离散掩码,导致干预效果不稳定。

- ROAST利用模型自身rollout估计调控方向,并采用连续软缩放和分组均值归一化。

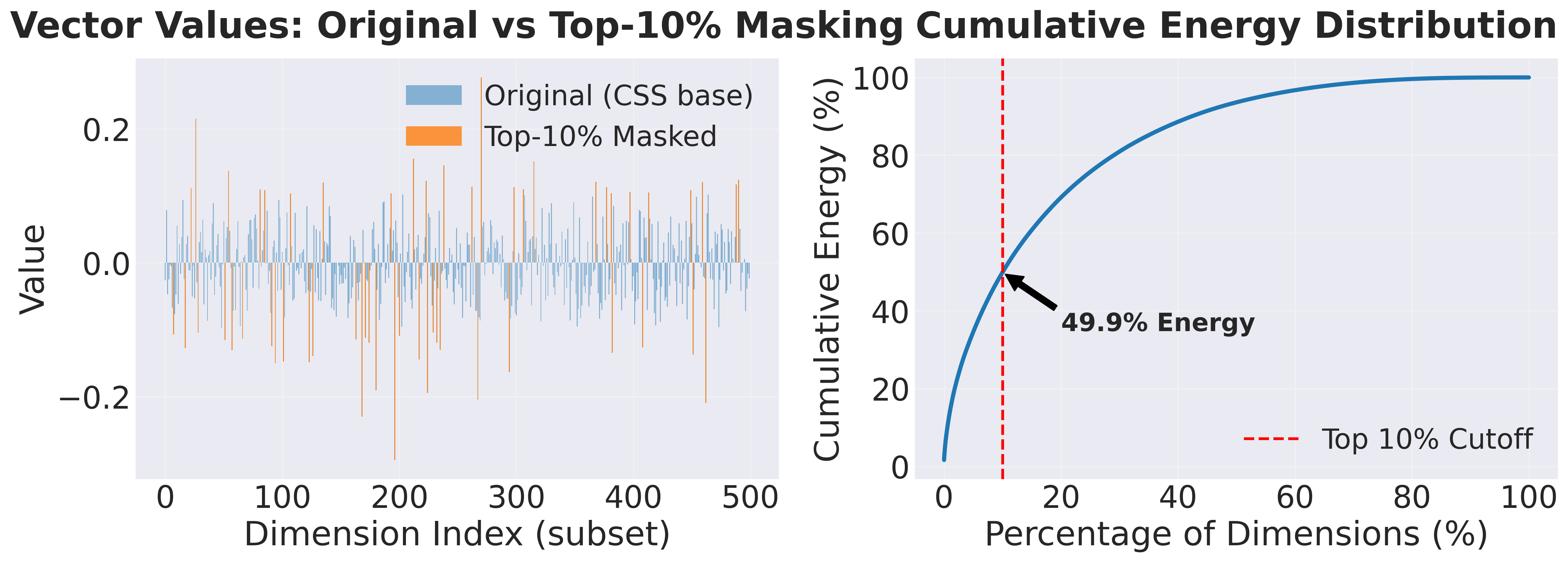

- 实验表明,ROAST在多个模型和任务上均有显著提升,且CSS能更好保留激活能量。

📝 摘要(中文)

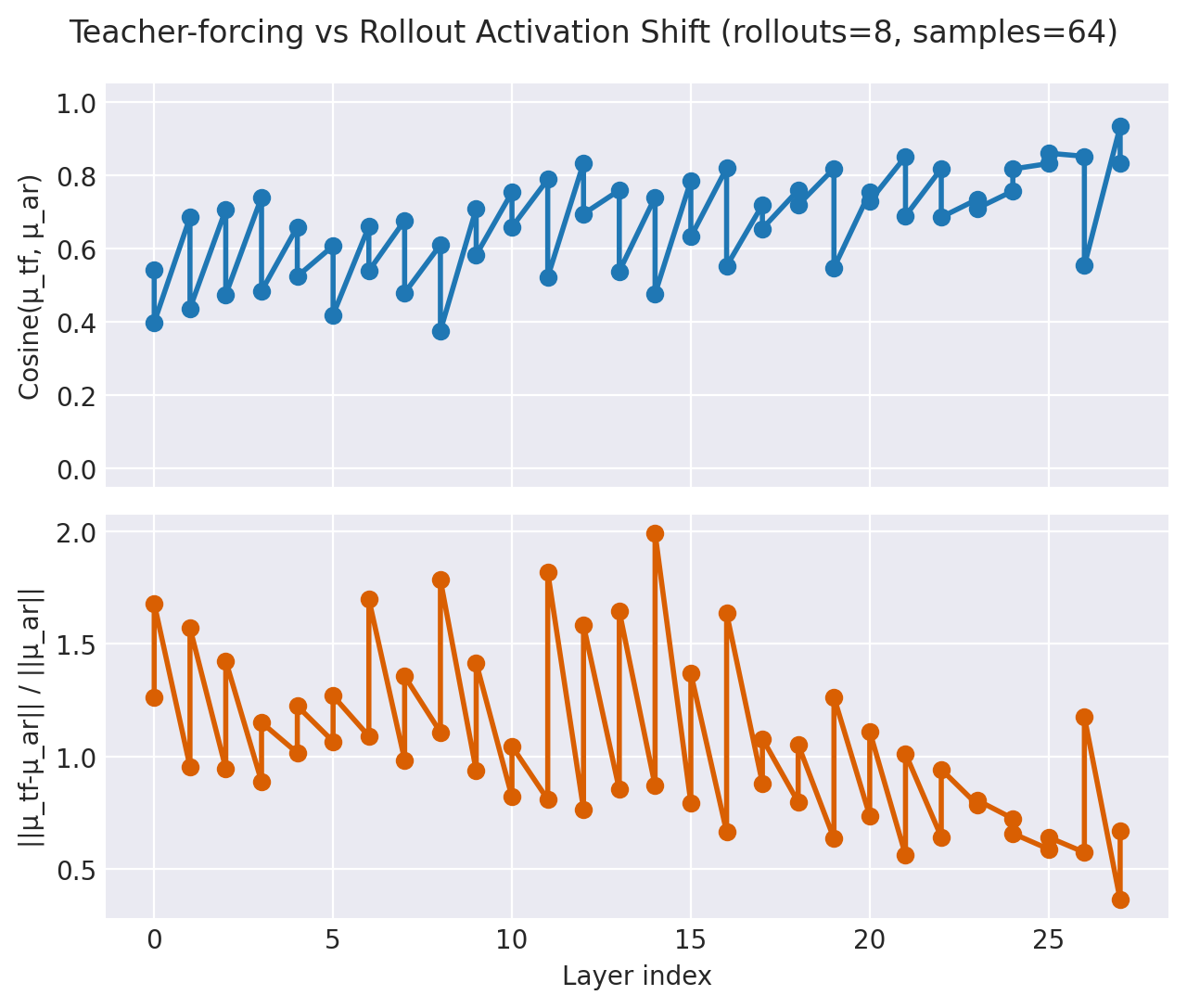

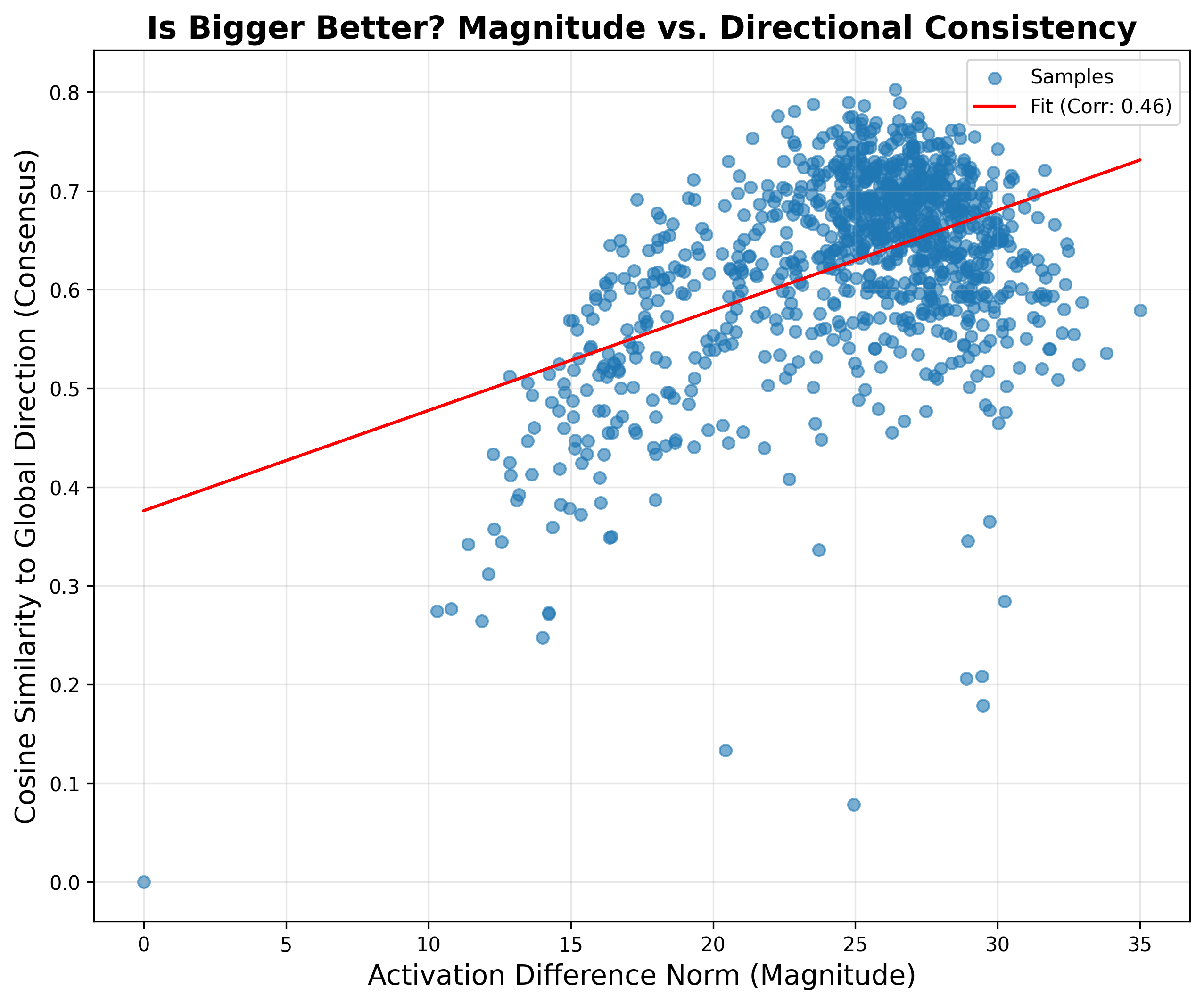

激活调控提供了一种在推理时对大型语言模型(LLMs)进行参数高效控制的方法,但许多方法依赖于非分布内的监督和离散掩码,导致干预脆弱。我们提出了ROAST(Rollout-based On-distribution Activation Steering Technique),它通过ROC从模型自身的分布内rollout估计调控方向,并通过连续软缩放(CSS)和分组均值归一化避免了硬稀疏化。我们的经验分析表明,虽然激活幅度与方向一致性适度相关,但幅度差异显著,且通常与语义质量不成比例。这表明,如果不进行适当的归一化,高幅度激活可能会主导全局调控方向。为了解决这个问题,ROAST采用分组归一化来平衡样本间的贡献,从而确保更稳健地估计共识调控方向。在不同模型(0.6B到32B)上,ROAST始终提高了各种任务的性能(例如,Qwen3-0.6B在GSM8K上+9.7%,GLM4-32B在TruthfulQA上+12.1%),分析表明CSS更好地保留了激活能量。

🔬 方法详解

问题定义:现有激活调控方法依赖于非分布内的数据进行监督,并且使用离散的掩码操作,这导致调控策略的泛化能力较差,容易受到噪声干扰,并且可能引入偏差。此外,激活幅度与语义质量不成比例,直接使用激活幅度可能导致调控方向被少数高幅度激活主导。

核心思路:ROAST的核心思路是利用模型自身的分布内数据(rollout)来估计调控方向,避免使用外部数据带来的偏差。同时,通过连续软缩放(CSS)和分组均值归一化来平衡不同激活的贡献,防止高幅度激活主导调控方向,从而提高调控的鲁棒性和有效性。

技术框架:ROAST的技术框架主要包含以下几个步骤:1. 使用模型自身的rollout生成数据。2. 使用ROC(Receiver Operating Characteristic)分析估计调控方向。3. 使用连续软缩放(CSS)来平滑激活值的贡献。4. 使用分组均值归一化来平衡不同样本的贡献。5. 将调控方向应用于模型的激活层,从而实现对模型行为的控制。

关键创新:ROAST的关键创新在于:1. 使用模型自身的rollout进行调控方向估计,避免了外部数据的偏差。2. 提出了连续软缩放(CSS)方法,避免了硬稀疏化带来的信息损失。3. 引入了分组均值归一化,平衡了不同样本的贡献,提高了调控的鲁棒性。

关键设计:ROAST的关键设计包括:1. rollout策略的选择,需要保证生成数据的质量和多样性。2. ROC分析的阈值选择,需要平衡调控方向的准确性和覆盖率。3. CSS的缩放参数,需要根据具体任务进行调整,以平衡激活值的贡献。4. 分组均值归一化的分组策略,需要根据模型的结构和任务特点进行选择。

🖼️ 关键图片

📊 实验亮点

ROAST在多个模型(0.6B到32B)和任务上取得了显著的性能提升。例如,在Qwen3-0.6B模型上,ROAST在GSM8K数据集上提升了9.7%。在GLM4-32B模型上,ROAST在TruthfulQA数据集上提升了12.1%。实验结果表明,ROAST能够有效地提高LLM的性能,并且具有良好的泛化能力。

🎯 应用场景

ROAST可应用于各种需要对LLM行为进行细粒度控制的场景,例如:安全对齐、风格迁移、知识注入、以及提升模型在特定任务上的性能。该方法能够提高LLM的可控性和可靠性,降低模型产生有害或不准确信息的风险,并促进LLM在更广泛领域的应用。

📄 摘要(原文)

Activation steering provides parameter-efficient control over large language models (LLMs) at inference time, but many methods rely on off-distribution supervision and discrete masking, leading to brittle interventions. We propose ROAST (Rollout-based On-distribution Activation Steering Technique), which estimates steering directions from the model's own on-distribution rollouts via ROC and avoids hard sparsification via Continuous Soft Scaling (CSS) and Grouped Mean Normalization. Our empirical analysis reveals that while activation magnitude correlates moderately with directional consistency, the variance in magnitude is significant and often disproportionate to semantic quality. This suggests that high-magnitude activations risk dominating the global steering direction if not properly normalized. To address this, ROAST employs grouped normalization to balance contributions across samples, ensuring a more robust estimation of the consensus steering direction. Across models (0.6B to 32B), ROAST consistently improves performance on diverse tasks (e.g., +9.7% on GSM8K for Qwen3-0.6B and +12.1% on TruthfulQA for GLM4-32B), and analyses show that CSS better preserves activation energy.