EIDOS: Latent-Space Predictive Learning for Time Series Foundation Models

作者: Xinxing Zhou, Qingren Yao, Yiji Zhao, Chenghao Liu, Flora Salim, Xiaojie Yuan, Yanlong Wen, Ming Jin

分类: cs.LG, cs.AI

发布日期: 2026-02-15

💡 一句话要点

EIDOS:面向时间序列基础模型的潜空间预测学习框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列 基础模型 潜空间学习 预测学习 Transformer

📋 核心要点

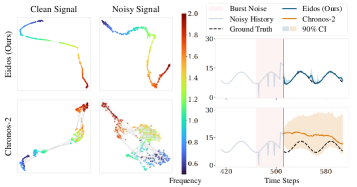

- 现有时间序列基础模型直接预测未来值,导致学习到的潜在表示缺乏结构性,易受噪声干扰。

- EIDOS通过预测潜在空间演化进行预训练,鼓励模型学习结构化和时间连贯的潜在状态。

- EIDOS在GIFT-Eval基准测试中表现出色,验证了其在学习鲁棒时间序列表示方面的有效性。

📝 摘要(中文)

大多数时间序列基础模型通过直接预测未来观测值进行预训练,这通常导致结构 слабо 的潜在表示,捕获的是表面噪声而非连贯且可预测的时间动态。本文提出了EIDOS,一个基础模型家族,它将预训练从未来值预测转移到潜空间预测学习。我们训练一个因果Transformer来预测潜在表示的演变,鼓励结构化和时间连贯的潜在状态的出现。为了确保潜空间学习的稳定目标,我们设计了一个轻量级的聚合分支来构建目标表示。EIDOS通过一个联合目标进行优化,该目标集成了潜空间对齐、将表示锚定到输入信号的观测基础以及直接预测监督。在GIFT-Eval基准测试中,EIDOS减轻了表示空间中的结构碎片,并实现了最先进的性能。这些结果表明,约束模型学习可预测的潜在动态是朝着更鲁棒和可靠的时间序列基础模型迈出的有原则的一步。

🔬 方法详解

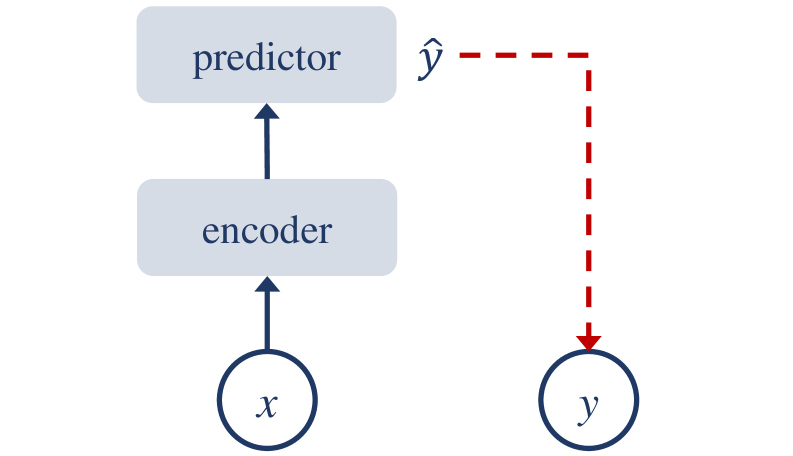

问题定义:现有时间序列基础模型通常直接预测未来的观测值,这种方法容易受到噪声的影响,并且学习到的潜在表示往往缺乏结构性和时间连贯性。这导致模型难以捕捉到时间序列数据中潜在的动态模式,从而影响了模型的泛化能力和预测准确性。现有方法的痛点在于无法有效地提取和利用时间序列数据中蕴含的深层结构信息。

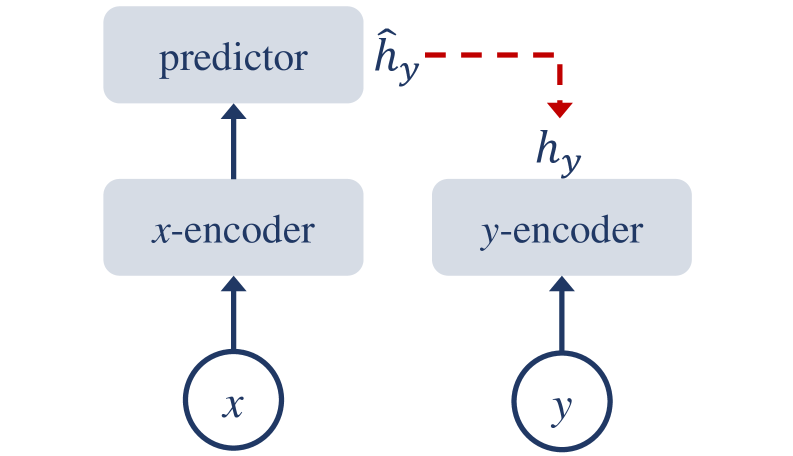

核心思路:EIDOS的核心思路是将预训练的目标从直接预测未来观测值转移到预测潜在空间的演化。通过训练模型来预测潜在表示的变化,EIDOS鼓励模型学习到更加结构化和时间连贯的潜在状态。这种方法能够更好地捕捉时间序列数据中的动态模式,并且对噪声具有更强的鲁棒性。同时,EIDOS还引入了一个轻量级的聚合分支来构建稳定的目标表示,从而进一步提升了模型的学习效果。

技术框架:EIDOS的整体架构包括三个主要模块:编码器、因果Transformer和聚合分支。编码器将输入的时间序列数据映射到潜在空间中。因果Transformer负责预测潜在表示的演化,即根据过去的潜在状态预测未来的潜在状态。聚合分支用于构建稳定的目标表示,为潜空间预测提供可靠的监督信号。整个框架通过一个联合目标进行优化,该目标集成了潜空间对齐、观测基础和直接预测监督。

关键创新:EIDOS最重要的技术创新点在于将预训练的目标从未来值预测转移到潜空间预测学习。这种方法能够更好地捕捉时间序列数据中的动态模式,并且对噪声具有更强的鲁棒性。此外,EIDOS还引入了一个轻量级的聚合分支来构建稳定的目标表示,从而进一步提升了模型的学习效果。与现有方法相比,EIDOS能够学习到更加结构化和时间连贯的潜在表示,从而提升了模型的泛化能力和预测准确性。

关键设计:EIDOS的关键设计包括以下几个方面:1) 使用因果Transformer来预测潜在表示的演化,确保模型只能利用过去的信息进行预测;2) 设计了一个轻量级的聚合分支来构建稳定的目标表示,为潜空间预测提供可靠的监督信号;3) 使用一个联合目标进行优化,该目标集成了潜空间对齐、观测基础和直接预测监督。具体的损失函数包括潜空间对齐损失、观测损失和预测损失。网络结构方面,编码器可以使用各种时间序列模型,如Transformer或RNN。聚合分支可以使用简单的线性层或卷积层。

🖼️ 关键图片

📊 实验亮点

EIDOS在GIFT-Eval基准测试中取得了state-of-the-art的性能,证明了其有效性。实验结果表明,EIDOS能够减轻表示空间中的结构碎片,学习到更加结构化和时间连贯的潜在表示。相较于其他基线模型,EIDOS在多个时间序列预测任务上取得了显著的提升。

🎯 应用场景

EIDOS具有广泛的应用前景,包括但不限于:金融时间序列分析(股票价格预测、风险管理)、医疗健康(疾病预测、生理信号分析)、工业生产(设备故障诊断、过程优化)、交通运输(交通流量预测、智能驾驶)等领域。通过学习鲁棒的时间序列表示,EIDOS能够提升各种下游任务的性能,为实际应用带来更大的价值。

📄 摘要(原文)

Most time series foundation models are pretrained by directly predicting future observations, which often yields weakly structured latent representations that capture surface noise rather than coherent and predictable temporal dynamics. In this work, we introduce EIDOS, a foundation model family that shifts pretraining from future value prediction to latent-space predictive learning. We train a causal Transformer to predict the evolution of latent representations, encouraging the emergence of structured and temporally coherent latent states. To ensure stable targets for latent-space learning, we design a lightweight aggregation branch to construct target representations. EIDOS is optimized via a joint objective that integrates latent-space alignment, observational grounding to anchor representations to the input signal, and direct forecasting supervision. On the GIFT-Eval benchmark, EIDOS mitigates structural fragmentation in the representation space and achieves state-of-the-art performance. These results demonstrate that constraining models to learn predictable latent dynamics is a principled step toward more robust and reliable time series foundation models.