NeuroMambaLLM: Dynamic Graph Learning of fMRI Functional Connectivity in Autistic Brains Using Mamba and Language Model Reasoning

作者: Yasaman Torabi, Parsa Razmara, Hamed Ajorlou, Bardia Baraeinejad

分类: eess.IV, cs.LG

发布日期: 2026-02-14

💡 一句话要点

NeuroMambaLLM:利用Mamba和语言模型推理动态学习自闭症大脑的fMRI功能连接

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: fMRI分析 功能连接 动态图学习 状态空间模型 大型语言模型 自闭症诊断 神经影像 LoRA微调

📋 核心要点

- 现有fMRI分析主要依赖静态功能连接,忽略了自闭症等神经发育障碍中重要的瞬时神经动态。

- NeuroMambaLLM通过动态潜在图学习和选择性状态空间建模,结合LLM进行诊断分类和语言推理。

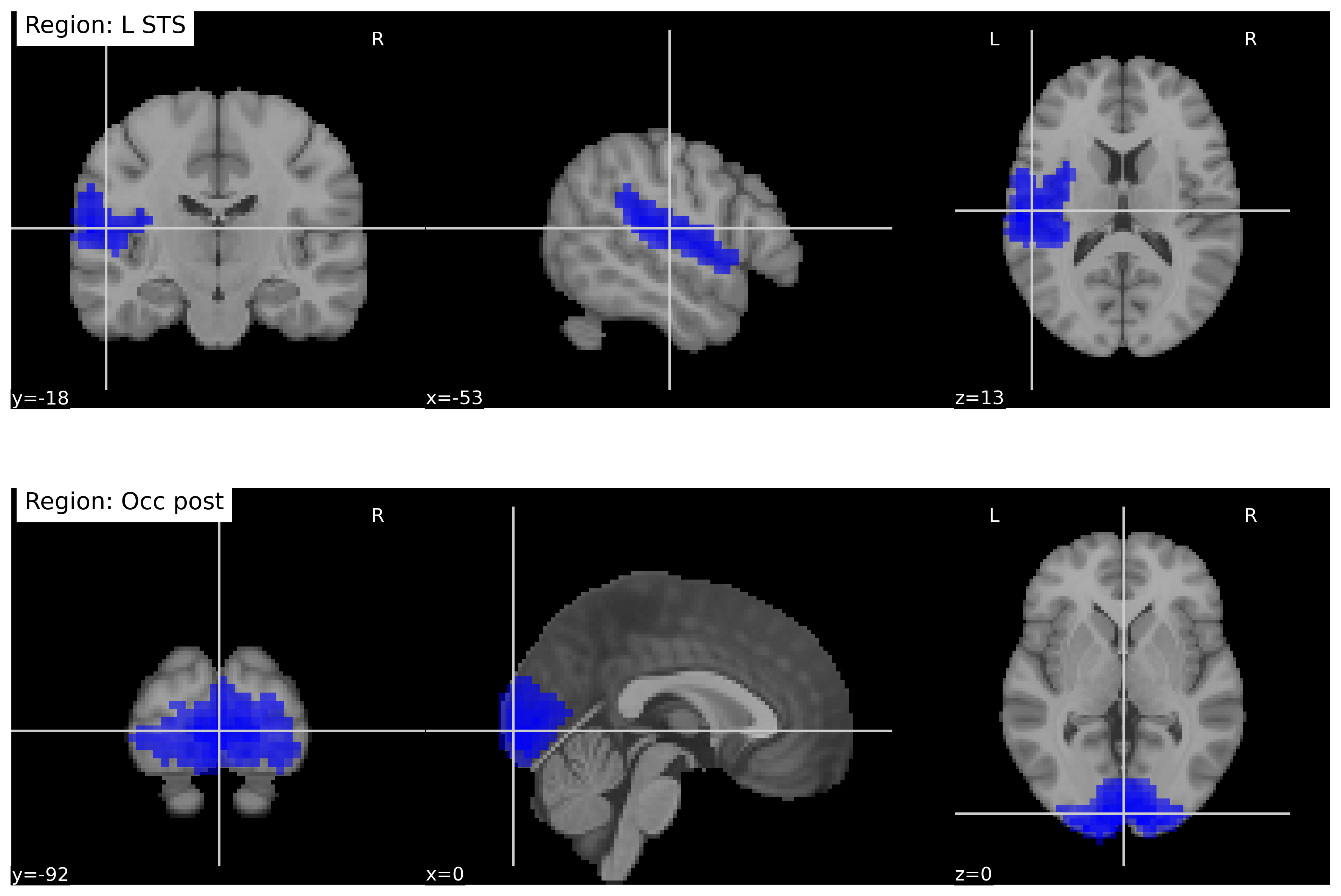

- 该方法从原始BOLD时间序列动态学习功能连接,抑制运动伪影,并利用LLM生成临床报告。

📝 摘要(中文)

大型语言模型(LLM)已展示出跨多模态领域的强大语义推理能力。然而,它们与基于图的脑连接模型集成仍然有限。此外,现有的大多数fMRI分析方法依赖于静态功能连接(FC)表示,这掩盖了神经发育障碍(如自闭症)的关键瞬时神经动态。最近的状态空间方法,包括Mamba,可以有效地建模时间结构,但通常用作独立的特征提取器,而没有明确的高级推理。我们提出了NeuroMambaLLM,一个端到端框架,它集成了动态潜在图学习和选择性状态空间时间建模与LLM。该方法从原始血氧水平依赖(BOLD)时间序列动态学习功能连接,用自适应潜在连接取代固定的相关图,同时抑制与运动相关的伪影并捕获长程时间依赖性。由此产生的动态大脑表示被投影到LLM模型的嵌入空间中,其中基础语言模型保持冻结,并训练轻量级低秩适应(LoRA)模块以实现参数高效对齐。这种设计使LLM能够执行诊断分类和基于语言的推理,从而分析动态fMRI模式并生成具有临床意义的文本报告。

🔬 方法详解

问题定义:现有fMRI分析方法主要依赖静态功能连接(FC)表示,无法捕捉大脑活动的瞬时动态变化,这对于理解自闭症等神经发育障碍至关重要。此外,现有方法在整合大型语言模型(LLM)进行高级推理方面存在局限性。

核心思路:NeuroMambaLLM的核心思路是利用Mamba状态空间模型动态学习fMRI数据的功能连接,并将其与LLM相结合,实现诊断分类和语言推理。通过动态图学习,模型能够捕捉大脑活动的瞬时变化,并通过LLM进行高级语义分析,生成具有临床意义的报告。

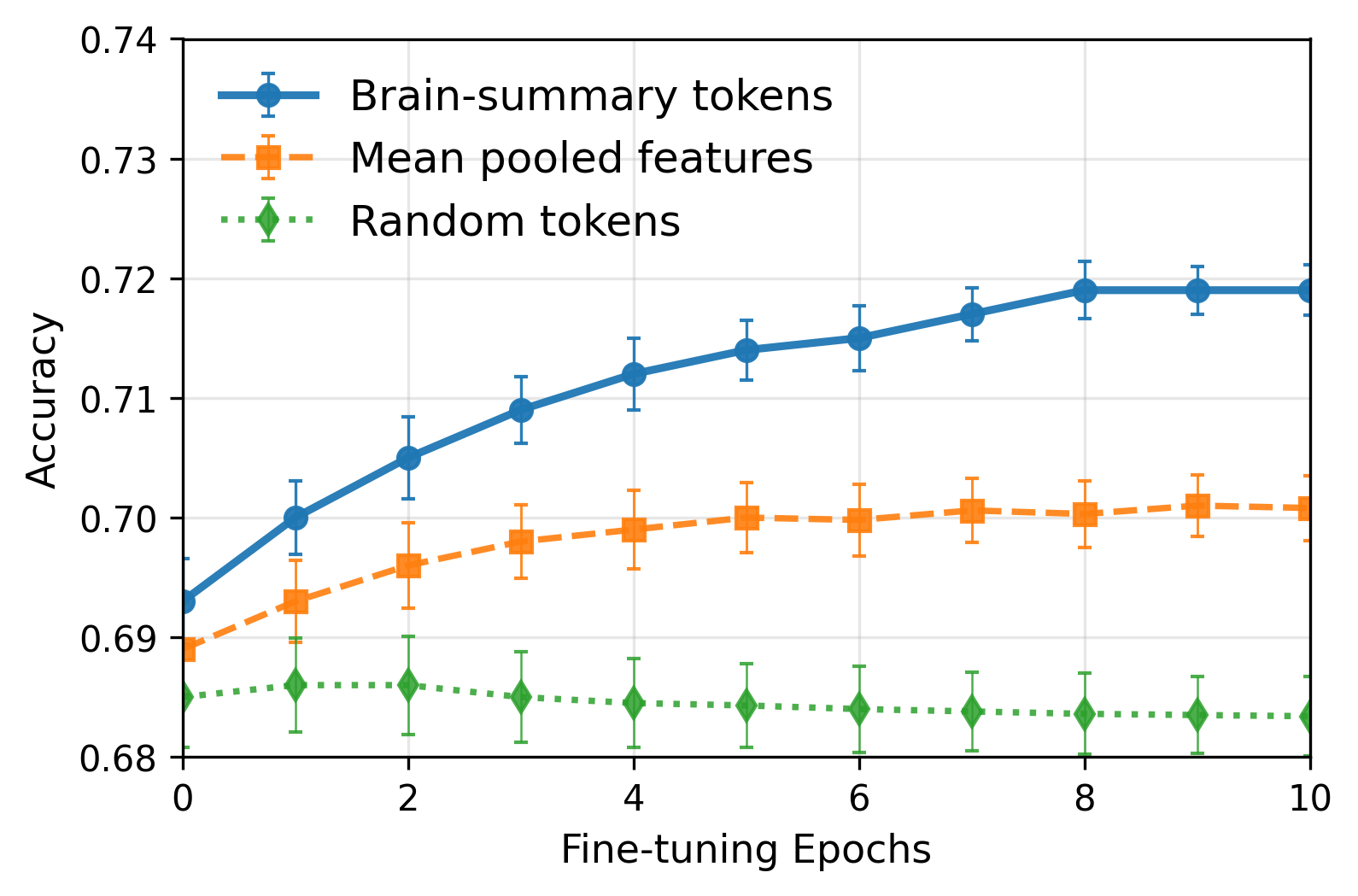

技术框架:NeuroMambaLLM包含以下主要模块:1) 动态图学习模块,从原始BOLD时间序列中学习动态功能连接;2) Mamba状态空间模型,用于捕捉时间依赖性;3) LLM模块,用于诊断分类和语言推理。动态图学习的结果被投影到LLM的嵌入空间中,并通过LoRA进行参数高效的对齐。整个框架是端到端可训练的。

关键创新:该方法的主要创新点在于:1) 提出了一个端到端的框架,将动态图学习、状态空间模型和LLM相结合;2) 利用Mamba模型动态学习fMRI数据的功能连接,捕捉大脑活动的瞬时变化;3) 通过LoRA进行参数高效的LLM对齐,降低了训练成本。

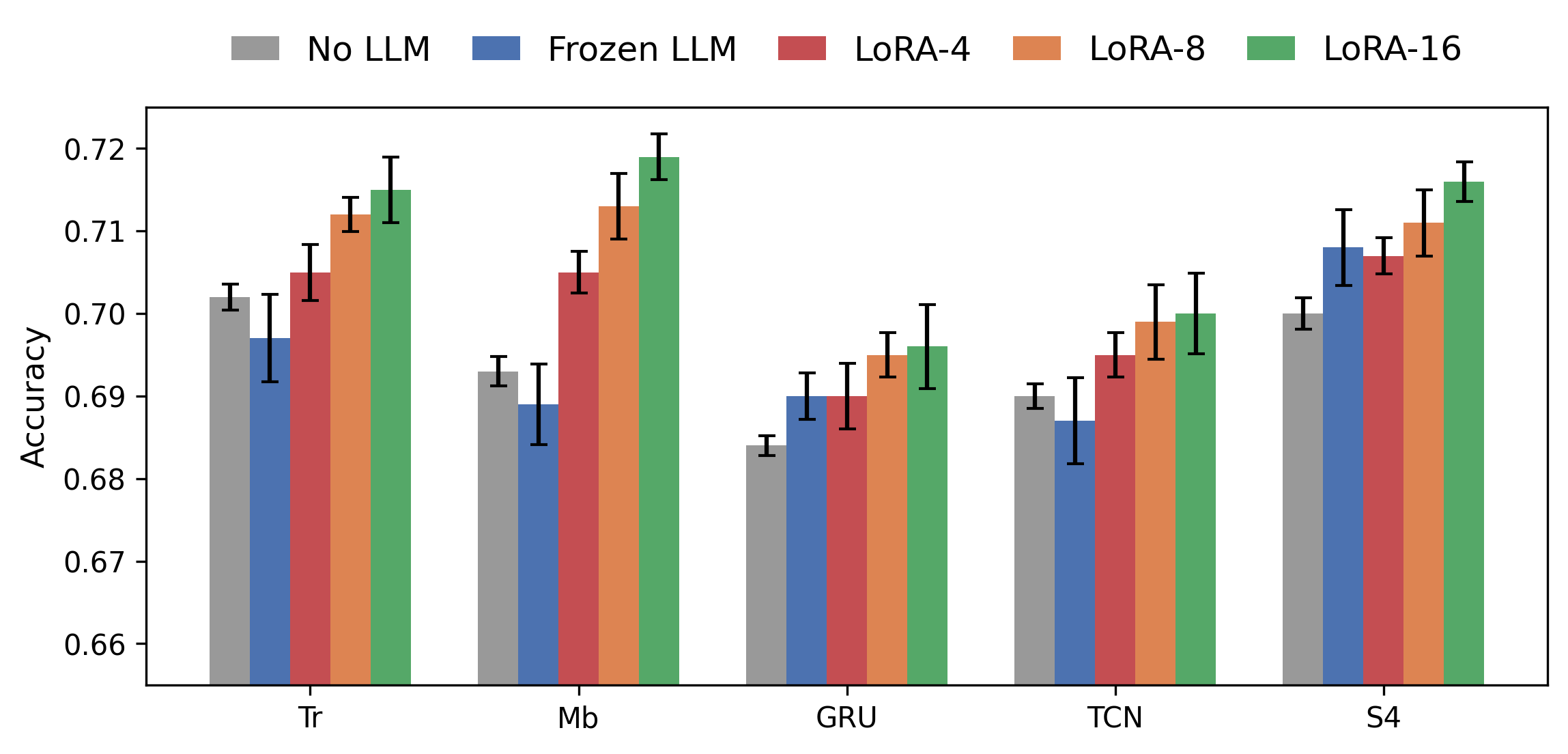

关键设计:在动态图学习模块中,使用可学习的图结构来表示功能连接,并使用损失函数来约束图的稀疏性和平滑性。Mamba模型的参数根据fMRI数据的特性进行调整,以优化时间依赖性的捕捉。LLM采用预训练模型,并通过LoRA进行微调,以适应fMRI数据的特点。LoRA的秩(rank)是一个关键参数,需要根据数据集的大小和复杂度进行调整。

🖼️ 关键图片

📊 实验亮点

论文提出的NeuroMambaLLM框架在自闭症诊断分类任务上取得了显著的性能提升。通过动态学习fMRI数据的功能连接,并结合LLM进行推理,该方法能够更准确地识别自闭症患者,并生成具有临床意义的报告。具体的性能数据和对比基线需要在论文中查找。

🎯 应用场景

NeuroMambaLLM可应用于自闭症等神经发育障碍的早期诊断和个性化治疗。通过分析动态fMRI模式并生成临床报告,该方法可以帮助医生更准确地评估患者的病情,并制定更有效的治疗方案。此外,该方法还可以扩展到其他脑部疾病的研究,例如阿尔茨海默病和精神分裂症。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated strong semantic reasoning across multimodal domains. However, their integration with graph-based models of brain connectivity remains limited. In addition, most existing fMRI analysis methods rely on static Functional Connectivity (FC) representations, which obscure transient neural dynamics critical for neurodevelopmental disorders such as autism. Recent state-space approaches, including Mamba, model temporal structure efficiently, but are typically used as standalone feature extractors without explicit high-level reasoning. We propose NeuroMambaLLM, an end-to-end framework that integrates dynamic latent graph learning and selective state-space temporal modelling with LLMs. The proposed method learns the functional connectivity dynamically from raw Blood-Oxygen-Level-Dependent (BOLD) time series, replacing fixed correlation graphs with adaptive latent connectivity while suppressing motion-related artifacts and capturing long-range temporal dependencies. The resulting dynamic brain representations are projected into the embedding space of an LLM model, where the base language model remains frozen and lightweight low-rank adaptation (LoRA) modules are trained for parameter-efficient alignment. This design enables the LLM to perform both diagnostic classification and language-based reasoning, allowing it to analyze dynamic fMRI patterns and generate clinically meaningful textual reports.