Preventing Rank Collapse in Federated Low-Rank Adaptation with Client Heterogeneity

作者: Fei Wu, Jia Hu, Geyong Min, Shiqiang Wang

分类: cs.LG, cs.AI, cs.DC

发布日期: 2026-02-13

💡 一句话要点

提出raFLoRA,解决联邦低秩适配中因客户端异构性导致的秩坍塌问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦学习 低秩适配 客户端异构性 秩坍塌 模型聚合 LoRA 秩分割聚合

📋 核心要点

- 现有异构FedLoRA方法存在秩坍塌问题,导致模型性能下降且对秩配置敏感。

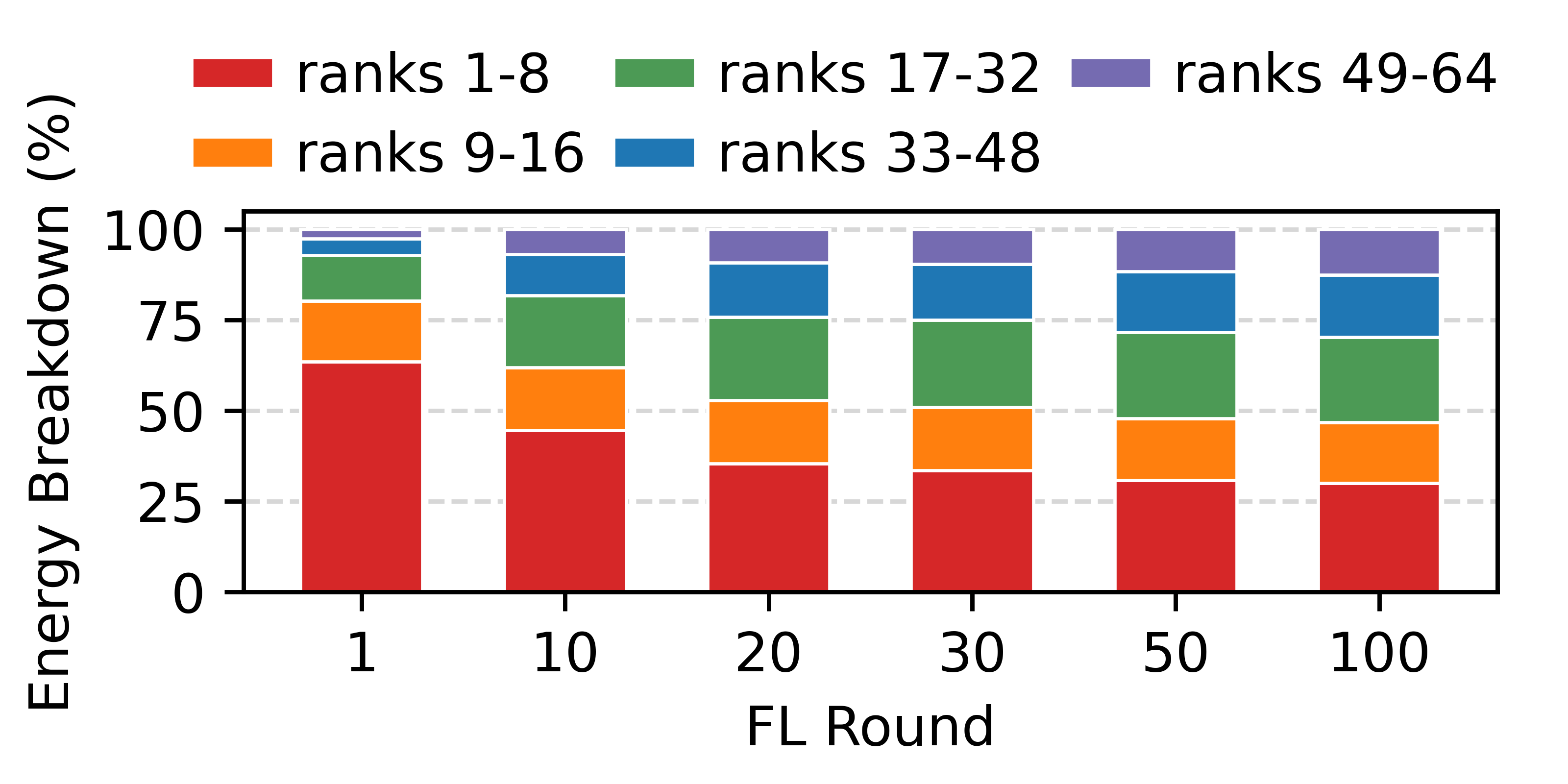

- 论文提出raFLoRA,通过秩分割聚合,根据客户端贡献加权聚合不同秩的更新。

- 实验表明,raFLoRA能有效防止秩坍塌,提升模型性能,并保持通信效率。

📝 摘要(中文)

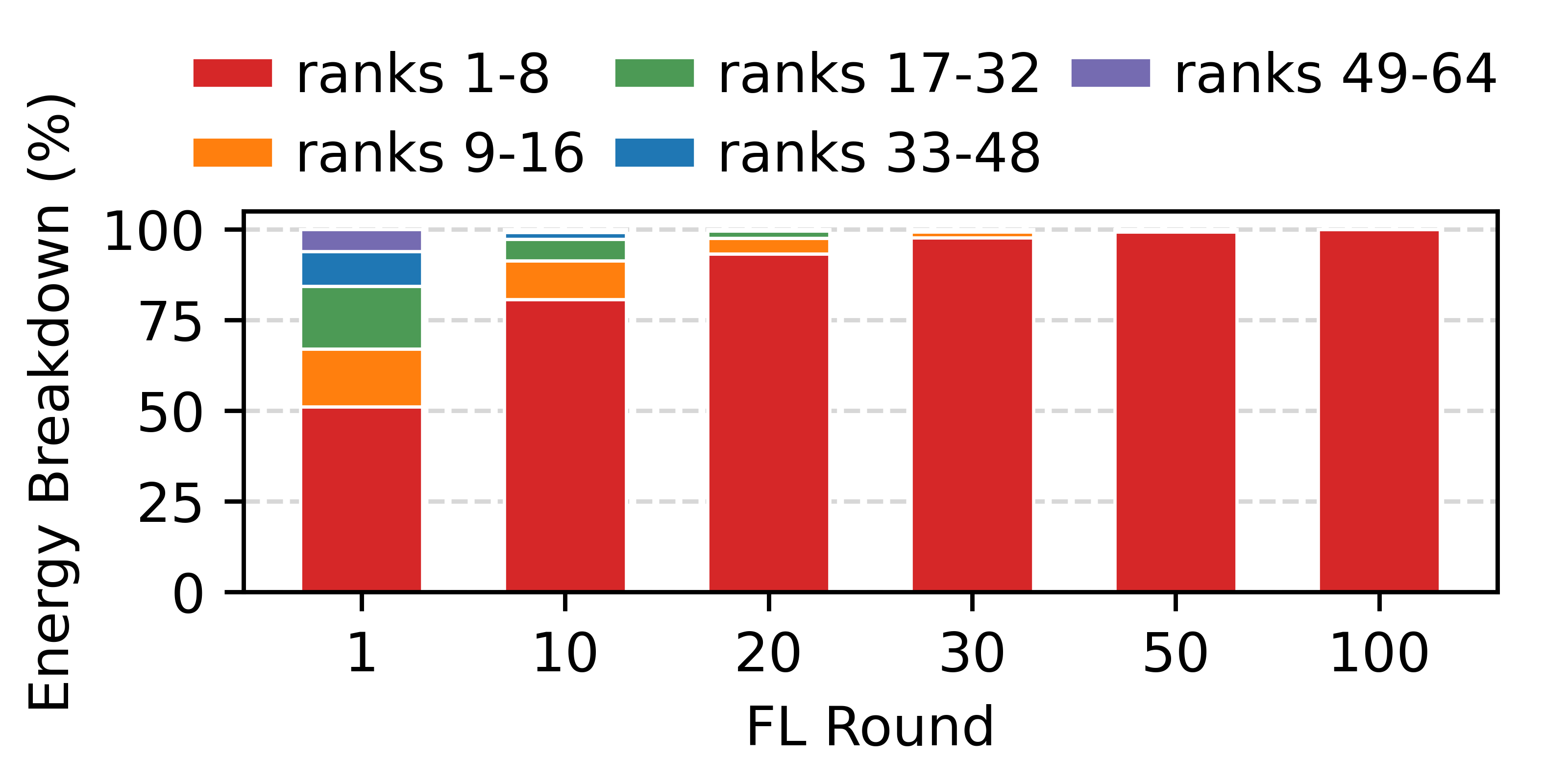

联邦低秩适配(FedLoRA)促进了下游任务中基础模型的通信高效和隐私保护微调。在实际联邦学习场景中,系统资源和数据分布的客户端异构性促使客户端采用异构的LoRA秩。我们发现异构FedLoRA中一个先前被忽视的现象,称为秩坍塌,即全局更新的能量集中在最小共享秩上,导致次优性能和对秩配置的高度敏感性。通过理论分析,我们揭示了秩坍塌的根本原因:与秩相关的客户端贡献和秩无关的聚合权重之间的不匹配,这以几何速率系统地抑制了更高秩的更新。受此启发,我们提出了raFLoRA,一种秩分割聚合方法,将局部更新分解为秩分区,然后根据其有效客户端贡献对每个分区进行加权聚合。在分类和推理任务上的大量实验表明,与最先进的FedLoRA基线相比,raFLoRA可以防止秩坍塌,提高模型性能,并保持通信效率。

🔬 方法详解

问题定义:论文旨在解决联邦低秩适配(FedLoRA)中,由于客户端异构性(数据分布和计算资源)导致的秩坍塌问题。现有方法在聚合不同客户端的LoRA更新时,通常采用秩无关的聚合权重,这导致全局更新的能量集中在最小共享秩上,抑制了高秩更新,最终影响模型性能。

核心思路:论文的核心思路是认识到不同秩的更新对全局模型的贡献是不同的,并且这种贡献与客户端的异构性相关。因此,需要一种秩感知的聚合方法,能够根据客户端在不同秩上的有效贡献来加权聚合更新,从而避免秩坍塌。

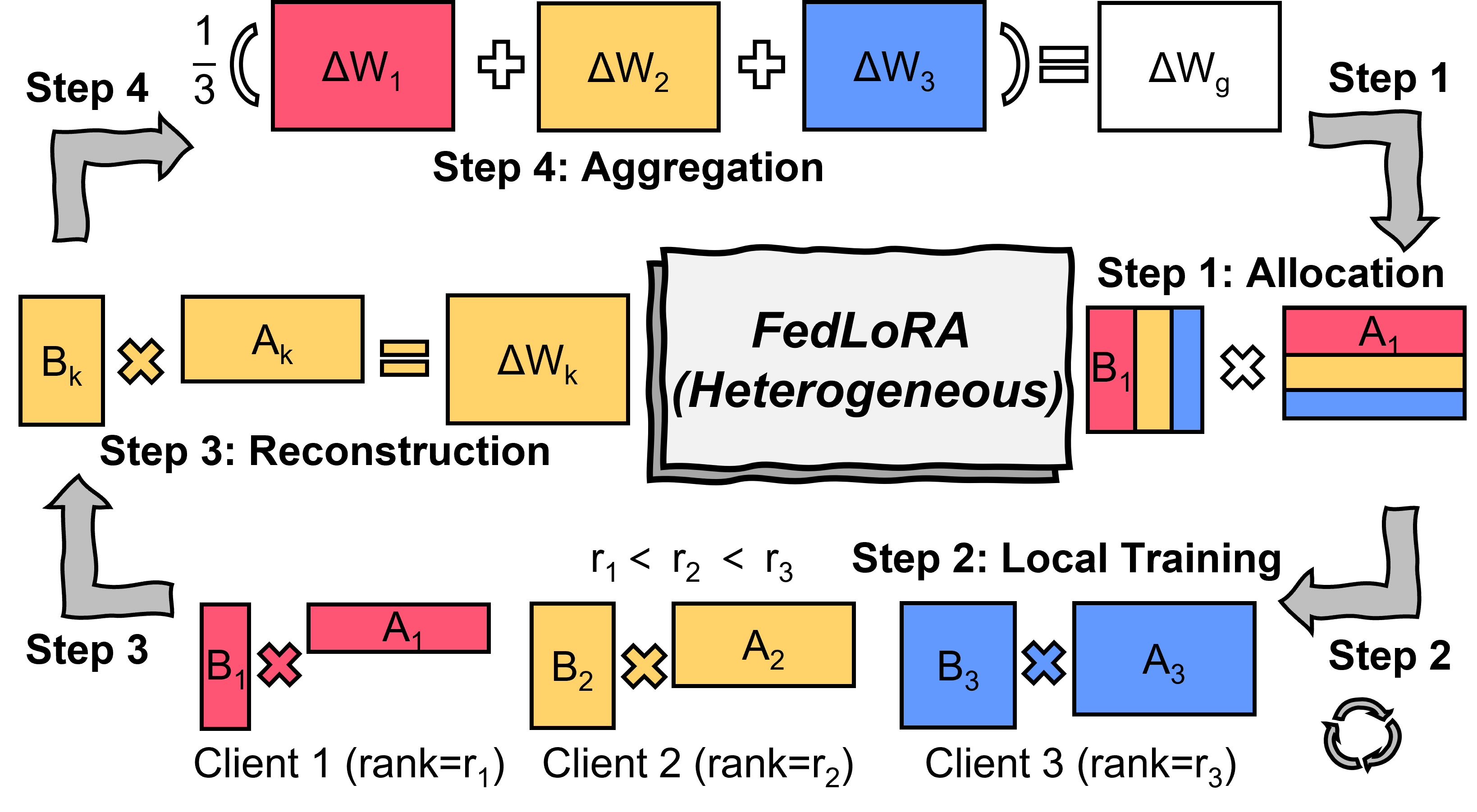

技术框架:raFLoRA的技术框架主要包含以下几个步骤:1) 客户端进行本地LoRA训练,得到本地更新;2) 将本地更新分解为不同的秩分区;3) 服务器根据客户端在每个秩分区上的有效贡献,对相应的秩分区进行加权聚合;4) 将聚合后的更新应用到全局模型。

关键创新:raFLoRA的关键创新在于提出了秩分割聚合方法,并根据客户端在不同秩上的有效贡献进行加权。这种方法能够有效地解决秩无关聚合权重与秩相关客户端贡献之间的不匹配问题,从而防止秩坍塌。

关键设计:raFLoRA的关键设计包括:1) 如何将本地更新分解为不同的秩分区;2) 如何估计客户端在每个秩分区上的有效贡献。论文可能采用某种统计量或梯度信息来估计客户端贡献。具体的技术细节需要在论文中进一步查找。

🖼️ 关键图片

📊 实验亮点

实验结果表明,raFLoRA在分类和推理任务上均优于现有的FedLoRA基线。具体而言,raFLoRA能够有效防止秩坍塌,提高模型性能,并保持与现有方法相当的通信效率。具体的性能提升幅度需要在论文中进一步查找。

🎯 应用场景

该研究成果可应用于各种联邦学习场景,尤其是在客户端数据异构性较高的情况下,例如跨设备联邦学习、医疗影像分析、金融风控等。通过防止秩坍塌,raFLoRA能够提升联邦学习模型的性能和泛化能力,从而更好地服务于实际应用。

📄 摘要(原文)

Federated low-rank adaptation (FedLoRA) has facilitated communication-efficient and privacy-preserving fine-tuning of foundation models for downstream tasks. In practical federated learning scenarios, client heterogeneity in system resources and data distributions motivates heterogeneous LoRA ranks across clients. We identify a previously overlooked phenomenon in heterogeneous FedLoRA, termed rank collapse, where the energy of the global update concentrates on the minimum shared rank, resulting in suboptimal performance and high sensitivity to rank configurations. Through theoretical analysis, we reveal the root cause of rank collapse: a mismatch between rank-agnostic aggregation weights and rank-dependent client contributions, which systematically suppresses higher-rank updates at a geometric rate over rounds. Motivated by this insight, we propose raFLoRA, a rank-partitioned aggregation method that decomposes local updates into rank partitions and then aggregates each partition weighted by its effective client contributions. Extensive experiments across classification and reasoning tasks show that raFLoRA prevents rank collapse, improves model performance, and preserves communication efficiency compared to state-of-the-art FedLoRA baselines.