EXCODER: EXplainable Classification Of DiscretE time series Representations

作者: Yannik Hahn, Antonin Königsfeld, Hasan Tercan, Tobias Meisen

分类: cs.LG, cs.AI

发布日期: 2026-02-13

备注: Accepted at PAKDD 2026

💡 一句话要点

EXCODER:利用离散时间序列表征提升时间序列分类的可解释性

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 时间序列分类 可解释AI 离散表征学习 VQ-VAE DVAE 相似子序列准确度 XAI 时间序列分析

📋 核心要点

- 深度学习时间序列分类模型缺乏可解释性,限制了其在关键领域的应用。

- 将时间序列转换为离散潜在表征,降低维度和噪声,提升XAI方法的效果。

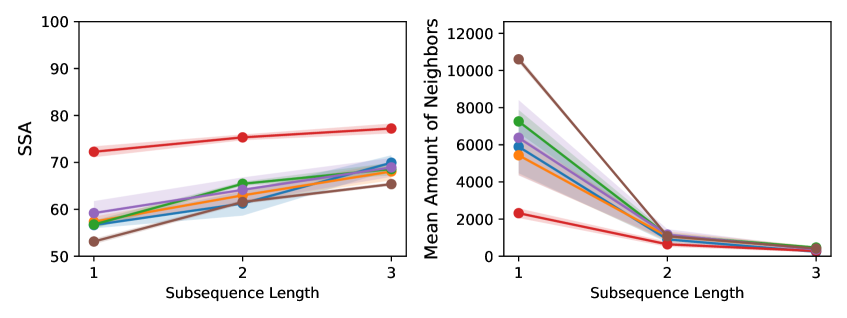

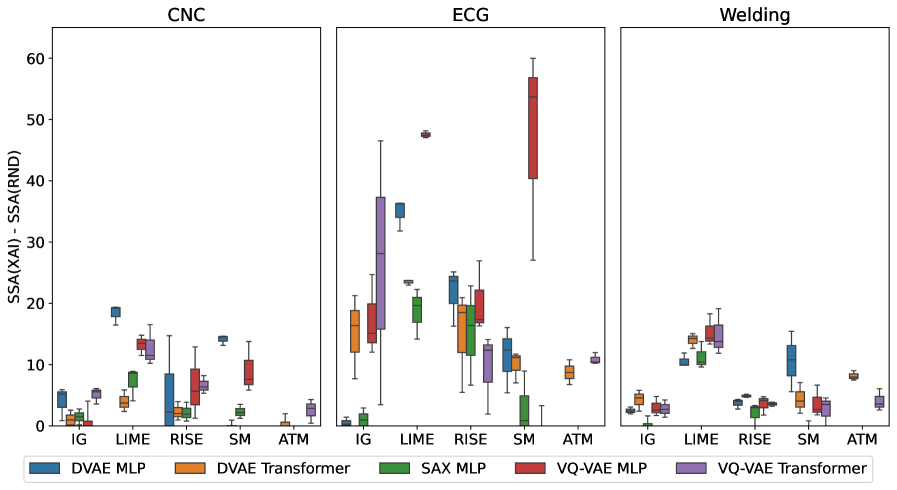

- 提出相似子序列准确度(SSA)指标,定量评估XAI结果与真实标签分布的一致性。

📝 摘要(中文)

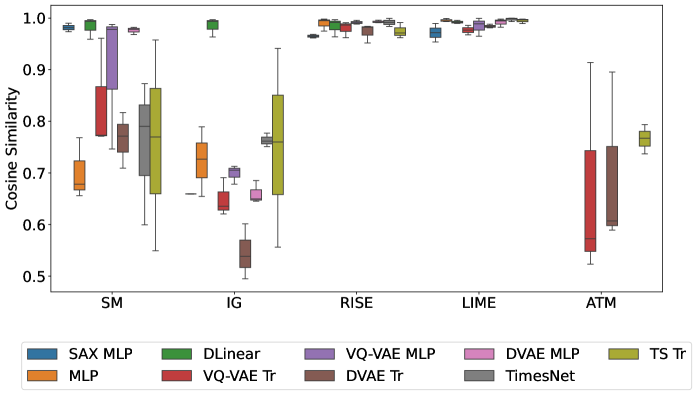

深度学习显著提升了时间序列分类的性能,但模型缺乏可解释性仍然是一个主要挑战。尽管可解释AI(XAI)技术旨在提高模型决策的透明度,但原始时间序列数据的高维度和噪声通常会阻碍其有效性。本文研究了将时间序列转换为离散潜在表征(使用诸如向量量化变分自编码器(VQ-VAE)和离散变分自编码器(DVAE)等方法)是否不仅保留而且增强了可解释性,方法是通过减少冗余并专注于最有效的信息模式。我们表明,将XAI方法应用于这些压缩表征可以产生简洁且结构化的解释,在不牺牲分类性能的情况下保持了保真度。此外,我们提出了一种新的度量标准,即相似子序列准确度(SSA),用于定量评估XAI识别的显著子序列与训练数据中标签分布之间的一致性。SSA提供了一种系统的方法来验证XAI方法突出显示的特征是否真正代表了学习到的分类模式。我们的研究结果表明,离散潜在表征不仅保留了分类所需的基本特征,而且还为时间序列分析中更紧凑、可解释和计算高效的解释提供了一条途径。

🔬 方法详解

问题定义:现有深度学习时间序列分类模型,虽然精度高,但缺乏可解释性,难以理解模型决策依据。原始时间序列数据维度高、噪声大,直接应用XAI方法效果不佳,难以提取关键特征。

核心思路:通过离散潜在表征来压缩时间序列,降低数据维度和噪声,突出关键信息模式。利用VQ-VAE和DVAE等方法将时间序列转换为离散表征,然后在此基础上应用XAI方法,期望得到更简洁、更易于理解的解释。

技术框架:该方法包含两个主要阶段:1) 时间序列离散表征学习:使用VQ-VAE或DVAE将原始时间序列转换为离散潜在空间中的表示。2) 可解释性分析:将XAI方法(如Grad-CAM、LIME等)应用于离散表征,提取显著子序列,并使用SSA指标评估其与真实标签分布的一致性。

关键创新:核心创新在于将离散表征学习与XAI方法相结合,利用离散表征的简洁性来提升XAI方法的效果。同时,提出了新的评估指标SSA,用于定量评估XAI结果的可靠性。

关键设计:VQ-VAE和DVAE的选择是关键设计之一,它们决定了离散表征的质量。SSA指标的设计也至关重要,它需要能够准确反映XAI方法提取的特征与真实标签之间的关联性。具体的网络结构和损失函数需要根据具体的时间序列数据进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,将XAI方法应用于离散潜在表征可以生成更简洁、更易于理解的解释,同时保持了分类性能。提出的SSA指标能够有效评估XAI结果的可靠性。具体性能数据和对比基线在论文中给出,证明了该方法的有效性。

🎯 应用场景

该研究成果可应用于医疗健康、金融风控、工业监控等领域。例如,在心电图分析中,可以利用该方法识别与特定心脏疾病相关的关键波形模式,为医生提供辅助诊断依据。在金融领域,可以用于识别欺诈交易的关键特征,提高风控系统的准确性和可解释性。在工业领域,可以用于预测设备故障,并解释故障发生的原因。

📄 摘要(原文)

Deep learning has significantly improved time series classification, yet the lack of explainability in these models remains a major challenge. While Explainable AI (XAI) techniques aim to make model decisions more transparent, their effectiveness is often hindered by the high dimensionality and noise present in raw time series data. In this work, we investigate whether transforming time series into discrete latent representations-using methods such as Vector Quantized Variational Autoencoders (VQ-VAE) and Discrete Variational Autoencoders (DVAE)-not only preserves but enhances explainability by reducing redundancy and focusing on the most informative patterns. We show that applying XAI methods to these compressed representations leads to concise and structured explanations that maintain faithfulness without sacrificing classification performance. Additionally, we propose Similar Subsequence Accuracy (SSA), a novel metric that quantitatively assesses the alignment between XAI-identified salient subsequences and the label distribution in the training data. SSA provides a systematic way to validate whether the features highlighted by XAI methods are truly representative of the learned classification patterns. Our findings demonstrate that discrete latent representations not only retain the essential characteristics needed for classification but also offer a pathway to more compact, interpretable, and computationally efficient explanations in time series analysis.