Flow-Factory: A Unified Framework for Reinforcement Learning in Flow-Matching Models

作者: Bowen Ping, Chengyou Jia, Minnan Luo, Hangwei Qian, Ivor Tsang

分类: cs.LG, cs.CV

发布日期: 2026-02-13

🔗 代码/项目: GITHUB

💡 一句话要点

Flow-Factory:统一强化学习框架,加速Flow-Matching模型与人类偏好对齐

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Flow-Matching模型 强化学习 扩散模型 统一框架 模块化设计

📋 核心要点

- 现有强化学习方法在Flow-Matching模型中应用时,存在代码分散、模型定制化强、工程复杂度高等挑战。

- Flow-Factory通过模块化和注册机制解耦算法、模型和奖励,实现算法和架构的无缝集成,降低开发和维护成本。

- 该框架支持多种算法和模型,并提供内存优化、多奖励训练和分布式训练等功能,加速研究和应用落地。

📝 摘要(中文)

强化学习已成为使扩散模型和Flow-Matching模型与人类偏好对齐的一种有前景的范例,但从业者面临着代码库分散、模型特定实现和工程复杂性等问题。我们推出了Flow-Factory,这是一个统一的框架,通过基于模块化、基于注册的架构来解耦算法、模型和奖励。这种设计能够无缝集成新的算法和架构,正如我们对Flux、Qwen-Image和WAN视频模型中GRPO、DiffusionNFT和AWM的支持所证明的那样。通过最大限度地减少实现开销,Flow-Factory使研究人员能够轻松快速地原型设计和扩展未来的创新。Flow-Factory提供生产就绪的内存优化、灵活的多奖励训练和无缝的分布式训练支持。代码库可在https://github.com/X-GenGroup/Flow-Factory获得。

🔬 方法详解

问题定义:现有基于强化学习的Flow-Matching模型训练方法存在代码库分散、模型特定实现以及工程复杂性高等问题。研究人员需要花费大量精力在不同模型和算法之间切换,阻碍了新算法的快速原型设计和验证。此外,缺乏统一的框架也使得模型部署和扩展变得困难。

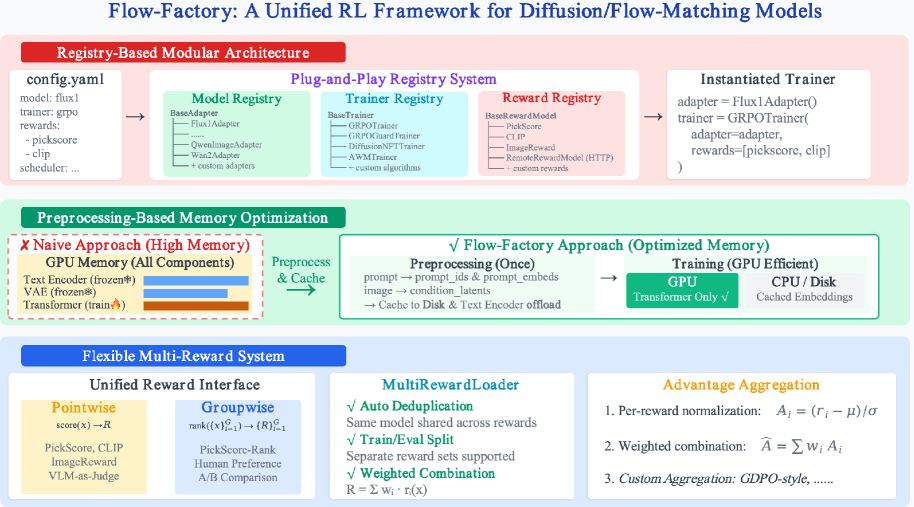

核心思路:Flow-Factory的核心思路是通过模块化设计和注册机制,将强化学习算法、Flow-Matching模型以及奖励函数解耦。这种解耦使得研究人员可以独立地开发和修改各个模块,而无需关心其他模块的实现细节。通过注册机制,可以方便地添加新的算法和模型,实现框架的灵活扩展。

技术框架:Flow-Factory采用模块化、基于注册的架构。整体框架包含以下几个主要模块:1) 算法模块:包含各种强化学习算法的实现,如GRPO、DiffusionNFT和AWM等。2) 模型模块:包含各种Flow-Matching模型的实现,如Flux、Qwen-Image和WAN视频模型等。3) 奖励模块:定义了不同的奖励函数,用于指导强化学习算法的训练。框架通过注册机制将这些模块连接起来,实现算法、模型和奖励的灵活组合。此外,框架还提供了内存优化、多奖励训练和分布式训练等功能。

关键创新:Flow-Factory的关键创新在于其统一的框架设计,实现了算法、模型和奖励的解耦。这种解耦使得研究人员可以更加专注于算法的创新,而无需花费大量精力在模型和工程实现上。此外,框架提供的内存优化、多奖励训练和分布式训练等功能,也大大提高了训练效率和模型性能。

关键设计:Flow-Factory的关键设计包括:1) 模块化架构:将算法、模型和奖励划分为独立的模块,方便开发和维护。2) 注册机制:通过注册机制实现模块的动态加载和组合。3) 统一接口:定义了统一的接口,使得不同的算法和模型可以方便地集成到框架中。4) 内存优化:采用多种内存优化技术,降低训练过程中的内存消耗。5) 多奖励训练:支持同时使用多个奖励函数进行训练,提高模型的泛化能力。6) 分布式训练:支持分布式训练,加速模型训练过程。

🖼️ 关键图片

📊 实验亮点

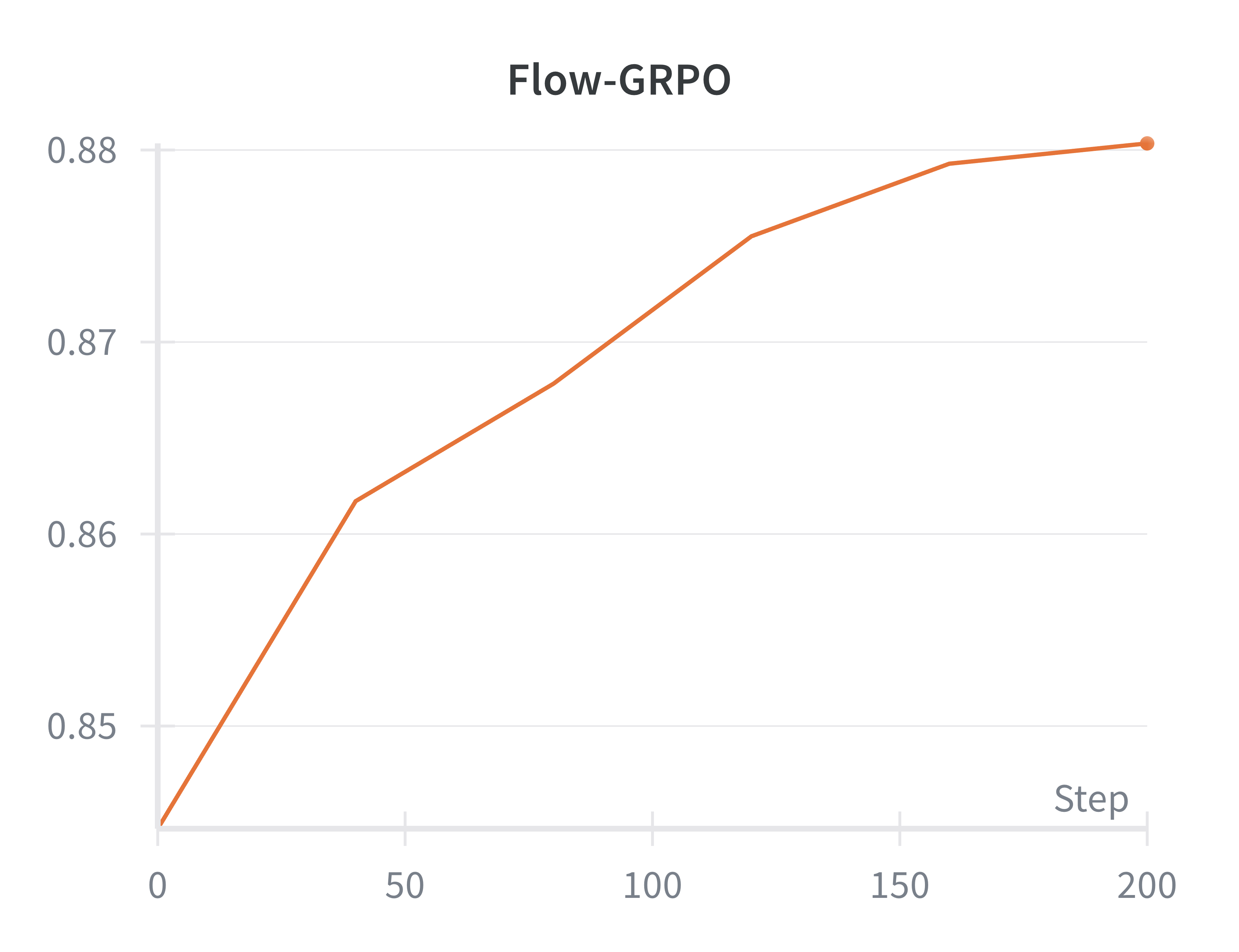

Flow-Factory支持GRPO、DiffusionNFT和AWM等多种强化学习算法,以及Flux、Qwen-Image和WAN视频模型等多种Flow-Matching模型。实验表明,该框架能够有效地训练这些模型,并取得良好的生成效果。此外,Flow-Factory提供的内存优化、多奖励训练和分布式训练等功能,也显著提高了训练效率。

🎯 应用场景

Flow-Factory可广泛应用于图像生成、视频生成、文本生成等领域,通过强化学习方法优化生成模型的输出,使其更符合人类偏好。该框架降低了Flow-Matching模型强化学习的门槛,加速了相关研究和应用落地,有望推动生成模型在艺术创作、内容生成、智能助手等领域的应用。

📄 摘要(原文)

Reinforcement learning has emerged as a promising paradigm for aligning diffusion and flow-matching models with human preferences, yet practitioners face fragmented codebases, model-specific implementations, and engineering complexity. We introduce Flow-Factory, a unified framework that decouples algorithms, models, and rewards through through a modular, registry-based architecture. This design enables seamless integration of new algorithms and architectures, as demonstrated by our support for GRPO, DiffusionNFT, and AWM across Flux, Qwen-Image, and WAN video models. By minimizing implementation overhead, Flow-Factory empowers researchers to rapidly prototype and scale future innovations with ease. Flow-Factory provides production-ready memory optimization, flexible multi-reward training, and seamless distributed training support. The codebase is available at https://github.com/X-GenGroup/Flow-Factory.