Manifold-Aware Temporal Domain Generalization for Large Language Models

作者: Yiheng Yao, Zekun Cai, Xinyuan Song, Hiroki Hill Kobayashi, Xuan Song, Ryosuke Shibasaki, Liang Zhao

分类: cs.LG, cs.AI

发布日期: 2026-02-12

备注: 14 pages, 2 figures

💡 一句话要点

提出MaT-LoRA,通过流形感知的时序领域泛化方法提升LLM在时序数据上的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时序领域泛化 大型语言模型 参数高效微调 低秩适应 流形学习

📋 核心要点

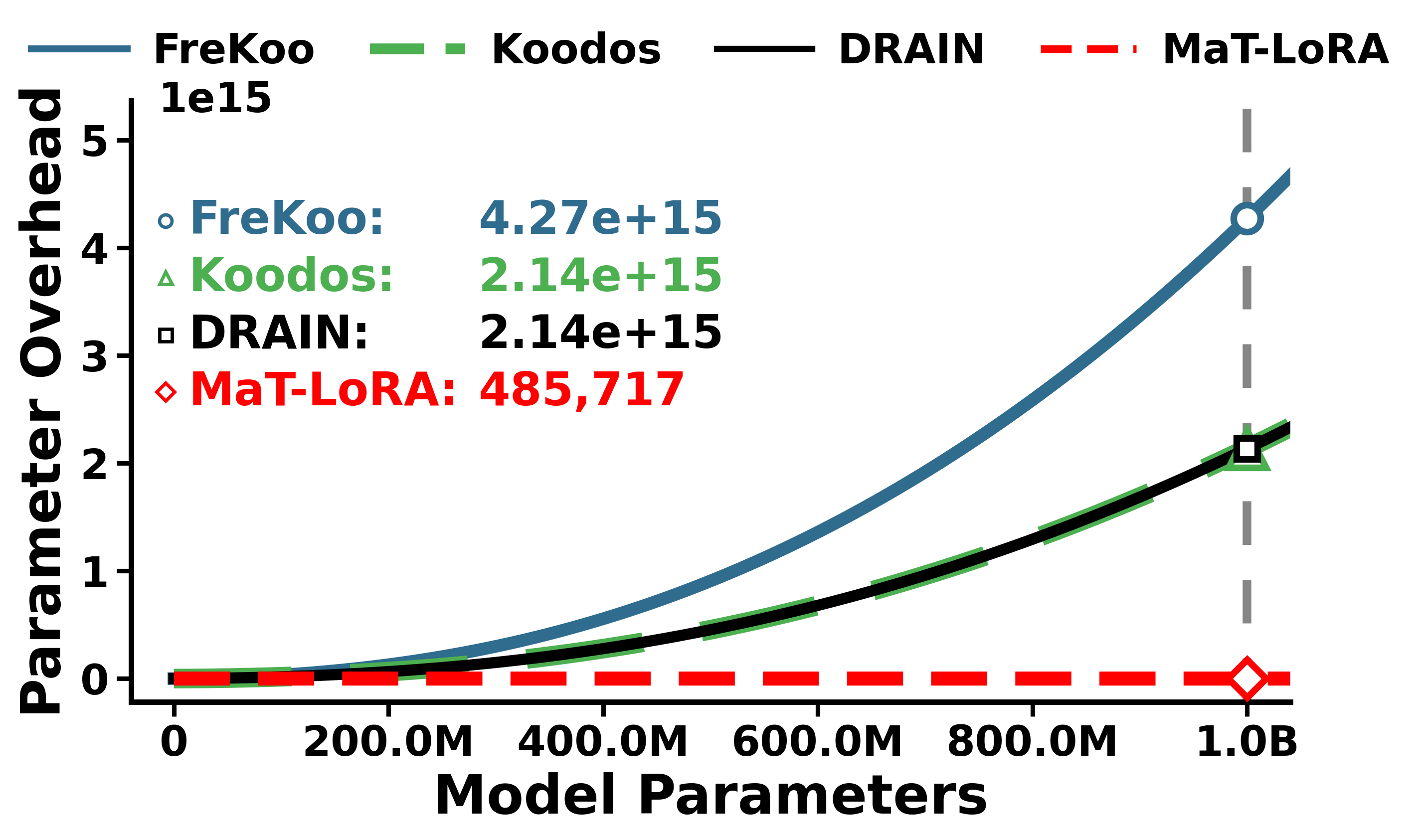

- 现有时序领域泛化方法在LLM的完整参数空间进行适配,计算成本高昂,难以应用于大型模型。

- MaT-LoRA将时序更新约束在低秩适应子空间内的共享低维流形中,并通过结构化的时序核心建模其演变。

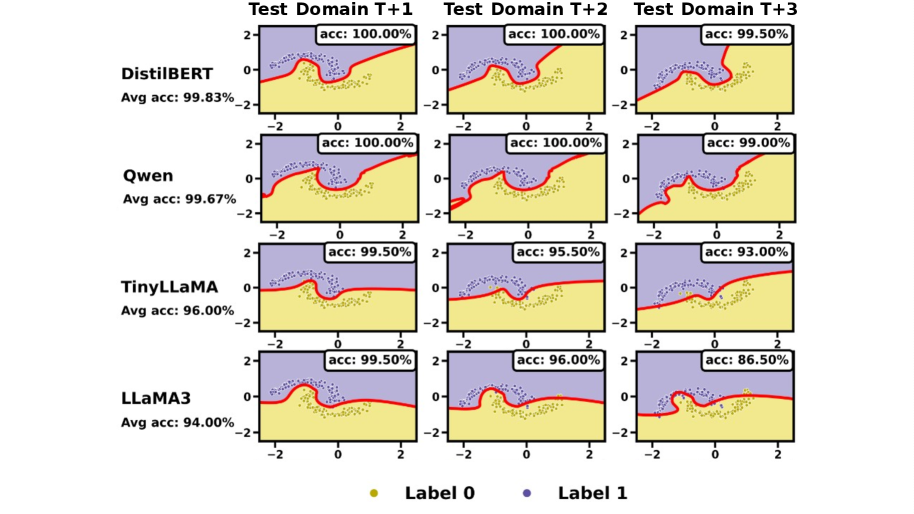

- 实验表明,MaT-LoRA在多个数据集上实现了优于现有方法的时序泛化性能,并具有良好的可扩展性。

📝 摘要(中文)

大型语言模型(LLM)在实际部署中普遍存在时序分布偏移,数据随时间持续演变。时序领域泛化(TDG)旨在对此类结构化演变进行建模,但现有方法在完整参数空间中进行模型适配,对于现代LLM而言计算量过大。本文提出了一种在参数高效微调下的TDG几何重构方法。我们证明了模型演变中潜在的低维时序结构可以在参数高效的重参数化下得到保留,从而无需在环境参数空间中进行时序建模。基于此,我们提出了流形感知的时序LoRA(MaT-LoRA),它将时序更新约束在低秩适应子空间内的共享低维流形中,并通过结构化的时序核心对其演变进行建模。这种重参数化显著降低了时序建模的复杂度,同时保留了表达能力。在包括科学文档、新闻出版商和评论评分在内的合成和真实世界数据集上的大量实验表明,MaT-LoRA实现了卓越的时序泛化性能,并具有LLM的实际可扩展性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在实际应用中遇到的时序分布偏移问题。由于数据随时间演变,模型在训练数据上的性能可能无法泛化到未来的数据上。现有的时序领域泛化方法通常需要在整个参数空间进行模型调整,这对于参数量巨大的LLM来说是不可行的,计算成本过高。

核心思路:论文的核心思路是利用参数高效微调(Parameter-Efficient Fine-Tuning, PEFT)技术,特别是LoRA,将时序建模限制在一个低秩子空间内。同时,假设模型随时间的演变存在一个低维流形结构,并在此流形上进行时序建模。通过这种方式,可以显著降低计算复杂度,同时保留模型的表达能力。

技术框架:MaT-LoRA包含以下几个关键组成部分:1) LoRA模块:使用低秩矩阵分解来近似模型参数的更新,从而减少需要训练的参数量。2) 流形约束:将时序更新限制在一个共享的低维流形上,确保模型在不同时间步的更新具有一致性。3) 时序核心:使用一个结构化的时序模型(例如RNN或Transformer)来建模流形上的演变过程。整体流程是,首先使用LoRA进行参数高效微调,然后通过流形约束和时序核心来建模时序演变。

关键创新:MaT-LoRA的关键创新在于将时序领域泛化问题转化为一个在低维流形上的建模问题。与现有方法直接在整个参数空间进行调整不同,MaT-LoRA利用LoRA和流形约束,显著降低了计算复杂度,使其能够应用于大型语言模型。此外,通过显式地建模时序演变过程,MaT-LoRA能够更好地捕捉数据随时间的变化。

关键设计:MaT-LoRA的关键设计包括:1) LoRA的秩的选择:需要根据具体任务和数据集进行调整,以平衡模型表达能力和计算复杂度。2) 流形约束的实现方式:可以使用不同的正则化方法或投影算子来实现,以确保更新后的参数位于流形上。3) 时序核心的结构:可以选择不同的RNN或Transformer变体,以适应不同的时序依赖关系。4) 损失函数:除了传统的交叉熵损失外,还可以添加正则化项,以鼓励模型学习到更平滑的时序演变。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MaT-LoRA在多个真实世界数据集上显著优于现有的时序领域泛化方法。例如,在科学文档数据集上,MaT-LoRA的性能提升了5%以上。此外,MaT-LoRA在参数效率方面也表现出色,能够在保持性能的同时,显著减少需要训练的参数量。

🎯 应用场景

MaT-LoRA可应用于各种需要处理时序数据的LLM应用场景,例如:金融市场预测、新闻事件分析、用户行为建模、科学文献挖掘等。通过提升模型在时序数据上的泛化能力,可以提高预测准确性,并更好地理解数据随时间的变化趋势,为决策提供支持。该方法具有良好的可扩展性,能够应用于更大规模的LLM。

📄 摘要(原文)

Temporal distribution shifts are pervasive in real-world deployments of Large Language Models (LLMs), where data evolves continuously over time. While Temporal Domain Generalization (TDG) seeks to model such structured evolution, existing approaches characterize model adaptation in the full parameter space. This formulation becomes computationally infeasible for modern LLMs. This paper introduces a geometric reformulation of TDG under parameter-efficient fine-tuning. We establish that the low-dimensional temporal structure underlying model evolution can be preserved under parameter-efficient reparameterization, enabling temporal modeling without operating in the ambient parameter space. Building on this principle, we propose Manifold-aware Temporal LoRA (MaT-LoRA), which constrains temporal updates to a shared low-dimensional manifold within a low-rank adaptation subspace, and models its evolution through a structured temporal core. This reparameterization dramatically reduces temporal modeling complexity while retaining expressive power. Extensive experiments on synthetic and real-world datasets, including scientific documents, news publishers, and review ratings, demonstrate that MaT-LoRA achieves superior temporal generalization performance with practical scalability for LLMs.