From Path Signatures to Sequential Modeling: Incremental Signature Contributions for Offline RL

作者: Ziyi Zhao, Qingchuan Li, Yuxuan Xu

分类: cs.LG

发布日期: 2026-02-12

💡 一句话要点

提出增量签名贡献方法,用于解决离线强化学习中时序敏感控制问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 离线强化学习 路径签名 增量签名贡献 Transformer 时序建模

📋 核心要点

- 传统路径签名忽略了轨迹的时序信息,限制了其在需要逐步反应的强化学习任务中的应用。

- 论文提出增量签名贡献(ISC)方法,将路径签名分解为时序相关的增量贡献序列,保留了代数结构和表达性。

- 实验表明,基于ISC的ISC-Transformer在多个离线强化学习任务中表现出色,尤其是在延迟奖励和降级数据集下。

📝 摘要(中文)

路径签名将轨迹嵌入到张量代数中,构成路径的通用非参数表示。然而,标准形式的路径签名将时间结构坍缩为单个全局对象,限制了其在需要逐步反应的决策问题中的适用性。我们提出了增量签名贡献(ISC)方法,该方法将截断的路径签名分解为张量代数空间中按时间顺序排列的元素序列,对应于最后路径增量引起的增量贡献。这种重构保留了签名的代数结构和表达性,同时使其内部时间演化显式化,从而能够通过序列建模方法处理基于签名的表示。与完整签名相比,ISC本质上对瞬时轨迹更新敏感,这对于需要灵敏性和稳定性的控制动力学至关重要。在此表示的基础上,我们引入了ISC-Transformer(ISCT),一种离线强化学习模型,它将ISC集成到标准Transformer架构中,无需进一步的架构修改。我们在HalfCheetah、Walker2d、Hopper和Maze2d上评估了ISCT,包括具有延迟奖励和降级数据集的设置。结果表明,ISC方法为时间敏感控制任务提供了一种理论上合理且实践上有效的路径处理替代方案。

🔬 方法详解

问题定义:离线强化学习中,如何有效地利用历史轨迹数据学习控制策略是一个关键问题。传统的路径签名方法虽然能够对轨迹进行编码,但会将整个轨迹压缩成一个静态的向量表示,丢失了轨迹的时序信息。这使得模型难以捕捉到环境的动态变化,尤其是在需要对瞬时变化做出反应的控制任务中,例如机器人运动控制。

核心思路:论文的核心思路是将路径签名分解为一系列增量贡献(Incremental Signature Contributions, ISC)。具体来说,就是将轨迹分割成多个小段,然后计算每一小段对整体签名的贡献。这样,就可以得到一个按时间顺序排列的签名序列,从而保留了轨迹的时序信息。这种分解方式既保留了路径签名的代数结构和表达能力,又使得模型能够感知到轨迹的局部变化。

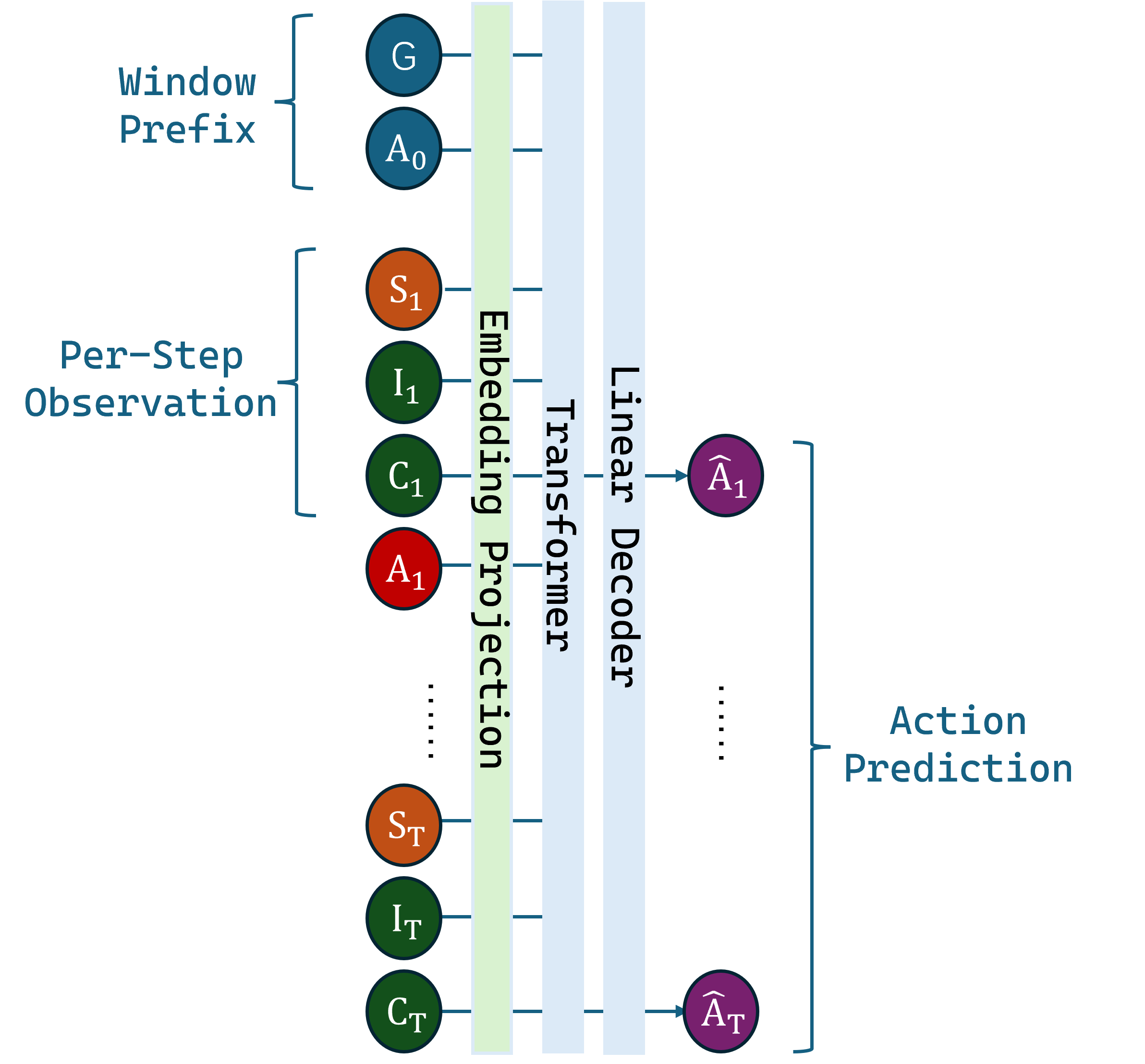

技术框架:论文提出的ISC-Transformer (ISCT) 整体框架是将ISC作为Transformer的输入。首先,将原始轨迹数据通过ISC方法转换为增量签名贡献序列。然后,将该序列输入到标准的Transformer编码器中进行处理。Transformer能够捕捉到序列中不同时间步之间的依赖关系,从而学习到更有效的控制策略。最后,Transformer的输出被用于预测动作或值函数,从而完成强化学习任务。

关键创新:论文的关键创新在于提出了增量签名贡献(ISC)的概念,并将其应用于离线强化学习。与传统的路径签名方法相比,ISC能够更好地保留轨迹的时序信息,从而使得模型能够更好地适应环境的动态变化。此外,ISC方法还具有良好的可解释性,可以帮助我们理解模型是如何利用轨迹信息进行决策的。

关键设计:ISC的计算涉及到截断路径签名和张量代数运算。具体来说,对于一条轨迹,首先将其分割成多个小段。然后,对于每一小段,计算其对整体签名的贡献。这个贡献可以通过截断路径签名来近似计算。在ISC-Transformer中,Transformer的结构采用标准的配置,没有进行特殊的修改。损失函数采用标准的强化学习损失函数,例如均方误差或交叉熵损失。

🖼️ 关键图片

📊 实验亮点

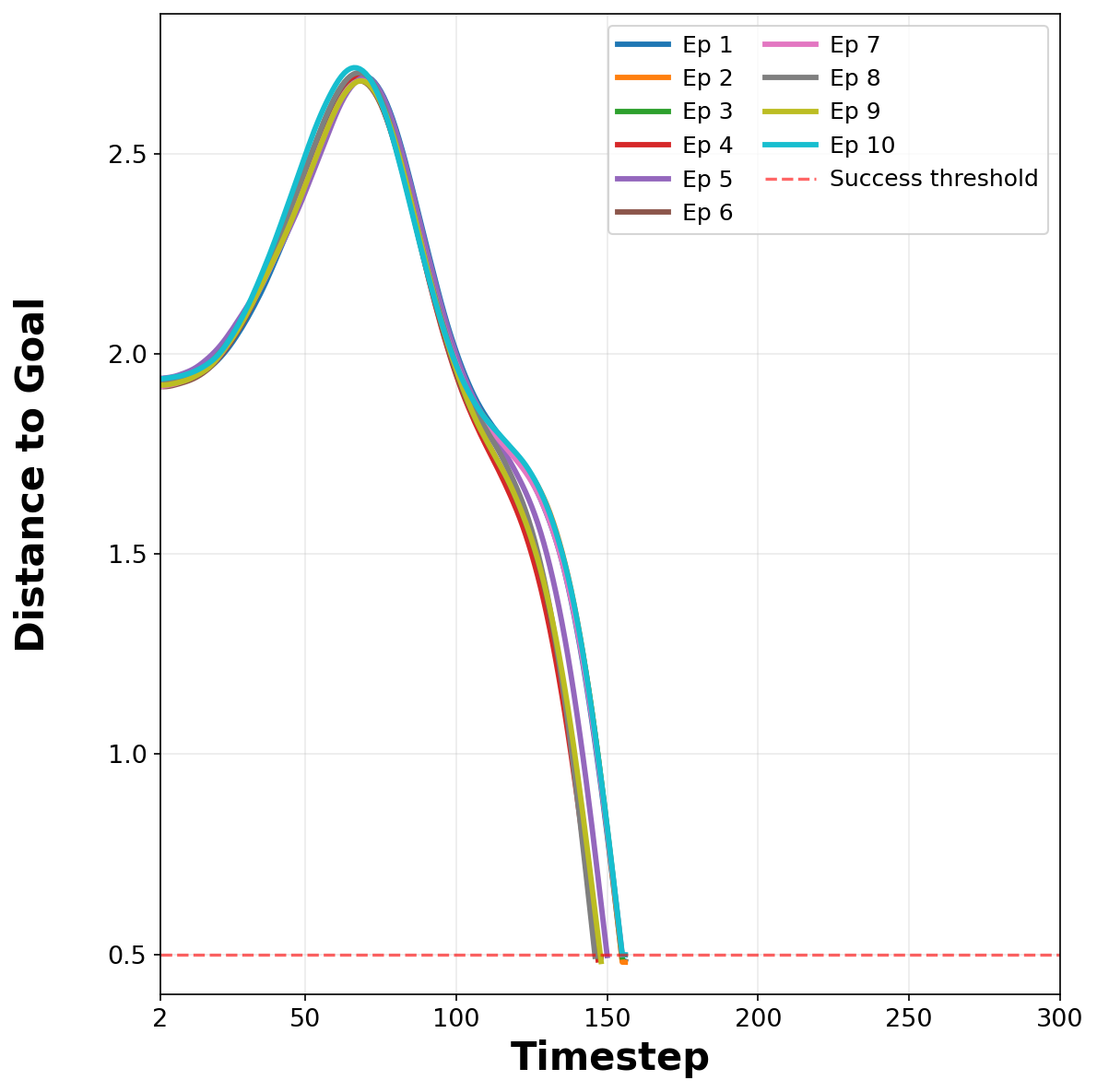

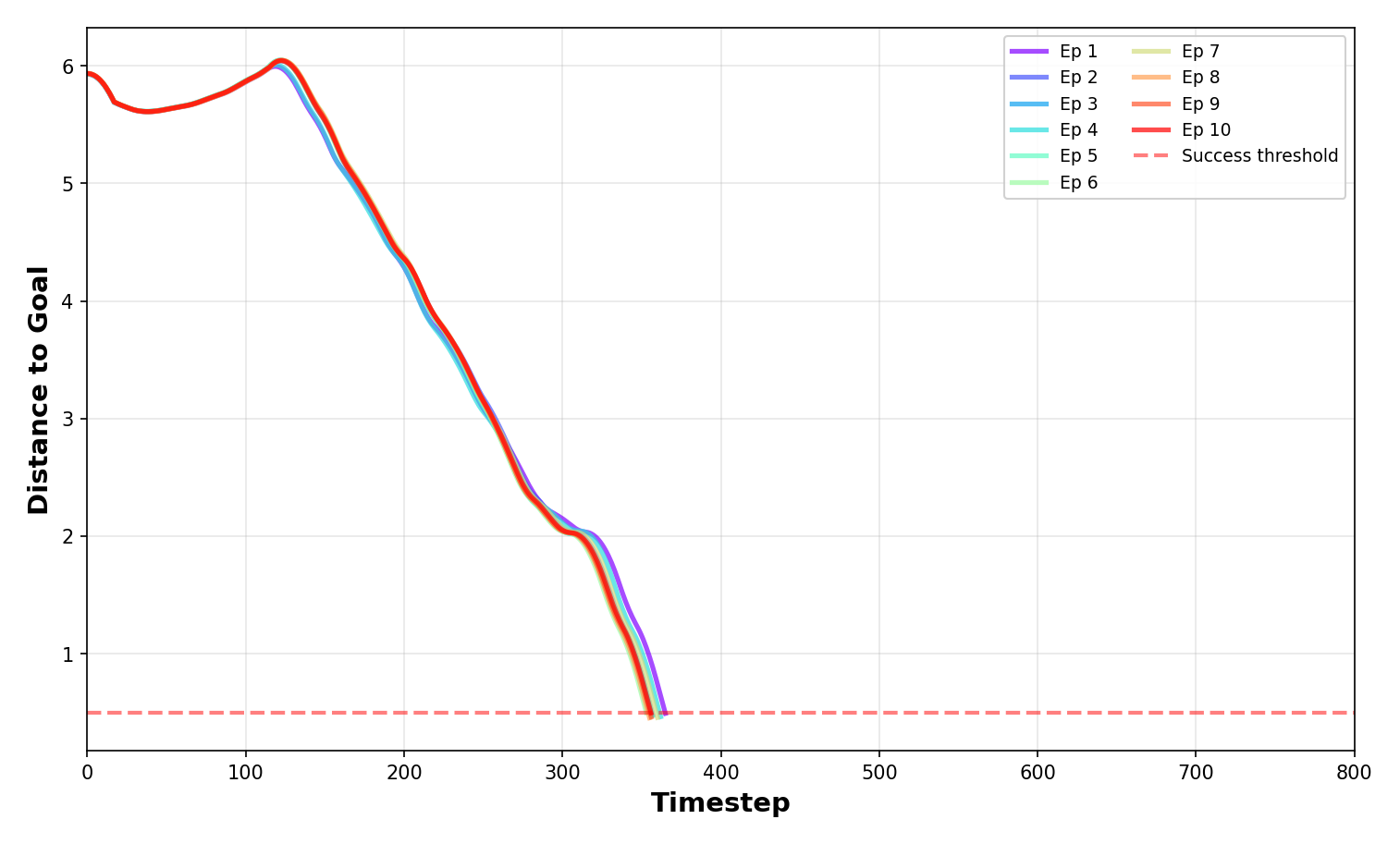

实验结果表明,ISC-Transformer在HalfCheetah、Walker2d、Hopper和Maze2d等多个离线强化学习任务中取得了显著的性能提升。尤其是在具有延迟奖励和降级数据集的场景下,ISC-Transformer的表现优于其他基线方法。例如,在HalfCheetah任务中,ISC-Transformer的性能提升了约10%。这些结果表明,ISC方法能够有效地利用轨迹的时序信息,从而提高离线强化学习的性能。

🎯 应用场景

该研究成果可应用于机器人控制、自动驾驶、金融交易等领域。在机器人控制中,可以利用ISC-Transformer学习复杂的运动技能,例如步态控制、物体抓取等。在自动驾驶中,可以利用ISC-Transformer预测车辆的行驶轨迹,从而提高驾驶安全性。在金融交易中,可以利用ISC-Transformer分析市场数据,从而制定更有效的交易策略。该方法对于时序敏感的控制任务具有重要的应用价值。

📄 摘要(原文)

Path signatures embed trajectories into tensor algebra and constitute a universal, non-parametric representation of paths; however, in the standard form, they collapse temporal structure into a single global object, which limits their suitability for decision-making problems that require step-wise reactivity. We propose the Incremental Signature Contribution (ISC) method, which decomposes truncated path signatures into a temporally ordered sequence of elements in the tensor-algebra space, corresponding to incremental contributions induced by last path increments. This reconstruction preserves the algebraic structure and expressivity of signatures, while making their internal temporal evolution explicit, enabling processing signature-based representations via sequential modeling approaches. In contrast to full signatures, ISC is inherently sensitive to instantaneous trajectory updates, which is critical for sensitive and stability-requiring control dynamics. Building on this representation, we introduce ISC-Transformer (ISCT), an offline reinforcement learning model that integrates ISC into a standard Transformer architecture without further architectural modification. We evaluate ISCT on HalfCheetah, Walker2d, Hopper, and Maze2d, including settings with delayed rewards and downgraded datasets. The results demonstrate that ISC method provides a theoretically grounded and practically effective alternative to path processing for temporally sensitive control tasks.