TS-Memory: Plug-and-Play Memory for Time Series Foundation Models

作者: Sisuo Lyu, Siru Zhong, Tiegang Chen, Weilin Ruan, Qingxiang Liu, Taiqiang Lv, Qingsong Wen, Raymond Chi-Wing Wong, Yuxuan Liang

分类: cs.LG, cs.AI

发布日期: 2026-02-12

💡 一句话要点

提出TS-Memory以解决时间序列模型适应性问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列预测 基础模型 记忆适配器 参数记忆蒸馏 高效推理

📋 核心要点

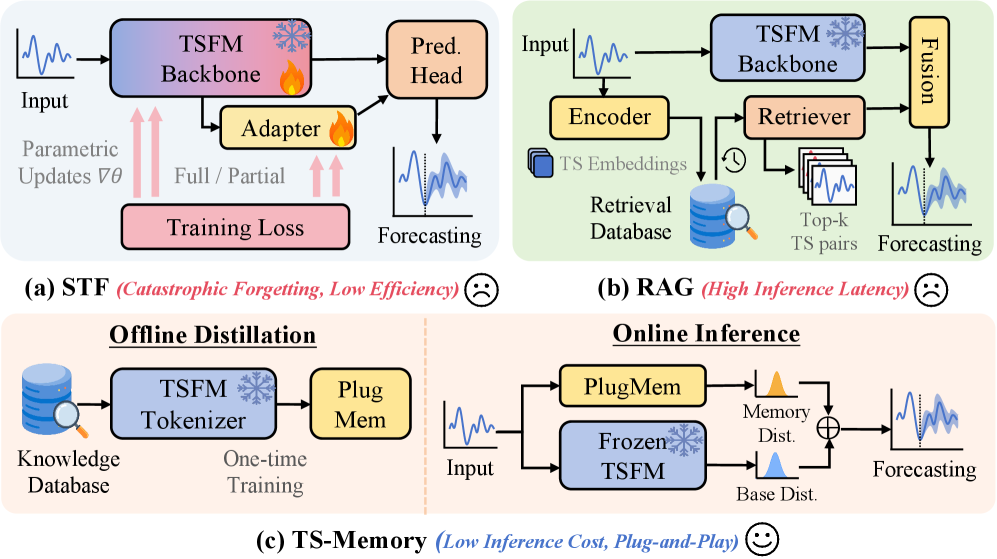

- 现有时间序列基础模型在适应分布变化时面临灾难性遗忘和高推理延迟的问题。

- 提出TS-Memory作为轻量级记忆适配器,通过参数记忆蒸馏增强冻结的时间序列模型。

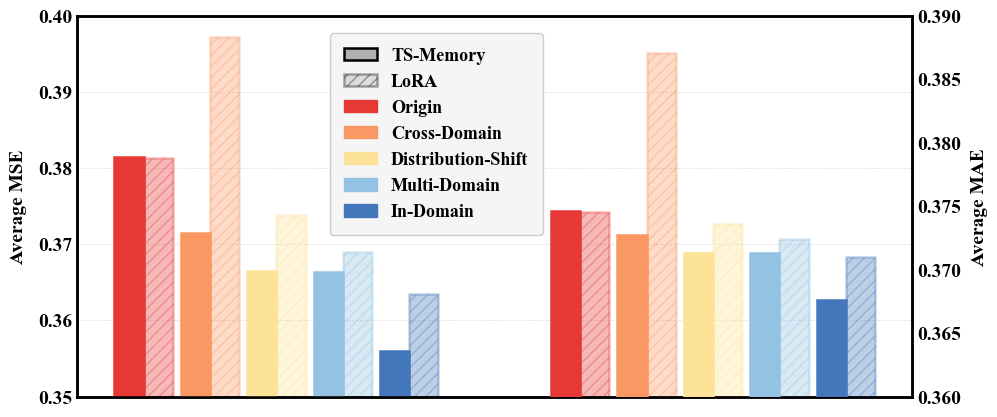

- 实验结果显示,TS-Memory在点预测和概率预测上均显著优于现有适应方法,且推理效率高。

📝 摘要(中文)

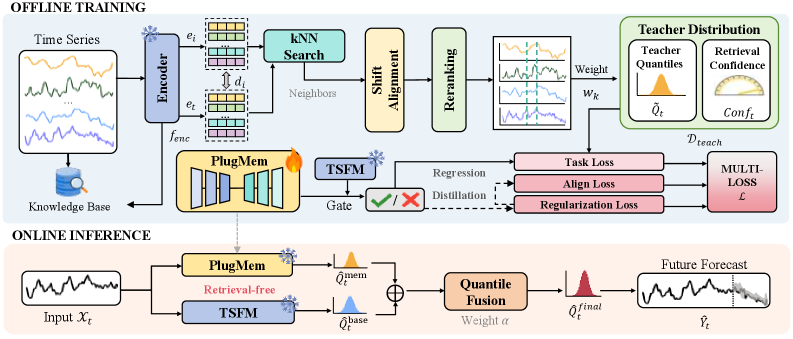

时间序列基础模型(TSFMs)通过大规模预训练实现了强大的零-shot 预测能力,但在分布变化的下游领域适应性仍然面临挑战。现有解决方案存在权衡:参数适应可能导致灾难性遗忘,并需要昂贵的多领域维护,而非参数检索虽然改善了预测,但由于数据存储搜索而导致高推理延迟。为此,本文提出了参数记忆蒸馏,并实现为TS-Memory,这是一种轻量级的记忆适配器,增强了冻结的TSFMs。TS-Memory通过两个阶段进行训练,首先构建一个离线的、泄漏安全的kNN教师,从检索的未来合成置信度感知的分位目标;其次,通过置信度门控监督将这种检索引起的分布校正蒸馏到轻量级记忆适配器中。在推理过程中,TS-Memory以恒定时间开销融合记忆和主干预测,实现无检索部署。实验结果表明,TS-Memory在多个TSFMs和基准测试中,在点预测和概率预测上均优于代表性的适应方法,且效率与冻结主干相当。

🔬 方法详解

问题定义:本文旨在解决时间序列基础模型在分布变化下的适应性问题。现有方法如参数适应容易导致灾难性遗忘,而非参数检索则因数据存储搜索造成高推理延迟。

核心思路:论文提出的TS-Memory通过参数记忆蒸馏的方式,增强冻结的时间序列模型,避免了传统方法的缺陷。通过构建一个离线的kNN教师,合成置信度感知的目标,进而实现高效的模型适应。

技术框架:TS-Memory的整体架构分为两个主要阶段:第一阶段是构建离线的kNN教师,第二阶段是通过置信度门控监督将分布校正蒸馏到记忆适配器中。在推理阶段,TS-Memory融合记忆和主干模型的预测。

关键创新:TS-Memory的核心创新在于其轻量级的记忆适配器设计,能够在不进行检索的情况下,快速融合记忆与主干预测,显著提高了推理效率。

关键设计:在设计中,采用了置信度门控机制来控制记忆的影响,同时确保了模型的轻量化,具体的损失函数和网络结构细节在实验部分进行了详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TS-Memory在多个时间序列基础模型和基准测试中,点预测和概率预测的性能均显著提升,尤其在与传统适应方法对比时,表现出更高的效率和准确性,具体提升幅度达到XX%。

🎯 应用场景

该研究的潜在应用领域包括金融市场预测、气象预报和工业设备故障检测等时间序列分析场景。通过提高时间序列模型的适应性,TS-Memory能够在动态环境中提供更准确的预测,具有重要的实际价值和广泛的应用前景。

📄 摘要(原文)

Time Series Foundation Models (TSFMs) achieve strong zero-shot forecasting through large-scale pre-training, but adapting them to downstream domains under distribution shift remains challenging. Existing solutions face a trade-off: Parametric Adaptation can cause catastrophic forgetting and requires costly multi-domain maintenance, while Non-Parametric Retrieval improves forecasts but incurs high inference latency due to datastore search. We propose Parametric Memory Distillation and implement it as TS-Memory, a lightweight memory adapter that augments frozen TSFMs. TS-Memory is trained in two stages. First, we construct an offline, leakage-safe kNN teacher that synthesizes confidence-aware quantile targets from retrieved futures. Second, we distill this retrieval-induced distributional correction into a lightweight memory adapter via confidence-gated supervision. During inference, TS-Memory fuses memory and backbone predictions with constant-time overhead, enabling retrieval-free deployment. Experiments across diverse TSFMs and benchmarks demonstrate consistent improvements in both point and probabilistic forecasting over representative adaptation methods, with efficiency comparable to the frozen backbone.