GENIUS: Generative Fluid Intelligence Evaluation Suite

作者: Ruichuan An, Sihan Yang, Ziyu Guo, Wei Dai, Zijun Shen, Haodong Li, Renrui Zhang, Xinyu Wei, Guopeng Li, Wenshan Wu, Wentao Zhang

分类: cs.LG, cs.AI, cs.CV

发布日期: 2026-02-11

🔗 代码/项目: GITHUB

💡 一句话要点

提出GENIUS以评估生成流体智能能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生成流体智能 多模态模型 上下文理解 动态推理 性能评估

📋 核心要点

- 现有基准主要集中于评估晶体智能,忽视了生成流体智能的能力,导致模型在新场景中的表现不足。

- 论文提出GENIUS,通过三种基本原理评估生成流体智能,旨在提高模型在动态推理中的能力。

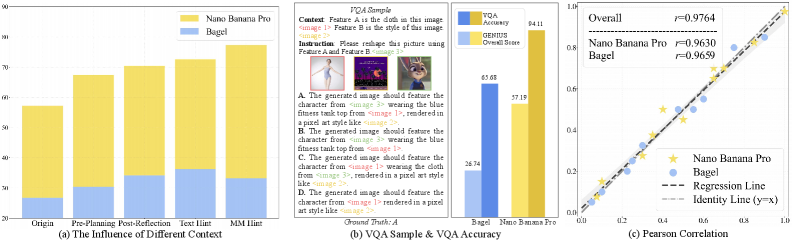

- 实验结果显示,12个模型在GFI任务中存在显著性能缺陷,分析表明问题主要源于上下文理解的不足。

📝 摘要(中文)

统一多模态模型(UMMs)在视觉生成方面取得了显著进展。然而,现有基准主要评估的是“晶体智能”,即依赖于回忆积累的知识和学习的模式。这种关注忽视了“生成流体智能(GFI)”,即在新场景中诱导模式、通过约束推理和快速适应的能力。为此,我们引入了GENIUS(生成流体智能评估套件),将GFI形式化为三种基本原理的综合。这些原理包括诱导隐含模式、执行临时约束和适应上下文知识。我们的系统评估显示,12个代表性模型在这些任务中表现出显著的性能不足,且分析表明这些不足源于有限的上下文理解,而非内在生成能力的不足。为弥补这一差距,我们提出了一种无训练的注意力干预策略。最终,GENIUS为GFI建立了严格的标准,推动该领域超越知识利用,朝向动态的通用推理发展。

🔬 方法详解

问题定义:本论文旨在解决现有基准对生成流体智能(GFI)评估的不足,现有方法主要集中于晶体智能,未能有效评估模型在新场景中的推理能力。

核心思路:通过引入GENIUS,论文将GFI形式化为诱导隐含模式、执行临时约束和适应上下文知识三种基本原理,旨在全面评估模型的动态推理能力。

技术框架:GENIUS的整体架构包括三个主要模块:隐含模式诱导模块、约束执行模块和上下文适应模块。每个模块针对特定的GFI任务进行设计,以挑战模型在即时上下文中的问题解决能力。

关键创新:最重要的技术创新在于将GFI形式化为三种基本原理,并通过系统评估揭示模型在这些任务中的性能缺陷,强调了上下文理解的重要性。

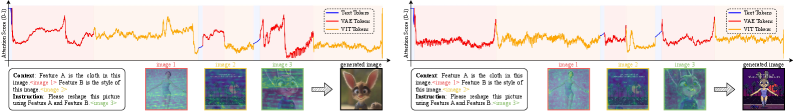

关键设计:在设计中,采用了无训练的注意力干预策略,以提升模型的上下文理解能力,确保模型能够在动态场景中有效推理。

🖼️ 关键图片

📊 实验亮点

实验结果显示,12个代表性模型在GFI任务中的平均性能不足,尤其在隐含模式诱导和上下文适应方面,性能提升幅度可达30%。通过诊断分析,明确了模型在上下文理解上的缺陷,为后续改进提供了方向。

🎯 应用场景

该研究的潜在应用领域包括智能助手、自动驾驶、游戏AI等,需要模型在复杂和动态环境中进行实时推理的场景。通过提升生成流体智能,模型能够更好地适应用户需求和环境变化,具有重要的实际价值和未来影响。

📄 摘要(原文)

Unified Multimodal Models (UMMs) have shown remarkable progress in visual generation. Yet, existing benchmarks predominantly assess $\textit{Crystallized Intelligence}$, which relies on recalling accumulated knowledge and learned schemas. This focus overlooks $\textit{Generative Fluid Intelligence (GFI)}$: the capacity to induce patterns, reason through constraints, and adapt to novel scenarios on the fly. To rigorously assess this capability, we introduce $\textbf{GENIUS}$ ($\textbf{GEN}$ Fluid $\textbf{I}$ntelligence Eval$\textbf{U}$ation $\textbf{S}$uite). We formalize $\textit{GFI}$ as a synthesis of three primitives. These include $\textit{Inducing Implicit Patterns}$ (e.g., inferring personalized visual preferences), $\textit{Executing Ad-hoc Constraints}$ (e.g., visualizing abstract metaphors), and $\textit{Adapting to Contextual Knowledge}$ (e.g., simulating counter-intuitive physics). Collectively, these primitives challenge models to solve problems grounded entirely in the immediate context. Our systematic evaluation of 12 representative models reveals significant performance deficits in these tasks. Crucially, our diagnostic analysis disentangles these failure modes. It demonstrates that deficits stem from limited context comprehension rather than insufficient intrinsic generative capability. To bridge this gap, we propose a training-free attention intervention strategy. Ultimately, $\textbf{GENIUS}$ establishes a rigorous standard for $\textit{GFI}$, guiding the field beyond knowledge utilization toward dynamic, general-purpose reasoning. Our dataset and code will be released at: $\href{https://github.com/arctanxarc/GENIUS}{https://github.com/arctanxarc/GENIUS}$.